¿Lo que acaba de suceder? En la conferencia Nvidia GTC 2024 del lunes, la compañía presentó su plataforma GPU Blackwell que, según dice, está diseñada para el procesamiento generativo de IA. La línea de próxima generación incluye la GPU B200 y el «superchip» GB200 Grace que ofrecen todo el rendimiento necesario para las cargas de trabajo de inferencia LLM al tiempo que reducen sustancialmente el consumo de energía.

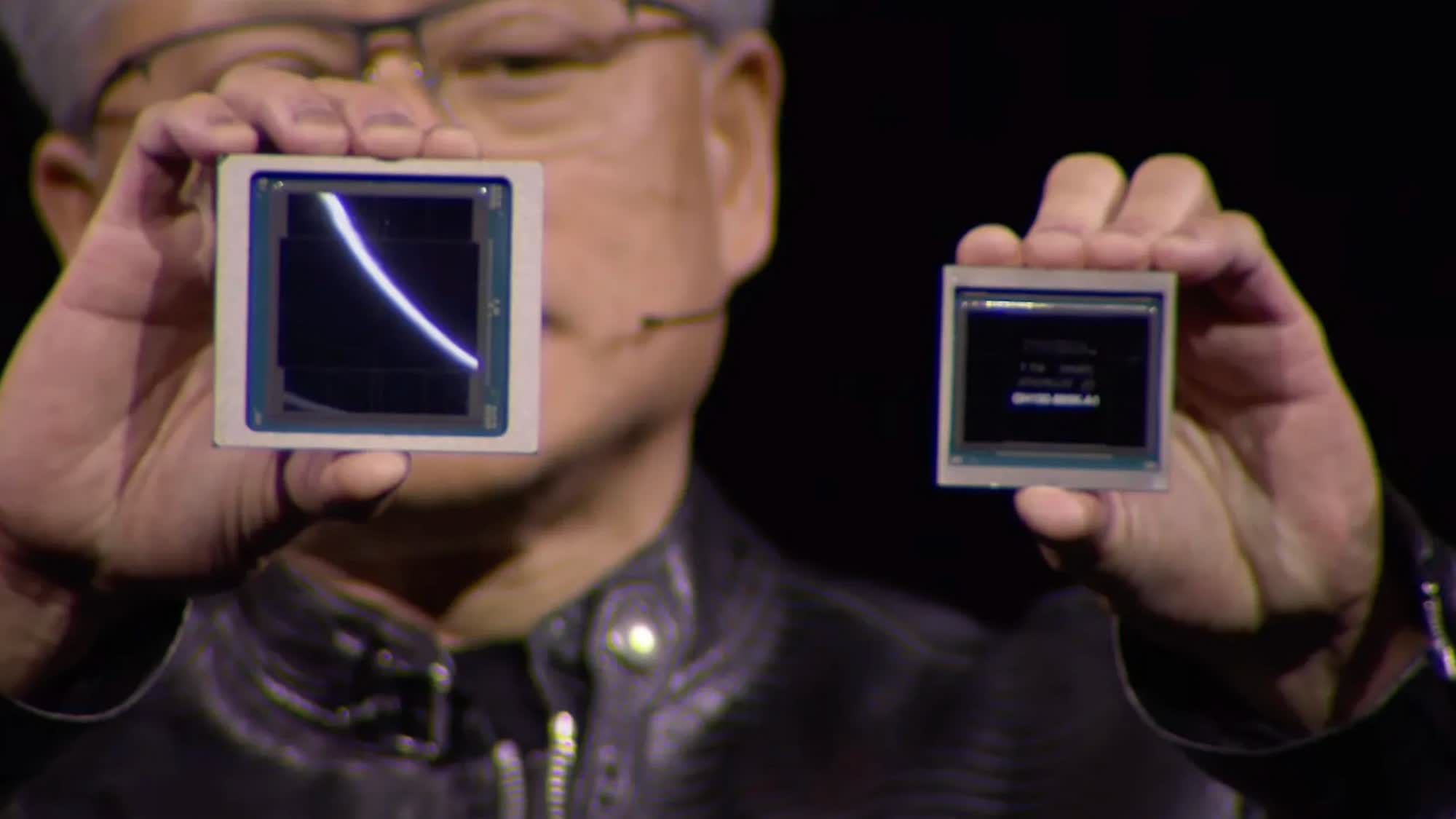

La GPU B200 incluye 208 mil millones de transistores y ofrece hasta 20 petaflops de rendimiento FP4. También incluye un rápido motor transformador de segunda generación con precisión FP8. El GB200 Grace combina dos de estos chips B200 con una CPU Nvidia Grace y los conecta a través de una interfaz NVLink Chip-to-Chip (C2C) que ofrece 900 GB/s de ancho de banda bidireccional. La compañía afirma que los nuevos aceleradores ayudarían a lograr avances en el procesamiento de datos, la simulación de ingeniería, el diseño electrónico, la automatización, el diseño de fármacos asistido por computadora y la computación cuántica.

De acuerdo a NVIDIA, solo 2.000 GPU Blackwell pueden entrenar un LLM de 1.8 mil millones de parámetros mientras consumen solo cuatro megavatios de energía, mientras que antes se habrían necesitado 8.000 GPU Hopper y 15 megavatios para completar la misma tarea. La compañía también afirma que en un punto de referencia GPT-3 LLM con 175 mil millones de parámetros, el GB200 ofrece un aumento de rendimiento 7 veces mayor que un H100 y al mismo tiempo ofrece un rendimiento de entrenamiento 4 veces más rápido. También se dice que los nuevos chips reducen los costos operativos y el consumo de energía hasta 25 veces.

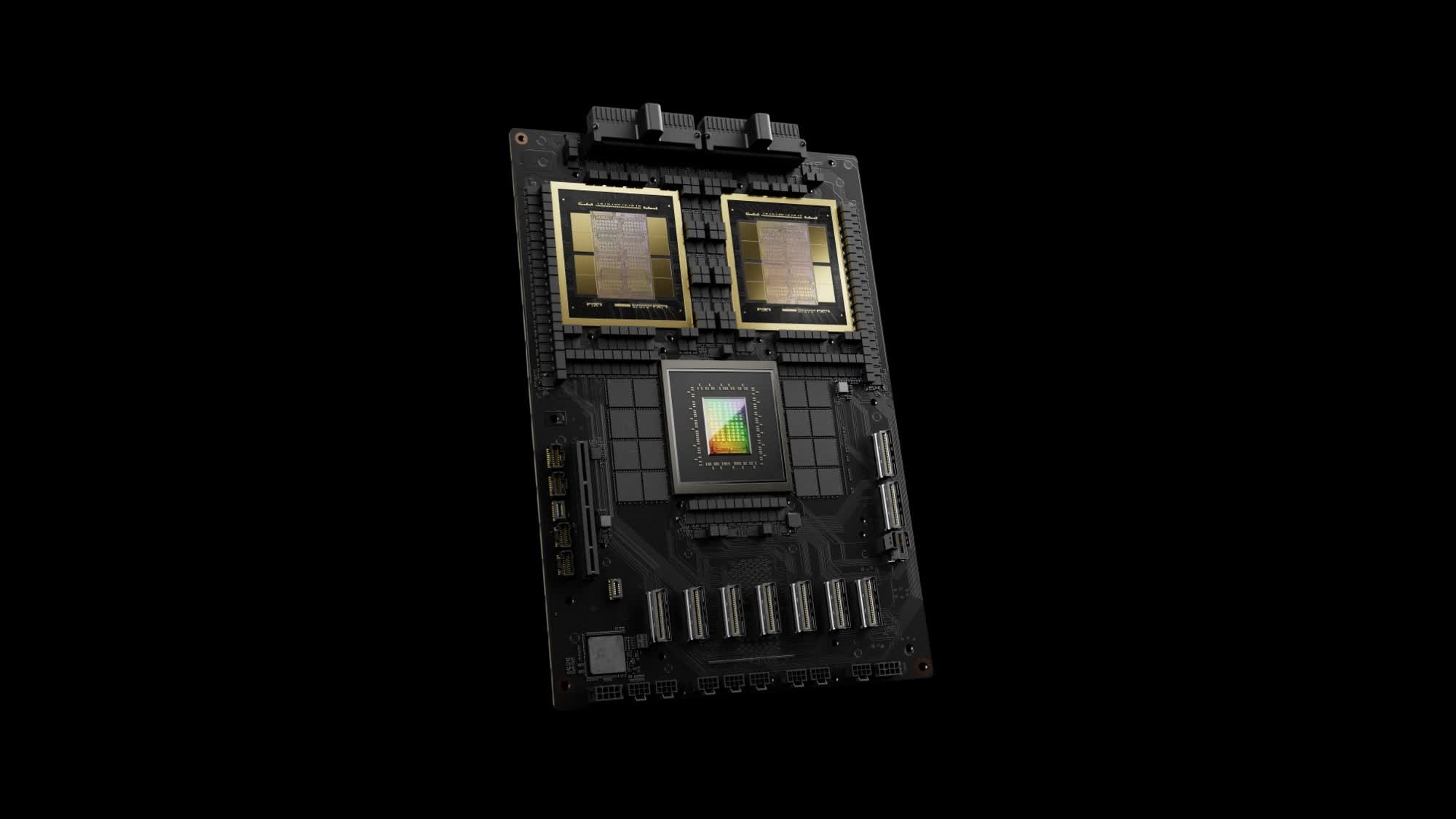

Además de los chips individuales, Nvidia también desvelado un sistema de múltiples nodos, refrigerado por líquido y a escala de rack llamado GB200 NVL72 para cargas de trabajo informáticas intensivas. Combina 36 Superchips Grace Blackwell, que incluyen 72 GPU Blackwell y 36 CPU Grace interconectadas por NVLink de quinta generación. El sistema viene con 30 TB de memoria rápida y ofrece 1,4 exaflops de rendimiento de IA para el DGX SuperPOD más nuevo. Nvidia afirma que ofrece 30 veces el rendimiento de un sistema H100 en aplicaciones que consumen muchos recursos como el parámetro GPT-MoE de 1,8T.

Se espera que muchas organizaciones y empresas adopten Blackwell, y la lista incluye el quién es quién virtual de Silicon Valley. Algunas de las empresas tecnológicas más grandes de EE. UU. que implementarán las nuevas GPU incluyen Amazon Web Services (AWS), Dell, Google, Meta, Microsoft, OpenAI, Oracle, Tesla y xAI, entre otras.

Desafortunadamente para los entusiastas de los juegos, el director ejecutivo de Nvidia, Jensen Huang, no reveló nada sobre el GPU para juegos Blackwell que se espera que se lancen a finales de este año o principios de 2025. Se espera que la línea esté liderada por el RTX 5090 impulsado por la GPU GB202, mientras que el RTX 5080 estará respaldado por el GB203.