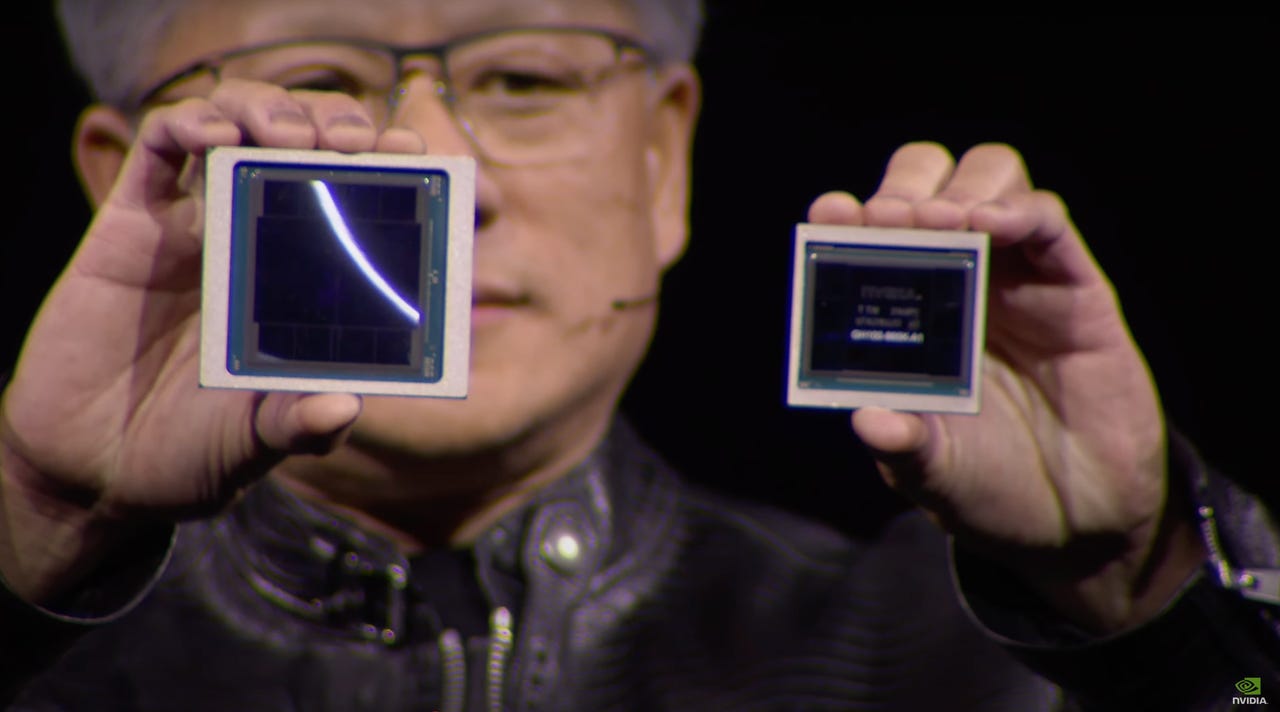

El cofundador y director ejecutivo de Nvidia, Jensen Huang, levantó el nuevo chip GPU Blackwell, a la izquierda, para compararlo con su predecesor, el H100, «Hopper». NVIDIA

El director ejecutivo de Nvidia, Jensen Huang, presidió el lunes la primera conferencia tecnológica del fabricante de chips de IA celebrada en persona desde la pandemia de COVID-19, la Conferencia de Tecnología GPU, o GTC, en San José, California, y dio a conocer el nuevo diseño de la compañía para sus chips, código- llamado «Blackwell«.

Muchos consideran que GTC es el «Woodstock de la IA» o el «Lalapalooza de la IA». «Espero que se den cuenta de que esto no es un concierto», dijo Huang tras un gran aplauso al principio. Llamó a la gran colección de socios y clientes presentes.

«Michael Dell está sentado allí», dijo Huang, señalando que el fundador y director ejecutivo de Dell estaba entre la audiencia.

También: La startup de IA Cerebras presenta el WSE-3, el chip más grande hasta el momento para IA generativa

Huang enfatizó la escala de computación necesaria para entrenar grandes modelos lingüísticos de IA generativa o GenAI. Un modelo que tiene billones de parámetros, combinados con datos de entrenamiento que son billones de «tokens» o partes de palabras, requeriría «30 mil billones de operaciones de punto flotante», o 30 mil millones de petaFLOPS, señaló Huang. «Si tuvieras una GPU petaFLOP, necesitarías 30 mil millones de segundos para calcular y entrenar ese modelo; 30 mil millones de segundos son aproximadamente 1000 años».

«Me gustaría hacerlo antes, pero vale la pena; esa suele ser mi respuesta», bromeó Huang.

Huang abrió su presentación con una visión general del tamaño cada vez mayor de las cargas de trabajo de la IA, señalando que los chips más potentes tardarían 30 mil millones de segundos, o 1.000 años, en entrenarse. NVIDIA

La GPU H100 de Nvidia, el chip de última generación actual, ofrece del orden de 2.000 billones de operaciones de punto flotante por segundo, o 2.000 TFLOPS. Mil TFLOPS equivalen a un petaFLOP, ergo, el H100, y su hermano, el H200, sólo pueden gestionar un par de petaFLOPS, muy por debajo de los 30 mil millones a los que se refería Huang.

También: Hacer que GenAI sea más eficiente con un nuevo tipo de chip

«Lo que necesitamos son GPU más grandes; necesitamos GPU mucho, mucho más grandes», dijo.

Blackwell, conocido en la industria como «HopperNext», puede realizar 20 petaFLOPS por GPU. Está destinado a entregarse en un sistema de 8 vías, un Placa de circuito «HGX» de los chips..

Utilizando la «cuantización», una especie de matemática comprimida en la que cada valor de una red neuronal se representa utilizando menos decimales, llamada «FP4», el chip puede ejecutar hasta 144 petaFLOP en un sistema HGX.

El chip tiene 208 mil millones de transistores, dijo Huang, utilizando un proceso de fabricación de semiconductores personalizado en Taiwan Semiconductor Manufacturing conocido como «4NP». Eso es más del doble de los 80 mil millones de GPU Hopper.

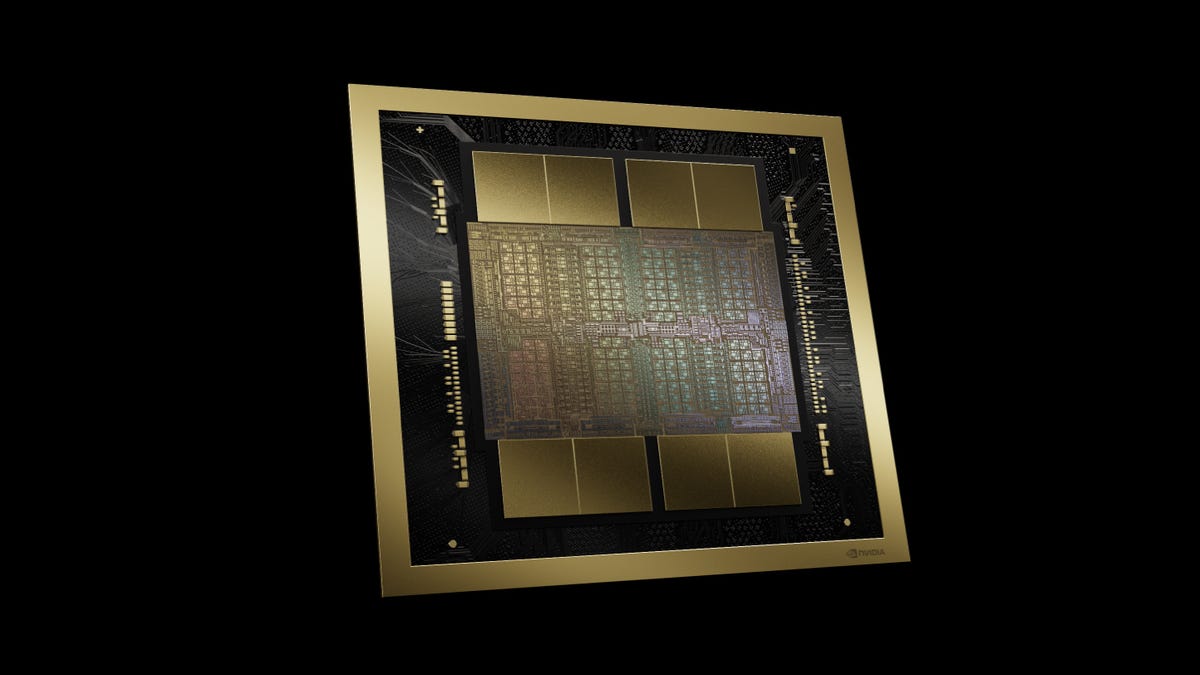

La GPU Nvidia Blackwell multiplica por diez el número de operaciones matemáticas de punto flotante por segundo y duplica con creces el número de transistores de la serie predecesora «Hopper». Nvidia destaca la capacidad del chip para ejecutar grandes modelos de lenguaje 25 veces más rápido. NVIDIA

Blackwell puede ejecutar grandes modelos de lenguaje de IA generativa con un billón de parámetros 25 veces más rápido que los chips anteriores, dijo Huang.

También: Para la era de las PC con IA, aquí llega una nueva prueba de velocidad

El chip lleva el nombre de David Harold Blackwell, quien, según relata Nvidia, era «un matemático especializado en teoría de juegos y estadística, y el primer erudito negro ingresado en la Academia Nacional de Ciencias».

El chip Blackwell utiliza una nueva versión del enlace de red de alta velocidad de Nvidia, NVLink, que entrega 1,8 terabytes por segundo a cada GPU. Una parte discreta del chip es lo que Nvidia llama «motor RAS», para mantener «la confiabilidad, disponibilidad y capacidad de servicio» del chip. Una colección de circuitos de descompresión mejora el rendimiento de cosas como las consultas a bases de datos.

Amazon Web Services, Dell, Google, Meta, Microsoft, OpenAI, Oracle, Tesla y xAI se encuentran entre los primeros en adoptar Blackwell.

Al igual que sus predecesores, se pueden combinar dos GPU Blackwell con uno de los microprocesadores «Grace» de Nvidia para producir un chip combinado, llamado «GB200 Grace Blackwell Superchip».

Al igual que sus GPU Hopper predecesoras, se pueden combinar dos GPU Blackwell con uno de los microprocesadores «Grace» de Nvidia para producir un chip combinado, llamado «GB200 Grace Blackwell Superchip». NVIDIA

Se pueden combinar treinta y seis Grace y 72 GPU para una computadora basada en bastidor que Nvidia llama «GB200 NVL72» que puede realizar 1.440 petaFLOPS, acercándose a los mil millones de petaFLOP que citó Huang.

Un nuevo sistema para los chips, el DGX SuperPODcombina «decenas de miles» de Grace Blackwell Superchips, aumentando aún más las operaciones por segundo.

También: Nvidia potencia su ‘superchip’ Grace-Hopper con memoria más rápida para IA

Además de Blackwell, Nvidia hizo varios anuncios adicionales:

- Nuevos algoritmos de IA generativa para mejorar su biblioteca existente de algoritmos de diseño de semiconductores conocida como «cuLitho», en referencia a la fotolitografía utilizada en el proceso de diseño de semiconductores. El código GenAI genera una «fotomáscara» inicial para la litografía, que luego puede perfeccionarse mediante métodos tradicionales. Esto acelera el diseño de tales fotomáscaras en un 100%. TSMC y el fabricante de software de diseño de chips Synopsys están implementando cuLitho y las nuevas funciones GenAI en sus tecnologías.

- Una nueva línea de conmutadores de red y tarjetas de interfaz de red basado en la tecnología InfiniBand desarrollada por la operación Mellanox de Nvidia, el «Quantum-X800 Infiniband» y el estándar de red Ethernet, el «Spectrum-X800 Ethernet». Ambas tecnologías entregan 800 mil millones de bits por segundo, o 800 Gbps. Nvidia dice que los conmutadores y las NIC están «optimizados para la computación GPU de billones de parámetros» para manejar la velocidad de las operaciones de punto flotante de los chips.

- un catalogo de 25 «microservicios» Software de servicios de contenedores de aplicaciones basado en la nube, prediseñado para aplicaciones individuales, incluidos modelos de IA personalizados, creado sobre el paquete de software de contenedores «NIM» de Nvidia, que a su vez forma parte de la oferta de software AI Enterprise de la empresa. Los programas son lo que la compañía describe como una «ruta estandarizada para ejecutar modelos de IA personalizados optimizados para la base instalada CUDA de Nvidia de cientos de millones de GPU en nubes, centros de datos, estaciones de trabajo y PC». Los microservicios incluyen un paquete de productos centrados en las ciencias de la vida, algunos dedicados a tareas de «biología generativa», química y «predicción molecular», para realizar «inferencia», la generación de predicciones, «para una colección cada vez mayor de modelos en imágenes, tecnología médica, descubrimiento de fármacos y salud digital». Los microservicios están disponibles a través de los sistemas de Dell y de otros proveedores, a través de servicios de nube pública, incluidos AWS, Google Cloud, Microsoft Azure y Oracle Cloud Infrastructure, y se pueden probar en el propio servicio de nube de Nvidia.

- Earth-2, un microservicio independiente diseñado como una simulación de «gemelo digital» de condiciones climáticas extremas, destinado a «entregar advertencias y pronósticos actualizados en segundos en comparación con los minutos u horas del modelado tradicional impulsado por CPU». La tecnología se basa en un modelo de IA generativa creado por Nvidia llamado «CorrDiff», que puede generar «imágenes de patrones climáticos con una resolución 12,5 veces mayor» que los modelos numéricos actuales, 1.000 veces más rápido y 3.000 veces más eficiente desde el punto de vista energético. The Weather Company es un usuario inicial de la tecnología.

Una simulación de imágenes terrestres de alta resolución de una simulación de «gemelo digital» de condiciones climáticas extremas, llamado clima Tierra-2, destinado a «entregar advertencias y pronósticos actualizados en segundos en comparación con los minutos u horas en el modelado tradicional impulsado por CPU». La tecnología se basa en un modelo de IA generativa creado por Nvidia llamado «CorrDiff», que puede generar «imágenes de resolución 12,5 veces mayor» de patrones climáticos «que los modelos numéricos actuales, 1.000 veces más rápido y 3.000 veces más eficiente desde el punto de vista energético». The Weather Company es un usuario inicial de la tecnología. NVIDIA

También: Cómo los avances en inteligencia artificial de Apple podrían hacer o deshacer el iPhone 16

Además de los anuncios de productos y tecnología propios, Nvidia anunció una serie de iniciativas con socios:

- A colaboración con oráculo para que la «IA soberana» ejecute programas de IA localmente, «dentro de las instalaciones seguras de un país u organización».

- Una nueva supercomputadora para Amazon AWS construido a partir de sistemas DGX que ejecutan chips Blackwell, llamado «Ceiba».

- Una asociación con Google Cloud ampliar el marco de programación JAX a los chips Nvidia, «ampliando el acceso a la formación LLM a gran escala entre la comunidad de ML en general».

Se pueden encontrar más novedades en la sala de redacción de Nvidia.

Puede vea el discurso de apertura completo en repetición en YouTube.