A pesar de no lanzar nueva IA desde el IA generativa Comenzó la locura, Apple está gestando algunos proyectos de IA. La semana pasada Apple investigadores compartieron un artículo presentar un nuevo modelo lingüístico en el que está trabajando la empresa, y fuentes internas informaron que Apple tiene dos robots impulsados por IA en proceso. Ahora, el lanzamiento de otro trabajo de investigación muestra que Apple no se detiene ahí.

El lunes, los investigadores de Apple dieron a conocer un trabajo de investigación que presentó Ferret-UI, un nuevo modelo multimodal de lenguaje grande (MLLM) capaz de comprender pantallas de interfaz de usuario (UI) móvil.

También: Generar música usando IA en Copilot ahora es aún mejor

Los MLLM se diferencian de los LLM estándar porque van más allá del texto y muestran una comprensión profunda de elementos multimodales como imágenes y audio. En este caso, Ferret-UI está entrenado para reconocer los diferentes elementos de la pantalla de inicio de un usuario, como íconos de aplicaciones y texto pequeño.

Identificar los elementos de la pantalla de la aplicación ha sido un desafío para los MLLM en el pasado debido a su naturaleza pequeña. Para superar ese problema, según el artículo, los investigadores agregaron «cualquier resolución» encima de Ferret que le permita ampliar los detalles en la pantalla.

Partiendo de eso, MLLM de Apple también tiene «capacidades de referencia, conexión a tierra y razonamiento», que permiten a Ferret-UI comprender completamente las pantallas de la interfaz de usuario y realizar tareas cuando se le indica en función del contenido de la pantalla, según el documento, como se ve en el foto de abajo.

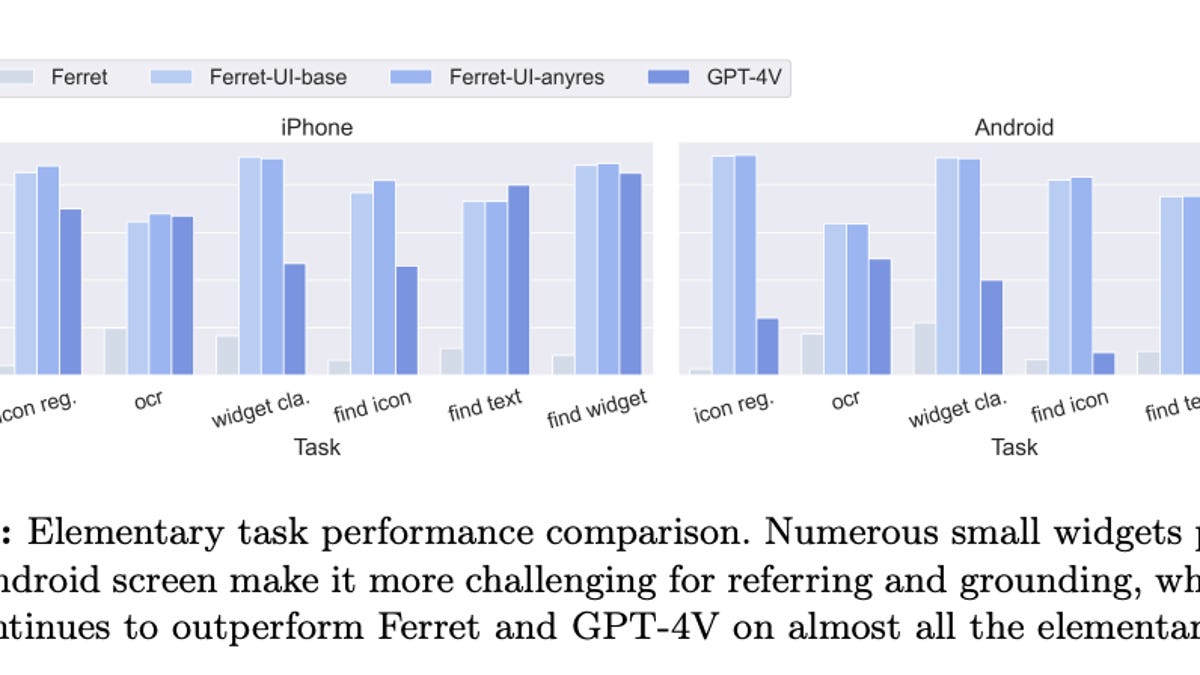

Para medir el rendimiento del modelo en comparación con otros MLLM, los investigadores de Apple compararon Ferret-UI con GPT-4V, el MLLM de OpenAI, en puntos de referencia públicos, tareas elementales y tareas avanzadas. Los resultados pueden sorprenderte.

También: Los mejores generadores de imágenes con IA para probar ahora mismo

Ferret-UI superó a GPT-4V en casi todas las tareas de la categoría elemental, incluido el reconocimiento de íconos, OCR, clasificación de widgets, búsqueda de íconos y tareas de búsqueda de widgets en iPhone y Android, con la única excepción de la tarea de buscar texto en iPhone donde GPT -4V superó ligeramente a los modelos Ferret, como se ve en el cuadro a continuación.

Cuando se trata de fundamentar las conversaciones sobre los hallazgos de la interfaz de usuario, GPT-4V tiene una ligera ventaja, superando a Ferret entre un 93,4% y un 91,7%. Sin embargo, los investigadores señalan que el rendimiento de Ferret UI sigue siendo «digno de mención», ya que genera coordenadas sin procesar en lugar del conjunto de cuadros predefinidos entre los que elige GPT-4V. Puede encontrar un ejemplo a continuación.

El documento no aborda para qué planea Apple aprovechar la tecnología, o si lo hará en absoluto. En cambio, los investigadores afirman de manera más amplia que las capacidades avanzadas de Ferret-UI tienen el potencial de impactar positivamente las aplicaciones relacionadas con la interfaz de usuario.

«La llegada de estas capacidades mejoradas promete avances sustanciales para una multitud de aplicaciones de UI posteriores, amplificando así los beneficios potenciales que ofrece Ferret-UI en este dominio», escribieron los investigadores.

Sin embargo, las posibilidades de Ferret-UI para mejorar Siri son evidentes. Debido a la comprensión profunda que tiene el modelo de la pantalla de la aplicación de un usuario y al conocimiento de cómo realizar ciertas tareas, podría usarse para potenciar a Siri y potencialmente hacer que el asistente sea capaz de realizar tareas por usted.

Hemos visto cómo la tendencia cambia hacia este tipo de asistente, con el atractivo de nuevos dispositivos de inteligencia artificial como el Conejo R1 ya que pueden realizar toda una tarea por usted, como reservar un vuelo o pedir una comida, sin que usted tenga que instruirlos paso a paso.