en un entrevista reciente con Jim Cramer de CNBC, NVIDIA El director ejecutivo, Jensen Huang, compartió detalles sobre el próximo chip Blackwell de la compañía, cuya creación costó 10 mil millones de dólares en investigación y desarrollo.

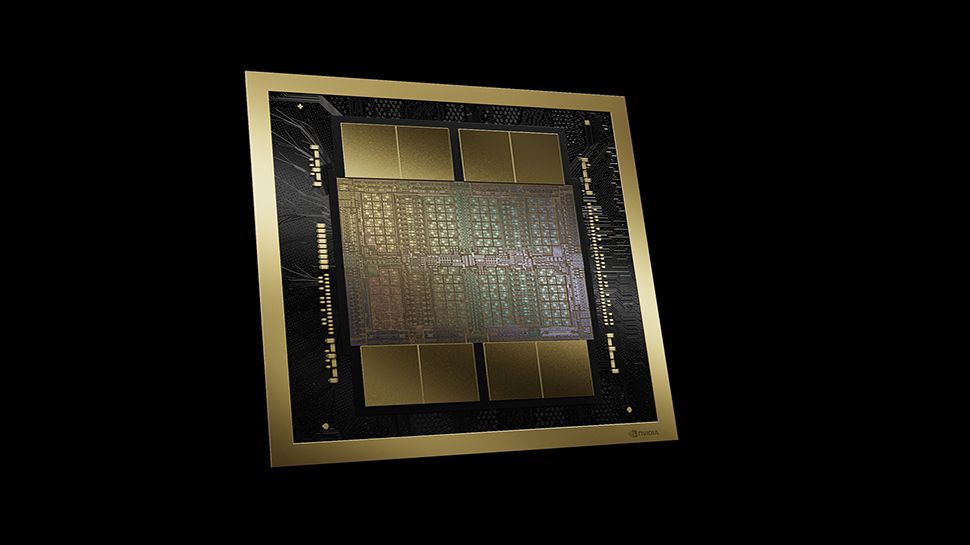

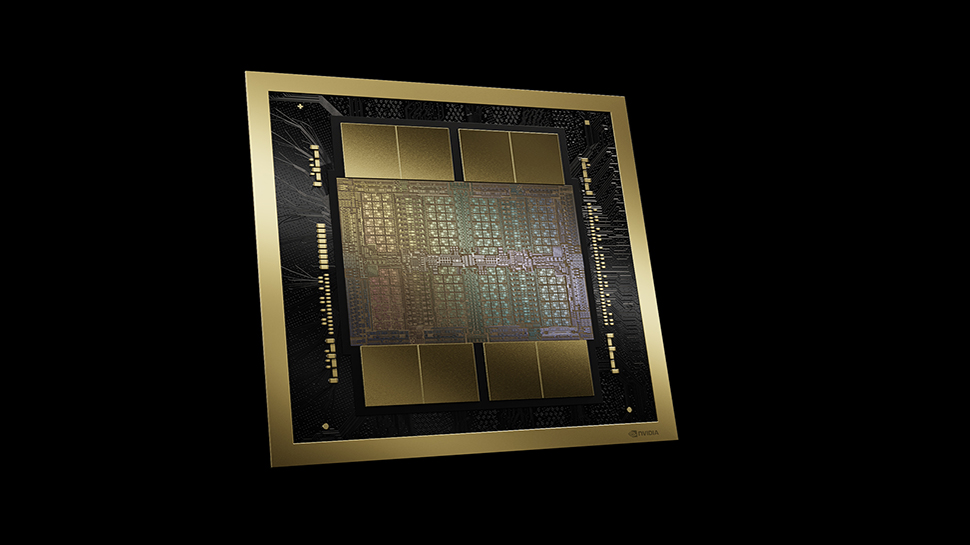

La nueva GPU, que se basa en un proceso 4NP TSMC personalizado y contiene un total de 208 mil millones de transistores (104 mil millones por chip), con 192 GB de memoria HMB3e y 8 TB/s de ancho de banda de memoria, implicó la creación de una nueva tecnología porque lo que el La empresa estaba tratando de lograr «fue más allá de los límites de la física», dijo Huang.

Durante la charla, Huang también reveló que el chip Blackwell del tamaño de un puño se venderá por «entre 30.000 y 40.000 dólares». Su precio es similar al del H100, que según los analistas costaba entre 25.000 y 40.000 dólares por chip cuando la demanda estaba en su punto máximo.

Un gran margen

Según estimaciones de la firma de servicios de inversión Raymond James (vía @primeroadopter), la fabricación de las Nvidia B200 le costará a Nvidia más de 6.000 dólares, en comparación con los costes de producción estimados de 3.320 dólares de la H100.

El precio de venta final real de la GPU variará dependiendo de si se compra directamente a Nvidia o a través de un vendedor externo, pero no es probable que los clientes compren solo los chips.

Nvidia ya ha presentado tres variaciones de su acelerador Blackwell AI con diferentes configuraciones de memoria: B100, B200 y GB200, que reúne dos GPU Nvidia B200 Tensor Core y una CPU Grace. La estrategia de Nvidia, sin embargo, está orientada a vender supercomputadoras de inteligencia artificial de millones de dólares, como el sistema de escala en rack NVIDIA GB200 NVL72 con múltiples nodos y refrigeración líquida, servidores DGX B200 con ocho GPU Blackwell o SuperPOD DGX B200.