En una época en la que los estafadores utilizan la IA generativa para estafa de dinero o empañar la reputación de uno, las empresas de tecnología están ideando métodos para ayudar a los usuarios a verificar el contenido, al menos imágenes fijas, para empezar. Como se burla en su Estrategia de desinformación 2024OpenAI ahora incluye metadatos de procedencia en imágenes generadas con ChatGPT en la web y DALL-E 3 API, y sus contrapartes móviles recibirán la misma actualización antes del 12 de febrero.

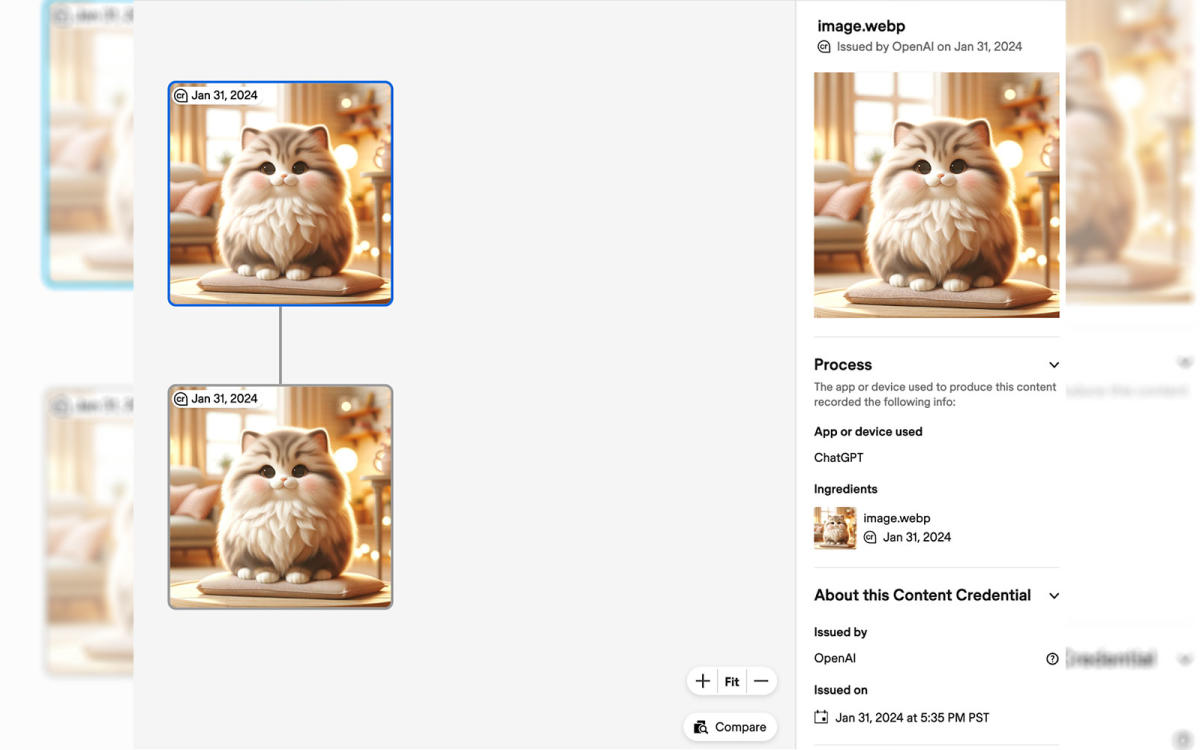

Los metadatos siguen el estándar abierto C2PA (Coalición para la procedencia y autenticidad del contenido), y cuando una de esas imágenes se carga en el Verificación de credenciales de contenido herramienta, podrá rastrear su linaje de procedencia. Por ejemplo, una imagen generada con ChatGPT mostrará un manifiesto de metadatos inicial que indica su origen de API DALL-E 3, seguido de un segundo manifiesto de metadatos que muestra que apareció en ChatGPT.

A pesar de la sofisticada tecnología criptográfica detrás del estándar C2PA, este método de verificación sólo funciona cuando los metadatos están intactos; la herramienta no sirve de nada si carga una imagen generada por IA sin metadatos, como es el caso de cualquier captura de pantalla o imagen cargada en las redes sociales. Como era de esperar, las imágenes de muestra actuales en el página oficial de DALL-E 3 devuelto en blanco también. En sus Página de preguntas frecuentesOpenAI admite que esta no es una solución milagrosa para abordar la guerra de la desinformación, pero cree que la clave es alentar a los usuarios a buscar activamente tales señales.

Si bien el último esfuerzo de OpenAI para frustrar el contenido falso se limita actualmente a imágenes fijas, DeepMind de Google ya lo ha hecho. SynthID para marcar digitalmente marcas de agua tanto en imágenes como en audio generado por IA. Mientras tanto, Meta ha estado probando marcas de agua invisibles a través de su Generador de imágenes de IAque puede ser menos propenso a ser manipulado.