En breve: A medida que la IA generativa devora cada vez más capacidad, la evolución de los productos de memoria de gran ancho de banda será clave para su funcionamiento continuo. Los proveedores están lanzando productos HBM3 de segunda generación, pero el HBM4 traerá un cambio real.

El nuevo producto de memoria de gran ancho de banda de SK Hynix, HBM3E, se encuentra actualmente en producción en masa y se introducirá en el mercado en la primera mitad de este año, según comentarios hizo el vicepresidente Kim Chun-hwan durante su discurso de apertura en SEMICON Corea 2024 la semana pasada. Para 2026, la compañía espera producir en masa HBM4, su sexta generación de HBM, añadió.

Kim también proporcionó información sobre los productos flash DRAM y NAND de la empresa. Actualmente está produciendo en masa productos de ancho de línea de circuito de nivel 1b y desarrollando 1c, que representa la próxima generación, dijo. Sin embargo, SK Hynix prevé «graves limitaciones tecnológicas» por debajo del nivel de 10 nanómetros y por ello la empresa sigue desarrollando nuevos materiales y estructuras.

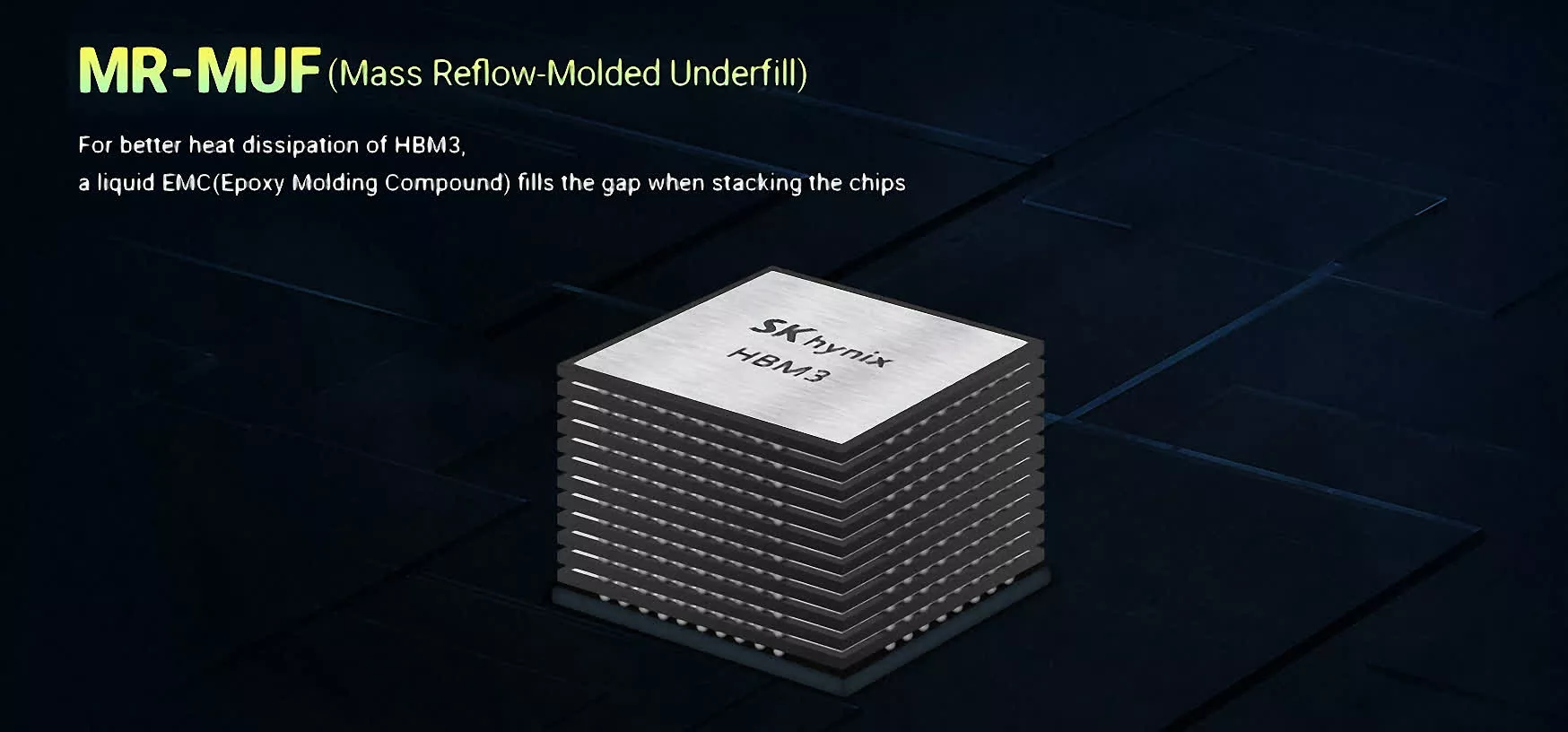

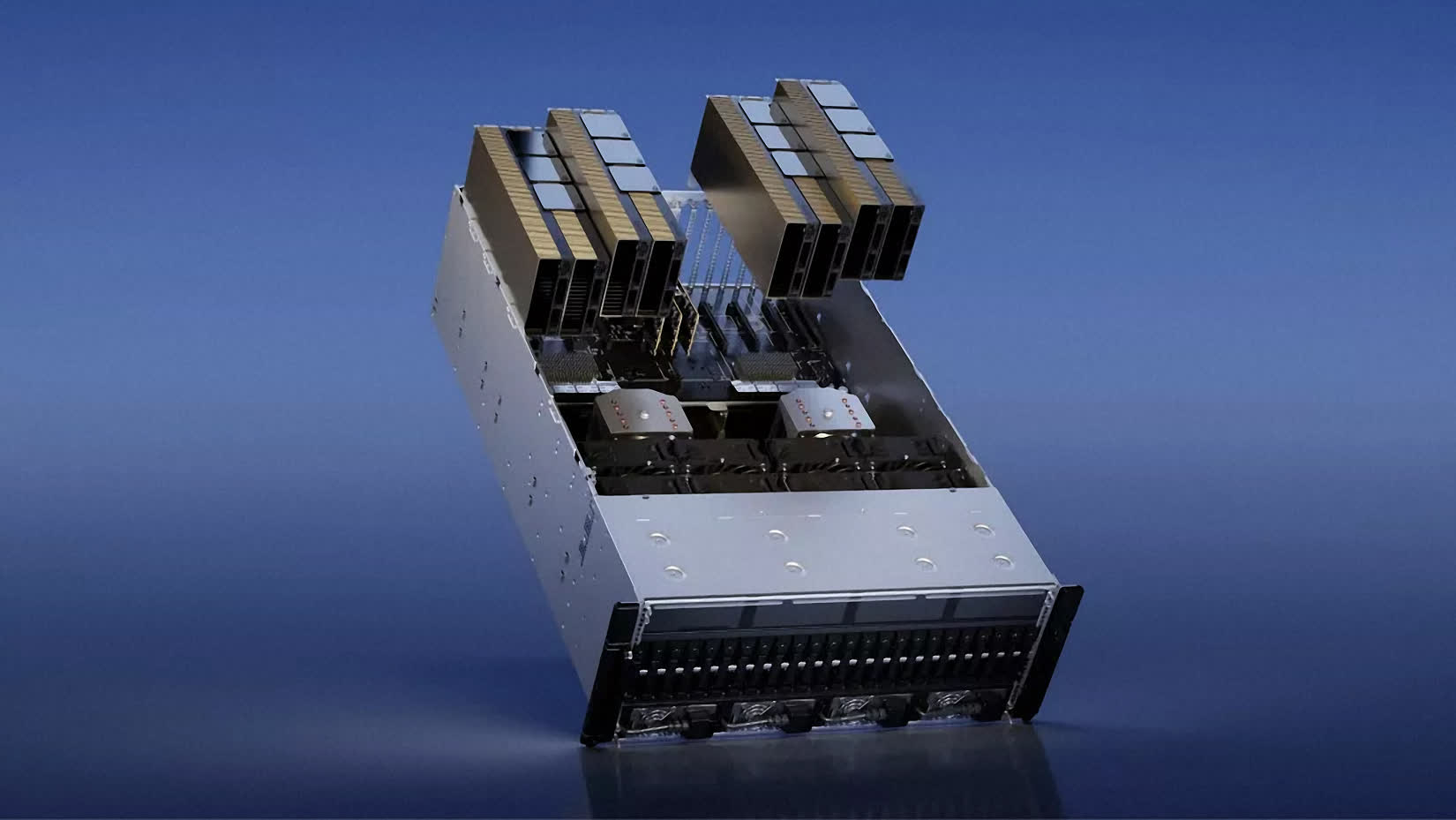

El rápido crecimiento de la IA generativa está impulsando la demanda de estos productos de memoria, y Kim señaló que se espera que el mercado de la IA generativa crezca a una tasa anual del 35 %. En particular, la memoria de gran ancho de banda (introducida al mercado por primera vez en 2013 en medio de advertencias de que nunca sería comercialmente viable) permite las transferencias de datos ultrarrápidas necesarias para muchas de estas aplicaciones. Solo por citar un ejemplo, Micron Technology se jacta de que su memoria HBM3 Gen2 con un ancho de banda superior a 1,2 TB/s y una velocidad de pin de más de 9,2 Gb/s reduce los tiempos de entrenamiento de modelos de lenguajes grandes como GPT-4. En resumen, el rendimiento se ha disparado.

La primera versión de la memoria de gran ancho de banda fue algo limitada, solo permitiendo velocidades de hasta 128 GB/s por pila. HBM2 duplicó las velocidades potenciales a 256 GB/s por pila y la capacidad máxima a 8 GB. En 2018, HBM2 recibió una actualización llamada HBM2E, que aumentó aún más los límites de capacidad a 24 GB y trajo otro aumento de velocidad, llegando finalmente a 460 GB/s por chip en su punto máximo. La velocidad se duplicó nuevamente con el lanzamiento de HBM3, a un máximo de 819 GB/s por pila, mientras que las capacidades aumentaron a 64 GB. Luego vino otra actualización, HBM3E, que aumentó las velocidades teóricas hasta 1,2 TB/s por pila.

A lo largo de esta historia, HBM mantuvo la misma interfaz de 1024 bits por pila, una característica definitoria de la tecnología. Pero eso cambiará con HBM4, que se espera que tenga una interfaz de 2048 bits que teóricamente podría duplicar las velocidades de transferencia nuevamente, suponiendo que los fabricantes puedan mantener las mismas tasas de transferencia, una hazaña que está en duda.

A medida que evolucionan las especificaciones de HBM, también lo hace el propio mercado. Trendforce informó el año pasado que Nvidia planea diversificar sus proveedores de HBM para una gestión de la cadena de suministro más sólida y eficiente. También predijo un cambio significativo hacia la demanda de personalización en el mercado HBM4, alejándose del enfoque estandarizado de la DRAM básica. Se espera que este paso hacia la personalización genere estrategias únicas de diseño y precios, dijo Trendforce, y marque el comienzo de una era de producción especializada en tecnología de HBM.