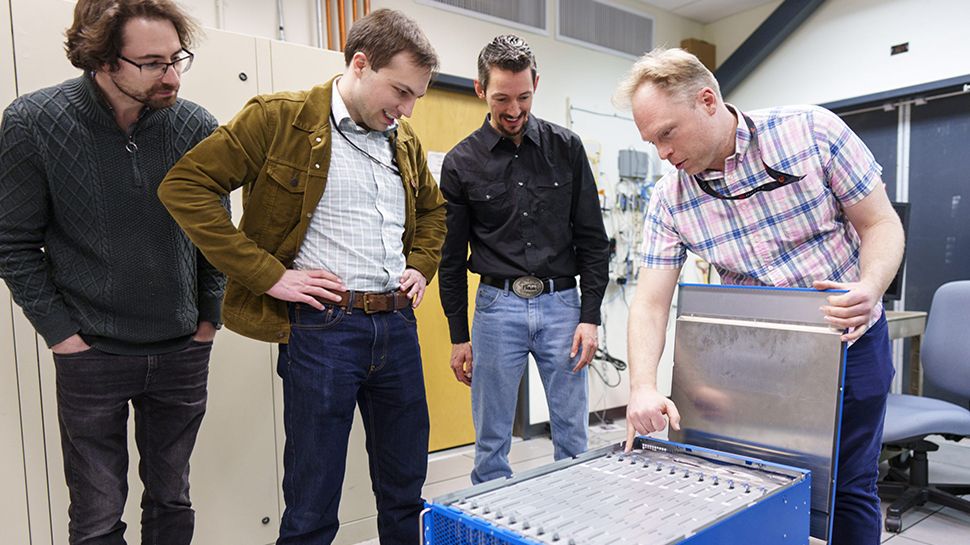

Groq, liderado por el ex-Google El ingeniero y director ejecutivo Jonathan Ross, afirma haber creado la primera Unidad de procesamiento de lenguaje (LPU) que, según dice, puede ofrecer las velocidades más rápidas para aplicaciones de inteligencia artificial.

Es una afirmación audaz, pero que las últimas demostraciones respaldan con creces, lo que sugiere que bien podría convertirse en un punto de inflexión absoluto para la IA.

Ross, quien anteriormente diseñó la unidad de procesamiento tensorial (TPU) de Google, lanzó Groq en 2016 para crear un chip capaz de ejecutar tareas de inferencia de aprendizaje profundo de manera más eficiente que las CPU y GPU existentes.

Velocidad del rayo

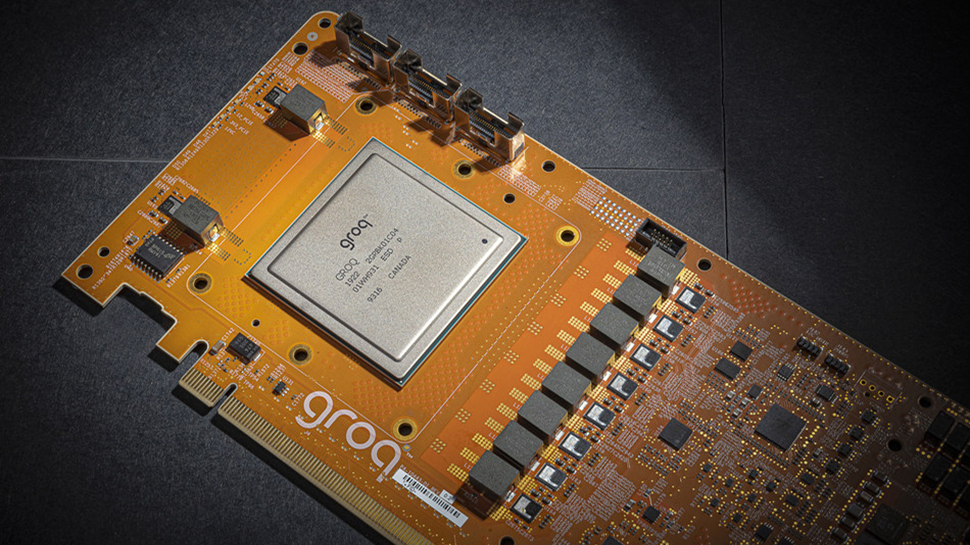

El Tensor Stream Processor (TSP) de la empresa se asemeja a una línea de montaje, que procesa tareas de datos de forma secuencial y organizada. Por el contrario, una GPU es similar a una estación de trabajo estática, donde los trabajadores van y vienen para aplicar pasos de procesamiento. La eficiencia del TSP se hizo evidente con el surgimiento de la IA generativa, lo que llevó a Ross a cambiar el nombre del TSP a Unidad de procesamiento del lenguaje (LPU) para aumentar su reconocibilidad.

A diferencia de las GPU, las LPU utilizan un enfoque optimizado, lo que elimina la necesidad de hardware de programación complejo y garantiza una latencia y un rendimiento constantes. Las LPU también son energéticamente eficientes, lo que reduce la sobrecarga de administrar múltiples subprocesos y evita la subutilización de los núcleos. El diseño de chip escalable de Groq permite vincular múltiples TSP sin los tradicionales cuellos de botella, lo que simplifica los requisitos de hardware para modelos de IA a gran escala.

La primera demostración pública de Groq fue un motor de respuestas de IA ultrarrápido que generaba respuestas con cientos de palabras en menos de un segundo. Matt Shumer publicó la prueba en X y dice que más de 3/4 del tiempo se dedicó a buscar y no a generar.

La primera demostración pública que utiliza Groq: un motor de respuestas de IA ultrarrápido. Escribe respuestas objetivas y citadas con cientos de palabras en menos de un segundo. ¡Más de 3/4 del tiempo se dedica a buscar, no a generar! El LLM se ejecuta en una fracción de segundo.https://t.co/dVUPyh3XGV https://t.co/mNV78XkoVB pic.twitter.com/QaDXixgSzp19 de febrero de 2024

Si bien eso es impresionante, ver a Groq enfrentarse cara a cara con Chat-GPT es otra cosa.

Si quieres probar Groq por ti mismo y tener una idea de lo rápido que puede ser para la IA, ve a este chat. página. Utilice el menú desplegable de la izquierda para cambiar entre los diferentes modelos disponibles.