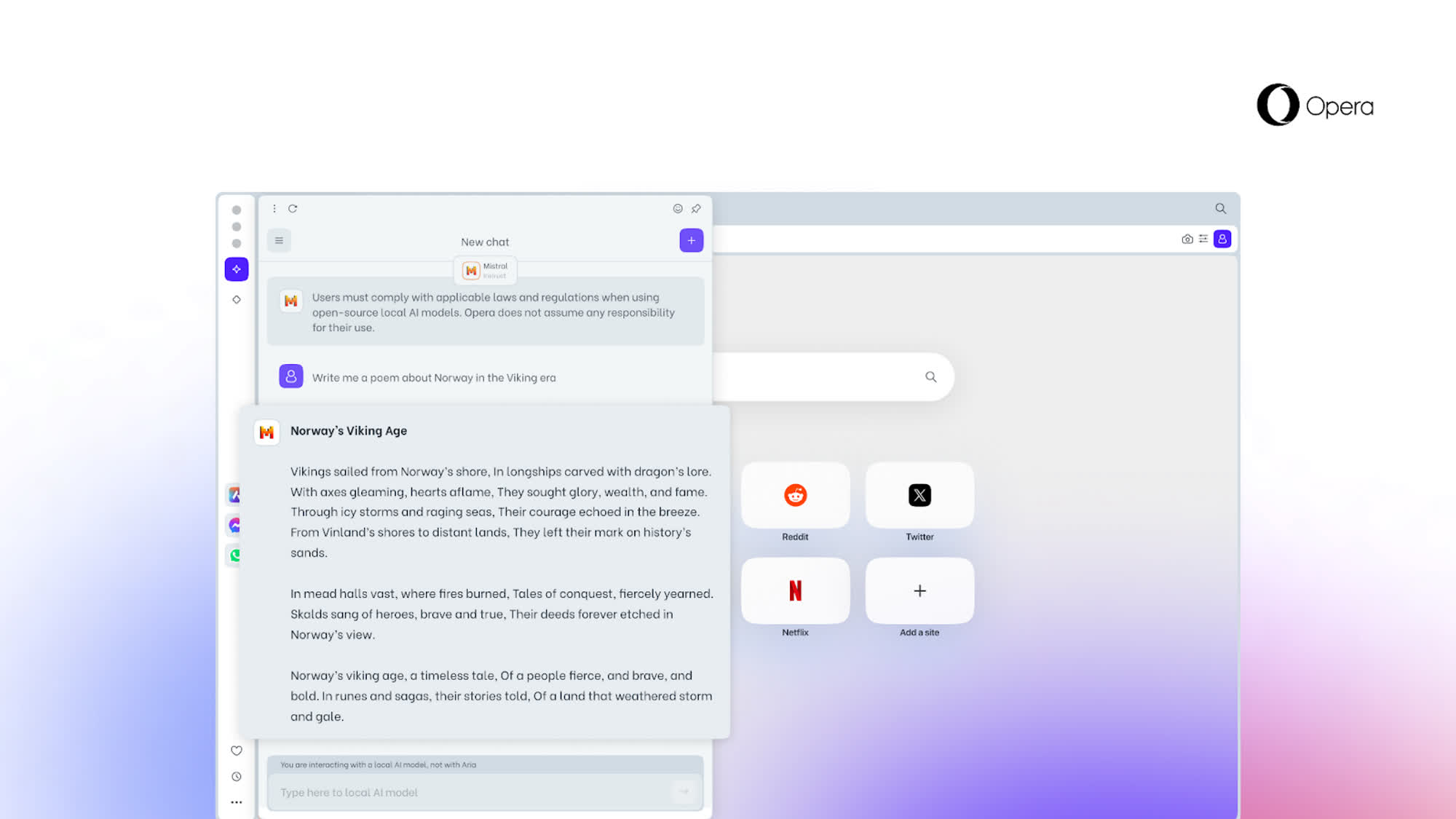

Una patata caliente: Los algoritmos de IA más populares disponibles en la actualidad necesitan acceso constante a Internet para interactuar con potentes centros de datos. Opera Software dice que puede realizar las mismas funciones con sólo un navegador configurado correctamente y una descarga inicial masiva.

Una actualización reciente de la versión de desarrollo de Opera agrega la capacidad de descargar y ejecutar potentes modelos de lenguaje grande (LLM) en la PC de un usuario. El algoritmo de IA se ejecuta en un entorno local, no necesita enviar datos a «servidores de IA» externos y, según la empresa de software con sede en Oslo, está diseñado para proteger la privacidad de los usuarios (o de las empresas).

Desarrollador de Opera One es ahora el primer navegador que proporciona soporte integrado para LLM locales, Opera’s anuncio oficial fijado. Como parte del programa AI Feature Drops de la compañía, el navegador Opera está agregando soporte experimental para 150 algoritmos LLM (en sus variantes locales) que pertenecen a alrededor de 50 familias de modelos de IA diferentes.

Se puede acceder y administrar fácilmente los LLM a través de la interfaz familiar del navegador, e incluyen muchos nombres conocidos en el negocio de la IA, como Llama (Meta), Vicuña, Gemma (Google), Mixtral (Mistral AI) y más. Opera enfatizó que cuando los modelos de lenguaje están confinados en un entorno local, los datos se guardan en el dispositivo del usuario sin necesidad de enviar ninguna información a un servidor remoto.

El programa AI Feature Drops permite a los entusiastas del navegador basado en Chromium probar las primeras versiones de las nuevas funciones que Opera está desarrollando. La compañía dijo que la opción LLM local es «tan innovadora» que incluso podría «romperse». De todos modos, la experimentación es divertida, aunque ejecutar un LLM local requerirá algunos compromisos importantes en términos de espacio de almacenamiento.

Los modelos de lenguaje para chatbots de IA tienden a contener grandes cantidades de datos y Opera advierte sobre estos requisitos. Es probable que cada LLM requiera entre 2 y 10 gigabytes de almacenamiento local, mientras que una oferta excepcional como Megadolphin necesitará una considerable descarga de 67 GB. Los LLM locales también pueden ser «considerablemente más lentos» en comparación con los servicios remotos, ya que no pueden explotar una infraestructura de servidor de IA. El rendimiento dependerá de las capacidades informáticas del hardware del usuario.

La compañía ofrece consejos sobre algunos LLM interesantes para explorar a través del navegador experimental Opera One Developer, citando Code Llama como una extensión de Llama destinada a generar y discutir código. Los programadores pueden trabajar de manera más eficiente, generando fragmentos de código en Python, C++, Java y más. Phi-2 es un LLM de Microsoft Research con capacidades «excepcionales» de razonamiento y comprensión del lenguaje, mientras que Mixtral sobresale en tareas de procesamiento del lenguaje natural.