En contexto: El lunes inició la Conferencia de desarrolladores de juegos de 2024, que se inauguró con empresas que exhibieron sus creaciones de juegos impulsadas por inteligencia artificial. Unity adelantó una colaboración con una startup de IA conversacional, Convai, y Nvidia anunció una serie de proyectos que utilizan MetaHuman y otras tecnologías de IA.

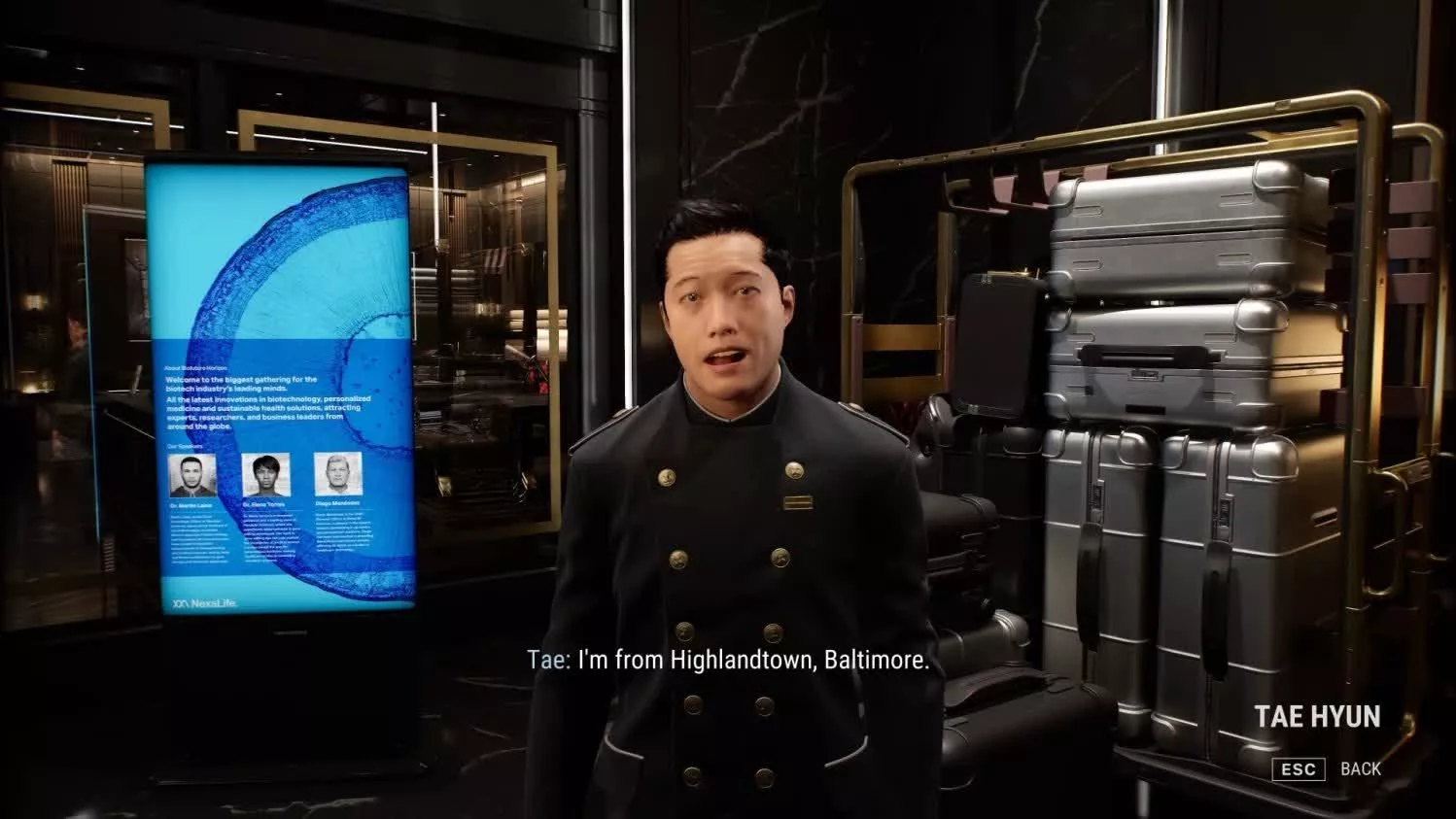

Durante su discurso de apertura de GDC 2024, el director ejecutivo de Nvidia, Jensen Huang, presentó un breve avance/explicación de Covert Protocol, una demostración tecnológica colaborativa con el desarrollador de AI SDK, Inworld AI. Covert Protocol es un nombre en clave para una plataforma de desarrollo mejorada con IA que está construyendo Inworld. Utiliza Unreal Engine 5 y aprovecha varias de las tecnologías de inteligencia artificial de Nvidia, incluido el reconocimiento automático de voz de Riva y Audio2Face, para proporcionar personajes realistas que pueden hablar, reaccionar e interactuar con su entorno en tiempo real.

Covert Protocol es similar a la demostración tecnológica del Proyecto Neural Nexus de Convair/Unity, también presentado en GDC. La principal diferencia es que Covert Protocol se ve mucho mejor que Neural Nexus. Gráficamente, se ve como cabría esperar de UE5 y la tecnología MetaHuman de Epic, lo cual es impresionante. Neural Nexus usa Unity y parece monótono y descolorido.

Los modelos de Covert Protocol parecen un poco más plásticos que las demostraciones anteriores de MetaHuman Creator. Sin embargo, hay que considerar que cuando Epic exhibido En los modelos altamente detallados y casi fotorrealistas, no había fondos complejos para desmenuzar los ciclos. Por lo tanto, los desarrolladores podrían utilizar todos los recursos para hacer que los rostros de MetaHuman parezcan lo más detallados posible. Covert Protocol se acerca más a cómo se verían los modelos en un juego terminado, lo cual sigue siendo bastante bueno.

La jugabilidad de la demostración es más una aventura de misterio conversacional que el FPS que presenta Convai. Así que no pudimos ver ninguna acción intensa, pero sí demostró fragmentos de conversaciones, y las animaciones faciales y la entonación de voz de la IA fueron mucho mejores. El discurso aún no se compara con la actuación de voz humana, pero tampoco está completamente exento de emoción como los modelos de Convai. Hay algunos indicios de emoción allí.

Si bien la demostración fue innegablemente impresionante, plantea preguntas válidas sobre el futuro de los juegos, tal como lo hizo el Proyecto Neural Nexus. Es decir, ¿los jugadores realmente desean tener la capacidad de entablar conversaciones abiertas y a veces absurdas con avatares virtuales de Chat-GTP? ¿O rechazarán estas ideas impulsadas por la IA en favor de la actuación de voz tradicional y los diálogos guionados?

Es difícil decirlo sin un producto terminado. Sin embargo, ya podemos ver la fatiga de la IA a medida que las empresas inundan diariamente a los consumidores con ideas de productos basados en IA. Si la tendencia actual continúa, la IA pronto podría controlarlo todo, desde los juegos hasta las tareas diarias. Los juegos desarrollados sin pensamiento y sin alma, que dependen demasiado de la mecánica de la IA, probablemente molesten a los jugadores en lugar de convertirlos en ventas.