Fábrica de rumores: Microsoft ya ha invertido miles de millones de dólares en OpenAI. Con este nuevo proyecto pretende acortar el tiempo que lleva entrenar modelos de IA para sus servidores. Una nueva tarjeta de red que rivalice con la funcionalidad de ConnectX-7 de Nvidia también daría un impulso al rendimiento de las optimizaciones para los centros de datos de hiperescala de Microsoft.

La información tiene aprendió que Microsoft está desarrollando una nueva tarjeta de red que podría mejorar el rendimiento de su chip de servidor Maia AI. Como beneficio adicional, promovería el objetivo de Microsoft de reducir su dependencia de Nvidia, ya que se espera que la nueva tarjeta de red sea similar a la tarjeta ConnectX-7 de Team Green, que admite Ethernet de 400 Gb con ancho de banda máximo. TechPowerUp especula que con la disponibilidad aún tan lejos, el diseño final podría apuntar a un ancho de banda Ethernet aún mayor, como 800 GbE, por ejemplo.

El objetivo de Microsoft para su nuevo esfuerzo es acortar el tiempo que le toma a OpenAI entrenar sus modelos en servidores de Microsoft y hacer que el proceso sea menos costoso, según el informe. También debería haber otros usos, incluido proporcionar un aumento del rendimiento a partir de optimizaciones específicas necesarias en sus centros de datos de hiperescala, afirma TechPowerUp.

Microsoft tiene invertido miles de millones de dólares en OpenAI, la empresa de inteligencia artificial detrás del popular servicio ChatGPT y otros proyectos como DALL-E y GPT-3, y ha incorporado su tecnología en muchos productos de Microsoft.

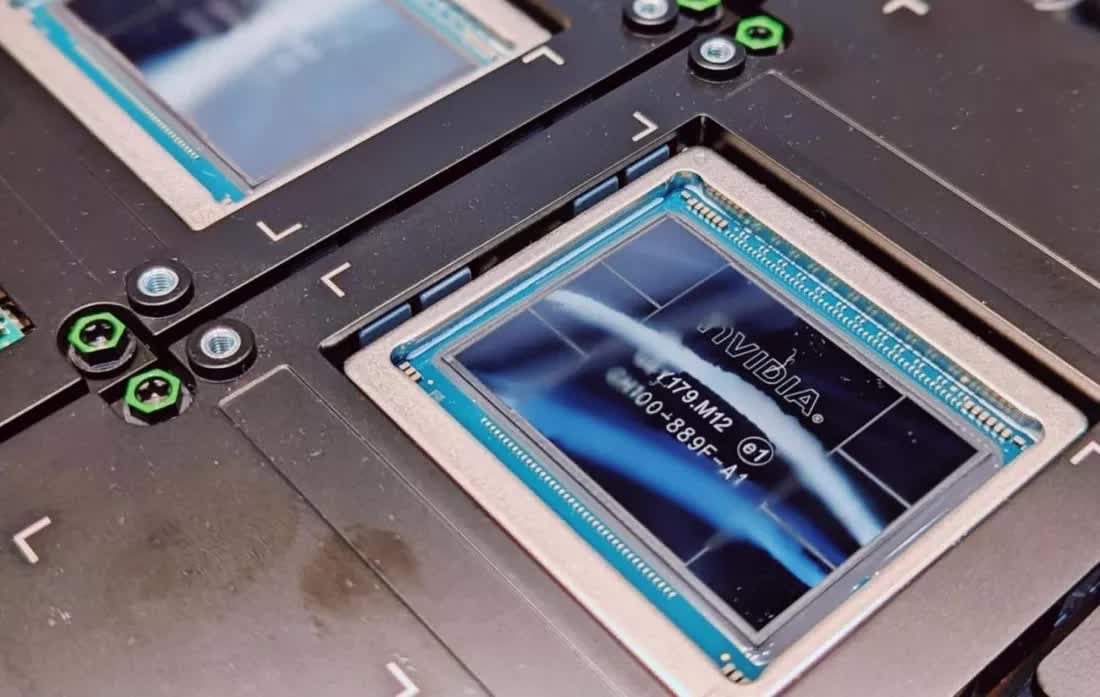

Al mismo tiempo, Microsoft está decidido a reducir su dependencia de Nvidia. El año pasado, Anunciado construyó dos chips locales para manejar la IA y cargas de trabajo informáticas generales en la nube de Azure. Uno de ellos fue el Acelerador de IA Microsoft Azure Maia 100, diseñado para ejecutar modelos de lenguajes grandes como GPT-3.5 Turbo y GPT-4, que posiblemente podría competir con el Superchip de IA H100 de Nvidia. Pero enfrentarse a Nvidia será difícil incluso para Microsoft. La adopción temprana de la tecnología de IA y las capacidades de GPU existentes por parte de Nvidia la han posicionado como el líder indiscutible, con más del 70% del mercado de IA existente de 150 mil millones de dólares.

Aún así, Microsoft está dando un peso significativo a este proyecto, a pesar de que la tarjeta de red podría tardar un año o más en llegar al mercado. Pradeep Sindhu ha sido elegido para encabezar la iniciativa de tarjetas de red de Microsoft. Sindhu cofundó Juniper Networks, así como una startup de chips de servidor llamada Fungible, que Microsoft adquirió el año pasado. Sin embargo, será mejor que Sindhu se dé prisa: Nvidia continúa avanzando en este espacio. A finales del año pasado introducido un nuevo superchip de IA, la GPU H200 Tensor Core, que permite una mayor densidad y un mayor ancho de banda de memoria, ambos factores cruciales para mejorar la velocidad de servicios como ChatGPT y Google Bard.