Una patata caliente: Por segunda vez en poco más de seis meses, Microsoft ha emitido una advertencia sobre el uso de IA generativa por parte de China para sembrar disrupción en Estados Unidos durante este año electoral. También se espera que grupos patrocinados por el Estado, que trabajan con el respaldo de Corea del Norte, apunten a las elecciones en Corea del Sur y la India, habiendo lanzado una campaña similar durante las elecciones presidenciales de Taiwán en enero.

Microsoft informe, titulado Los actores de amenazas de Asia Oriental emplean métodos únicos, señala que las campañas chinas han seguido perfeccionando el contenido generado o mejorado por IA, creando vídeos, memes y audio, entre otros. Si bien su influencia podría no ser demasiado impactante en este momento, puede resultar cada vez más efectiva en el futuro a medida que se vuelva más sofisticada, dijo Microsoft.

En septiembre, los analistas del Centro de análisis de amenazas de Microsoft resaltado una campaña de agentes chinos que utilizaron IA generativa para crear contenido (ver ejemplo a continuación) para publicaciones en redes sociales centradas en temas políticamente divisivos, incluida la violencia armada y la denigración de figuras y símbolos políticos estadounidenses.

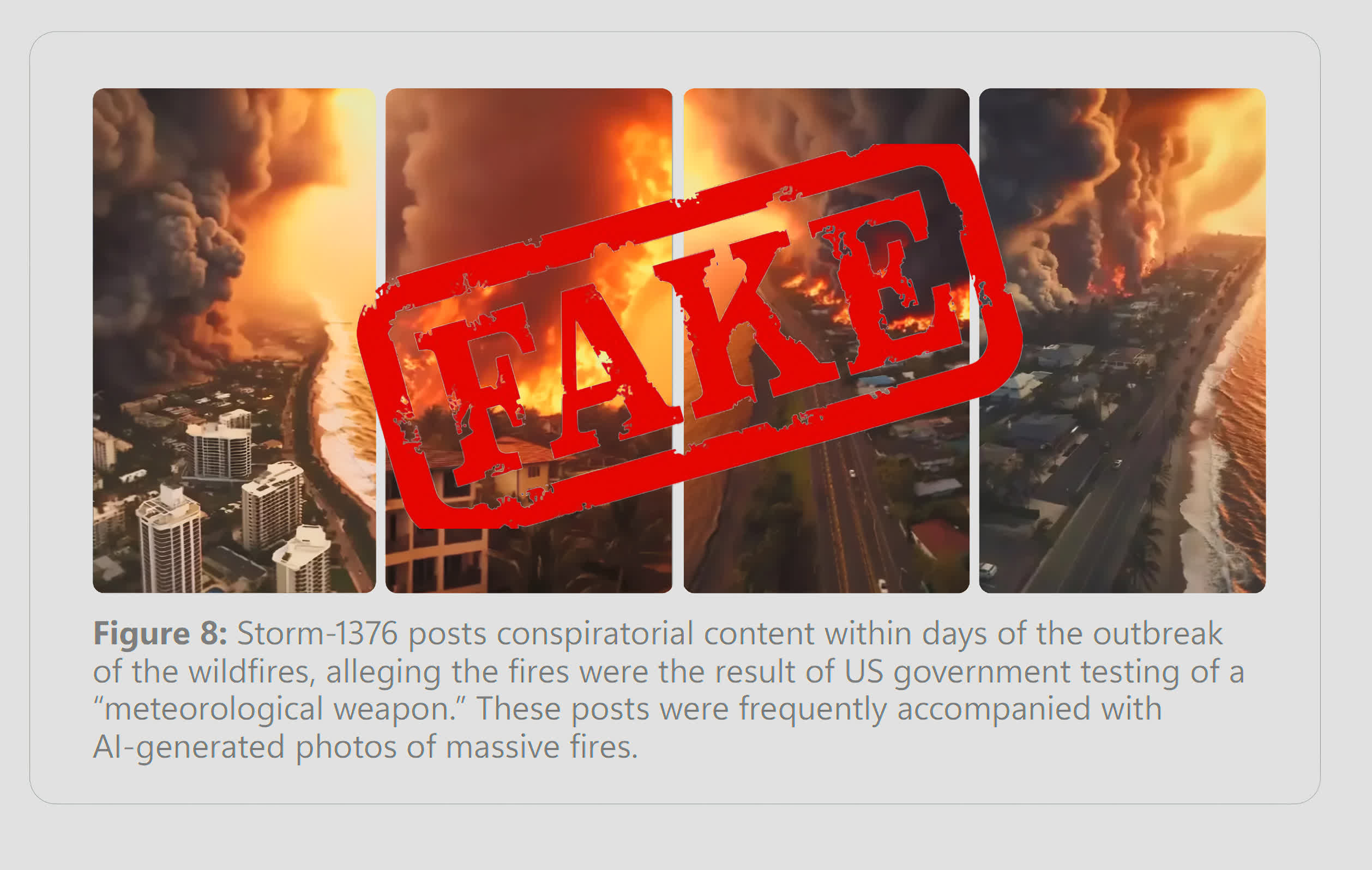

El último informe examina parte del contenido conspirativo creado utilizando IA generativa impulsada por cuentas de redes sociales chinas. Esto incluye una afirmación del grupo Storm 1376, respaldado por Beijing, en agosto de 2023 de que el gobierno de Estados Unidos había iniciado deliberadamente los incendios forestales de Hawái utilizando un arma meteorológica de grado militar. El mismo grupo publicó teorías de conspiración relacionadas con el descarrilamiento ferroviario de Kentucky en 2023 y trató de avivar la discordia en Japón y Corea del Sur.

La tormenta 1376 estuvo muy activa durante las elecciones taiwanesas de enero, a las que Microsoft se refiere como un «ensayo» para las próximas elecciones en otros países. Publicó un audio falso del fundador de Foxconn, Terry Gou, quien había abandonado la carrera en noviembre y respaldaba a otro candidato. El grupo también publicó varios memes generados por IA sobre el eventual ganador William Lai, quien está a favor de la soberanía. También hubo un mayor uso de presentadores de noticias generados por inteligencia artificial, creados por la herramienta CapCut del propietario de TikTok, ByteDance, en los que los presentadores falsos hacían afirmaciones sin fundamento sobre la vida privada de Lai, incluido que engendró hijos ilegítimos.

Uno de los mayores problemas a la hora de luchar contra el uso de una IA generativa realista para difundir información errónea es que muchas personas negarse a creer es falso, especialmente cuando este contenido se ajusta a sus creencias y valores.