¿Lo que acaba de suceder? En su conferencia telefónica sobre resultados del segundo trimestre de 2024, el director ejecutivo de Micron Technology, Sanjay Mehrotra, anunció que la compañía había agotado todo su suministro de memoria HBM3E de alto ancho de banda para todo 2024. Mehrotra también afirmó que «la abrumadora mayoría» de la producción de la compañía para 2025 también ya se ha agotado. sido asignado.

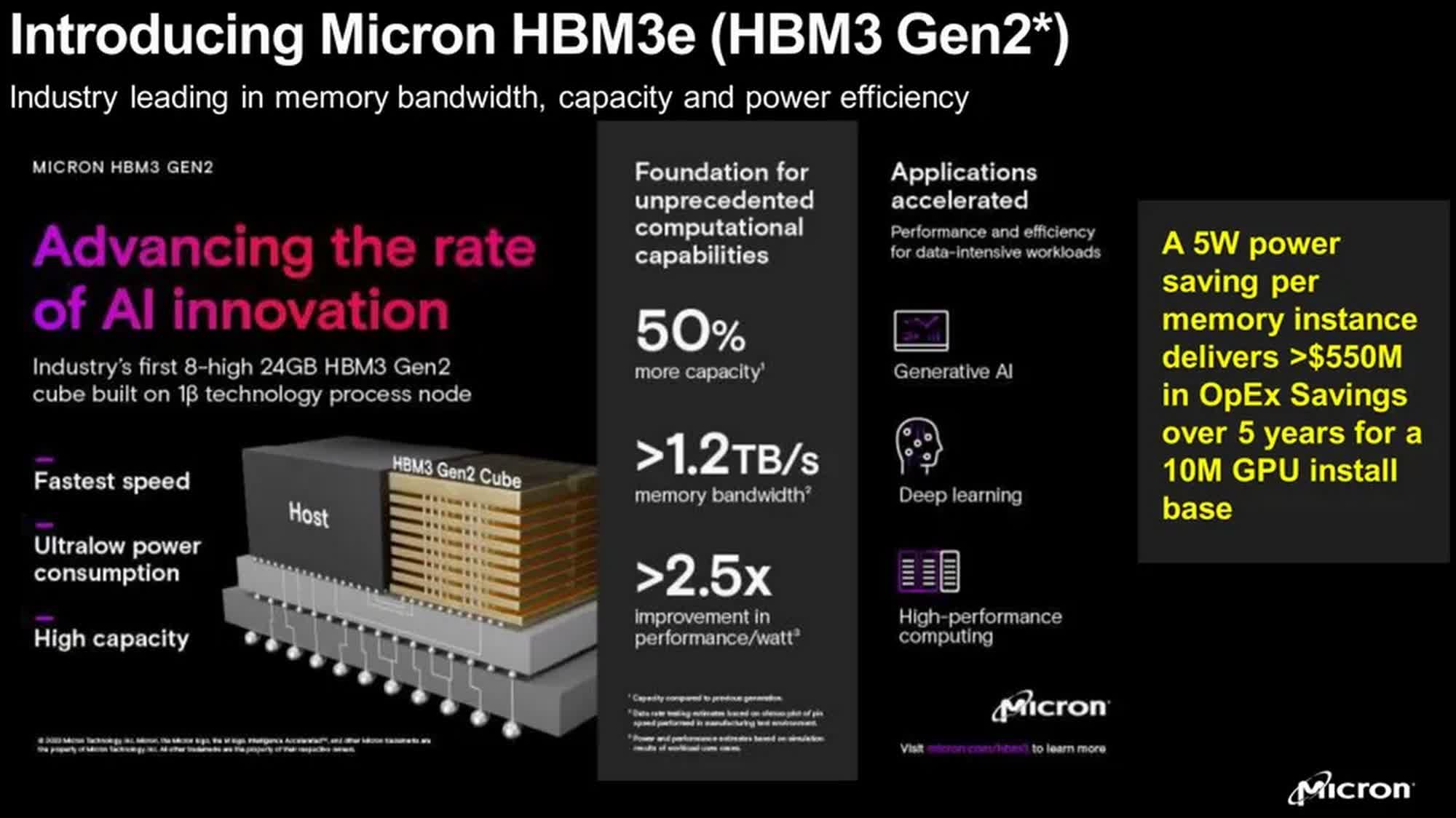

Micron está cosechando los beneficios de ser el primero en salir con memoria HBM3E (HBM3 Gen 2 en la jerga de Micron), y gran parte de ella es utilizada por los aceleradores de inteligencia artificial de Nvidia. Según la empresa, su nueva tecnología de memoria se utilizará ampliamente en La nueva GPU H200 de Nvidia para inteligencia artificial y computación de alto rendimiento (HPC). Mehrotra cree que HBM ayudará a Micron a generar «varios cientos de millones de dólares» en ingresos sólo este año.

Según los analistas, los chips A100 y H100 de Nvidia fueron ampliamente utilizados por las empresas de tecnología para sus modelos de entrenamiento de IA el año pasado, y se espera que el H200 siga sus pasos y se convierta en la GPU más popular para aplicaciones de IA en 2024. Se espera que sea utilizado ampliamente por los gigantes tecnológicos Meta y Microsoft, que ya han implementado cientos de miles de aceleradores de inteligencia artificial de Nvidia.

Como lo señaló Hardware de Tom, los primeros productos HBM3E de Micron son pilas de 8 Hi de 24 GB con interfaz de 1024 bits, velocidad de transferencia de datos de 9,2 GT/s y un ancho de banda máximo de 1,2 TB/s. El H200 utilizará seis de estas pilas en un solo módulo para ofrecer 141 GB de memoria de gran ancho de banda.

Además de las pilas de 8-Hi, Micron ya ha comenzado a probar sus cubos HBM3E de 12-Hi que, según se dice, aumentan la capacidad de DRAM por cubo en un 50 por ciento a 36 GB. Este aumento permitiría a los fabricantes de equipos originales como Nvidia incluir más memoria por GPU, lo que los convertiría en herramientas de HPC y entrenamiento de IA más potentes. Micron dice que espera aumentar la producción de sus pilas HBM3E de 12 capas a lo largo de 2025, lo que significa que el diseño de 8 capas será su pan de cada día este año. Micron también dijo que está buscando aumentar la capacidad y el rendimiento con HBM4 en los próximos años.

Además, la empresa está trabajando en sus productos DIMM de servidor de alta capacidad. Recientemente completó la validación del primer módulo DRAM de servidor de 128 GB basado en mono-die de la industria que se dice que proporciona un 20 por ciento más de eficiencia energética y más de un 15 por ciento de rendimiento de latencia mejorado «en comparación con las soluciones basadas en 3D TSV de la competencia».