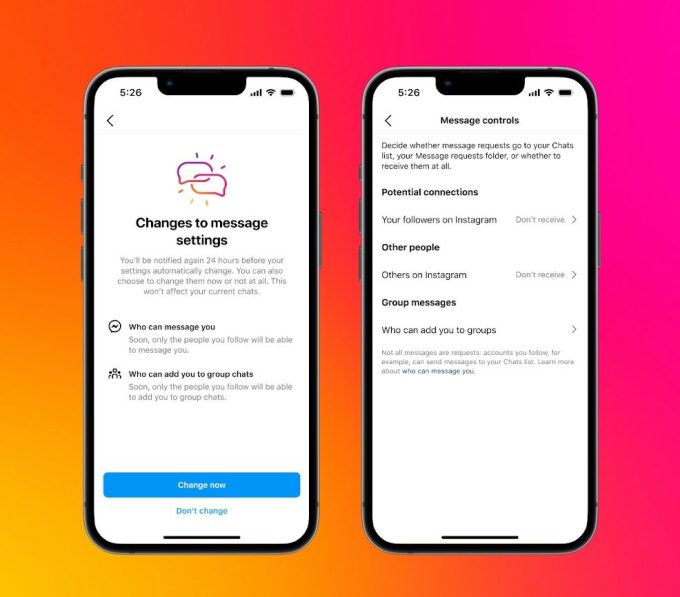

Meta anunció hoy que está implementando nuevas restricciones de DM tanto en Facebook como en Instagram para adolescentes que impiden que cualquiera envíe mensajes a los adolescentes.

Hasta ahora, Instagram restringe a los adultos mayores de 18 años enviar mensajes a adolescentes que no los siguen. Los nuevos límites se aplicarán a todos los usuarios menores de 16 años (y en algunas zonas geográficas a menores de 18 años) de forma predeterminada. Meta dijo que notificará a los usuarios existentes con una notificación.

Créditos de imagen: Meta

En Messenger, los usuarios sólo recibirán mensajes de amigos de Facebook o de personas que tengan en sus contactos.

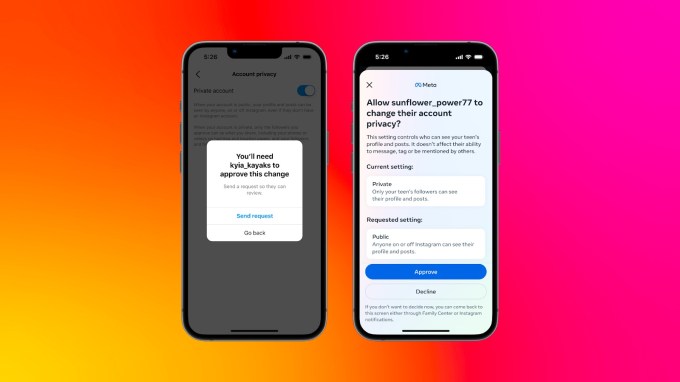

Es más, Meta también está fortaleciendo sus controles parentales al permitir que los tutores permitan o rechacen cambios en la configuración de privacidad predeterminada realizada por los adolescentes. Anteriormente, cuando los adolescentes cambiaban estas configuraciones, los guardianes recibieron una notificaciónpero no pudieron tomar ninguna medida contra ellos.

La compañía dio un ejemplo de que si un usuario adolescente intenta hacer que su cuenta sea pública y privada, cambia el control de contenido confidencial de «Menos» a «Estándar» o intenta cambiar los controles sobre quién puede enviarles mensajes directos, los tutores pueden bloquearlos.

Créditos de imagen: Meta

Meta lanzado por primera vez Herramientas de supervisión parental para Instagram en 2022lo que dio a los tutores una idea del uso que hacen sus adolescentes.

El gigante de las redes sociales dijo que también planea lanzar una función que evitará que los adolescentes vean imágenes no deseadas e inapropiadas en sus mensajes directos enviados por personas conectadas con ellos. La compañía agregó que esta función también funcionará en chats cifrados de extremo a extremo y «desalentará» a los adolescentes a enviar este tipo de imágenes.

Meta no especificó qué trabajo está haciendo para garantizar la privacidad de los adolescentes mientras ejecuta estas funciones. Tampoco proporcionó detalles sobre lo que considera «inapropiado».

A principios de este mes, Meta lanzó nuevas herramientas para impedir que los adolescentes vean autolesiones o trastornos alimentarios en Facebook e Instagram.

El mes pasado, Meta recibió una solicitud formal de información a los reguladores de la UEquien pidió a la empresa que proporcionara más detalles sobre los esfuerzos de la empresa para prevenir el intercambio de material autogenerado de abuso sexual infantil (SG-CSAM).

Al mismo tiempo, la empresa se enfrenta una demanda civil en el tribunal estatal de Nuevo México, alegando que la red social de Meta promueve contenido sexual entre usuarios adolescentes y promueve cuentas de menores entre depredadores. En octubre, Más de 40 estados de EE.UU. presentaron una demanda en un tribunal federal de California acusando a la empresa de diseñar productos de una manera que dañaba la salud mental de los niños.

La compañía testificará ante el Senado sobre cuestiones relacionadas con la seguridad infantil el 31 de enero de este año junto con otras redes sociales como TikTok, Snap, Discord y X (anteriormente Twitter).