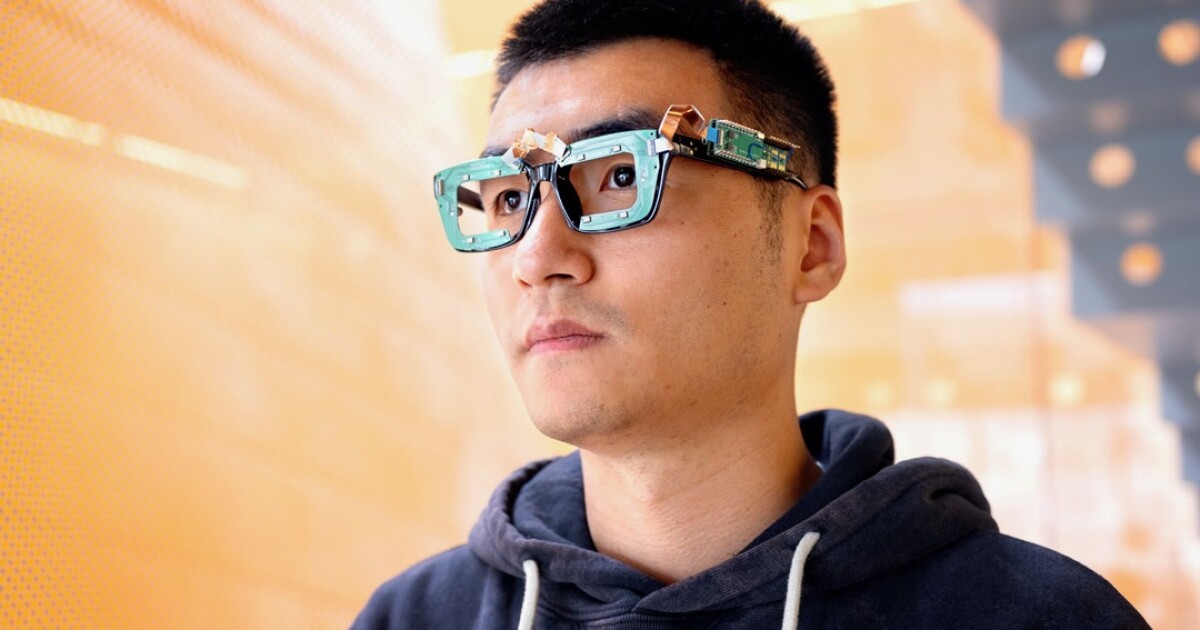

Dos nuevas tecnologías permiten que un solo par de gafas siga los movimientos oculares y lea las expresiones faciales del usuario, respectivamente. Los sistemas utilizan sonar en lugar de cámaras, para mejorar la duración de la batería y aumentar la privacidad del usuario.

Conocidas como GazeTrak y EyeEcho, las tecnologías están siendo desarrolladas en la Universidad de Cornell por un equipo dirigido por el estudiante de doctorado en Ciencias de la Información Ke Li.

Ambas configuraciones podrían incorporarse a gafas inteligentes o cascos de realidad virtual de terceros, donde consumirían mucha menos energía que los sistemas basados en cámaras. Tampoco capturarían ninguna imagen del rostro del usuario.

GazeTrak actualmente utiliza un altavoz y cuatro micrófonos dispuestos alrededor del interior de cada marco de lente en un par de gafas (para un total de dos altavoces y ocho micrófonos). Los altavoces emiten ondas sonoras inaudibles pulsadas que resuenan en el globo ocular y son captadas por los micrófonos.

Debido a que los globos oculares humanos no son esferas perfectamente redondas, cada eco tarda una cantidad de tiempo diferente en llegar a cada uno de los micrófonos, dependiendo de hacia dónde mira el globo ocular.

Por lo tanto, al utilizar software basado en IA en un teléfono inteligente o computadora portátil conectado de forma inalámbrica (que analiza continuamente esas diferencias de milisegundos) es posible rastrear la dirección de la mirada del usuario. Y lo que es más importante, la tecnología no se ve afectada negativamente por los ruidos de fondo fuertes.

Cabe señalar que en su forma actual de prueba de concepto, GazeTrak no es como precisos que los dispositivos portátiles de seguimiento ocular convencionales basados en cámaras. Dicho esto, consume sólo un 5% de energía como este tipo de dispositivos. Los científicos afirman que si un sistema GazeTrak utilizara una batería de la misma capacidad que la de las Tobii Pro Glasses 3 existentes, podría funcionar durante 38,5 horas, frente a las 1,75 horas de los Tobiis.

Además, los investigadores afirman que la precisión del sistema debería mejorar drásticamente a medida que la tecnología se desarrolle más.

Universidad de Cornell

EyeEcho también envía ondas sonoras y recibe sus ecos, aunque lo hace mediante un altavoz y un micrófono situados junto a cada una de las dos bisagras de los brazos de las gafas (para un total de dos altavoces y dos micrófonos).

En este En este caso, son los movimientos sutiles de la piel del rostro los que afectan el tiempo que transcurre entre la emisión de cada pulso y la detección de su eco. El software de IA relaciona estas diferencias horarias con movimientos específicos de la piel, que a su vez coinciden con expresiones faciales específicas.

Después de sólo cuatro minutos de entrenamiento en cada uno de los rostros de 12 sujetos de prueba, el sistema demostró ser muy preciso al leer sus expresiones, incluso cuando realizaban una variedad de actividades cotidianas en diferentes entornos.

Universidad de Cornell

Ke Li y sus colegas desarrollaron previamente un sistema de lectura de expresiones similar llamado oídoIO, en el que los altavoces y micrófonos están integrados en unos auriculares. En comparación con esa configuración, se dice que EyeEcho ofrece un mejor rendimiento utilizando menos datos de entrenamiento, además su precisión se mantiene estable durante un período de tiempo más largo.

«Hay muchos sistemas basados en cámaras en esta área de investigación o incluso en productos comerciales para rastrear expresiones faciales o movimientos de la mirada, como Vision Pro u Oculus», dijo Li. «Pero no todo el mundo quiere que las cámaras de los dispositivos portátiles te capturen a ti y a tu entorno todo el tiempo».

Artículos sobre GazeTrak y Para eco se presentará a finales de este año y actualmente se puede acceder a él a través de Arxiv.

Y como si estos sistemas no fueran suficientes, los científicos de Cornell crearon previamente otro Tecnología de sonar de lectura facial que podría integrarse en gafas inteligentes. Llamado ecohablamonitorea los labios del usuario para leer las palabras que la persona dice en silencio.

Fuente: Universidad de Cornell