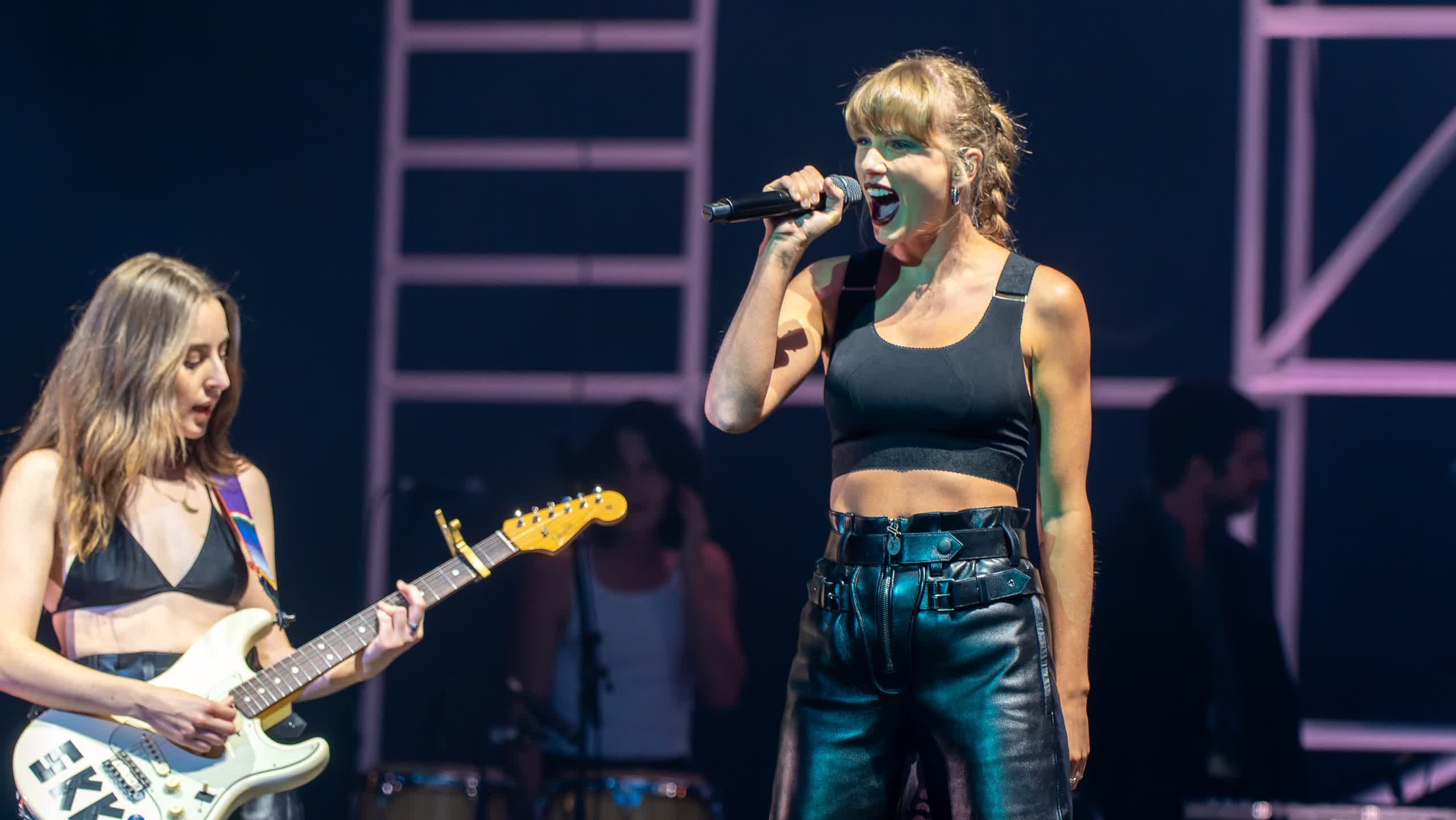

TL;DR: La estrella del pop mundialmente famosa Taylor Swift se ha convertido en la última víctima de la pornografía deepfake esta semana, después de que imágenes suyas generadas por inteligencia artificial se compartieran decenas de millones de veces en plataformas de redes sociales. Con esto, los deepfakes vuelven a estar en la conciencia legislativa. Representantes del Congreso e incluso la Casa Blanca han intervenido ahora sobre el asunto.

Esta semana se compartieron en X imágenes explícitas de la cantautora Taylor Swift, de 34 años, obteniendo más de 27 millones de visitas y 260.000 «me gusta» antes de que se cerrara la cuenta que publicó las imágenes. Sin embargo, eso no logró detener la propagación, ya que las imágenes continuaron circulando y, según se informa, fueron vistas más de 40 millones de veces.

En respuesta al incidente, X ha estado eliminando activamente las imágenes y ha desactivado las búsquedas de Taylor Swift en la plataforma para intentar contener la propagación. En un comunicado, dijo: «Estamos monitoreando de cerca la situación para asegurarnos de que cualquier violación adicional se aborde de inmediato y se elimine el contenido».

Pero la moderación en la plataforma puede no ser suficiente. Ahora, miembros del Congreso de Estados Unidos e incluso la Casa Blanca han intervenido sobre el tema. El representante estadounidense Joe Morelle ha dicho que las imágenes deepfake «pueden causar daños emocionales, financieros y de reputación irrevocables y, lamentablemente, las mujeres se ven afectadas de manera desproporcionada».

La representante demócrata Yvette Clark dijo: «Lo que le pasó a Taylor Swift no es nada nuevo. Durante años, las mujeres han sido blanco de deepfakes [without] su consentimiento. Y [with] Gracias a los avances en IA, crear deepfakes es más fácil y económico».

El viernes, la secretaria de prensa de la Casa Blanca, Karine Jean-Pierre, calificó las imágenes de «alarmantes» y dijo en un comunicado: «Aunque las empresas de medios sociales toman sus propias decisiones independientes sobre la gestión de contenidos, creemos que tienen un papel importante que desempeñar para hacer cumplir las normas». sus propias reglas para evitar la difusión de información errónea y de imágenes íntimas no consensuadas de personas reales».

Lo que le pasó a Taylor Swift no es nada nuevo. Durante años, las mujeres han sido blanco de deepfakes sin su consentimiento. Y con los avances en IA, crear deepfakes es más fácil y económico.

Este es un problema que ambos lados del pasillo e incluso los Swifties deberían poder unirse para resolverlo.

– Yvette D. Clarke (@RepYvetteClarke) 25 de enero de 2024

Como afirmó el Representante Clark, este no es un tema nuevo. Pero con un objetivo de tan alto perfil, el problema ha trascendido el discurso público y ahora puede ser un posible objetivo para una legislación futura.

En el Reino Unido, los deepfakes explícitos se declararon ilegales en virtud de la Ley de seguridad en línea en octubre de 2023. PornHub, un importante proveedor en línea de medios para adultos, ha deepfakes prohibidos en su plataforma desde 2018.

La Sra. Swift aún no ha comentado públicamente sobre el incidente.

Ya sea que este último incidente de alto perfil conduzca o no a cambios legislativos, está claro que el contenido de IA ya está causando problemas a los legisladores. Esta misma semana informamos sobre el primer caso conocido de mensajería generada por IA utilizada para suprimir la participación electoral, después de una falso presidente Biden Llamó a los residentes de New Hampshire y los instó a no votar.