Forzar la IA para todos: Google ha estado implementando sus descripciones generales de IA para sus usuarios de EE. UU. durante los últimos días. Si bien la compañía afirma que los resúmenes de IA que aparecen en la parte superior de los resultados son en su mayoría correctos y están basados en hechos, un número alarmante de usuarios ha encontrado las llamadas alucinaciones, cuando un LLM declara una falsedad como un hecho. Los usuarios no están impresionados.

En mis primeras pruebas de la función experimental, encontré que los anuncios publicitarios eran más desagradables que útiles. Aparecen en la parte superior de la página de resultados, por lo que debo desplazarme hacia abajo para llegar al material que quiero. Con frecuencia se equivocan en los detalles más finos y, a menudo, plagian un artículo palabra por palabra. Estas molestias me impulsaron a escribir el artículo de la semana pasada. explicando Hay varias formas de evitar la función intrusiva ahora que Google nos la está metiendo en la garganta sin ningún interruptor de apagado.

Ahora que AI Overviews ha tenido algunos días para filtrarse entre el público, los usuarios están encontrando muchos ejemplos en los que la función falla. Las redes sociales están inundadas de ejemplos divertidos y obvios de cómo la IA de Google se esfuerza demasiado. Tenga en cuenta que las personas tienden a gritar cuando las cosas van mal y a permanecer en silencio cuando trabajan según lo anunciado.

«Los ejemplos que hemos visto son consultas generalmente muy poco comunes y no son representativos de las experiencias de la mayoría de las personas», dijo un portavoz de Google a Ars Technica. «La gran mayoría de las descripciones generales de IA proporcionan información de alta calidad, con enlaces para profundizar en la web».

Si bien puede ser cierto que la mayoría de las personas tienen buenos resúmenes, ¿cuántos malos se permiten antes de que se consideren poco confiables? En una era en la que todo el mundo grita sobre la desinformación, incluido Google, parecería que a la empresa le importarían más los malos ejemplos que darse una palmadita en la espalda por los buenos, especialmente cuando sus resúmenes le dicen a la gente que correr con tijeras es buen cardio.

El empresario de inteligencia artificial Kyle Balmer destaca algunos ejemplos más divertidos en un rápido video X (abajo).

La descripción general de Google AI es una pesadilla. Parece que se apresuraron a sacarlo por la puerta. Ahora Internet está teniendo un día de campo. Estos son algunos de los mejores ejemplos https://t.co/ie2whhQdPi

-Kyle Balmer (@iamkylebalmer) 24 de mayo de 2024

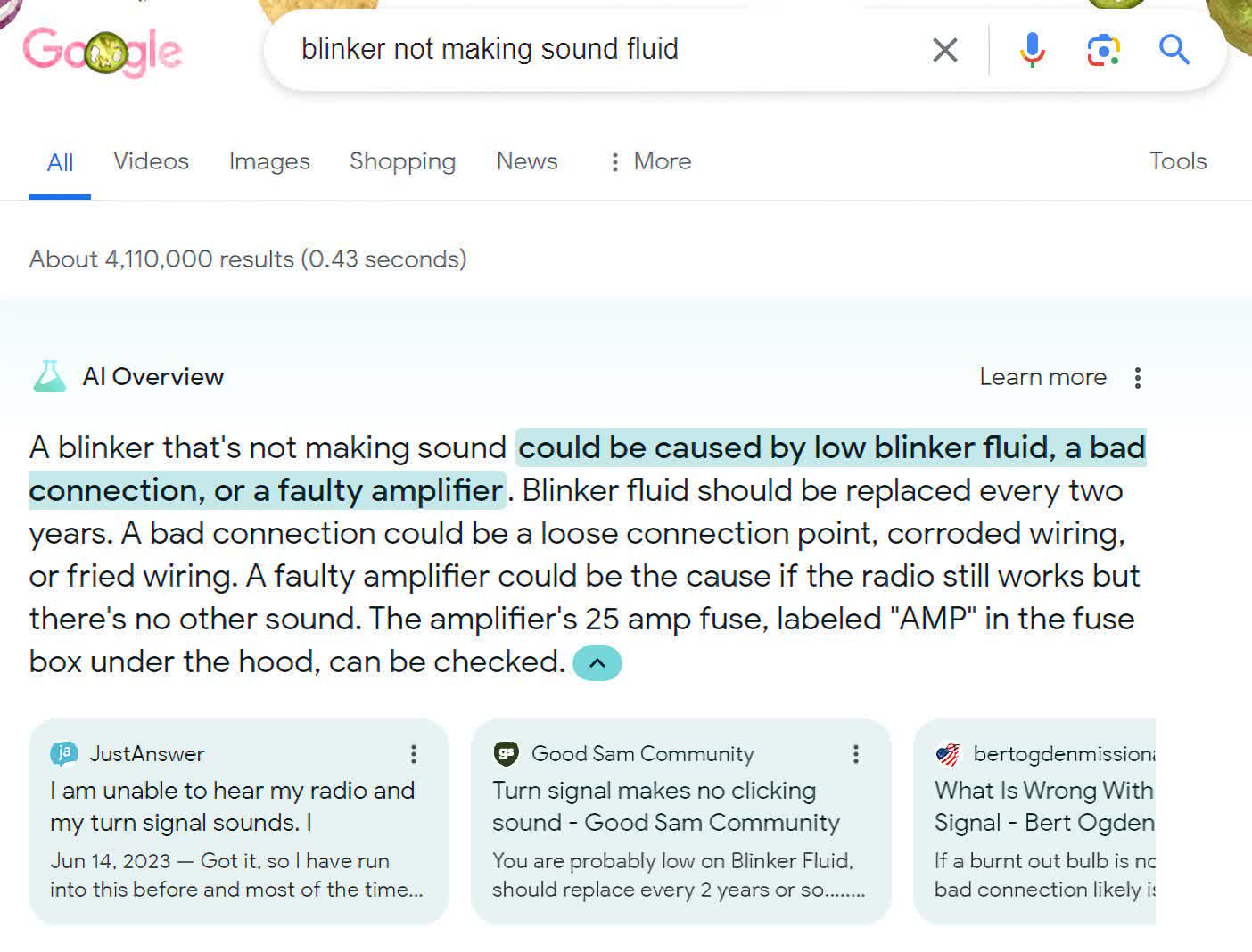

Es importante señalar que algunas de estas respuestas son intencionalmente contradictorias. Por ejemplo, en este al corriente por Ars Technica la palabra «fluido» no tiene nada que ver con la búsqueda más que para hacer referencia al viejo troll/broma, «necesitas cambiar el líquido de las luces intermitentes».

El chiste existe desde que estaba en la clase de compras de la escuela secundaria, pero en su intento de proporcionar una respuesta que abarque todos los términos de búsqueda, la IA de Google tomó la idea de un Troll en el foro de la comunidad Good Sam.

¿Qué tal enumerar algunas actrices que tengan más de 50 años?

La IA de Google es tan inteligente que, sinceramente, da miedo pic.twitter.com/7aa68Vo3dw

–Joe Kwaczala (@joekjoek) 19 de mayo de 2024

Si bien .250 es un buen promedio de bateo, uno de cada cuatro no forma una lista precisa. Además, apuesto a que a Elon Musk le sorprendería saber que se graduó en la Universidad de California, Berkley. Según la Enciclopedia Británica, en realidad recibido dos títulos de la Universidad de Pennsylvania. Lo más cerca que estuvo de Berkley fueron dos días en Stanford antes de abandonar los estudios.

Desafortunadamente, es trivial cometer el mismo tipo de error, por ejemplo, en el caso de los directores ejecutivos de tecnología que fueron a Berkeley. pic.twitter.com/mDVXT714C7

– MMitchell (@mmitchell_ai) 22 de mayo de 2024

Errores o sugerencias descaradamente obvios, como mezclando pegamento con salsa de pizza para evitar que el queso se caiga, probablemente no causará daño a nadie. Sin embargo, si necesita respuestas serias y precisas, incluso un resumen incorrecto es suficiente para que esta función no sea confiable. Y si no puedes confiar en él y debes verificarlo mirando los resultados de búsqueda habituales, entonces ¿por qué por encima de todo dice: «Préstame atención?»

Parte del problema es lo que AI Overviews considera una fuente confiable. Si bien Reddit puede ser un lugar excelente para que un humano encuentre respuestas a una pregunta, no es tan bueno para una IA que no puede distinguir entre hechos, fan fiction y sátira. Entonces, cuando ve a alguien decir de manera insensible y simplista que «saltar del puente Golden Gate» puede curar a alguien de su depresión, la IA no puede entender que el cartel estaba troleando.

Otra parte del problema es que Google se apresura a publicar Overviews presa del pánico para competir con OpenAI. Hay mejores maneras de hacerlo que mancillar su reputación como líder en los motores de búsqueda obligando a los usuarios a navegar por tonterías que no pidieron. Como mínimo, debería ser una característica opcional, si no un producto completamente independiente.

Los entusiastas, incluido el equipo de relaciones públicas de Google, dicen: «Esto sólo mejorará con el tiempo».

Puede ser, pero he usado (léase: tolerado) la función desde enero, cuando todavía era opcional, y he visto pocos cambios en la calidad de su resultado. Entonces, subirme al carro no es suficiente para mí. Google es demasiado utilizado y confiable para eso.