Meta reveló recientemente detalles sobre el infraestructura de formación de IA de la empresarevelando que actualmente depende de casi 50.000 NVIDIA GPU H100 para entrenar su LLM Llama 3 de código abierto.

Como muchas de las principales empresas tecnológicas involucradas en la IA, Meta quiere reducir su dependencia del hardware de Nvidia y ha dado un paso más en esa dirección.

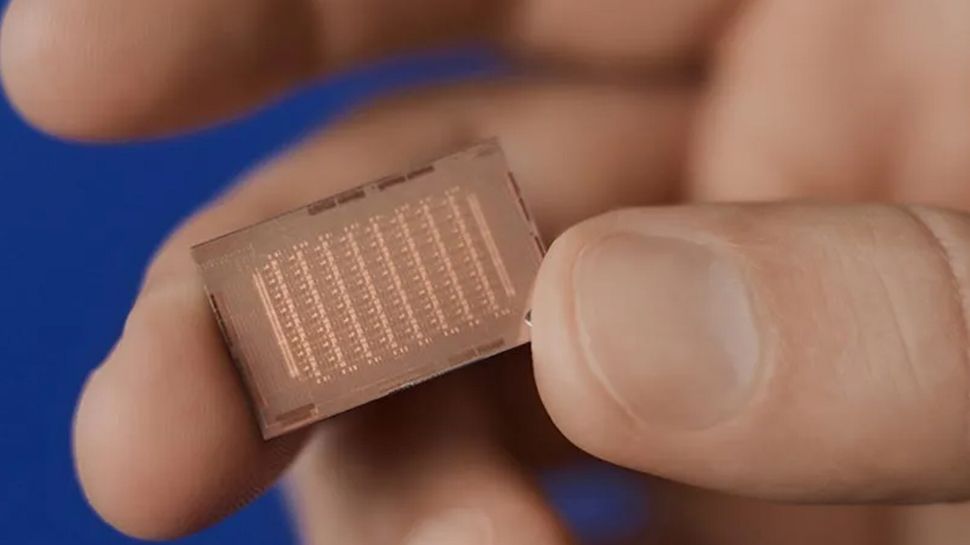

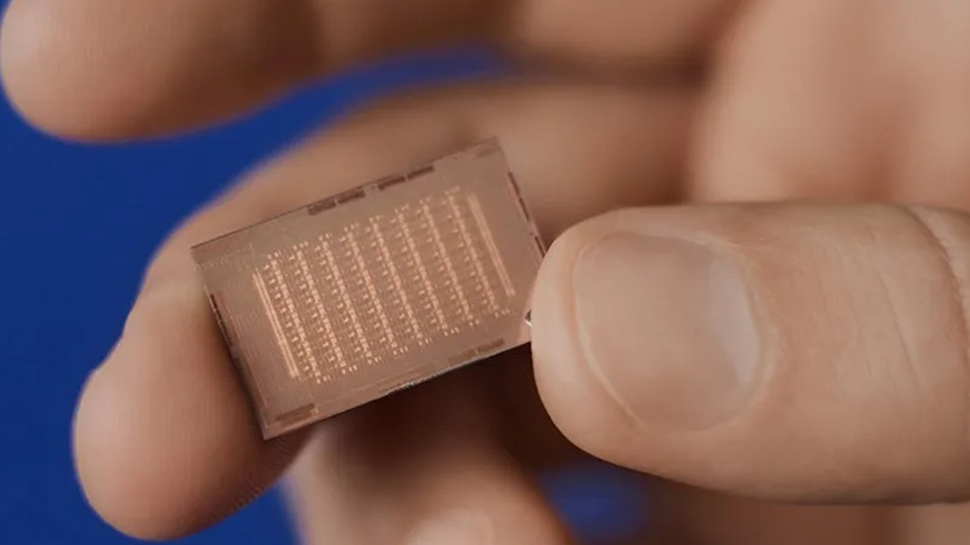

Meta ya tiene su propio acelerador de inferencia de IA, Meta Training and Inference Accelerator (MTIA), que está diseñado para las cargas de trabajo de IA internas del gigante de las redes sociales, especialmente aquellas que mejoran las experiencias en sus diversos productos. La compañía ahora ha compartido información sobre su MTIA de segunda generación, que mejora significativamente a su predecesor.

Pila de software

Esta versión renovada de MTIA, que puede manejar la inferencia pero no el entrenamiento, duplica el ancho de banda de computación y memoria de la solución anterior, manteniendo una estrecha relación con las cargas de trabajo de Meta. Está diseñado para servir de manera eficiente modelos de clasificación y recomendación que brindan sugerencias a los usuarios. La nueva arquitectura del chip tiene como objetivo proporcionar una combinación equilibrada de potencia informática, ancho de banda de memoria y capacidad de memoria para satisfacer las necesidades únicas de estos modelos. La arquitectura mejora la capacidad de SRAM, lo que permite un alto rendimiento incluso con tamaños de lote reducidos.

El último Accelerator consta de una cuadrícula de elementos de procesamiento (PE) de 8×8 que ofrece un rendimiento de cómputo denso 3,5 veces mayor y un rendimiento de cómputo escaso que, según se informa, es siete veces mejor que MTIA v1. El avance proviene de optimizaciones en la nueva arquitectura en torno a la canalización de computación dispersa, así como de cómo se introducen los datos en los PE. Las características clave incluyen el triple del tamaño del almacenamiento local, el doble de SRAM en el chip y un aumento de 3,5 veces en su ancho de banda, y el doble de capacidad LPDDR5.

Junto con el hardware, Meta también se está centrando en codiseñar la pila de software con el silicio para crear sinergias en una solución de inferencia general óptima. La compañía dice que ha desarrollado un sistema robusto basado en rack que admite hasta 72 aceleradores, diseñado para sincronizar el chip a 1,35 GHz y ejecutarlo a 90 W.

Entre otros desarrollos, Meta dice que también ha mejorado la estructura entre aceleradores, aumentando significativamente el ancho de banda y la escalabilidad del sistema. Triton-MTIA, un compilador backend creado para generar código de alto rendimiento para hardware MTIA, optimiza aún más la pila de software.

El nuevo MTIA no tendrá un impacto masivo en la hoja de ruta de Meta hacia un futuro menos dependiente de las GPU de Nvidia, pero es otro paso en esa dirección.