No basta con defender el hardware de IA que admita modelos de lenguajes locales grandes, IA generativa y similares. Los proveedores de hardware deben dar un paso al frente y actuar como intermediarios (si no como desarrolladores directos) también para esas aplicaciones locales de IA.

Qualcomm casi lo tiene. En el MWC 2024 (anteriormente conocido como Mobile World Congress, también conocido como una de las ferias comerciales de dispositivos móviles más grandes del mundo), la compañía anunció esta semana un Qualcomm AI Hub, un repositorio de más de 75 modelos de IA optimizados específicamente para las plataformas Qualcomm y Snapdragon. Qualcomm también mostró un LLM local de siete mil millones de parámetros, que se ejecuta en una PC (presumiblemente con tecnología Snapdragon) y que puede aceptar entradas de audio. Finalmente, Qualcomm demostró un LLM adicional de siete mil millones de parámetros ejecutándose en teléfonos Snapdragon.

Eso está muy bien, pero más proveedores de PC y chips tendrán que demostrar ejemplos de IA del mundo real. El AI Hub de Qualcomm es un buen comienzo, incluso si es un centro para desarrolladores. Pero la única forma en que los proveedores de chips y PC convencerán a los usuarios de que utilicen la IA local es haciéndola fácil, barata y muy disponible. Sin embargo, muy pocos han dado un paso al frente para hacerlo.

La industria de las PC tiende a aprovechar cualquier tendencia que pueda porque las ventas de hardware de PC se ven constantemente socavadas por los teléfonos inteligentes, la nube y otros dispositivos que amenazan su dominio. Si bien las ventas de computadoras portátiles y Chromebook se dispararon durante la pandemia, han regresado a la tierra con fuerza. El argumento de que necesitará una PC local para ejecutar el próximo gran avance: la IA. y pagar por hardware de alta gama es un argumento que debería hacer babear a la industria de las PC.

Pero los primeros ejemplos de IA se ejecutaron en la nube, lo que deja atrás a la industria de las PC. Esto parece un punto en el que insisto, pero lo diré de nuevo: Microsoft no parece particularmente interesado en la IA local todavía. Todo lo que tenga la marca «Copilot» de Microsoft en su nombre se ejecuta en la nube y, por lo general, requiere una suscripción o al menos una cuenta de Microsoft para su uso. (Copilot se puede usar con una cuenta local de Windows, pero solo por un número limitado de veces antes de obligarte a iniciar sesión para continuar usándolo).

La mayoría de las personas probablemente no estén necesariamente convencidas de que necesiten utilizar IA, y mucho menos ejecutarla localmente en su PC. Este es el problema que los proveedores de chips y hardware deben resolver. Pero la solución no es el hardware, sino el software.

Mark Hachman/IDG

La respuesta son las aplicaciones: muchísimas aplicaciones.

Microsoft introdujo un AI Hub en la aplicación Microsoft Store el año pasado, pero incluso hoy se siente un poco deslucido. La mayoría de las “aplicaciones” de chatbot disponibles en realidad se ejecutan en la nube y requieren una suscripción, lo que no tiene sentido, por supuesto, cuando Copilot es esencialmente gratuito. Lo mismo ocurre con aplicaciones como Adobe Lightroom y ACDSee; también se basan en suscripción, que es lo que una aplicación local podría evitar aprovechando la potencia de su PC local.

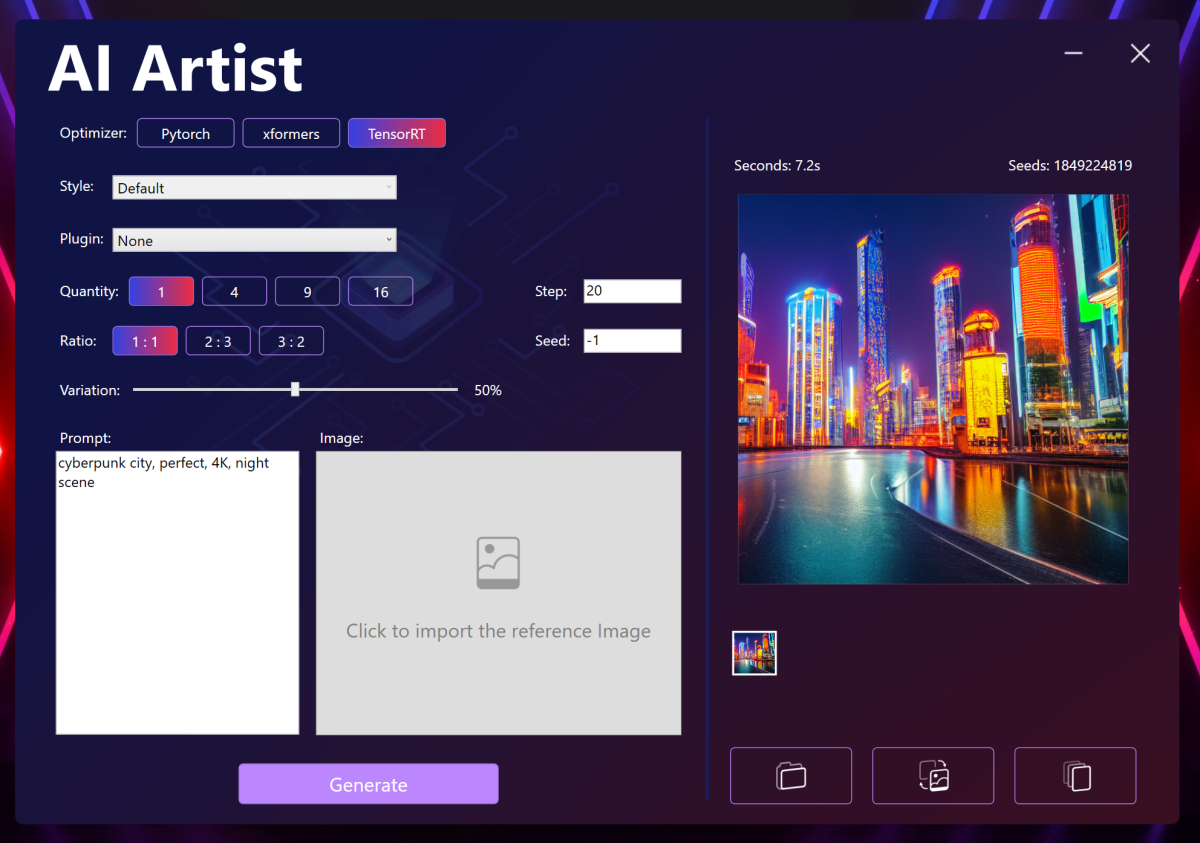

Eso deja a los proveedores de hardware llevar la antorcha. Y algunos lo han hecho: MSI, por ejemplo, pone a disposición de sus clientes una aplicación de IA generativa “AI Artist”. La última computadora portátil para juegos MSI Raider GE78. Si bien es un poco torpe y lento, al menos proporciona un procedimiento de instalación con un solo clic de un proveedor confiable.

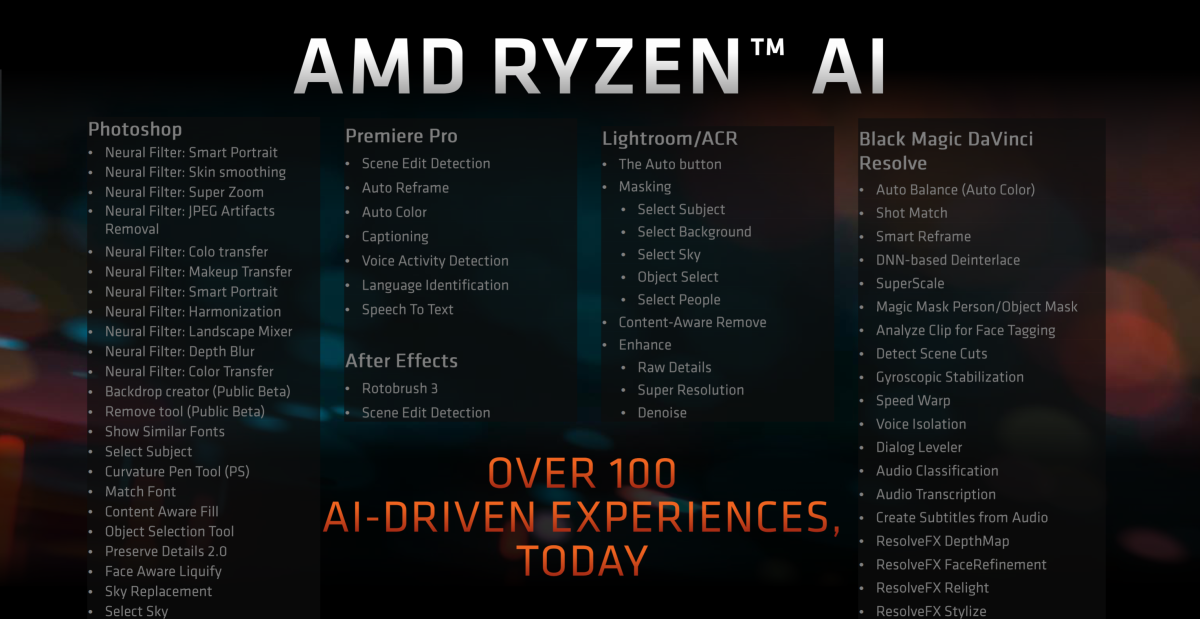

Pero eso es un oasis en un desierto de IA local. Tanto AMD como Intel promocionan el rendimiento de sus chips en modelos de lenguaje de IA como Llama 2. Esto tiene sentido para aquellos que ya han probado los chatbots de IA y están familiarizados con algunos de los distintos modelos y cómo funcionan. AMD, por ejemplo, expuso específicamente qué aplicaciones aprovechan su propia NPU, a la que denomina Ryzen AI.

Con todo respeto, eso no es suficiente. No basta con que Intel haya lanzado un Fondo de desarrollo de IA el año pasado. Lo que deben hacer los proveedores de chips es ponerlos en manos del consumidor.

¿Cómo? Un método ya está probado y es cierto: suscripciones de prueba de aplicaciones impulsadas por inteligencia artificial como Adobe Photoshop, DaVinci Resolve de BlackMagic o Topaz. A los clientes tradicionalmente no les gusta el bloatware, pero creo que si la industria de las PC va a comercializar PC con IA, tendrán que intentar encontrar una PC de clase creativa que se apoye en él. En lugar de utilizar «Intel Inside», comience a comercializar «paquetes de IA». Apóyate en el software, no el hardware. Empiece a poner logotipos de aplicaciones también en el exterior de la caja. ¿Estaría Adobe dispuesto a poner su sello en una PC “certificada por Photoshop”? Es un pensamiento.

De lo contrario, sugeriría una de las mejores ideas que tuvo Intel: el regreso del paquete de juegos. Hoy en día, tanto Intel como AMD pueden incluir un juego como Assassin’s Creed: Espejismo con la compra de una CPU o placa base calificada. Pero no hace mucho tiempo, se podían descargar varios juegos, de forma gratuita, que mostrarían la potencia de la CPU. (Aquí hay un Ejemplo de MSI de 2018, a continuación).

Ejecutar IA localmente ofrece algunas ventajas convincentes: privacidad, por ejemplo. Pero el factor de conveniencia de Copilot y Bard es un argumento poderoso para utilizar esas herramientas desinfectadas. Los consumidores son volubles y tampoco les importará, a menos que alguien les demuestre que les debe importar.

Si AMD, Intel y eventualmente Qualcomm planean hacer realidad la IA local, tendrán que hacer que esa opción sea simple, barata y ubicua. Y con el tren de la IA ya avanzando a toda velocidad, necesitan hacerlo ayer.