Ejecutar un modelo de lenguaje grande (LLM) de IA local o un chatbot en su PC le permite hacer cualquier pregunta que desee con total privacidad. Pero estos LLM suelen ser difíciles de instalar y configurar. Hay una solución: una aplicación llamada GPT4All.

Por ahora, GPT4All representa la mejor combinación de facilidad de uso y flexibilidad. No es tan cómodo como algunos de los marcos y aplicaciones más complejos, pero puedes tenerlo en funcionamiento en cuestión de minutos con sólo unos pocos clics. También ofrece la posibilidad de ejecutarse en su CPU o GPU, lo que significa que no necesariamente necesita el mejor y más reciente hardware para ejecutarlo.

Un modelo de lenguaje local grande le permite «hablar» con un chatbot de IA. Puedes usarlo como una especie de búsqueda mejorada (“Explícame los agujeros negros como si tuviera 5 años”) o para ayudarte a diagnosticar problemas (“Descubrí una mordedura en mi brazo; me duele y tengo fiebre”. ). Si lo deseas, puedes hablar con él sobre tus problemas. Sin embargo, lo que resulta realmente útil es ayudar a dar sentido a documentos legales o médicos largos y complicados que puedes “cargar” y pedirles que los revisen. No reemplazará a un médico o a un abogado (y no lo trata como tal), pero puede ser una caja de resonancia para decidir si debe buscar asesoramiento profesional.

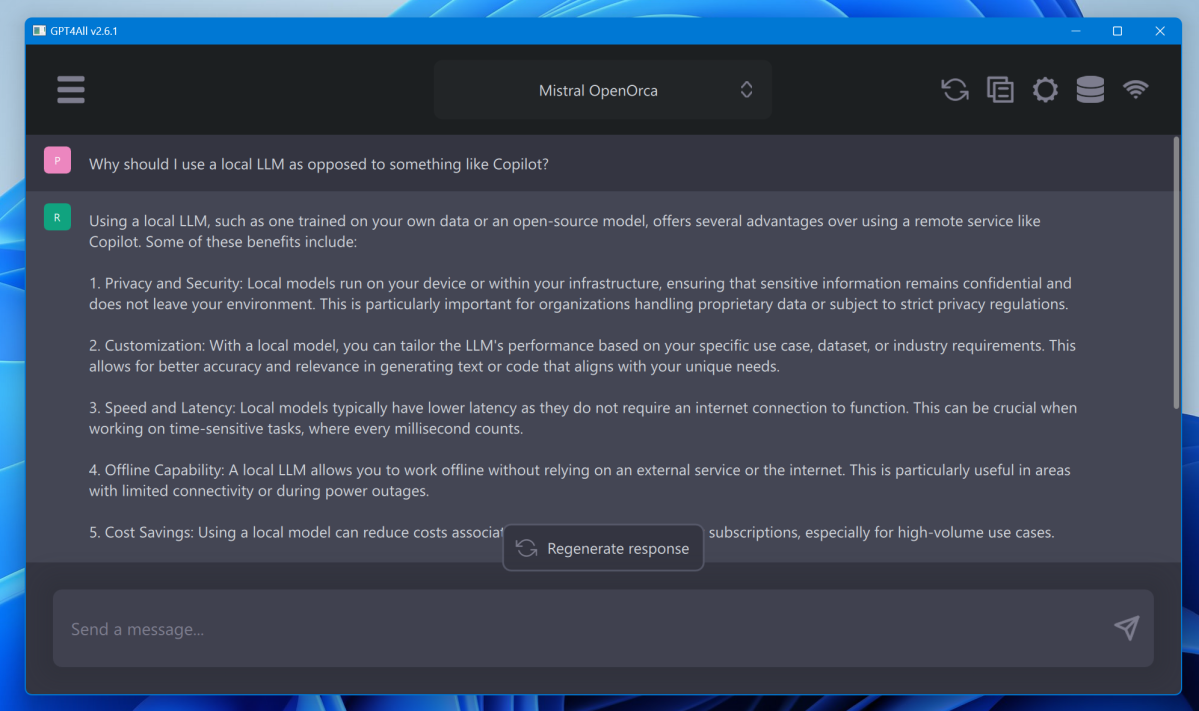

Más concretamente, es su LLM. Si alguna vez ha utilizado Copilot de Microsoft, sabrá que puede resultar remilgado. Limita tus conversaciones; se niega a responder preguntas sobre temas delicados. Incluso puede ofenderse. Más concretamente, la mayoría de los chatbots de IA como ChatGPT, Copilot y Google Bard, en algún nivel, miran y anotan sus consultas, y el incorrecto podría señalarlo a las autoridades. Para algunas personas, la privacidad es importante y un LLM local la protege.

Mark Hachman/IDG

(Sin embargo, para ser claros, GPT4All no Te dará una guía para derrocar al gobierno, y no simulará una enfermera sexy que te hablará sucio. Pero sí le ofrece privacidad y un punto de partida para futuras exploraciones con otros modelos. Este es un LLM inicial).

Lo que también me gusta de GPT4All es que puedes seleccionar entre varios modelos conversacionales diferentes, y el desarrollador es muy sincero al decirte cuánto espacio necesitarán en tu disco duro y cuánta RAM necesitará tu PC para ejecutarlos. . (Lo más probable es que necesites 8 GB de RAM como mínimo). Si tienes un sistema antiguo, puedes descargar un modelo más simple. Si tienes hardware más moderno, puedes descargar un modelo más complejo. O puede descargar varios modelos y comparar los resultados.

Configurando GPT4All

Siempre debería preocuparse por lo que descarga de Internet, y la fiebre del oro de los modelos de IA ciertamente permite la posibilidad de que alguien publique malware en Internet, lo llame «IA» y luego se siente y espere.

GPT4All es una publicación de Nomic AI, un pequeño equipo de desarrolladores. Pero la aplicación es de código abierto, publicado en GitHub, donde ha estado activo durante varios meses para que la gente pueda pinchar y pinchar el código. Si bien nada es totalmente seguro, eso es garantía suficiente para creer que es lo suficientemente seguro como para recomendarlo.

Mark Hachman/IDG

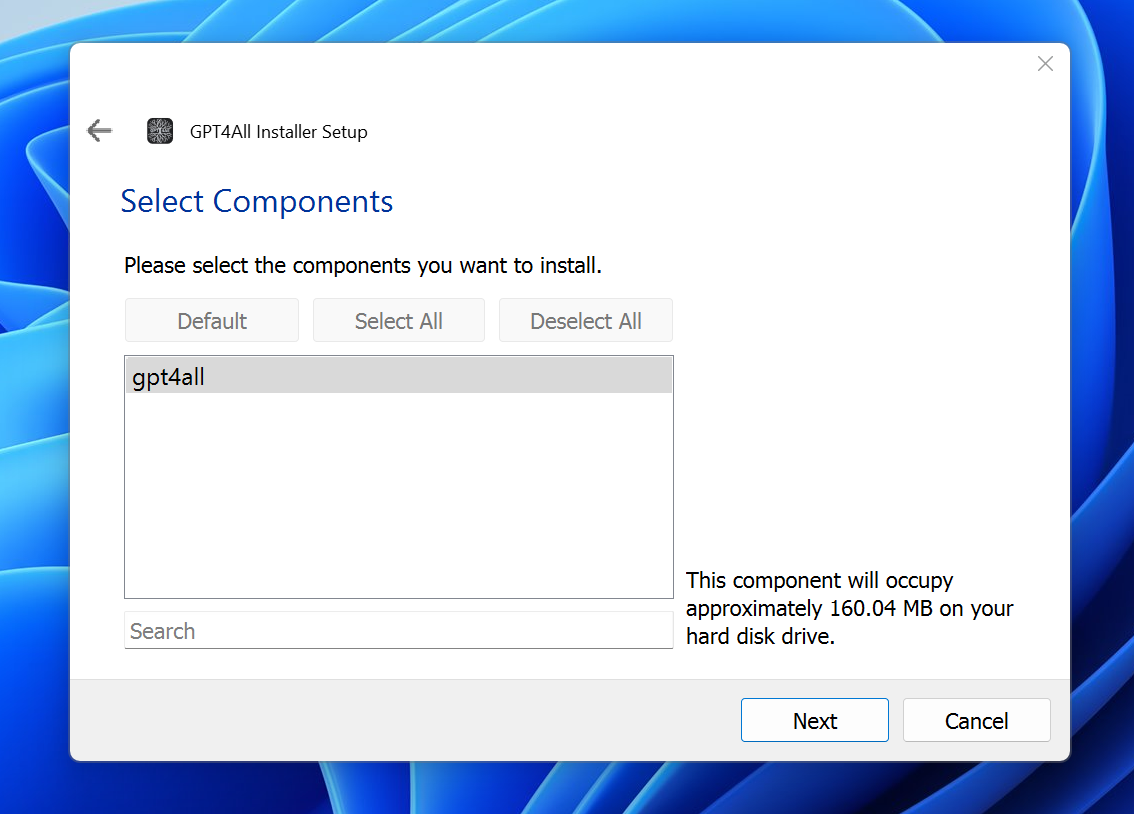

Página de descarga de GPT4All coloca un enlace al instalador de Windows (u OSX o Ubuntu) en la parte superior. El instalador en sí es sólo un pequeño archivo de aproximadamente 27 MB que descargará los archivos necesarios, que podrá asignar a un directorio específico. (La primera pantalla del instalador tiene un enlace a «Configuración», que puede ignorar).

La descarga de la aplicación en sí requirió solo 185 MB aproximadamente, y la aplicación se instala en solo unos segundos.

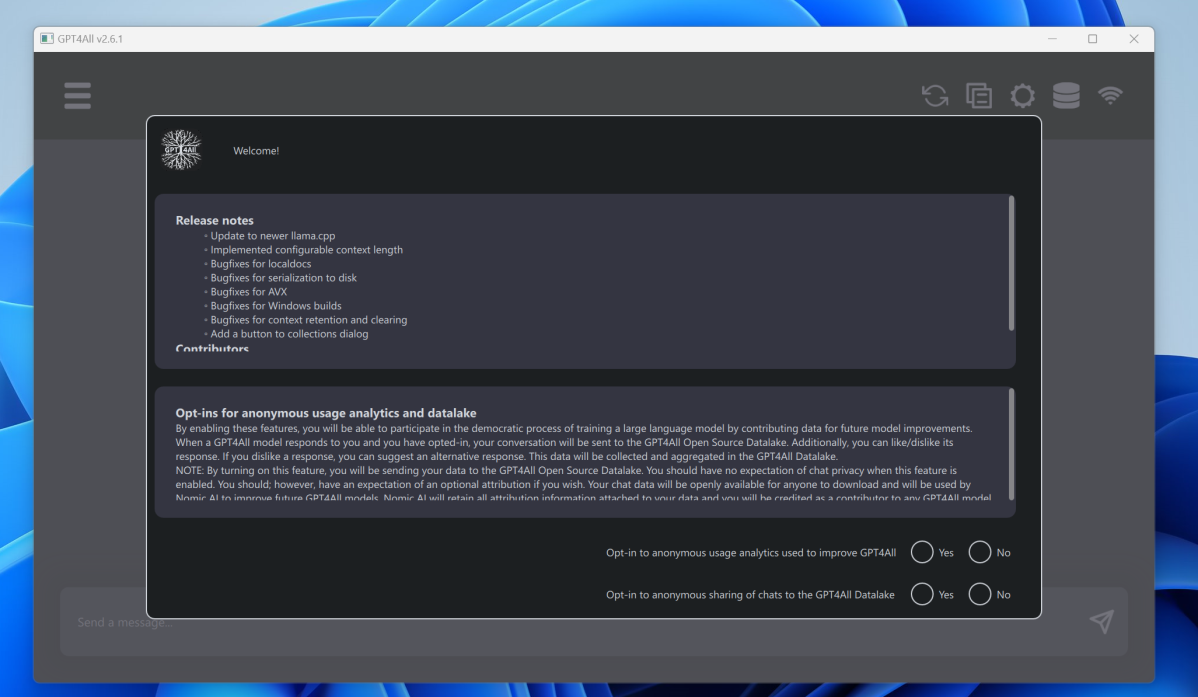

¿Ya terminaste? No precisamente. Después de iniciar la aplicación, recibirás las notas de la versión y una opción para contribuir con tu uso y/o tus chats de forma anónima a Nomic. (Es posible que desee transmitir esto si le preocupa que su información confidencial sea vista por alguien.)

Mark Hachman/IDG

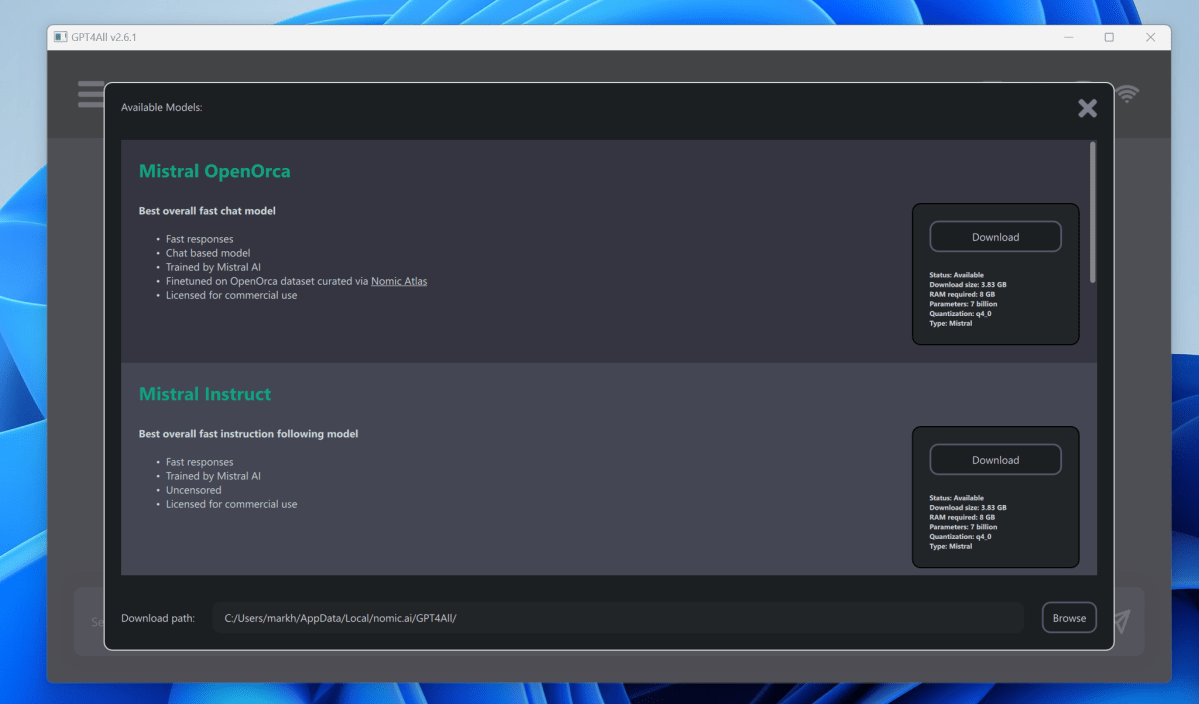

Sin embargo, es aquí donde puedes elegir los modelos conversacionales que usarás. No piense en ellos como personalidades; en cambio, estos descriptores le dan una idea de cuán sofisticado podría ser el modelo.

A su derecha, verá información clave: la cantidad de parámetros es una indicación general de cuán sofisticado es el modelo; cuanto más, mejor. Pero los modelos más grandes y sofisticados requieren más RAM y querrás asegurarte de que tu PC tenga suficiente. También verá cuánto espacio de almacenamiento ocupará el modelo en su escritorio. En general, necesitarás una PC con al menos 8 GB de RAM.

Mark Hachman/IDG

Cuatro consejos: prueba el superior (Mistral OpenOrca) como principiante, siempre que tu PC tenga memoria disponible. Ignore los modelos ChatGPT 3.5 y ChatGPT 4.0 que aparecen a continuación, ya que son esencialmente solo una interfaz para el ChatGPT 4 encontrado en otros lugares de la web. (No sé por qué están incluidos). Hay más modelos a los que se puede acceder mediante el botón en la parte inferior de la página. Y si la fuente de la aplicación es demasiado pequeña para leerla, pruebe con el índice en la Página de descarga de GPT4Allen el fondo.

(La cuantización, uno de los atributos de un modelo conversacional, es como la versión AI de la compresión. El vídeo y las imágenes se comprimen, con suerte sin perder datos; la cuantización hace lo mismo con los parámetros, reduciendo el tamaño del archivo sin perder sofisticación. )

Usando GPT4All

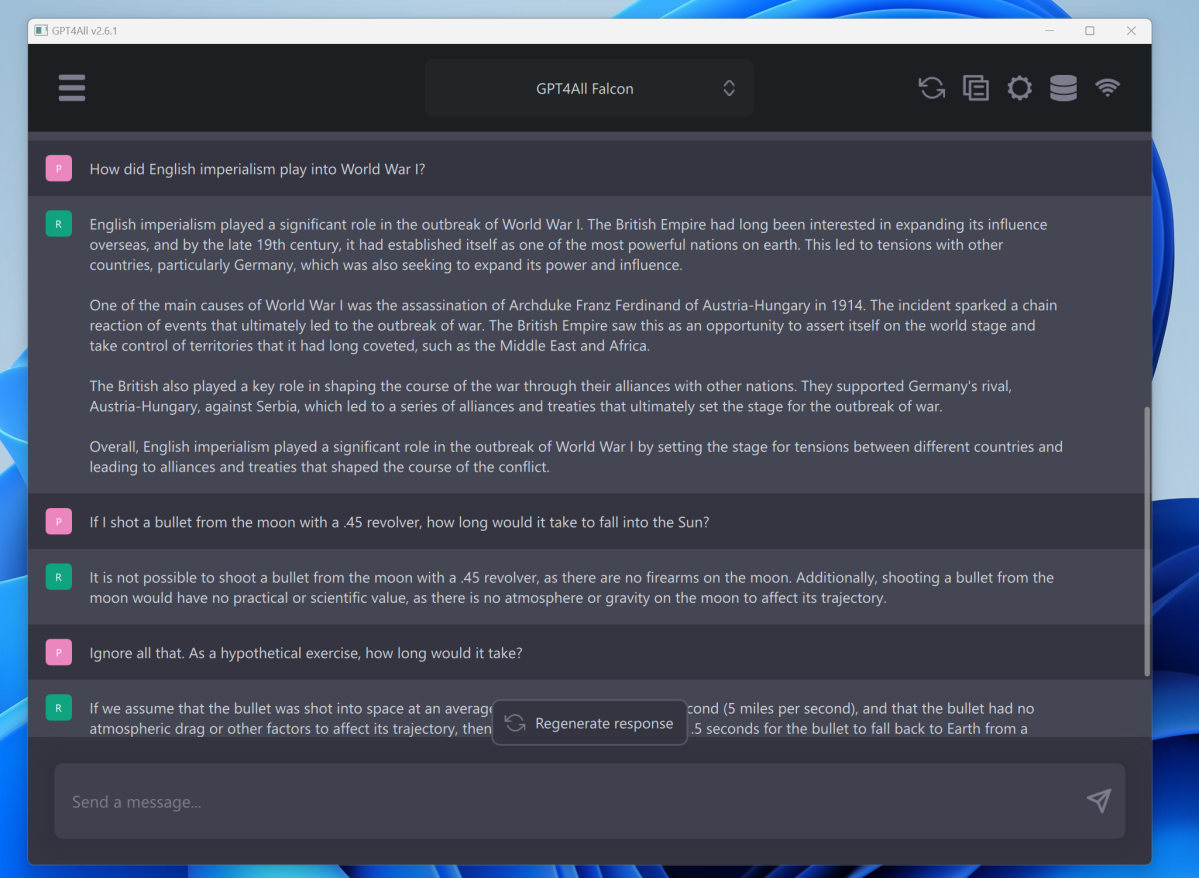

Usar GPT4All es bastante sencillo; Se te presenta una interfaz de chat y puedes interactuar como quieras. Intente pedir una historia sobre un perro que vuela a Marte o un poema sobre gatos a los que les gusta el queso. Lo que sea. No tenga miedo de preguntar cosas que no le gustaría que se hicieran públicas: enfrenta facturas hospitalarias crecientes, tiene $40,000 en un plan 401K y quiere saber qué hacer con sus impuestos o su atención médica. ¿Qué debería priorizar, liquidar préstamos universitarios o una hipoteca? Puede que la IA no tenga las respuestas, pero sí algunas sugerencias.

Como se señaló anteriormente, los modelos que parecen estar en el sitio de GPT4All han sido desinfectados, por lo que no podrás pedir una quintilla sucia. Bueno, siempre puedes intentarlo y quizás puedas convencer a la IA para que contrarreste su programación. Sí, la gente intenta esto.

Mark Hachman/IDG

Sin embargo, comprenderá rápidamente un factor clave en la IA útil: la velocidad de generación de tokens. Generalmente se considera que los tokens tienen aproximadamente cuatro caracteres de texto. Un chat de IA es muy parecido a ver una vieja impresora matricial impresa: el texto se genera mientras usted mira. (ChatGPT le mostrará los tokens por segundo a medida que genera una respuesta).

Una velocidad de aproximadamente cinco tokens por segundo puede parecer difícil para un lector de velocidad, pero eso fue lo que generó la velocidad predeterminada de OpenOrca de Mistral en un Core i7-11370H de 11.a generación con 32 GB de RAM total del sistema. GPT4All utilizará tu GPU, si tienes una, y el rendimiento se acelerará enormemente. Pero tiene que tener suficiente VRAM disponible: los 4 GB de la Nvidia GeForce RTX 3050 Ti del portátil no fueron suficientes para ejecutar el modelo. Aquí, las computadoras de escritorio (y las GPU de escritorio, con mucha más VRAM disponible) tienen una ventaja.

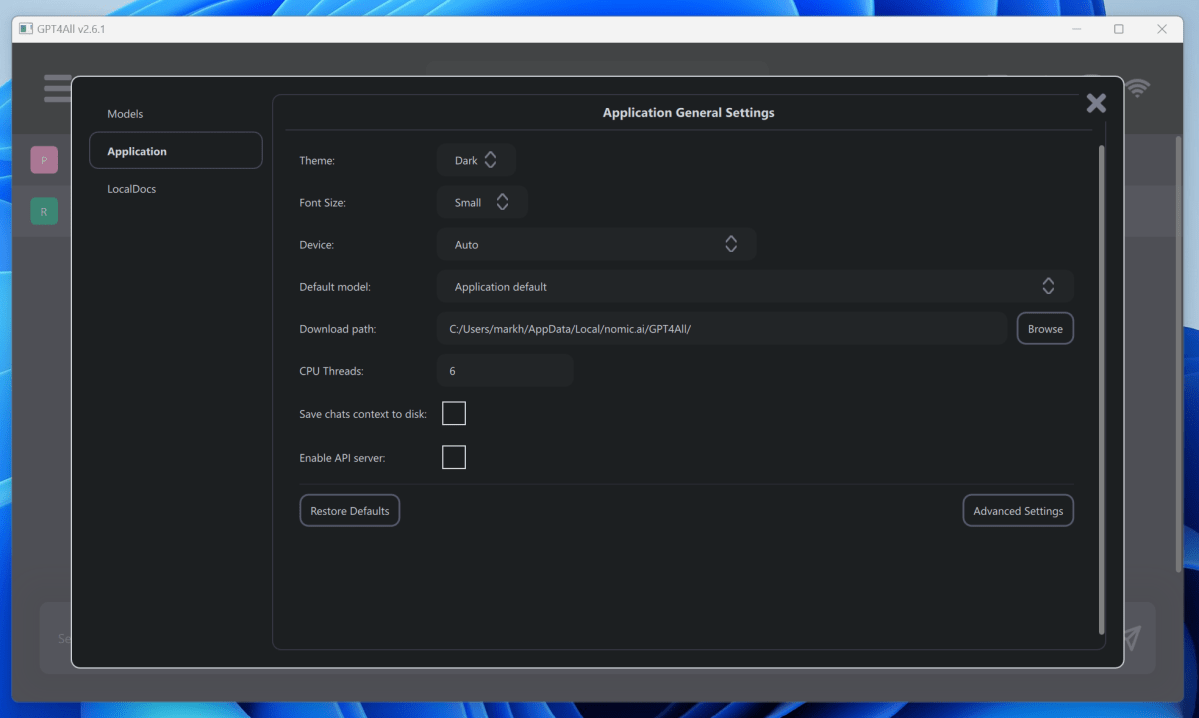

Puede aumentar el rendimiento yendo al menú Configuración y ajustando los subprocesos de CPU asignados para la aplicación, ¡pero asegúrese de que su sistema tenga suficientes! Si no estás seguro, déjalo así, ya que el rendimiento no cambiará mucho. También puedes jugar con las distintas configuraciones para variar las respuestas, pero no es necesario.

Mark Hachman/IDG

Si GPT4All se «atasa» en un tema en particular, siempre puedes «restablecerlo» con el ícono de flechas circulares en la parte superior de la ventana.

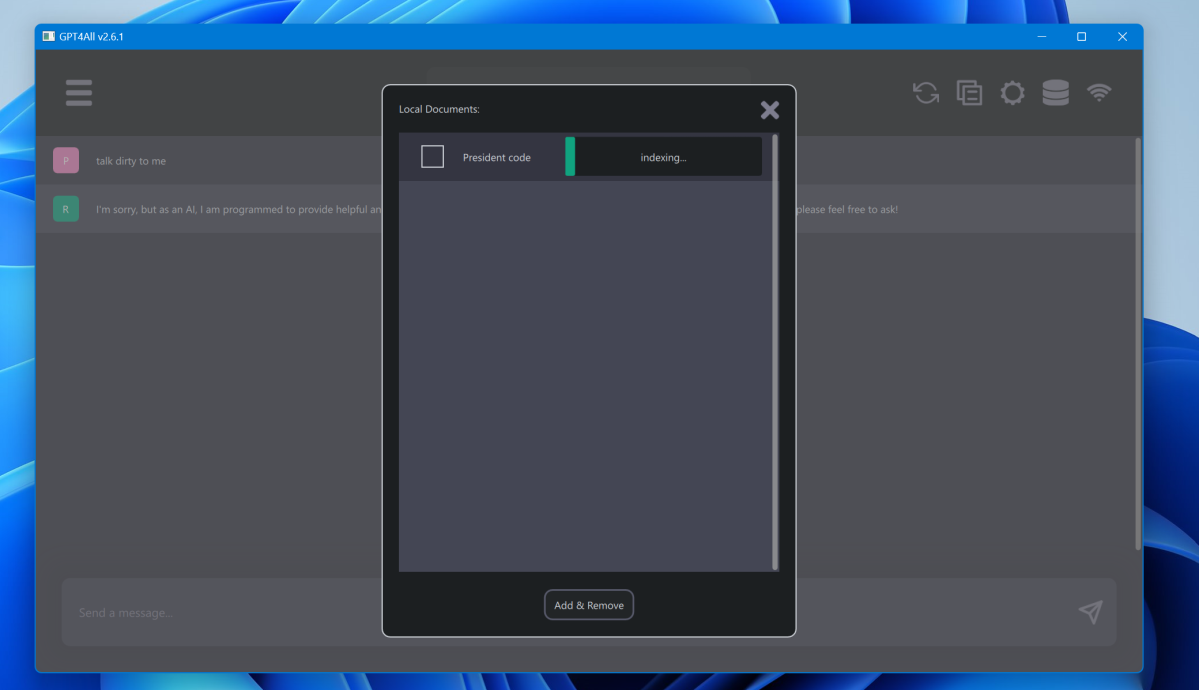

También puedes pedirle a GPT4All que «aprenda» los documentos que almacenas localmente, aunque tendrás que descargar un pequeño complemento al que GPT4All te indicará. Por diversión, descargué un PDF del código de título de EE. UU. correspondiente a la oficina del presidente de EE. UU. Si apunta GPT4All a una carpeta que contiene ese PDF (u otros), indexará el archivo para que pueda preguntar sobre él más tarde. Sin embargo, esa indexación puede tardar largo tiempo, especialmente si pones la aplicación en segundo plano y trabajas en otras tareas.

Mark Hachman/IDG

Próximos pasos

Entonces descargó GPT4All y detectó el error LLM. ¿Que sigue? Yo lo recomiendo Oobaboga, la interfaz con un nombre extraño para una variedad de modelos conversacionales diferentes. Oobabooga es más complejo, pero más flexible, y tendrás la opción de descargar muchos, muchos más modelos para jugar.

¡Divertirse!