Google se burla de los avances en la capacidad de inteligencia artificial multimodal de Gemini.

Por delante de su evento anual de E/S muy esperadoGoogle lanzó un vídeo teaser sobre X mostrando algunas nuevas funciones de IA multimodal que seguramente harán que los creadores de R1 del conejo temblando en sus botas.

También: Qué esperar de Google I/O 2024: Android 15, Gemini, Wear OS y más

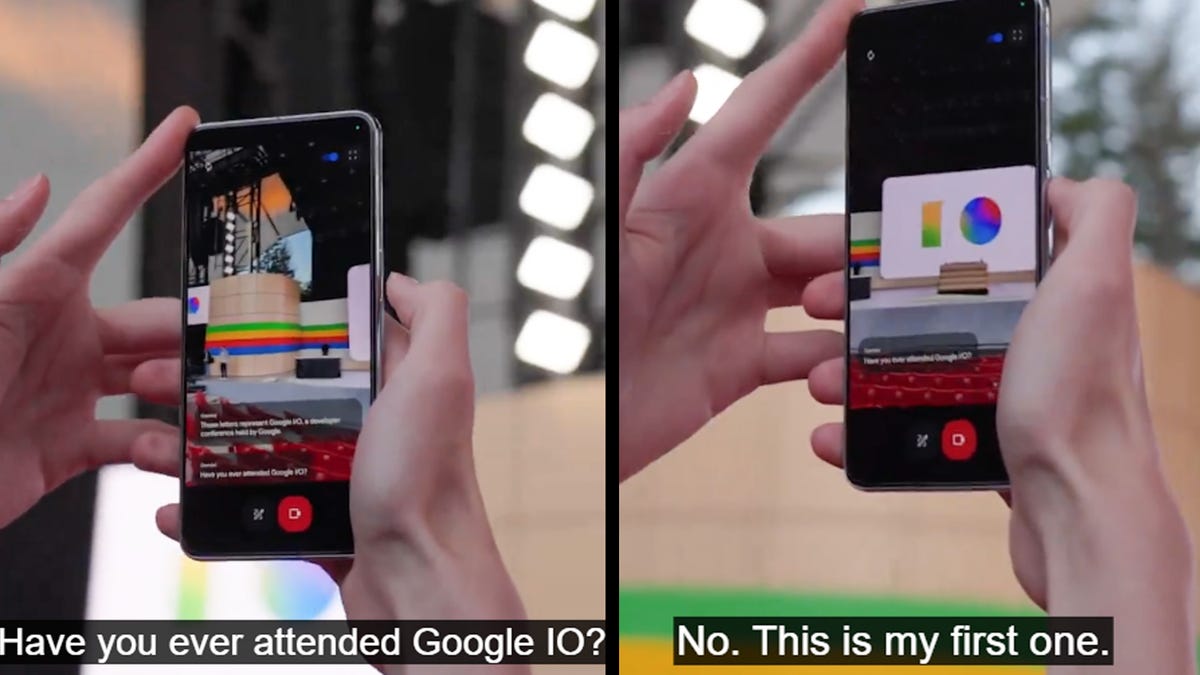

En el video, el usuario sostiene la cámara de su teléfono (Android) hacia la etapa de E/S y pregunta: «¿Qué crees que está pasando aquí?» El modelo de IA Géminis de Google responde: «Parece que la gente se está preparando para un gran evento, tal vez una conferencia o una presentación». Entonces, Géminis hace su propia pregunta: «¿Hay algo en particular que te llame la atención?»

Cuando el usuario le pregunta a Gemini qué significan las letras grandes en el escenario, Gemini identifica correctamente la conferencia de desarrolladores de E/S de Google. La pregunta probablemente ayudó a la IA a obtener información contextual, lo que a su vez la posicionó para proporcionar respuestas más útiles. Luego, el chatbot continúa con otra pregunta: «¿Has asistido alguna vez a Google I/O?» La conversación parece natural y sin esfuerzo, al menos en el vídeo.

Durante su Demostración de lanzamiento de R1 En abril, Rabbit mostró una tecnología de inteligencia artificial multimodal similar que muchos elogiaron como una característica interesante. El vídeo teaser de Google demuestra que la compañía ha trabajado arduamente para desarrollar una funcionalidad similar para Gemini que, por lo que parece, podría ser incluso mejor.

Google y Rabbit no están solos. También hoy, OpenAI mostró sus propias actualizaciones durante su Actualización de primavera de OpenAI transmisión en vivo, incluyendo GPT-4o, su modelo de IA más nuevo que ahora permite a ChatGPT «ver, oír y hablar». Durante la demostración, los presentadores mostraron a la IA una serie de cosas diferentes a través de la cámara de su teléfono inteligente, incluido un problema matemático escrito a mano y las expresiones faciales del presentador, y la IA identificó correctamente estas cosas a través de una conversación similar con sus usuarios.

También: Por qué las gafas inteligentes Ray-Ban de Meta son mi compra tecnológica favorita este año

Cuando Google actualiza Géminis en el móvil Con esta característica, la tecnología de la compañía podría saltar al frente del grupo en la carrera de asistentes de IA, particularmente con la cadencia de sonido extremadamente natural y las preguntas de seguimiento de Gemini. Aunque la amplitud exacta de capacidades se revelará en I/O, este desarrollo ciertamente coloca a Rabbit en una posición complicada, haciendo que una de sus características destacadas sea esencialmente redundante.

Como ocurre con cualquier demostración que no se muestra en vivo, debes tomar esta con cautela. Aún así, el lanzamiento estratégico de este video apenas una hora antes de la transmisión en vivo de OpenAI sugiere que Google tendrá mucho más que decir al respecto. Geminis esta semana.