La mayoría de los mejores robots, los que pueden caminar, correr, subir escaleras y hacer parkour, no tienen cara, y puede haber una buena razón para ello. Si alguno de ellos tuviera tazas como la de este nuevo robot de investigación, probablemente nos detendríamos en seco frente a ellos, mirando sin decir palabra mientras pasaban sobre nosotros.

Construir robots con caras y la capacidad de imitar expresiones humanas es una fascinación constante en el mundo de la investigación en robótica, pero, aunque podría necesitar menos batería y menos motores de carga para hacerlo funcionar, el listón es mucho más alto para un robot. sonreír que el salto de un robot.

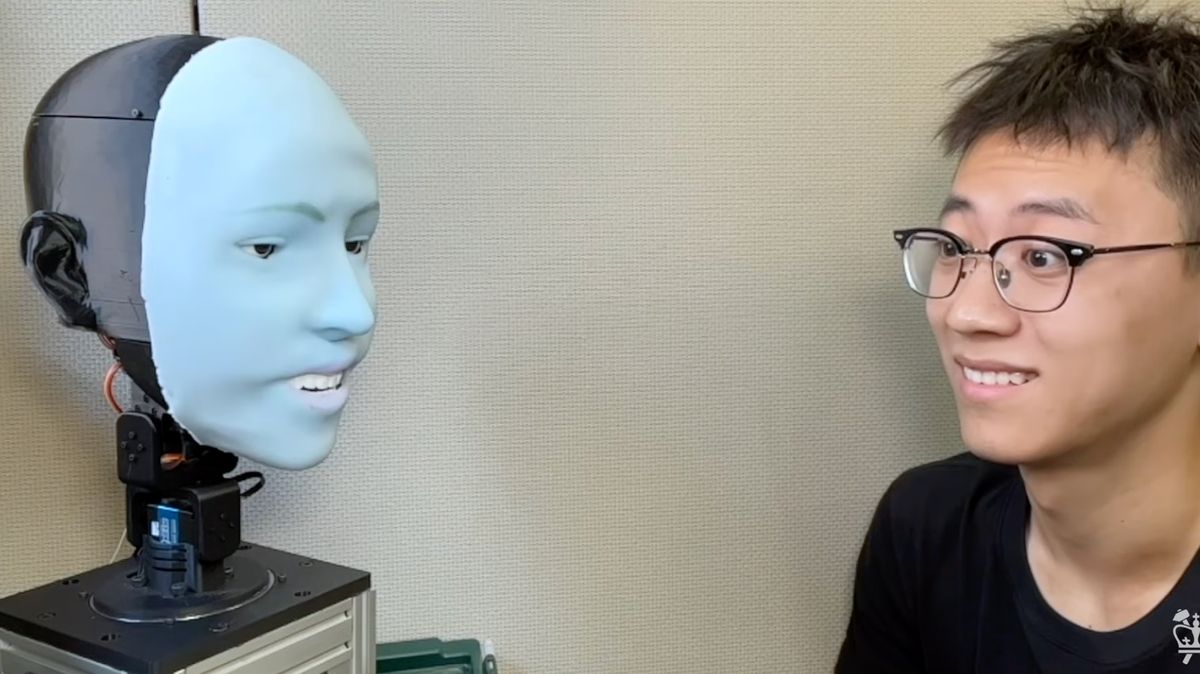

Aun así, el desarrollo de Columbia Engineering de su robot más nuevo, Emo y «Coexpresión facial humano-robot» es un trabajo impresionante e importante. En un artículo científico publicado recientemente y Video de Youtubelos investigadores describen su trabajo y demuestran la capacidad de Emo para hacer contacto visual e imitar y replicar instantáneamente la expresión humana.

Decir que la serie de expresiones humanas del robot es inquietante sería quedarse corto. Como tantas caras de robots de su generación, la forma de su cabeza, sus ojos y su piel de silicona se parecen a un rostro humano, pero no lo suficiente como para evitar el temido y extraño valle.

Está bien, porque el objetivo de Emo no es poner una cabeza de robot parlante en tu casa hoy. Se trata de programar, probar y aprender… y tal vez tener un robot expresivo en tu hogar en el futuro.

Los ojos de Emo están equipados con dos cámaras de alta resolución que le permiten hacer «contacto visual» y, utilizando uno de sus algoritmos, observarte y predecir tus expresiones faciales.

Debido a que la interacción humana a menudo implica modelado, lo que significa que a menudo imitamos inconscientemente los movimientos y expresiones de aquellos con quienes interactuamos (cruzar los brazos en un grupo y gradualmente observar a todos los demás cruzar los brazos), Emo usa su segundo modelo para imitar la expresión facial que predicho.

«Al observar cambios sutiles en un rostro humano, el robot podría predecir una sonrisa inminente 839 milisegundos antes de que el humano sonriera y ajustar su rostro para sonreír simultáneamente». escriben los investigadores en su artículo.

En el vídeo, las expresiones de Emo cambian tan rápidamente como las del investigador. Nadie diría que su sonrisa parece una sonrisa humana normal, que su mirada de tristeza no es vergonzosa o que su mirada de sorpresa no es inquietante, pero sus 26 actuadores debajo de la piel se acercan bastante a ofrecer algo reconocible. expresión humana.

«Creo que predecir las expresiones faciales humanas representa un gran paso adelante en el campo de la interacción entre humanos y robots. Tradicionalmente, los robots no han sido diseñados para considerar a los humanos», dijo el candidato a doctorado de Columbia, Yuhang Hu, en el vídeo.

Cómo aprendió Emo sobre las expresiones humanas es aún más fascinante. Para entender cómo funcionan su propia cara y sus motores, los investigadores pusieron a Emo frente a una cámara y le permitieron hacer cualquier expresión facial que quisiera. Esto le enseñó a Emo la conexión entre sus movimientos motores y las expresiones resultantes.

También entrenaron a la IA en expresiones humanas reales. La combinación de estos métodos de entrenamiento hace que Emo se acerque lo más posible a la expresión humana instantánea que hemos visto en un robot.

El objetivo, señalan los investigadores en el vídeo, es que Emo posiblemente se convierta en una interfaz para una IA o Inteligencia General Artificial (básicamente una IA pensante).

Emo llega apenas unas semanas después Figure AI presentó su robot Figura 01 imbuido de OpenAI y su capacidad para comprender y actuar sobre la conversación humana. Ese robot, en particular, no tenía cara.

No puedo evitar imaginarme cómo sería una cabeza Emo en un robot de la Figura 01. Ese es un futuro por el que vale la pena perder el sueño.