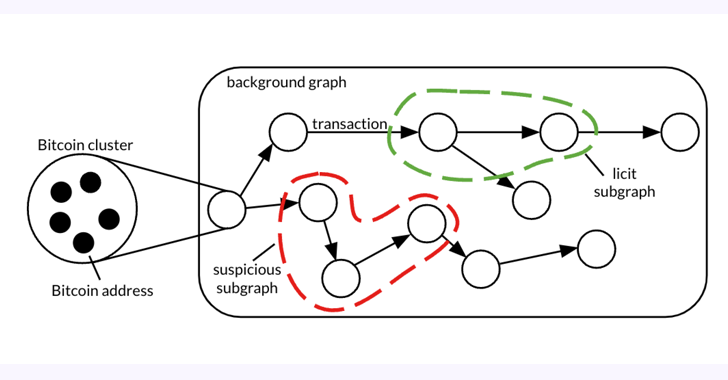

Los chatbots matan: En 2017, el Pentágono estableció el Proyecto Maven para aplicar tecnología de aprendizaje automático (ML) para identificar objetivos en situaciones de combate en tiempo real. El programa ahora aparentemente se ha convertido en una herramienta de guerra adecuada, aunque los miembros del ejército estadounidense prometen que todavía hay un ser humano apretando el gatillo final.

Desde principios de febrero, el Departamento de Defensa de EE. UU. ha empleado algoritmos de aprendizaje automático para identificar objetivos de más de 85 ataques aéreos en Irak y Siria. Según Schuyler Moore, director de tecnología del Comando Central de Estados Unidos (CentCom), el Pentágono comenzó a utilizar tecnología de inteligencia artificial en situaciones de batalla reales después de que los terroristas de Hamás atacaran a Israel el 7 de octubre de 2023.

El ataque sorpresa del terrorista cambió Todo, dijo Moore a Bloomberg, cuando el Departamento de Defensa finalmente decidió implementar los algoritmos de IA desarrollados por el Proyecto Maven. El ejército estadounidense inmediatamente comenzó a hacer cosas que nunca había hecho con la tecnología de guerra de IA.

«El 7 de octubre todo cambió», dijo Moore. «Inmediatamente cambiamos de marcha y adoptamos un ritmo operativo mucho más alto que el que teníamos anteriormente».

Los desarrolladores diseñaron los algoritmos del Proyecto Maven para que funcionen a partir de imágenes de vídeo capturadas por drones estadounidenses, lo que ayuda a detectar soldados u otros posibles objetivos de ataque aéreo. Desde el 2 de febrero, CentCom ha identificado y destruido cohetes, misiles, drones e instalaciones de la milicia enemigos con Maven AI.

Moore intentó desmitificar las supuestas capacidades de «matar» de los nuevos algoritmos de reconocimiento de objetos, afirmando que cada paso que involucra a la IA termina con la validación humana. El CentCom también utilizó un motor de recomendación de IA que sugería planes de ataque y las mejores armas para usar durante las operaciones. Sin embargo, los resultados no estuvieron a la altura de los estándares humanos.

Proyecto Maven ha demostrado ser un tema muy controvertido en los últimos años. Google abandonó el programa después de enfrentar una importante reacción negativa de los empleados, pero otras compañías estaban más que felices de seguir trabajando en la guerra de IA con funcionarios del Pentágono.

Como lo confirman los ataques aéreos con IA revelados por Moore, el Departamento de Defensa ahora está dispuesto a seguir adelante con el despliegue de tecnología «inteligente» en el campo de batalla. Al parecer, el Pentágono ya está trabajando en la integración de modelos en lenguaje grande (LLM) en decisiones de combate reales.

Craig Martell, director digital y de inteligencia artificial del Departamento de Defensa, dijo recientemente que Estados Unidos podría quedarse atrás adversarios si no adopta modelos de IA generativa en las operaciones de guerra. Por supuesto, el gobierno de Estados Unidos debe concebir las «medidas de protección» y mitigaciones adecuadas para los riesgos de seguridad nacional, previniendo y abordando los problemas que podrían surgir de datos de entrenamiento mal administrados.