Cerebras Systems ha presentado su Wafer Scale Engine 3 (WSE-3), denominado «el chip de IA más rápido del mundo».

El WSE-3, que alimenta la supercomputadora de IA Cerebras CS-3, ofrece el doble de rendimiento que su predecesor, el WSE-2, con el mismo consumo de energía y precio.

El chip es capaz de entrenar modelos de IA con hasta 24 billones de parámetros, un salto significativo con respecto a los modelos anteriores.

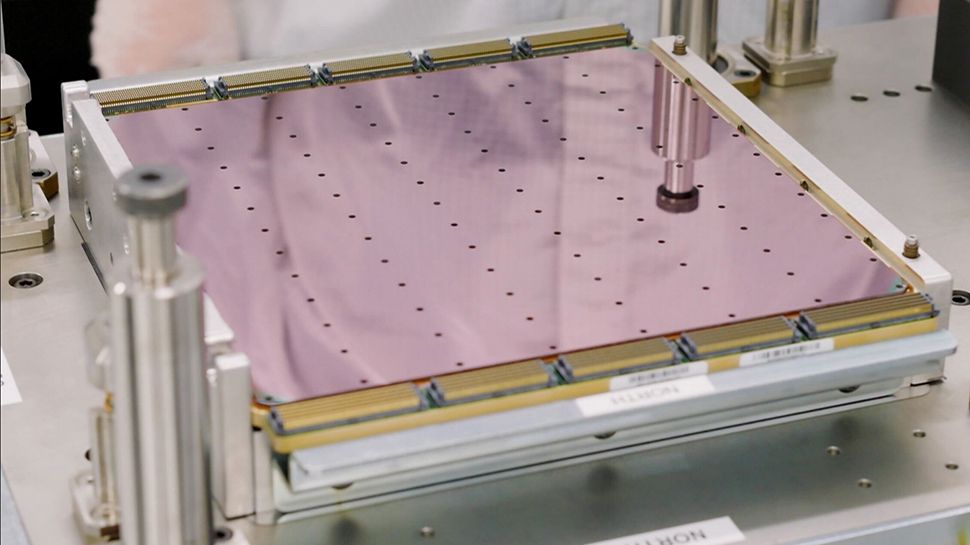

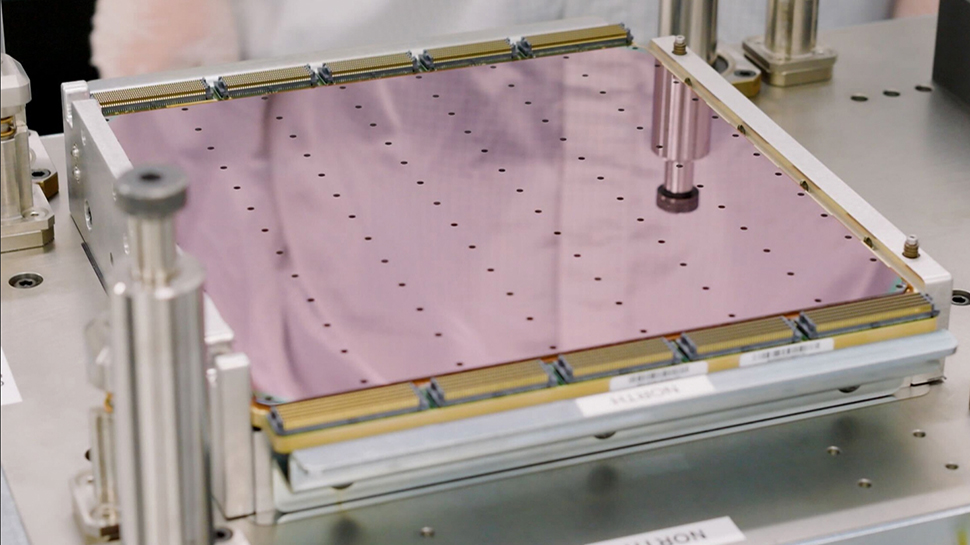

supercomputadora cs-3

El WSE-3 se basa en un proceso TSMC de 5 nm y cuenta con 44 GB de SRAM en chip. Cuenta con cuatro billones de transistores y 900.000 núcleos informáticos optimizados para IA, lo que ofrece un rendimiento máximo de IA de 125 petaflops, que es el equivalente teórico a unos 62 NVIDIA GPU H100.

La supercomputadora CS-3, impulsada por WSE-3, está diseñada para entrenar modelos de IA de próxima generación que son 10 veces más grandes que GPT-4 y Gemini. Con un sistema de memoria de hasta 1,2 petabytes, puede almacenar 24 billones de modelos de parámetros en un único espacio de memoria lógica, lo que simplifica el flujo de trabajo de capacitación y aumenta la productividad de los desarrolladores.

Cerebras dice que su supercomputadora CS-3 está optimizada para necesidades empresariales y de hiperescala, y ofrece eficiencia energética y simplicidad de software superiores, requiriendo un 97% menos de código que las GPU para modelos de lenguajes grandes (LLM).

El director ejecutivo y cofundador de Cerebras, Andrew Feldman, dijo: «WSE-3 es el chip de IA más rápido del mundo, diseñado específicamente para el último trabajo de IA de vanguardia, desde una combinación de expertos hasta modelos de 24 billones de parámetros. Estamos encantados para llevar WSE-3 y CS-3 al mercado para ayudar a resolver los mayores desafíos de IA de hoy”.

La compañía dice que ya tiene una acumulación de pedidos del CS-3 en nubes empresariales, gubernamentales e internacionales. El CS-3 también desempeñará un papel importante en la asociación estratégica entre Cerebras y G42, que ya ha entregado 8 exaFLOP de rendimiento de supercomputadora de IA a través de Condor Galaxy 1 y 2. Actualmente se está construyendo una tercera instalación, Condor Galaxy 3, que se construirá con 64 sistemas CS-3, produciendo 8 exaFLOP de computación de IA.