Ya sea que vea la IA como una herramienta increíble con enormes beneficios o como un mal social que solo beneficia a las herramientas masivas, un nuevo y poderoso chip puede entrenarlas más rápido que nunca. Cerebras Systems ha presentado el chip de IA más rápido del mundo: el Wafer Scale Engine 3 (WSE-3), que impulsa la supercomputadora de IA Cerebras CS-3 con un rendimiento máximo de 125 petaFLOPS. Y es escalable hasta un grado increíble.

Antes de que un sistema de inteligencia artificial pueda producir un pequeño y lindo pero extraño Vídeo de un gato despertando a su dueñonecesita ser entrenado de manera franca asombrosa cantidad de datosconsumiendo más 100 hogares de energía en el proceso. Pero el nuevo chip y las computadoras construidas con él ayudarán a acelerar ese proceso y hacerlo más eficiente.

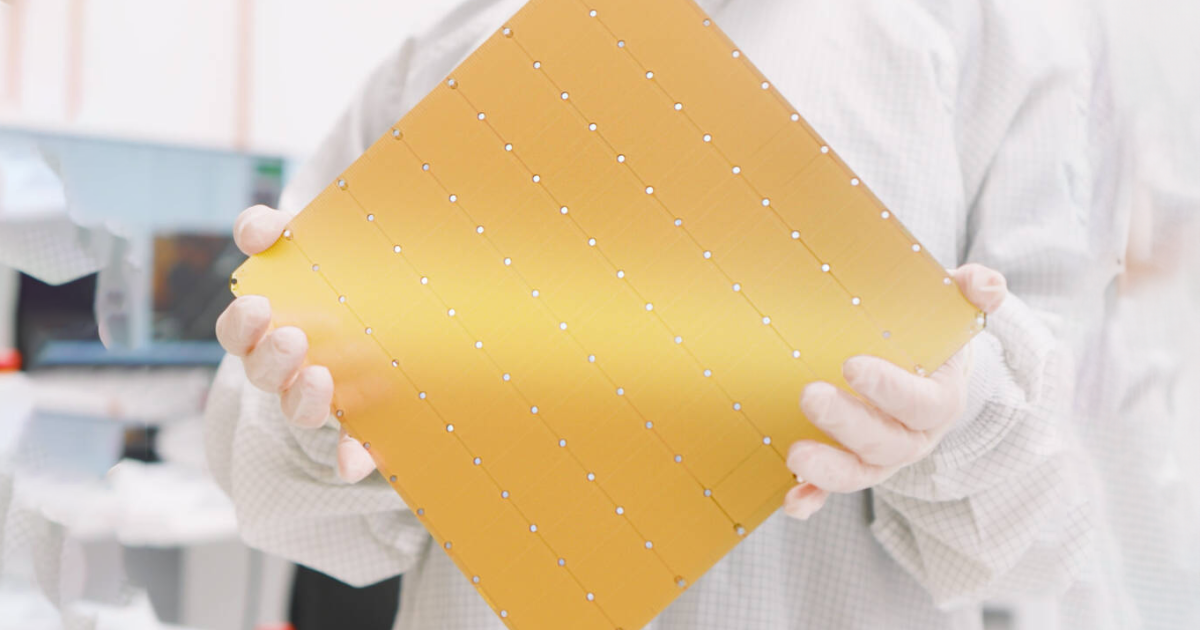

Cada chip WSE-3, del tamaño aproximado de una caja de pizza, contiene una sorprendente cuatro billones transistores, proporcionando el doble de rendimiento que el modelo anterior de la compañía (que también ostentaba el récord mundial anterior) por el mismo costo y consumo de energía. Cuando estos se incluyen en el sistema CS-3, aparentemente pueden proporcionar el rendimiento de una sala llena de servidores dentro de una sola unidad del tamaño de un mini refrigerador.

Cerebras dice que el CS-3 ejecuta 900.000 núcleos de IA y 44 GB de SRAM en el chip, lo que proporciona hasta 125 petaFLOPS de rendimiento máximo de IA. En teoría, eso debería ser suficiente para colocarlo entre las 10 mejores supercomputadoras del mundo, aunque, por supuesto, no ha sido probado en esos puntos de referencia, por lo que no podemos estar seguros de qué tan bien funcionará realmente.

Para almacenar todos esos datos, las opciones de memoria externa incluyen 1,5 TB, 12 TB o 1,2 petabytes (PB), que son 1200 TB. El CS-3 puede entrenar modelos de IA que involucran hasta 24 billones de parámetros; en comparación, la mayoría de los modelos de IA actualmente tienen miles de millones de parámetros, con GPT-4 estimado hasta alcanzar alrededor de 1,8 billones. Cerebras dice que el CS-3 debería poder entrenar un modelo de un billón de parámetros tan fácilmente como las computadoras actuales basadas en GPU entrenan un miserable modelo de mil millones de parámetros.

Gracias al proceso de producción de obleas de los chips WSE-3, el CS-3 está diseñado para ser escalable, permitiendo agrupar hasta 2.048 unidades en una supercomputadora apenas insondable. Esto sería capaz de hasta 256 exaFLOPS, donde el mejores supercomputadoras del mundo Actualmente todavía estamos jugando con un poco. más de un exaFLOP. Ese tipo de potencia le permitiría entrenar un modelo Llama 70B desde cero en sólo un día, afirma la empresa.

Ya parece que los modelos de IA son avanzando a un ritmo aterrador, pero este tipo de tecnología solo hará que la manguera contra incendios suba aún más. No importa qué trabajo hagas, parece que los sistemas de IA vendrán a por ti. tus trabajos e incluso sus pasatiempos más rápido que nunca.

Fuente: Cerebras [1],[2]