Con toda la charla reciente sobre AI, centros de datosy la nube, creemos que es útil recordar que los procesadores como GPU y CPU solo generan alrededor del 20% del costo inicial de un servidor. Estos tienden a recibir la mayor atención ya que primero se debe elegir el procesador, y es esta decisión la que impulsa las opciones para todo lo demás en el servidor, pero son solo una parte del costo total.

La memoria es otro 20%. Pero aún así, más de la mitad del costo de un servidor proviene de productos mucho más prosaicos (placas de circuito impreso (PCB), componentes pasivos, cables, fuentes de alimentación, discos duros y los bastidores que los contienen). Deberíamos agregar las redes, que pueden ser más que el resto de los componentes, pero lo dejaremos para otro momento: ¿quién vende todo ese equipo y dónde se acumula el valor?

Nota del editor:

Autor invitado Jonathan Goldberg es el fundador de D2D Advisory, una firma de consultoría multifuncional. Jonathan ha desarrollado estrategias de crecimiento y alianzas para empresas de las industrias de telefonía móvil, redes, juegos y software.

Aquí hay dos tipos de proveedores: OEM y ODM; no vamos a detallar las siglas porque eso en realidad confunde el panorama. En términos generales, los OEM son propietarios de las marcas y de las relaciones con los clientes finales. Los ODM proporcionan abastecimiento y fabricación: la producción física y el ensamblaje de todos los equipos. Entre los dos, existe una considerable superposición en áreas de diseño e integración de sistemas. Es importante tener en cuenta que los límites entre los OEM y los ODM son difusos, con importantes vaivenes en muchas áreas.

Un poco de historia. Este modelo cobró vida durante la década de 1990, cuando los fabricantes de PC trasladaron su fabricación de Estados Unidos a Asia. Las marcas de PC, los OEM, subcontrataron a fabricantes contratados en gran medida con sede en Taiwán. Esas empresas fabricaron equipos en Taiwán y luego se trasladaron en gran medida a China. Con el tiempo, los fabricantes contratados ascendieron en la cadena de valor y agregaron capacidades de diseño. Los fabricantes contratados se convirtieron en ODM y luego muchos de ellos escindieron empresas separadas para vender sus propios productos de marca y se convirtieron en OEM por derecho propio. Este modelo luego se filtró en la forma en que se producen la mayoría de los productos electrónicos de alto volumen en la actualidad.

Los servidores se movieron a un ritmo ligeramente diferente. Estos ofrecían un volumen menor y precios más altos, por lo que los OEM, los propietarios de las marcas, mantuvieron las funciones de diseño (y a veces la fabricación) durante mucho más tiempo. Durante muchos años, los OEM trabajaron con Intel para diseñar una gama de servidores. Luego los vendieron a los clientes. Si bien ofrecían varias configuraciones, en gran medida se trataba de sistemas de catálogo: los clientes elegían entre las opciones disponibles.

La nube cambió todo esto.

Lo más crítico es que los proveedores de nube pública (también conocidos como los hiperescaladores) llegó a dominar el mercado, concentrando no sólo el poder económico sino también la competencia técnica. Con el tiempo, los hiperescaladores eliminaron en gran medida a los OEM y trabajaron directamente con los ODM para obtener los sistemas que ellos mismos diseñaron.

Hoy en día, el panorama OEM se compone en gran medida de HP, Dell y Lenovo. Hay cientos de ODM, pero los más grandes tienen su sede en Taiwán e incluyen a Compal, Foxconn, Inventec, Quanta y Wistron. Todas las empresas son muy diversas con docenas de filiales repartidas a lo largo de la cadena de suministro. También hay un puñado de otros ODM que tienden a especializarse en nichos específicos, como el stock de memes del momento SuperMicro con su especialidad en servidores GPU.

¿Cómo funciona esto en la práctica? Hoy en día existe una división entre los hiperescaladores y esencialmente todos los demás. Imaginemos una gran corporación (un banco, una cadena de comida rápida o un fabricante de automóviles) que aún quiera tener sus propios servidores o incluso centros de datos. Trabajarán con los OEM, quienes les ofrecerán un catálogo de sistemas para elegir. Luego, los OEM normalmente actuarán como integradores de sistemas: trabajarán con todos los proveedores para obtener piezas, ensamblar las PCB, luego conectar todo e instalar el software. Los fabricantes de equipos originales desempeñan un papel importante aquí, ya que son ellos quienes toman muchas decisiones de compra.

Por el contrario, los hiperescaladores operan docenas de centros de datos. Su negocio se basa en economías de escala masivas y si pueden reducir el 5% del costo de un servidor, eso generará cientos de millones de dólares en ahorros. Además tienen talento técnico concentrado. En pocas palabras, pueden permitirse el lujo de contratar equipos para diseñar servidores optimizados para sus necesidades específicas. Otras grandes corporaciones no tienen esos equipos, ni realmente los necesitan, simplemente no operan a la misma escala. Luego, los hiperescaladores van directamente a los ODM que recopilan todos los componentes, ensamblan los sistemas y los conectan. En este caso, es el cliente final quien toma las decisiones de compra de casi todos los componentes.

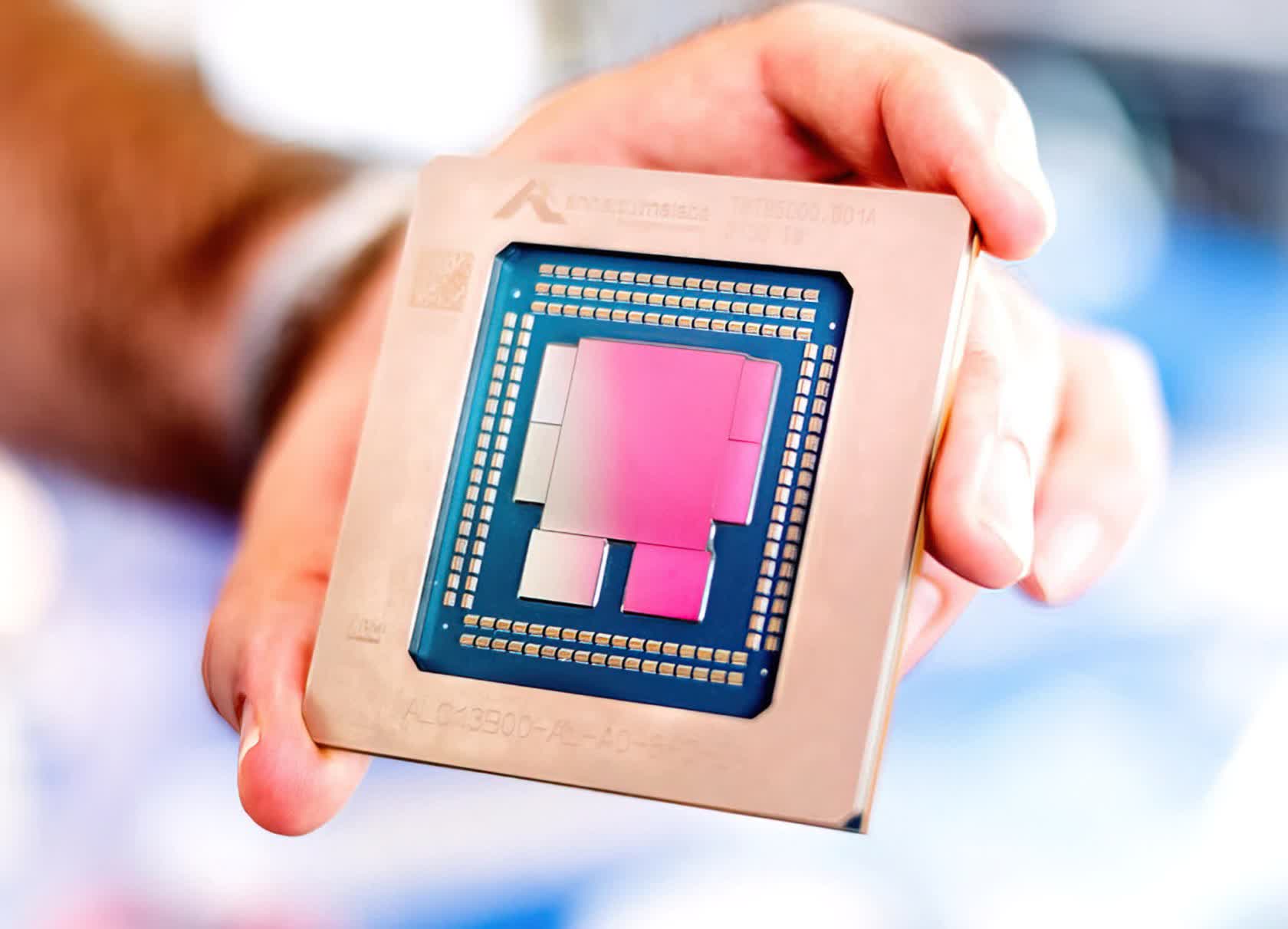

Esto presenta un gran problema para todos los proveedores de componentes. Imagínese un vendedor de chips. Necesitan convencer a un cliente para que compre su chip, pero el cliente no quiere un chip, quiere un sistema completo que funcione. Antes de aceptar pedidos grandes, el cliente querrá probar ese sistema y asegurarse de que ejecuta bien su software. Entonces, el proveedor del chip tiene que trabajar con un OEM u ODM para diseñar ese sistema. Y estos diseños cuestan dinero. Se necesita un equipo de 5 a 10 personas durante uno o dos meses para diseñar todo, verificar el rendimiento y garantizar la compatibilidad del firmware y el software. Entonces alguien tiene que comprar componentes para construir algunos prototipos.

Estos costos suman rápidamente, fácilmente unos cientos de miles por sistema y, a menudo, hasta siete cifras. Entonces, antes de que el proveedor de chips pueda vender un solo chip, tiene que invertir cantidades importantes. Todos los clientes quieren servidores que se ajusten lo más posible a sus necesidades, lo que significa que alguien tiene que producir múltiples versiones del servidor, por lo que los costos pueden dispararse. Todo antes de que nadie sepa qué tan bien se vende la plataforma.

Este problema ha empeorado. Cuando sólo Intel y AMD vendían CPU para servidores, la cadena de suministro tenía un espacio de decisión limitado, con proveedores bien establecidos. Ahora eso hay una docena de diseñadores de CPU la combinatoria es mucho más desalentadora. Cualquiera que quiera ingresar al mercado de aceleradores de IA tiene que lidiar con todos estos costos. Y los vendedores más pequeños deben tener mucho cuidado al realizar sus apuestas.

Invierta en soporte para un chip popular y las recompensas pueden ser inmensas, pero invierta en las plataformas equivocadas y los retornos serán grandes pérdidas. El problema es aún más grave cuando se trata de vender a los hiperescaladores. Quieren mucho más que unos pocos prototipos. Tienen ciclos de prueba rigurosos que van desde una docena de sistemas hasta cien o unos pocos miles. Pueden pagar por ellos (o no), pero cualquier empresa que diseñe un chip necesita mucho más volumen que eso para justificar los costos de los sistemas de prueba, y mucho menos el costo del chip completo.

Por supuesto, existen todo tipo de iniciativas para estandarizar gran parte de esto. El Proyectos de Computación Abierta La misión principal es estandarizar el diseño de servidores. Y si bien OCP ha hecho algunas contribuciones importantes a la industria, no creemos que nadie lo describiría como un estándar común. Todo esto se va a volver más complejo.

El creciente diversificación de los centros de datos, desde solo CPU hasta computación heterogénea está obligando a todos los proveedores, no solo a los diseñadores de chips, a comenzar a asumir grandes riesgos. Muchos perseguirán todos los acuerdos, otros probablemente recurrirán a viejos hábitos centrándose en AMD e Intel y ahora en Nvidia. Los inteligentes adoptarán un enfoque de cartera para sus negocios y monitorearán sus elecciones de manera similar a la de los administradores de fondos de cobertura o los inversionistas de riesgo. No pretendemos ser alarmistas, mucho de esto es una parte natural del carácter cíclico de la electrónica. Con el tiempo, la industria encontrará un nuevo equilibrio, pero los próximos años serán mucho más caóticos.