¿Lo que acaba de suceder? Apple ha tardado en adoptar la IA generativa, pero eso podría estar cambiando con la introducción de MM1, un modelo de lenguaje multimodal de gran tamaño capaz de interpretar datos de imágenes y texto. Esta funcionalidad podría incluirse en la próxima generación de teléfonos y servicios de la compañía, aunque también hay rumores de que Apple integrará la IA Gemini de Google.

Los investigadores de Apple han desarrollado MM1, un nuevo enfoque para entrenar modelos de lenguaje grandes (LLM) que incorporan información tanto textual como visual. MM1 es parte de una familia de modelos multimodales que incluye hasta 30 mil millones de parámetros, utilizando un conjunto de datos que comprende pares de imágenes y leyendas, documentos de imágenes y texto entrelazados y datos de solo texto, según un papel publicado por los investigadores.

Los modelos multimodales de lenguaje grande (MLLM), explican, son modelos fundamentales a gran escala que procesan datos de imágenes y texto para producir resultados textuales. «Tras el auge de los LLM, los MLLM están emergiendo como la próxima frontera en los modelos de fundaciones», señalan.

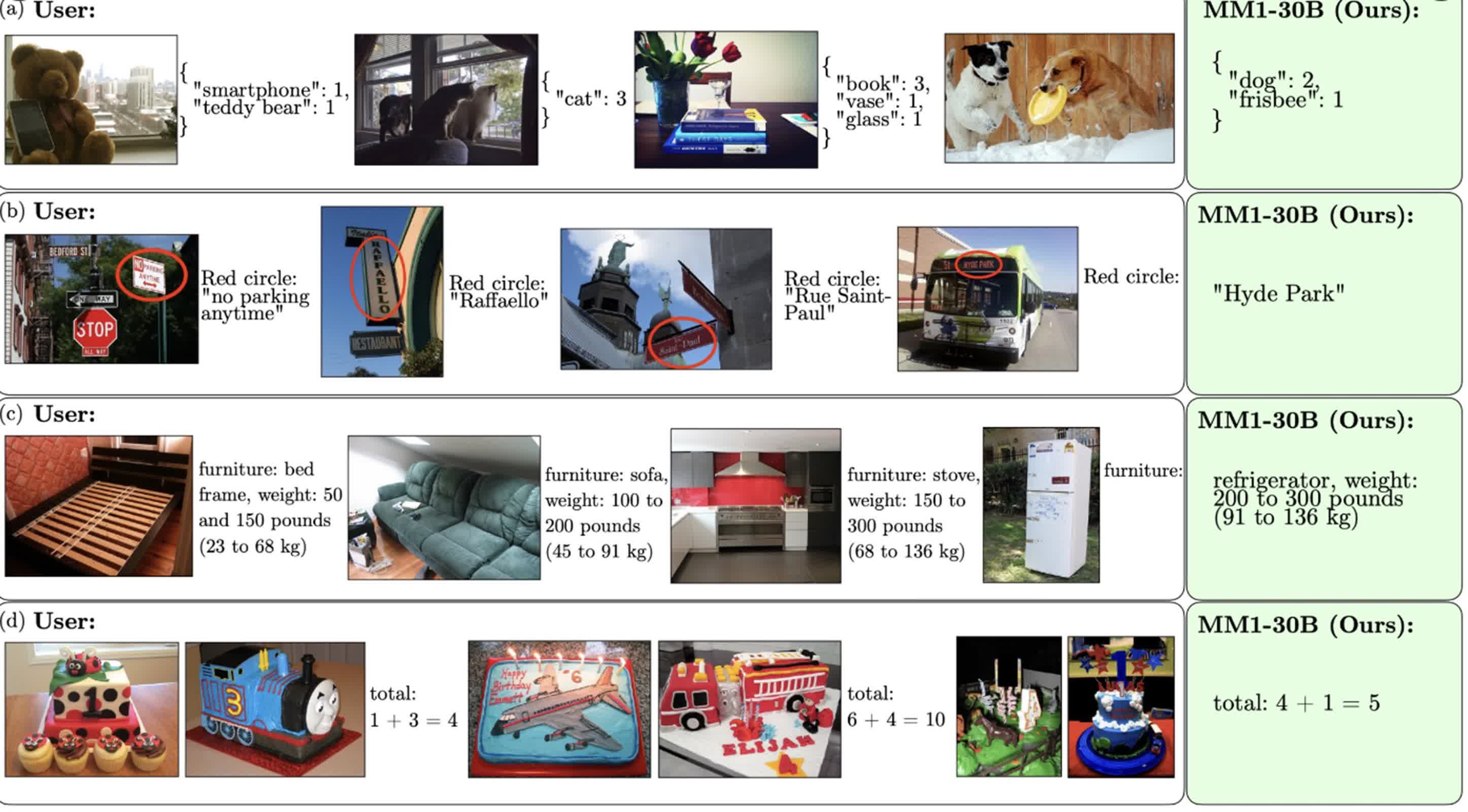

Apple afirma que MM1 es capaz de contar objetos, identificar partes de imágenes, demostrar sentido común y conocimiento de palabras sobre objetos cotidianos y realizar funciones matemáticas básicas. También admite el aprendizaje en contexto, lo que significa que el modelo no necesita volver a entrenarse ni ajustarse para cada consulta, sino que es capaz de comprender la consulta en función del contexto proporcionado. También cuenta con razonamiento de múltiples imágenes, lo que le permite interpretar y sacar conclusiones de múltiples imágenes.

Apple pone el ejemplo de un usuario que le muestra una foto al modelo y le pregunta cuánto tendría que pagar por toda la cerveza en la mesa según el precio del menú.

El modelo responde señalando que si bien la imagen muestra un menú con los precios de las cervezas, no está del todo claro qué cervezas específicas hay en la mesa. Sin embargo, le dice al usuario que puede proporcionar una estimación basada en los precios visibles. Su respuesta: «Del menú, parece que los precios de la cerveza son los siguientes: Magna: 5, Medalla: 5, Heineken: 6 Presidente: 6 Suponiendo que las cervezas en la mesa son Magna, Medalla, Heineken y Presidente, y hay dos de cada, pagarías: 2 x Magna: 2 x 5 = 10, 2 x Medalla: 2 x 5 = 10, 2 x Heineken: 2 x 6 = 12, 2 x Presidente: 2 x 6 = 12 Total: 10 + 10 + 12 + 12 = 44.»

MM1 es «sólo el comienzo», según el ingeniero de investigación senior de Apple, Brandon McKinzie, que está trabajando en modelos multimodales. También dijo que Apple «ya está trabajando duro en la próxima generación de modelos».

Este es solo el comienzo. El equipo ya está trabajando arduamente en la próxima generación de modelos. ¡Muchísimas gracias a todos los que contribuyeron a este proyecto!

– Brandon McKinzie (@mckbrando) 15 de marzo de 2024

La noticia de MM1 llega en medio de un informe de que Apple está actualmente en negociaciones para licencia la tecnología Gemini AI de Google para su uso en la próxima serie de iPhone. La asociación le daría a Google Gemini una audiencia más amplia y ayudaría a Apple a obtener acceso a algunas de las tecnologías de inteligencia artificial generativa más avanzadas disponibles.

Estas negociaciones también sugieren que las iniciativas de IA de Apple podrían no estar progresando tan rápido como se esperaba. Apple ha sido el más cauteloso entre los gigantes tecnológicos a la hora de adoptar la IA generativa, prefiriendo esperar a que el mercado madure un poco antes de comprometerse.

La presentación de MM1 abre nuevas posibilidades para la próxima generación de servicios de Apple. Es posible que MM1 pueda integrarse en Siri 2.0, permitiéndole responder preguntas basadas en imágenes. Además, iMessage podría mejorarse con el nuevo modelo, ofreciendo a los usuarios sugerencias de respuestas más precisas basadas en imágenes compartidas.