La empresa de inteligencia artificial (IA) Hugging Face reveló el viernes que detectó un acceso no autorizado a su plataforma Spaces a principios de esta semana.

«Tenemos sospechas de que se podría haber accedido a un subconjunto de secretos de Spaces sin autorización», afirma. dicho en un aviso.

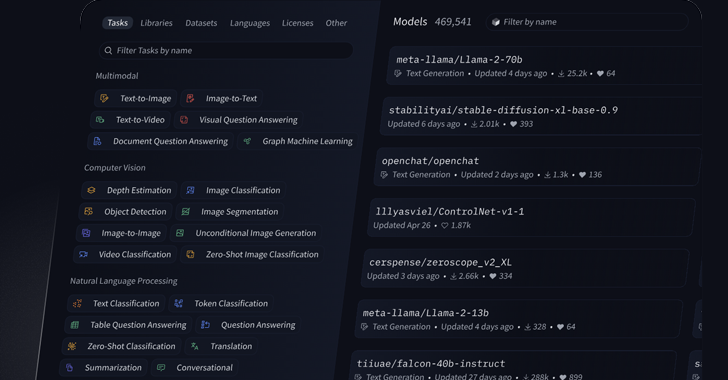

Espacios ofrece una manera para que los usuarios crear, alojar y compartir Aplicaciones de IA y aprendizaje automático (ML). También funciona como un servicio de descubrimiento para buscar aplicaciones de inteligencia artificial creadas por otros usuarios en la plataforma.

En respuesta al evento de seguridad, Hugging Space dijo que está tomando la medida de revocar una serie de fichas HF presente en esos secretos y que notifica a los usuarios a quienes se les revocaron sus tokens por correo electrónico.

«Le recomendamos que actualice cualquier clave o token y considere cambiar sus tokens HF a tokens de acceso detallados, que son los nuevos valores predeterminados», agregó.

Hugging Face, sin embargo, no reveló cuántos usuarios se vieron afectados por el incidente, que actualmente se encuentra bajo investigación. También ha alertado de la infracción a las fuerzas del orden y a las autoridades de protección de datos.

El desarrollo se produce cuando el crecimiento explosivo del sector de la IA ha puesto a proveedores de IA como servicio (AIaaS) como Hugging Face en la mira de los atacantes, que podrían explotarlos con fines maliciosos.

A principios de abril, la empresa de seguridad en la nube Wiz detallado problemas de seguridad en Hugging Face que podrían permitir a un adversario obtener acceso entre inquilinos y envenenar los modelos de IA/ML al hacerse cargo de los canales de integración y despliegue continuos (CI/CD).

Investigaciones anteriores realizadas por HiddenLayer también desenterrado fallas en el servicio de conversión de Hugging Face Safetensors que permitieron secuestrar los modelos de IA enviados por los usuarios y organizar ataques a la cadena de suministro.

«Si un actor malintencionado comprometiera la plataforma de Hugging Face, podría obtener acceso a modelos privados de IA, conjuntos de datos y aplicaciones críticas, lo que provocaría daños generalizados y riesgos potenciales en la cadena de suministro», señalaron los investigadores de Wiz en abril.