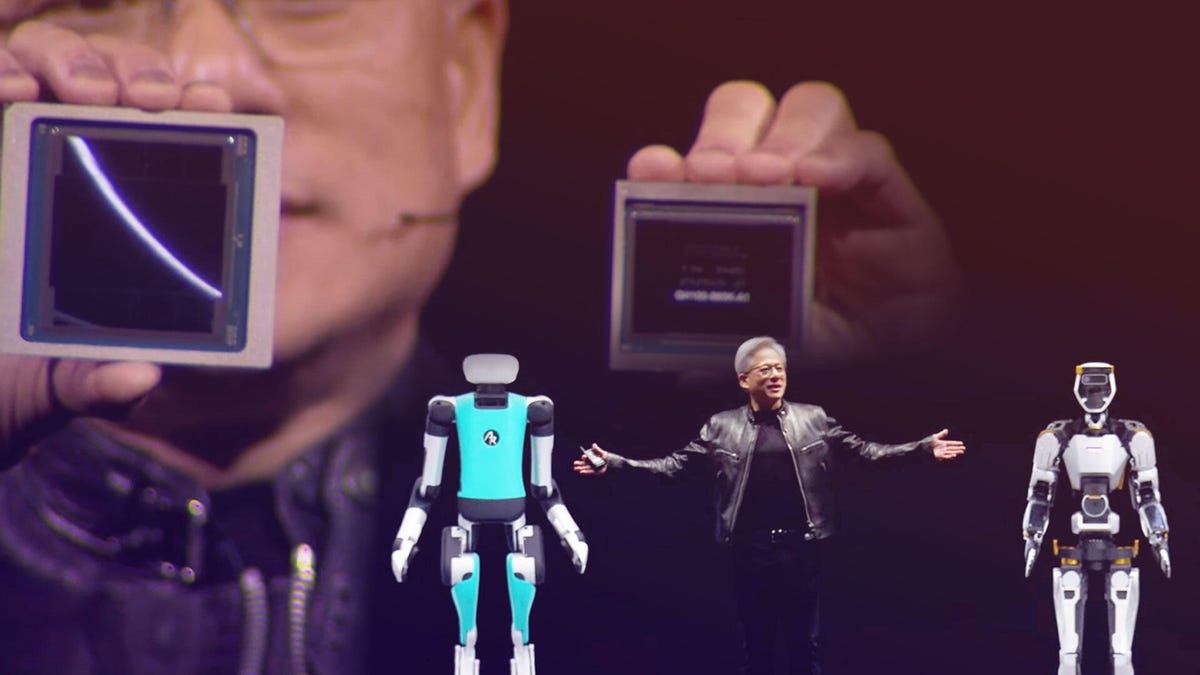

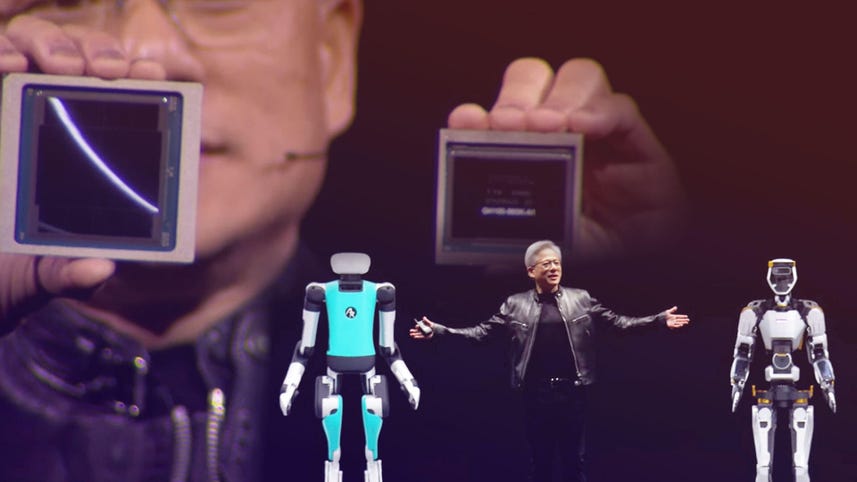

Orador 1: Espero que se dé cuenta de que esto no es un concierto. Ha llegado a una conferencia de desarrolladores. Habrá mucha ciencia descrita sobre algoritmos, arquitectura de computadoras y matemáticas. Blackwell no es un chip. Blackwell es el nombre de una plataforma. La gente piensa que fabricamos GPU y lo hacemos. [00:00:30] pero las GPU ya no tienen el mismo aspecto que antes. Este es Hopper. Hopper cambió el mundo. Este es Blackwell. Está bien. Hopper Speaker 1: 208 mil millones de transistores. Y para que puedas ver, puedo ver que hay [00:01:00] una pequeña línea entre dos tintes. Esta es la primera vez que dos tintes tienen un botón como este juntos de tal manera que los dos tintes piensan que es un solo chip. Hay 10 terabytes de datos entre ellos, 10 terabytes por segundo, por lo que estos dos lados del chip Blackwell no tienen idea de en qué lado están. No hay problemas de localidad de memoria ni de caché. Es sólo un chip gigante y se integra en dos tipos de sistemas. [00:01:30] El primero, es una función de ajuste de forma compatible con la tolva, por lo que deslizas toda la tolva y empujas Blackwell. Esa es la razón por la cual uno de los desafíos del ramping será tan eficiente. Hay instalaciones de tolvas en todo el mundo y podrían tener la misma infraestructura, el mismo diseño, la potencia, la electricidad, la calefacción y el software idénticos. Y esta es una versión hopper. [00:02:00] para la configuración HGX actual y así es como se ve la segunda tolva. Ahora bien, este es un tablero prototipo. Esta es una placa en pleno funcionamiento y tendré cuidado. Esto de aquí es, no sé, 10 mil millones de dólares. Orador 1: El segundo son cinco. Orador 1: Después de eso, se vuelve más barato. Entonces cualquier cliente en [00:02:30] ¿la audiencia? Está bien. La CPU gris tiene un enlace de chip a chip súper rápido. Lo sorprendente es que esta computadora es la primera de su tipo en la que tantos cálculos caben, en primer lugar, en un lugar tan pequeño. En segundo lugar, es memoria coherente. Se sienten como si fueran una gran familia feliz trabajando juntos en una aplicación. Creamos un procesador para la era de la IA generativa y uno de los más importantes [00:03:00] partes de ello es la generación de tokens de contenido. Lo llamamos. Este formato es FP cuatro. El ritmo al que avanzamos en la informática es una locura y todavía no es lo suficientemente rápido, por lo que construimos otro chip. Este chip es simplemente un chip increíble. Lo llamamos conmutador de enlace ENV. Son 50 mil millones de transistores. Es casi del tamaño de una tolva por sí solo. Este conmutador tiene cuatro enlaces ENV, cada uno de 1,8 [00:03:30] terabytes por segundo, y tiene computación, como mencioné. ¿Para qué es este chip? Si tuviéramos que construir un chip de este tipo, podríamos hacer que cada GPU se comunicara con todas las demás GPU a máxima velocidad al mismo tiempo. Puedes construir un sistema que se vea así. Orador 1: [00:04:00] Ahora, este sistema, este sistema es una especie de locura. Este es 1D GX. Así es como se ve un DGX. Ahora, para que lo sepas, solo hay un par, dos, tres máquinas de exit flops en el planeta mientras hablamos, por lo que este es un sistema de inteligencia artificial de exit flops en un solo bastidor. Quiero agradecer a algunos socios que se unen a nosotros en esto. AWS [00:04:30] se está preparando para Blackwell. Van a construir la primera GPU con IA segura. Están construyendo un sistema de 222 exo flops en el que Cuda acelera SageMaker ai, donde Cuda acelera bedrock ai. Amazon Robotics está trabajando con nosotros utilizando Nvidia Omniverse e Isaac Sim. AWS Health tiene Nvidia Health integrado. Entonces AWS realmente se ha inclinado hacia la computación acelerada. Google es [00:05:00] preparándose para Blackwell. GCP ya tiene cien, H cien, T cuatro, L cuatro, una flota completa de GPU Nvidia Kuda, y recientemente anunciaron un modelo Gemma que se ejecuta en todas ellas. Orador 1: Estamos trabajando para optimizar y acelerar todos los aspectos de GCP. Estamos acelerando el proceso de datos para el procesamiento de datos. Su motor de procesamiento de datos, JAKs XLA, vertex AI y mu joco para robótica. Por eso estamos trabajando con Google y GCP en un montón de [00:05:30] de iniciativas. Oracle se está preparando para Blackwell. Oracle es un gran socio nuestro para Nvidia DGX Cloud y también estamos trabajando juntos para acelerar algo que es realmente importante para muchas empresas. Oracle Database, Microsoft se está acelerando y Microsoft se está preparando para Blackwell. Microsoft y Nvidia tienen una asociación de amplio alcance. Estamos acelerando, podríamos acelerar todo tipo de servicios. Cuando chateas, obviamente, y los servicios de IA que están en Microsoft Azure, es muy, muy probable. [00:06:00] NVIDIA está atrás haciendo la inferencia y la generación de tokens. Construyeron la supercomputadora Nvidia InfiniBand más grande, básicamente un gemelo digital nuestro o un gemelo físico nuestro. Estamos llevando el ecosistema de Nvidia a Azure, Nvidia, DDRs Cloud a Azure. Orador 1: Nvidia Omniverse ahora está alojada en Azure. Nvidia Healthcare está en Azure y todo está profundamente integrado y profundamente conectado con Microsoft Fabric. Un nim, es un modelo previamente entrenado, por lo que es bastante inteligente. [00:06:30] y está empaquetado y optimizado para ejecutarse en la base de instalación de NVIDIA, que es muy, muy grande. Lo que se incita es increíble. Tiene todos estos modelos de código abierto de última generación previamente entrenados. Podrían ser de código abierto, podrían ser de uno de nuestros socios. Podríamos crearlo nosotros como Nvidia moment. Está empaquetado con todas sus dependencias. Entonces Kuda, la versión correcta, co DNN, la versión correcta, tensor rt, LLM, que se distribuye en múltiples GPU, tri [00:07:00] y servidor de inferencia, todos completamente empaquetados juntos. Está optimizado dependiendo de si tiene una sola GPU, múltiples GPU o múltiples nodos de GPU. Está optimizado para eso y está conectado con API que son fáciles de usar. Orador 1: Estos paquetes, increíbles cantidades de software, se optimizarán y empaquetarán y los colocaremos en un sitio web y podrá descargarlos, llevarlos consigo, ejecutarlos en cualquier nube, ejecutarlos en su propio centro de datos. Puede [00:07:30] ejecutar en estaciones de trabajo si cabe. Y todo lo que tienes que hacer es visitar ai.nvidia.com. Lo llamamos microservicio NVIDIA Inference, pero dentro de la empresa todos lo llamamos nims. Tenemos un servicio llamado microservicio NEMO que le ayuda a seleccionar los datos, preparándolos para que pueda enseñar esto a bordo, esta IA. Los afinas y luego los proteges. Incluso puedes evaluar la respuesta, evaluar su desempeño frente a otros ejemplos. Y entonces somos efectivamente una IA. [00:08:00] Fundición que haremos por usted y la industria en IA, lo que TSMC hace por nosotros construyendo chips. Y entonces vamos a ello, vamos a TSMC con nuestras grandes ideas. Orador 1: Ellos lo fabrican y nosotros lo llevamos. Y aquí exactamente lo mismo. AI Foundry y los tres pilares son el microservicio NIMS NEMO y DGX Cloud. Anunciamos que Nvidia AI Foundry está trabajando con algunas de las grandes empresas del mundo. SAP genera el 87% del comercio global del mundo. [00:08:30] Básicamente, el mundo funciona con SAP, nosotros funcionamos con SAP. Nvidia y SAP están construyendo SAP, joya copilotos utilizando Nvidia Nemo y DGX Cloud ServiceNow. Dirigen el 80, el 85% de las empresas Fortune 500 del mundo dirigen su personal y sus operaciones de servicio al cliente en ServiceNow y están utilizando Nvidia AI Foundry para crear asistencia virtual de asistencia de ServiceNow. La cohesión respalda los datos del mundo. Están sentados en una mina de oro. [00:09:00] de datos, cientos de exabytes de datos. Más de 10.000 empresas. Nvidia AI Foundry está trabajando con ellos, ayudándolos a construir su agente de IA generativa Gaia. Snowflake es una empresa que almacena el almacén digital mundial en la nube y atiende más de 3 mil millones de consultas al día para 10 000 clientes empresariales. Orador 1: Snowflake está trabajando con Nvidia AI Foundry para construir copilotos con Nvidia Nemo [00:09:30] y NIMS NetApp. Casi la mitad de los archivos del mundo se almacenan localmente en NetApp. NVIDIA. AI Foundry les está ayudando a crear chatbots y copilotos como esas bases de datos vectoriales y recuperadores con Nvidia Nemo y nims, y tenemos una gran asociación con Dell, todos los que están construyendo estos chatbots y la IA generativa. Cuando estés listo para ejecutarlo, necesitarás una fábrica de IA [00:10:00] y nadie es mejor que Dell para construir sistemas de extremo a extremo de gran escala para empresas. Y entonces, cualquiera, cualquier empresa, cada empresa necesitará construir fábricas de IA. Y resulta que Michael está aquí. Él estará feliz de tomar su pedido. Necesitamos un motor de simulación que represente el mundo digitalmente para que el robot tenga un gimnasio para ir a aprender a ser un robot. a eso lo llamamos [00:10:30] mundo virtual Omniverse, y la computadora que ejecuta Omniverse se llama OVX y OVX. La computadora en sí está alojada en la nube de Azure. Orador 2: El futuro de las industrias pesadas comienza como un gemelo digital. Los agentes de IA que ayudan a los robots, los trabajadores y la infraestructura a navegar por eventos impredecibles en espacios industriales complejos se construirán y evaluarán primero en sofisticados gemelos digitales. Orador 1: Una vez que conectas todo, es una locura [00:11:00] cuánta productividad puedes conseguir y es realmente maravilloso. De repente, todo el mundo opera sobre la misma verdad básica. No es necesario intercambiar datos y convertir datos, ni cometer errores. Todos trabajan en la misma base, desde el departamento de diseño hasta los departamentos de arte, el departamento de arquitectura, pasando por el departamento de ingeniería e incluso el departamento de marketing. Hoy anunciamos que omniverse Cloud se transmite a Vision Pro y [00:11:30] Es muy, muy extraño que caminas por puertas virtuales cuando yo salía de ese auto y todos lo hacen. Es realmente sorprendente que Vision Pro esté conectado a portales del omniverso, tú al Omniverso. Y debido a que todas estas herramientas CAD y todas estas diferentes herramientas de diseño ahora están integradas y conectadas a omniverse, puedes [00:12:00] Tener este tipo de flujo de trabajo es realmente increíble. Orador 3: Este es Nvidia Project Group, un modelo básico de propósito general para el aprendizaje de robots humanoides. El modelo de grupo toma instrucciones multimodales e interacciones pasadas como entrada y produce la siguiente acción que debe ejecutar el robot. Desarrollamos Isaac Lab, una aplicación de aprendizaje de robots [00:12:30] para entrenar valor en Omniverse Isaac Sim, y ampliamos con Osmo, un nuevo servicio de orquestación informática que coordina los flujos de trabajo entre sistemas DGX para capacitación y sistemas OVX para simulación. El modelo GR permitirá que un robot aprenda de un puñado de demostraciones humanas para que pueda ayudar con las tareas cotidianas y emular el movimiento humano con solo observarnos a todos. Esta increíble inteligencia [00:13:00] Está impulsado por los nuevos chips robóticos Jetson Thor diseñados para gr, construidos para el futuro con Isaac Lab, Osmo y Groot. Estamos proporcionando los componentes básicos para la próxima generación de robótica impulsada por IA. Orador 1: Acerca de [00:13:30] del mismo tamaño, el alma de Nvidia, la intersección de gráficos por computadora, física e inteligencia artificial. Todo se hizo realidad en este momento. El nombre de ese proyecto, Robótica general 0 0 3. Lo sé. Súper bien, súper [00:14:00] bien. Bueno, creo que tenemos algunos invitados especiales, ¿verdad? Hola chicos, entiendo que ustedes están impulsados por Jetson. Están impulsados por Supersónicos, pequeñas computadoras Jetson Robotics en su interior. [00:14:30] Aprendieron a caminar en Isaac Sim. Damas y caballeros, este es el Naranja y este es el famoso Verde. Son los robots BDX de Disney. Increíble investigación de Disney. Vamos chicos. Terminemos. Vamos cinco cosas. ¿Adónde vas? [00:15:00] Me siento aquí. No tengas miedo. Ven aquí, verde. Apresúrate. ¿Qué estás diciendo? No, no es hora de comer. No es hora de comer. Te daré un bocadillo en un momento. Déjame terminar muy rápido. Vamos verde. [00:15:30] Apresúrate. Perdiendo el tiempo. Esto es lo que les anunciamos hoy. Este es Blackwell. Se trata de procesadores, entornos, conmutadores de enlace, sistemas de red asombrosos y asombrosos, y el diseño del sistema es un milagro. Este es Blackwell, y así es como se ve una GPU en mi mente.