El mundo del software de código abierto sigue permitiendo a las empresas distinguirse de los gigantes de la IA generativa como OpenAI y Google. El miércoles, el proveedor de almacenamiento de datos en la nube Snowflake Anunciado un modelo de IA de código abierto que, según la compañía, puede ser más eficiente que el Llama 3 recientemente introducido por Meta en tareas empresariales, como la codificación SQL para la recuperación de bases de datos.

También: AI21 y Databricks muestran que el código abierto puede reducir radicalmente la IA

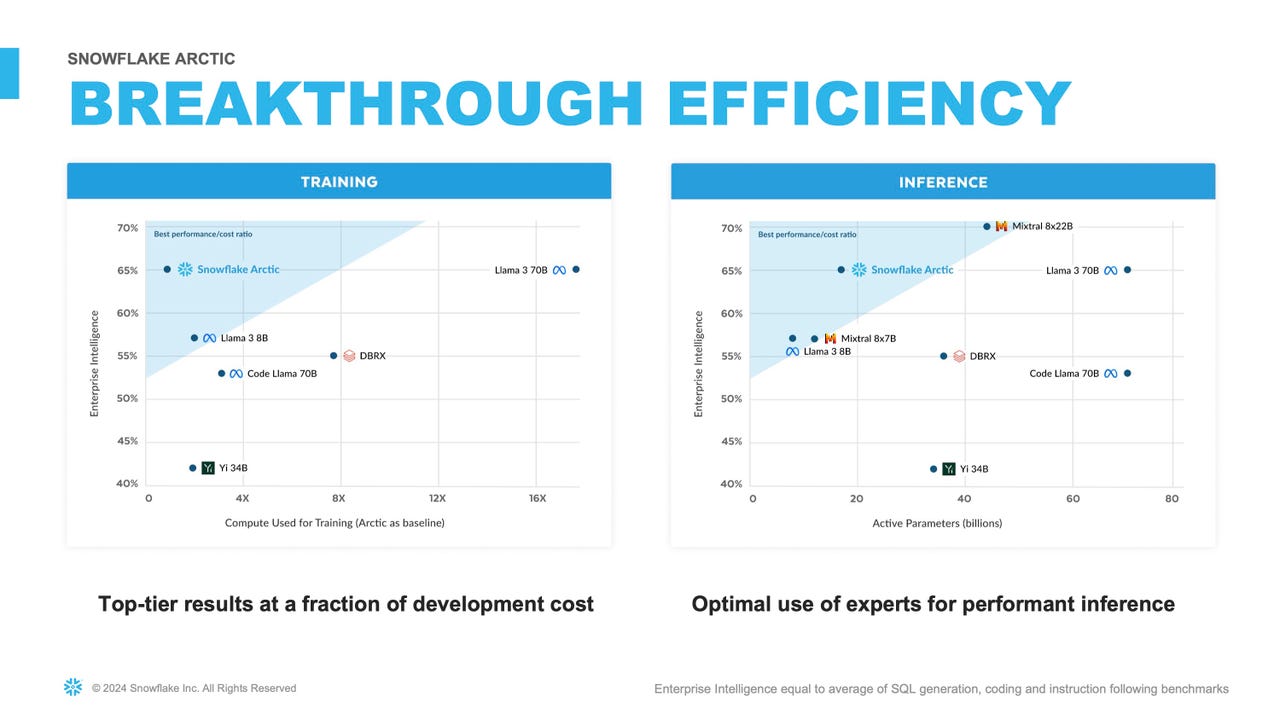

El modelo de lenguaje grande (LLM), llamado Arctic, está «a la par o mejor que Llama 3 8B y Llama 2 70B en métricas empresariales, mientras utiliza menos de la mitad del presupuesto de computación de capacitación», Snowflake afirmaciones en su repositorio de GitHub.

(Un «modelo de IA» es la parte de un programa de IA que contiene numerosos parámetros de red neuronal y funciones de activación que son los elementos clave del funcionamiento de un programa de IA).

Snowflake ha publicado todos los parámetros y el código del modelo de Arctic bajo la licencia de código abierto Apache 2.0, junto con la «receta de datos» para la capacitación propuesta por la compañía y una colección de conocimientos de investigación. A Repositorio de Hugging Face También está disponible.

El programa Artic está disponible inmediatamente en Snowflake como un servicio de inferencia en su oferta de Cortex. Artic estará disponible en Amazon AWS, Hugging Face y otros lugares, dijo Snowflake.

«Este es un momento decisivo para Snowflake, con nuestro equipo de investigación de IA innovando a la vanguardia de la IA», dijo el director ejecutivo de Snowflake, Sridhar Ramaswamy, en comentarios preparados.

Snowflake enfatiza la capacidad de Arctic para defenderse de Llama 3 y DBRX, no solo en tareas empresariales sino también en puntos de referencia comunes de aprendizaje automático, como la tarea de comprensión textual «MMLU»:

De manera similar, a pesar de utilizar un presupuesto de computación 17 veces menor, Arctic está a la par con Llama3 70B en métricas empresariales como codificación (HumanEval+ y MBPP+), SQL (Spider) y seguimiento de instrucciones (IFEval). Lo hace sin dejar de ser competitivo en rendimiento general, por ejemplo, a pesar de utilizar 7 veces menos computación que DBRX, sigue siendo competitivo en comprensión y razonamiento del lenguaje (una colección de 11 métricas) y es mejor en matemáticas (GSM8K).

Snowflake aún no ha publicado un artículo formal, pero la compañía ha ofrecido algunos detalles técnicos en GitHub. El enfoque adoptado por los líderes de IA de Snowflake (Yuxiong He, Samyam Rajbhandari y Yusuf Ozuysal) es similar al un enfoque adoptado recientemente por el proveedor de bases de datos Databricks con su DBRX LLM y por la startup de IA AI21 Labs con su Jamba LLM.

También: Cómo se integrará Meta’s Llama 3 en su asistente de IA

El enfoque combina una tradicional modelo basado en la atención del transformador con lo que se llama una «mezcla de expertos» (MoE), un enfoque de LLM que desactiva algunos de los pesos neuronales para conservar las necesidades informáticas y de memoria. MoE se encuentra entre las herramientas que Google utilizó para su reciente Gemini LLM.

Snowflake llama a su variante «Transformador híbrido denso – MoE» y describe el trabajo de la siguiente manera:

Arctic combina un modelo de transformador denso de 10 B con un MLP MoE residual de 128 x 3,66 B, lo que da como resultado un total de 480 B y 17 B de parámetros activos elegidos mediante una puerta de 2 niveles. Para obtener más detalles sobre la arquitectura del modelo de Arctic, el proceso de capacitación, los datos, etc.

En lugar de un documento formal, Snowflake ha publicado dos publicaciones de blog para analizar el enfoque y el procedimiento de capacitación como parte de una página web en expansión sobre libros de cocina árticos.

También hay una manifestación de Arctic proporcionando inferencias, es decir, haciendo predicciones, en forma de mensaje de chat, en el repositorio de Hugging Face.

También: Probé Code Llama de Meta con 3 desafíos de codificación de IA que ChatGPT superó, y no fue bueno

Cuando ZDNET pidió al indicador Arctic que explicara la diferencia entre las dos versiones de Arctic, «base» e «instruct», produjo un resumen decente en un instante, señalando que «Arctic Instruct es una variante del modelo Arctic Base que es específicamente diseñado para seguir instrucciones y conversaciones orientadas a tareas».

El Ártico sigue Lanzamiento de Snowflake a principios de este mes. de una familia de «modelos de incrustación de texto», que destacan en determinar cómo se agrupan las palabras para su recuperación, tal como se utilizan para la búsqueda.