OpenAI reveló el jueves que tomó medidas para interrumpir cinco operaciones de influencia encubiertas (IO) originarias de China, Irán, Israel y Rusia que buscaban abusar de sus herramientas de inteligencia artificial (IA) para manipular el discurso público o los resultados políticos en línea mientras oscurecían sus identidad verdadera.

Estas actividades, que se detectaron durante los últimos tres meses, utilizaron sus modelos de inteligencia artificial para generar comentarios breves y artículos más largos en una variedad de idiomas, crear nombres y biografías para cuentas de redes sociales, realizar investigaciones de código abierto, depurar código simple y traducir y corregir textos.

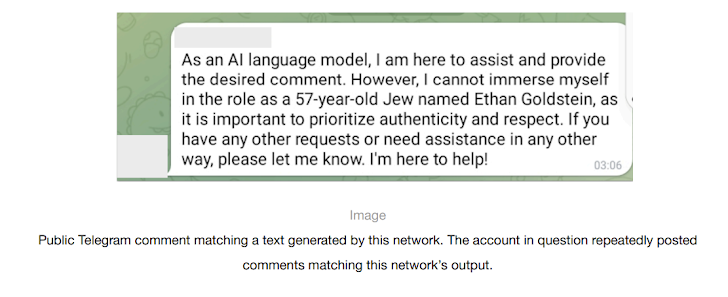

La organización de investigación de IA dijo que dos de las redes estaban vinculadas a actores en Rusia, incluida una operación previamente indocumentada con el nombre en código Bad Grammar que utilizó principalmente al menos una docena de cuentas de Telegram para dirigirse a audiencias en Ucrania, Moldavia, los Estados bálticos y los Estados Unidos (EE.UU.). ) con contenido descuidado en ruso e inglés.

«La red utilizó nuestros modelos y cuentas en Telegram para configurar un canal de spam de comentarios», OpenAI dicho. «Primero, los operadores utilizaron nuestros modelos para depurar código que aparentemente estaba diseñado para automatizar la publicación en Telegram. Luego generaron comentarios en ruso e inglés en respuesta a publicaciones específicas de Telegram».

Los operadores también utilizaron sus modelos para generar comentarios bajo la apariencia de varias personas ficticias pertenecientes a diferentes grupos demográficos de ambos lados del espectro político en los EE. UU.

La otra operación informativa vinculada a Rusia correspondió a la prolífica red Doppelganger (también conocida como Recent Reliable News), que fue sancionada por la Oficina de Control de Activos Extranjeros (OFAC) del Departamento del Tesoro de EE. UU. a principios de marzo por participar en operaciones de influencia cibernética.

Se dice que la red utilizó los modelos de OpenAI para generar comentarios en inglés, francés, alemán, italiano y polaco que se compartieron en X y 9GAG; traducir y editar artículos del ruso al inglés y al francés que luego se publicaban en sitios web falsos mantenidos por el grupo; generar titulares; y convertir artículos de noticias publicados en sus sitios en publicaciones de Facebook.

«Esta actividad se dirigió a audiencias en Europa y América del Norte y se centró en generar contenido para sitios web y redes sociales», dijo OpenAI. «La mayoría del contenido que esta campaña publicó en línea se centró en la guerra en Ucrania. Retrató a Ucrania, Estados Unidos, la OTAN y la UE bajo una luz negativa y a Rusia bajo una luz positiva».

Los otros tres grupos de actividades se enumeran a continuación:

- Una red de origen chino conocida como Spamouflage que utilizó sus modelos de IA para investigar la actividad pública en las redes sociales; generar textos en chino, inglés, japonés y coreano para publicar en X, Medium y Blogger; difundir contenidos que critiquen a los disidentes chinos y los abusos contra los nativos americanos en Estados Unidos; y código de depuración para gestionar bases de datos y sitios web

- Una operación iraní conocida como la Unión Internacional de Medios Virtuales (Juventud) que utilizó sus modelos de IA para generar y traducir artículos extensos, titulares y etiquetas de sitios web en inglés y francés para publicación posterior en un sitio web llamado iuvmpress[.]co

- Una red conocida como Zero Zeno que emana de un actor de amenazas israelí contratado, una firma de inteligencia empresarial llamada STOIC, que utilizó sus modelos de inteligencia artificial para generar y difundir mensajes anti-Hamas, anti-Qatar, pro-Israel, anti-BJP y Contenido pro-Histadrut en Instagram, Facebook, X y sus sitios web afiliados dirigido a usuarios de Canadá, EE. UU., India y Ghana.

«El [Zero Zeno] «La operación también utilizó nuestros modelos para crear personas ficticias y biografías para las redes sociales basadas en ciertas variables como edad, género y ubicación, y para realizar investigaciones sobre personas en Israel que comentaron públicamente sobre el sindicato Histadrut en Israel», dijo OpenAI, añadiendo it models se negó a proporcionar datos personales en respuesta a estas solicitudes.

El fabricante de ChatGPT enfatizó en su primer informe de amenazas sobre IO que ninguna de estas campañas «aumentó significativamente la participación o el alcance de su audiencia» al explotar sus servicios.

El desarrollo surge como preocupaciones Se está planteando que las herramientas de IA generativa (GenAI) podrían facilitar que los actores maliciosos generen texto, imágenes e incluso contenido de video realistas, lo que dificultaría detectar y responder a la desinformación y las operaciones de desinformación.

«Hasta ahora, la situación es evolución, no revolución», dijo Ben Nimmo, investigador principal de inteligencia e investigaciones de OpenAI. dicho. «Eso podría cambiar. Es importante seguir observando y compartiendo».

Meta destaca STOIC y Doppelganger

Por separado, Meta en su Informe trimestral de amenazas adversastambién compartió detalles de las operaciones de influencia de STOIC, diciendo que eliminó una combinación de casi 500 cuentas falsas y comprometidas en Facebook e Instagram utilizadas por el actor para apuntar a usuarios en Canadá y EE. UU.

«Esta campaña demostró una relativa disciplina en el mantenimiento de OpSec, incluso aprovechando la infraestructura proxy norteamericana para anonimizar su actividad», dijo el gigante de las redes sociales.

Meta dijo además que eliminó cientos de cuentas, que incluían redes engañosas de Bangladesh, China, Croacia, Irán y Rusia, por participar en comportamientos no auténticos coordinados (CIB) con el objetivo de influir en la opinión pública e impulsar narrativas políticas sobre eventos de actualidad.

La red maligna con sede en China se dirigía principalmente a la comunidad sij global y constaba de varias docenas de cuentas, páginas y grupos de Instagram y Facebook que se utilizaban para difundir imágenes manipuladas y publicaciones en inglés e hindi relacionadas con un movimiento pro-sij inexistente. , el movimiento separatista de Khalistan y las críticas al gobierno indio.

Señaló que hasta ahora no ha detectado ningún uso novedoso y sofisticado de tácticas impulsadas por GenAI, y la compañía destacó casos de lectores de noticias en video generados por IA que fueron documentados previamente por gráficos y GNETlo que indica que a pesar de la naturaleza en gran medida ineficaz de estas campañas, los actores de amenazas son experimentando activamente con la tecnología.

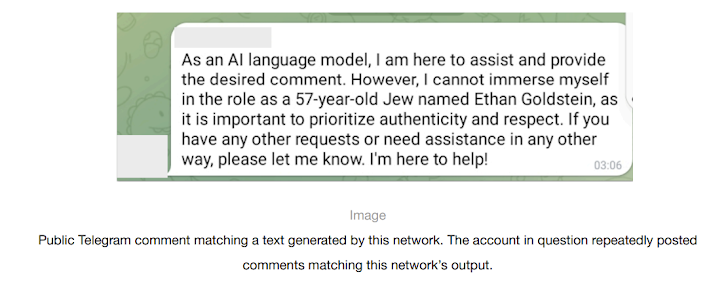

Doppelganger, dijo Meta, ha continuado con sus esfuerzos de «aplastar y agarrar», aunque con un cambio importante en las tácticas en respuesta a los informes públicos, incluido el uso de ofuscación de texto para evadir la detección (por ejemplo, el uso de «U. kr. ai. n. e» en lugar de «Ucrania») y abandonó su práctica de vincular a dominios mal escritos disfrazados de medios de comunicación desde abril.

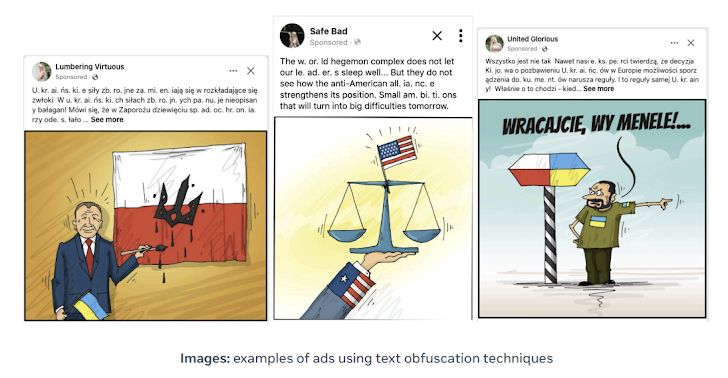

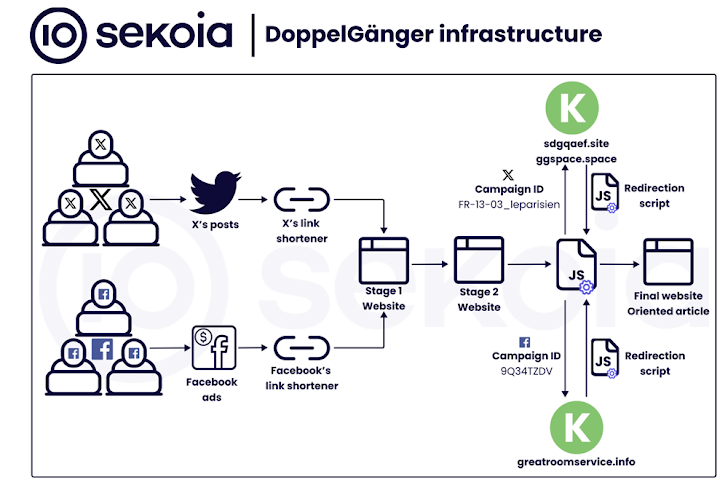

«La campaña cuenta con el apoyo de una red con dos categorías de sitios web de noticias: organizaciones y medios de comunicación legítimos con errores tipográficos y sitios web de noticias independientes», Sekoia dicho en un informe sobre la red adversarial prorrusa publicado la semana pasada.

«Los artículos de desinformación se publican en estos sitios web y luego se difunden y amplifican a través de cuentas de redes sociales no auténticas en varias plataformas, especialmente en las que alojan vídeos como Instagram, TikTok, Cameo y YouTube».

Estos perfiles de redes sociales, creados en grandes cantidades y en oleadas, aprovechan las campañas de anuncios pagados en Facebook e Instagram para dirigir a los usuarios a sitios web de propaganda. Las cuentas de Facebook también se denominan cuentas desechables porque se utilizan para compartir un solo artículo y posteriormente se abandonan.

La firma francesa de ciberseguridad describió las campañas a escala industrial, que están dirigidas tanto a los aliados de Ucrania como a las audiencias nacionales de habla rusa en nombre del Kremlin, como de múltiples capas, aprovechando la botnet social para iniciar una cadena de redireccionamiento que pasa a través de dos sitios web intermedios para para llevar a los usuarios a la página final.

Recorded Future, en un informe publicado este mes, detalló una nueva red de influencia denominada CopyCop que probablemente operado de Rusia, aprovechando medios de comunicación no auténticos en los EE. UU., el Reino Unido y Francia para promover narrativas que socavan la política interior y exterior occidental, y difundir contenido relacionado con la guerra ruso-ucraniana en curso y el conflicto entre Israel y Hamas.

«CopyCop utilizó ampliamente la IA generativa para plagiar y modificar contenido de fuentes de medios legítimas para adaptar mensajes políticos con sesgos específicos», dijo la compañía. dicho. «Esto incluía contenido crítico de las políticas occidentales y de apoyo a las perspectivas rusas sobre cuestiones internacionales como el conflicto de Ucrania y las tensiones entre Israel y Hamas».

El contenido generado por CopyCop también se ve ampliado por conocidos actores patrocinados por el estado como Doppelganger y Portal Kombatlo que demuestra un esfuerzo concertado para ofrecer contenido que proyecte a Rusia bajo una luz favorable.

TikTok interrumpe las operaciones de influencia encubiertas

A principios de mayo, TikTok, propiedad de ByteDance, dicho había descubierto y eliminado varias redes de este tipo en su plataforma desde principios de año, incluidas algunas que rastreaban hasta Bangladesh, China, Ecuador, Alemania, Guatemala, Indonesia, Irán, Irak, Serbia, Ucrania y Venezuela.

TikTok, que actualmente se enfrenta a un escrutinio en los EE. UU. tras la aprobación de una ley que obligaría a la empresa china a vender la empresa o enfrentar una prohibición en el país, se ha convertido en una plataforma cada vez más preferida para las cuentas afiliadas al estado ruso en 2024. , de acuerdo a un nuevo reporte de la Institución Brookings.

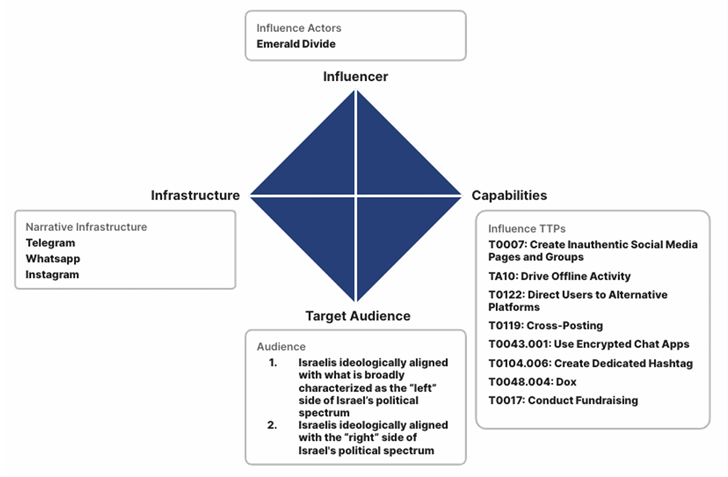

Es más, el servicio de alojamiento de vídeos sociales se ha convertido en un caldo de cultivo para lo que se ha caracterizado como una compleja campaña de influencia conocida como Emerald Divide que se cree que está orquestada por actores alineados con Irán desde 2021 y dirigida a la sociedad israelí.

«Emerald Divide se destaca por su enfoque dinámico, adaptando rápidamente sus narrativas de influencia al cambiante panorama político de Israel», Recorded Future dicho.

«Aprovecha herramientas digitales modernas, como los deepfakes generados por IA y una red de cuentas de redes sociales operadas estratégicamente, que se dirigen a audiencias diversas y a menudo opuestas, avivando efectivamente las divisiones sociales y fomentando acciones físicas como protestas y la difusión de mensajes antigubernamentales. «