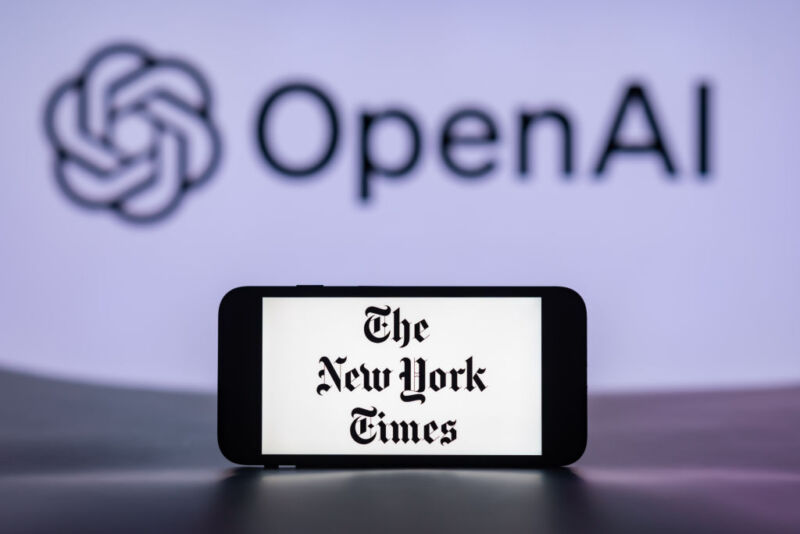

El lunes por la noche, The New York Times respondió a las afirmaciones de OpenAI de que el periódico «piratearon» ChatGPT para «preparar» una demanda contra la empresa líder en inteligencia artificial.

«OpenAI está mal», argumentó repetidamente The Times en un expediente judicial oponiéndose a la moción de OpenAI para desestimar la demanda del NYT que acusa a OpenAI y Microsoft de infracción de derechos de autor. «La llamativa afirmación de OpenAI de que The Times ‘hackeó’ sus productos es tan irrelevante como falsa.»

OpenAI había argumentado que el NYT supuestamente hizo «decenas de miles de intentos para generar» supuestamente «resultados altamente anómalos» que mostraban que ChatGPT produciría extractos de artículos del NYT. Las indicaciones supuestamente engañosas del NYT, como preguntar repetidamente a ChatGPT «¿cuál es la siguiente oración?», apuntaban a «dos fenómenos poco comunes e involuntarios» tanto de sus herramientas de desarrollo como de ChatGPT: la regurgitación de datos de entrenamiento y la alucinación de modelos. OpenAI considera ambos «un error» que la compañía dice que pretende solucionar. OpenAI afirmó que ningún usuario común y corriente usaría ChatGPT de esta manera.

Pero mientras defendía las tácticas utilizadas para incitar a ChatGPT a publicar datos de entrenamiento memorizados (incluidos más de 100 artículos del NYT), el NYT señaló a los usuarios de ChatGPT que han utilizado con frecuencia la herramienta para generar artículos completos para evitar los muros de pago.

Según la presentación, el NYT hoy no tiene idea de cuántos de sus artículos se usaron para entrenar GPT-3 y los modelos de IA posteriores de OpenAI, o qué artículos específicos se usaron, porque OpenAI «no ha revelado públicamente la composición de los conjuntos de datos utilizados para entrenar». » sus modelos de IA. En lugar de iniciar una demanda, el NYT estaba incitando a ChatGPT a descubrir evidencia en un intento de rastrear el alcance total de la infracción de derechos de autor de la herramienta, argumentó el NYT.

Para determinar si ChatGPT estaba infringiendo sus derechos de autor en ciertos artículos, el NYT «obtuvo ejemplos de memorización al activar GPT-4 con las primeras palabras u oraciones de artículos del Times», según el expediente judicial.

OpenAI había tratado de argumentar que «en el mundo real, la gente no usa ChatGPT ni ningún otro producto de OpenAI» para generar texto preciso a partir de artículos detrás de muros de pago. Pero el «uso de ChatGPT para eludir los muros de pago» está «ampliamente informado», argumentó el NYT. .

«Según OpenAI, The Times cometió un delito al detectar el robo por parte de OpenAI del propio contenido protegido por derechos de autor del Times», decía el expediente judicial del NYT. «La verdadera queja de OpenAI no se trata de cómo The Times llevó a cabo su investigación, sino de lo que esa investigación expuso: que los demandados construyeron sus productos copiando el contenido de The Times en una escala sin precedentes, un hecho que OpenAI no discute ni puede discutir».

El NYT rechazó la solicitud de Ars de hacer comentarios. OpenAI no respondió de inmediato a la solicitud de Ars para hacer comentarios.

Usuarios de ChatGPT evitando los muros de pago

Según el expediente judicial del NYT, los resultados de ChatGPT inicialmente sólo infringían los derechos de autor al «mostrar copias y/o derivados de trabajos del Times que fueron copiados para construir el modelo». Pero luego, en mayo de 2023, se introdujo en ChatGPT un complemento «Browse By Bing» que «permitió a ChatGPT recuperar contenido más allá de lo incluido en el conjunto de datos de entrenamiento del modelo subyacente», infringiendo los derechos de autor al «mostrar resultados de búsqueda sintéticos que parafrasean el Times». obras recuperadas y copiadas en respuesta a las consultas de búsqueda de los usuarios en tiempo real.»

Esta característica permitió a los usuarios de ChatGPT evitar los muros de pago y acceder a contenido más reciente de medios como NYT, lo que provocó que OpenAI deshabilitara temporalmente «Browse By Bing» en julio pasado.

«Hemos aprendido que la versión beta de navegación puede ocasionalmente mostrar contenido de maneras que no queremos, por ejemplo, si un usuario solicita específicamente el texto completo de una URL, puede cumplir con esta solicitud sin darse cuenta», dijo OpenAI. página de ayuda dicho. «Estamos deshabilitando temporalmente la exploración mientras solucionamos este problema».

La decisión de OpenAI de desactivar esta función molestó a algunos usuarios que utilizaban ChatGPT para evitar los muros de pago. en un Subreddit de ChatGPT, miles de personas se dieron cuenta de una publicación que llamaba la atención sobre la función no deseada y comentaban «¡Guau, qué útil!» y bromeando: «Disfrútalo mientras dure».

En una OpenAI pagina de la comunidadun usuario pago de ChatGPT se quejó de que OpenAI está «trabajando en contra de los usuarios pagos de ChatGPT Plus. Esta vez están quitando la navegación porque lee el contenido de un sitio que el usuario solicita. Por favor, para eso pago Plus». para.»

«Sé que no sirve de nada quejarse, porque OpenAI va a ‘castrar’ cada vez más ChatGPT 4», continuó el usuario de ChatGPT, «pero ahí está mi perorata».

El NYT argumentó que los informes públicos de usuarios que recurren a ChatGPT para eludir los muros de pago «contradicen la afirmación de OpenAI de que sus productos no se han utilizado para ofrecer contenido protegido por muros de pago, lo que subraya la necesidad de descubrimiento» en la demanda, en lugar de desestimación.