Una patata caliente: Los modelos de IA generativa deben entrenarse con una cantidad excesiva de material fuente antes de que estén listos para el horario de máxima audiencia, y eso puede ser un problema para los profesionales creativos que no quieren que los modelos aprendan sobre su contenido. Gracias a una nueva herramienta de software, los artistas visuales ahora tienen otra forma de decir «no» a la máquina de alimentación de IA.

Hierba mora se introdujo inicialmente en octubre de 2023 como una herramienta para desafiar grandes modelos de IA generativa. Creado por investigadores de la Universidad de Chicago, Nightshade es una herramienta «ofensiva» que puede proteger el trabajo de artistas y creadores «envenenando» una imagen y haciéndola inadecuada para el entrenamiento de IA. El programa ahora está disponible para que cualquiera lo pruebe, pero probablemente no será suficiente para revolucionar el negocio moderno de la IA.

Las imágenes procesadas con Nightshade pueden hacer que los modelos de IA muestren un comportamiento impredecible, según los investigadores dicho, como generar una imagen de un bolso flotante para un mensaje que solicitaba una imagen de una vaca volando en el espacio. Nightshade puede disuadir a los entrenadores de modelos y a las empresas de inteligencia artificial que no respetan los derechos de autor, las listas de exclusión voluntaria y las directivas de no raspar en robots.txt.

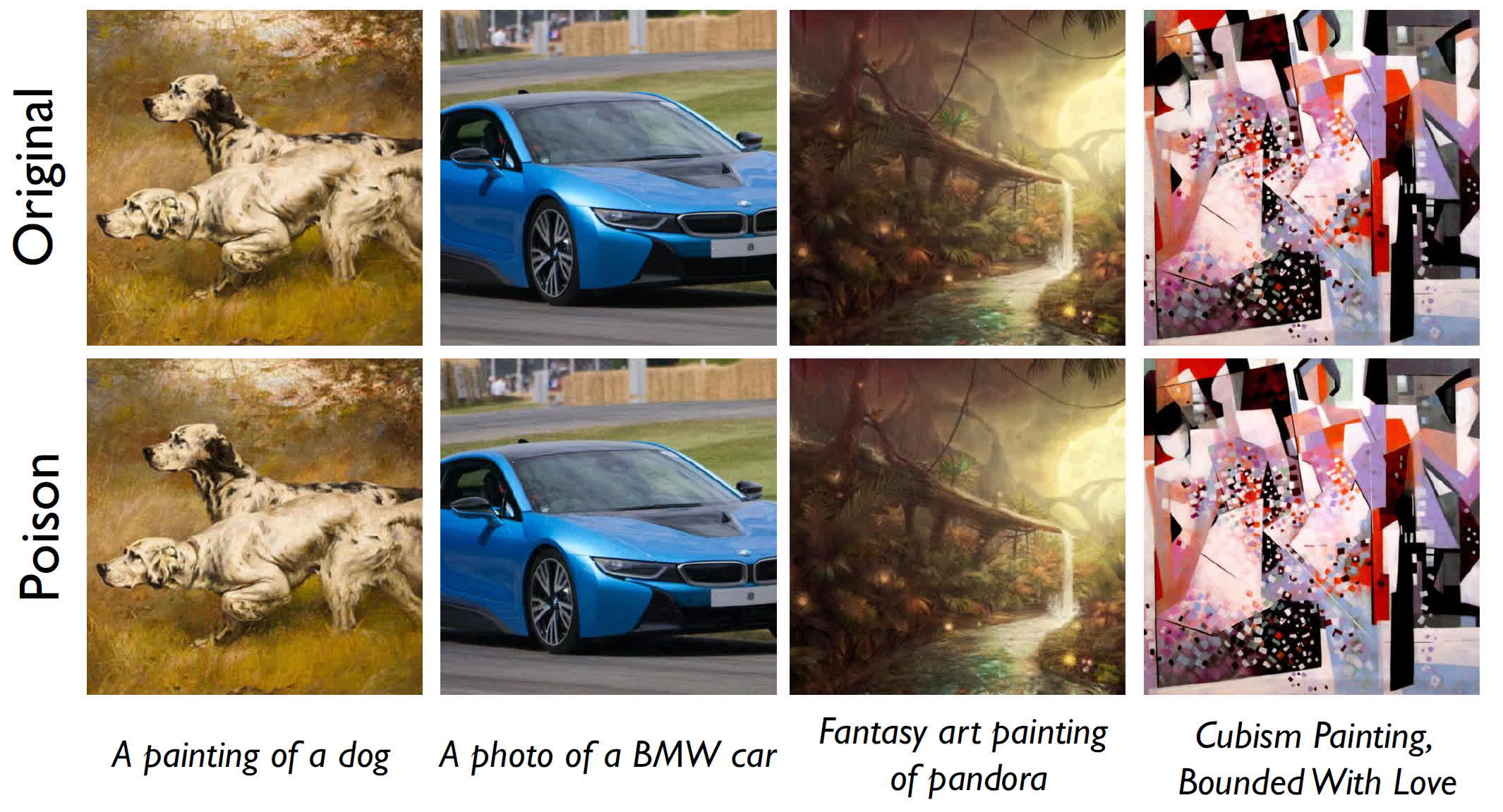

Nightshade se calcula como una «optimización multiobjetivo que minimiza los cambios visibles en la imagen original», dijeron los investigadores. Mientras que los humanos ven una imagen sombreada que prácticamente no ha cambiado con respecto a la obra de arte original, un modelo de IA percibiría una composición muy diferente. Los modelos de IA entrenados con imágenes envenenadas con Nightshade generarían una imagen que se asemeja a un «perro» a partir de un mensaje que pregunta por un gato. Los resultados impredecibles podrían hacer que la capacitación con imágenes infectadas sea menos útil y podrían incitar a las empresas de inteligencia artificial a capacitarse exclusivamente con contenido gratuito o con licencia.

Los investigadores dijeron que una imagen sombreada de una vaca en un campo verde se puede transformar en lo que los algoritmos de IA interpretarán como un gran bolso de cuero tirado en la hierba. Si los artistas proporcionan suficientes imágenes sombreadas de una vaca al algoritmo, un modelo de IA comenzará a generar imágenes de asas de cuero, bolsillos laterales con cremallera y otras composiciones no relacionadas para indicaciones centradas en la vaca.

Las imágenes procesadas a través de Nightshade son lo suficientemente robustas como para sobrevivir a la manipulación tradicional de imágenes, incluido el recorte, la compresión, el ruido o el suavizado de píxeles. Nightshade puede trabajar junto con Glaze, otra herramienta diseñada por investigadores de la Universidad de Chicago, para interrumpir aún más el abuso de contenido.

Glaze ofrece un enfoque «defensivo» contra el envenenamiento del contenido y puede ser utilizado por artistas individuales para proteger sus creaciones contra «ataques de imitación de estilo», explicaron los investigadores. Por el contrario, Nightshade es una herramienta ofensiva que funciona mejor si un grupo de artistas se unen para intentar alterar un modelo de IA conocido por extraer sus imágenes sin consentimiento.

El equipo de Nightshade ha lanzado el primera versión pública de la aplicación homónima de envenenamiento por IA. Los investigadores todavía están probando cómo interactúan sus dos herramientas al procesar la misma imagen y eventualmente combinarán los dos enfoques convirtiendo Nightshade en un complemento para Webglaze.