Una coalición de 20 empresas tecnológicas firmado un acuerdo el viernes para ayudar a prevenir falsificaciones de IA en las críticas elecciones de 2024 que se llevarán a cabo en más de 40 países. OpenAI, Google, Meta, Amazon, Adobe y X se encuentran entre las empresas que se unen al pacto para prevenir y combatir el contenido generado por IA que podría influir en los votantes. Sin embargo, el lenguaje vago del acuerdo y la falta de aplicación vinculante ponen en duda si va lo suficientemente lejos.

La lista de empresas que firman el “Acuerdo tecnológico para combatir el uso engañoso de la IA en las elecciones de 2024” incluye aquellas que crean y distribuyen modelos de IA, así como plataformas sociales donde es más probable que aparezcan los deepfakes. Los firmantes son Adobe, Amazon, Anthropic, Arm, ElevenLabs, Google, IBM, Inflection AI, LinkedIn, McAfee, Meta, Microsoft, Nota, OpenAI, Snap Inc., Stability AI, TikTok, Trend Micro, Truepic y X (anteriormente Twitter). ).

El grupo describe el acuerdo como “un conjunto de compromisos para implementar tecnología que contrarreste el contenido dañino generado por IA destinado a engañar a los votantes”. Los firmantes han acordado los siguientes ocho compromisos:

-

Desarrollar e implementar tecnología para mitigar los riesgos relacionados con el contenido electoral engañoso de IA, incluidas herramientas de código abierto cuando corresponda.

-

Evaluar los modelos dentro del alcance de este acuerdo para comprender los riesgos que pueden presentar con respecto al contenido electoral engañoso de IA.

-

Buscando detectar la distribución de este contenido en sus plataformas

-

Buscando abordar adecuadamente estos contenidos detectados en sus plataformas.

-

Fomentar la resiliencia intersectorial ante el contenido electoral engañoso de la IA

-

Proporcionar transparencia al público sobre cómo la empresa lo aborda.

-

Continuar colaborando con un conjunto diverso de organizaciones de la sociedad civil global y académicos.

-

Apoyar los esfuerzos para fomentar la conciencia pública, la alfabetización mediática y la resiliencia de toda la sociedad.

El acuerdo se aplicará al audio, vídeo e imágenes generados por IA. Aborda el contenido que “falsifica o altera engañosamente la apariencia, la voz o las acciones de candidatos políticos, funcionarios electorales y otras partes interesadas clave en una elección democrática, o que proporciona información falsa a los votantes sobre cuándo, dónde y cómo pueden votar. «

Los firmantes dicen que trabajarán juntos para crear y compartir herramientas para detectar y abordar la distribución en línea de deepfakes. Además, prevén impulsar campañas educativas y “aportar transparencia” a los usuarios.

OpenAI, uno de los firmantes, ya dijo el mes pasado que Planes para suprimir la información errónea relacionada con las elecciones. mundial. Imágenes generadas con la empresa. DE-E 3 La herramienta se codificará con un clasificador que proporcionará una marca de agua digital para aclarar su origen como imágenes generadas por IA. El ChatGPT El fabricante dijo que también trabajaría con periodistas, investigadores y plataformas para obtener comentarios sobre su clasificador de procedencia. También planea evitar que los chatbots se hagan pasar por candidatos.

«Estamos comprometidos a proteger la integridad de las elecciones aplicando políticas que prevengan el abuso y mejoren la transparencia en torno al contenido generado por IA», escribió Anna Makanju, vicepresidenta de Asuntos Globales de OpenAI, en el comunicado de prensa conjunto del grupo. «Esperamos trabajar con socios de la industria, líderes de la sociedad civil y gobiernos de todo el mundo para ayudar a proteger las elecciones del uso engañoso de la IA».

Notablemente ausente de la lista está Midjourney, la compañía con un generador de imágenes de IA (del mismo nombre) que actualmente produce algunas de las fotos falsas más convincentes. Sin embargo, la compañía dijo a principios de este mes que considerar prohibir por completo las generaciones políticas durante la temporada electoral. El año pasado, Midjourney estaba acostumbrado a Crean una imagen falsa viral del Papa Benedicto inesperadamente pavoneándose por la calle con una chaqueta blanca abullonada. Uno de los competidores más cercanos de Midjourney, Stability AI (creadores del software de código abierto Difusión estable), sí participó. Engadget se comunicó con Midjourney para comentar sobre su ausencia y actualizaremos este artículo si recibimos una respuesta.

Sólo Apple está ausente entre los «cinco grandes» de Silicon Valley. Sin embargo, esto puede explicarse por el hecho de que el fabricante del iPhone aún no ha lanzado ningún producto de IA generativa ni alberga una plataforma de redes sociales donde se puedan distribuir deepfakes. De todos modos, nos comunicamos con Apple PR para obtener una aclaración, pero no habíamos recibido respuesta al momento de la publicación.

Aunque los principios generales que acordaron las 20 empresas suenan como un comienzo prometedor, queda por ver si un conjunto flexible de acuerdos sin aplicación vinculante será suficiente para combatir un escenario de pesadilla en el que los malos actores del mundo utilizan la IA generativa para influir en la opinión pública y elegir candidatos agresivamente antidemocráticos, en Estados Unidos y en otros lugares.

«El lenguaje no es tan fuerte como cabría esperar», dijo Rachel Orey, directora asociada principal del Proyecto Electoral del Centro de Política Bipartidista. dijo La Prensa Asociada el viernes. “Creo que deberíamos dar crédito a quien lo merece y reconocer que las empresas tienen un interés personal en que sus herramientas no se utilicen para socavar elecciones libres y justas. Dicho esto, es voluntario y estaremos atentos a si lo cumplen”.

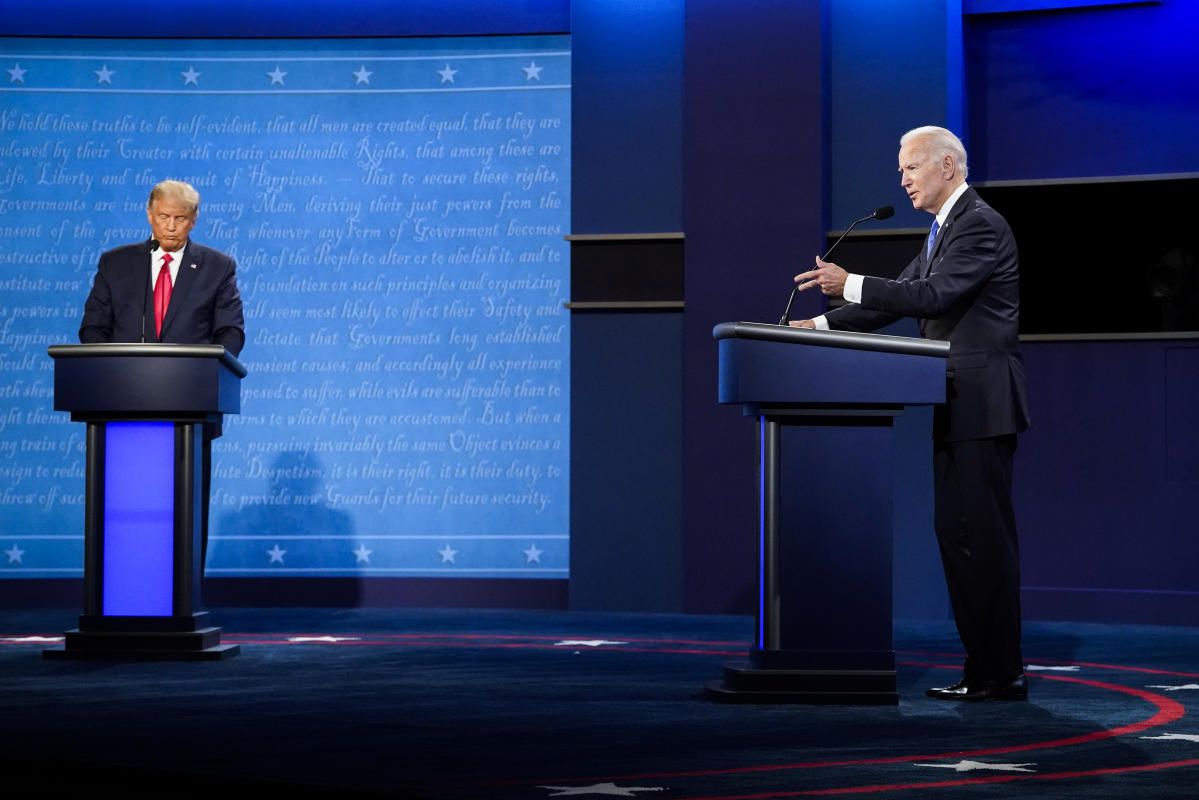

Los deepfakes generados por IA ya se utilizaron en las elecciones presidenciales de Estados Unidos. Ya en abril de 2023, el Comité Nacional Republicano (RNC) publicó un anuncio utilizando imágenes generadas por IA del presidente Joe Biden y la vicepresidenta Kamala Harris. La campaña de Ron DeSantis, quien desde entonces abandonó las primarias del Partido Republicano, siguió con Imágenes generadas por IA del rival y probable candidato Donald Trump en junio de 2023. Ambos incluían descargos de responsabilidad fáciles de pasar por alto de que las imágenes fueron generadas por IA.

En enero, un Deepfake generado por IA de la voz del presidente Biden fue utilizado por dos empresas con sede en Texas para realizar llamadas automáticas a los votantes de New Hampshire, instándolos a no votar en las primarias del estado el 23 de enero. El clip, generado utilizando la herramienta de clonación de voz de ElevenLabs, llegó a 25.000 votantes de NH, según el fiscal general del estado. ElevenLabs se encuentra entre los firmantes del pacto.

La Comisión Federal de Comunicaciones (FCC) actuó rápidamente para evitar nuevos abusos de la tecnología de clonación de voz en llamadas de campaña falsas. A principios de este mes, votó por unanimidad para prohibir las llamadas automáticas generadas por IA. El Congreso de los Estados Unidos (aparentemente eternamente estancado) no ha aprobado ninguna legislación sobre IA. En diciembre, la Unión Europea (UE) acordó un amplio proyecto de ley de desarrollo de seguridad de la Ley de IA que podrían influir en los esfuerzos regulatorios de otras naciones.

«A medida que la sociedad acepta los beneficios de la IA, tenemos la responsabilidad de ayudar a garantizar que estas herramientas no se conviertan en armas en las elecciones», escribió el vicepresidente y presidente de Microsoft, Brad Smith, en un comunicado de prensa. «La IA no creó el engaño electoral, pero debemos asegurarnos de que no contribuya a que el engaño florezca».