En breve: Rusia vuelve a realizar campañas en línea en un intento de manipular las elecciones presidenciales en Estados Unidos, aunque a un ritmo más lento que el que vimos en elecciones anteriores. Microsoft escribe que el país intenta principalmente socavar el apoyo a Ucrania y la OTAN entre el público estadounidense.

La campaña rusa de influencia electoral en Estados Unidos ha acelerado su ritmo en los últimos dos meses. escribe Microsoft, pero la temporada primaria menos disputada significa que no ha sido tan intensa como en 2016 y 2020.

El objetivo principal de Rusia en su campaña es difundir el apoyo a su guerra en Ucrania a través de la desinformación, reducir el apoyo a la OTAN y provocar luchas internas dentro de Estados Unidos, utilizando los medios tradicionales y sociales y una combinación de campañas encubiertas y abiertas.

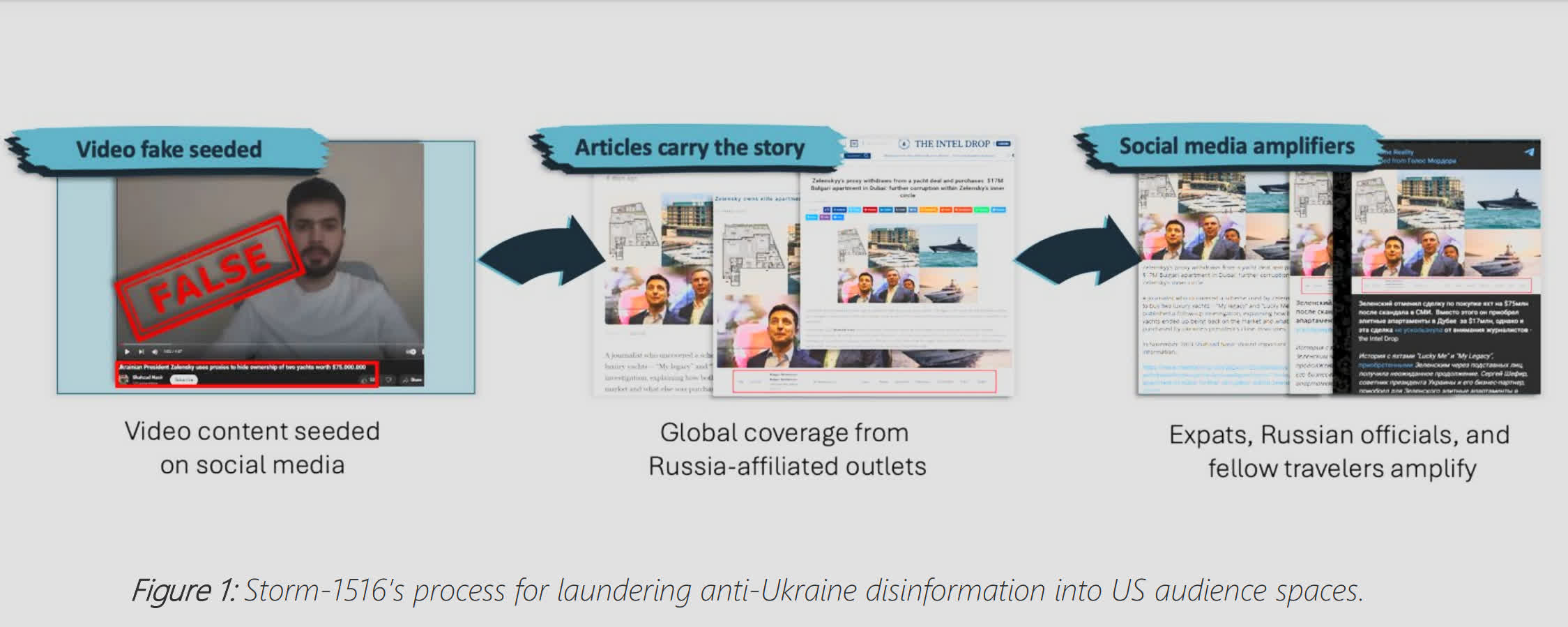

Microsoft escribe que el grupo Storm-1516, afiliado a Rusia, impulsa un mensaje anti-Ucrania al crear un video de alguien que se presenta como denunciante o periodista ciudadano difundiendo una narrativa positiva para Rusia sobre la guerra. Luego, el video es cubierto por una red global aparentemente no afiliada de sitios web administrados de manera encubierta, incluidos DC Weekly y The Intel Drop, antes de ser amplificado por expatriados, funcionarios y compañeros de viaje rusos. Luego, el público estadounidense repite y vuelve a publicar la desinformación, probablemente sin conocer su fuente.

Otro grupo destacado por Microsoft es Star Blizzard, también conocido como Cold River. Se centra en los think tanks occidentales y, si bien todavía no tiene conexión con las elecciones de 2024, su enfoque en figuras políticas estadounidenses puede ser la primera de una serie de campañas de piratería diseñadas para impulsar resultados favorables al Kremlin de cara a noviembre.

Ha habido muchas preocupaciones sobre el uso de IA avanzada por parte de adversarios extranjeros para influir en las elecciones estadounidenses. Microsoft dijo que hasta ahora no se ha observado el uso generalizado de videos deepfaked, pero que es probable que el contenido falso de audio mejorado con IA tenga más éxito.

Microsoft escribe que el contenido mejorado con IA es más influyente que el contenido totalmente generado por IA, el audio con IA tiene más impacto que el video con IA y el contenido falso que pretende provenir de un entorno privado, como una llamada telefónica, es más efectivo que el contenido falso de un entorno público. . La empresa añade que las personificaciones de personas menos conocidas funcionan mejor que las de personas conocidas, como los líderes mundiales.

Ya hemos visto ejemplos de audio falso utilizado para influir en las personas. Un 39 segundos llamada automática En enero se dirigió a los votantes de New Hampshire diciéndoles que no votaran en las elecciones primarias demócratas, sino que «guardaran sus votos» para las elecciones presidenciales de noviembre. La voz que daba este consejo era un modelo generado por IA que sonaba casi exactamente como Joe Biden. Llevó a la FCC a realizar llamadas automáticas generadas por IA ilegal y Biden pidiendo una prohibición sobre imitaciones de voz de IA.

No es sólo Rusia la que busca perturbar e influir en las elecciones estadounidenses utilizando la IA. microsoft prevenido A principios de este mes, las campañas chinas continuaron perfeccionando el contenido generado o mejorado por IA, creando videos, memes y audio, entre otros, para crear publicaciones en las redes sociales centradas en temas políticamente divisivos.

En febrero, 20 empresas importantes, incluidas Amazon, Google, Meta y X, firmaron un acuerdo comprometiéndose a erradicar el contenido de IA generativa y deepfake diseñado para influir o interferir con el derecho democrático de los ciudadanos al voto.