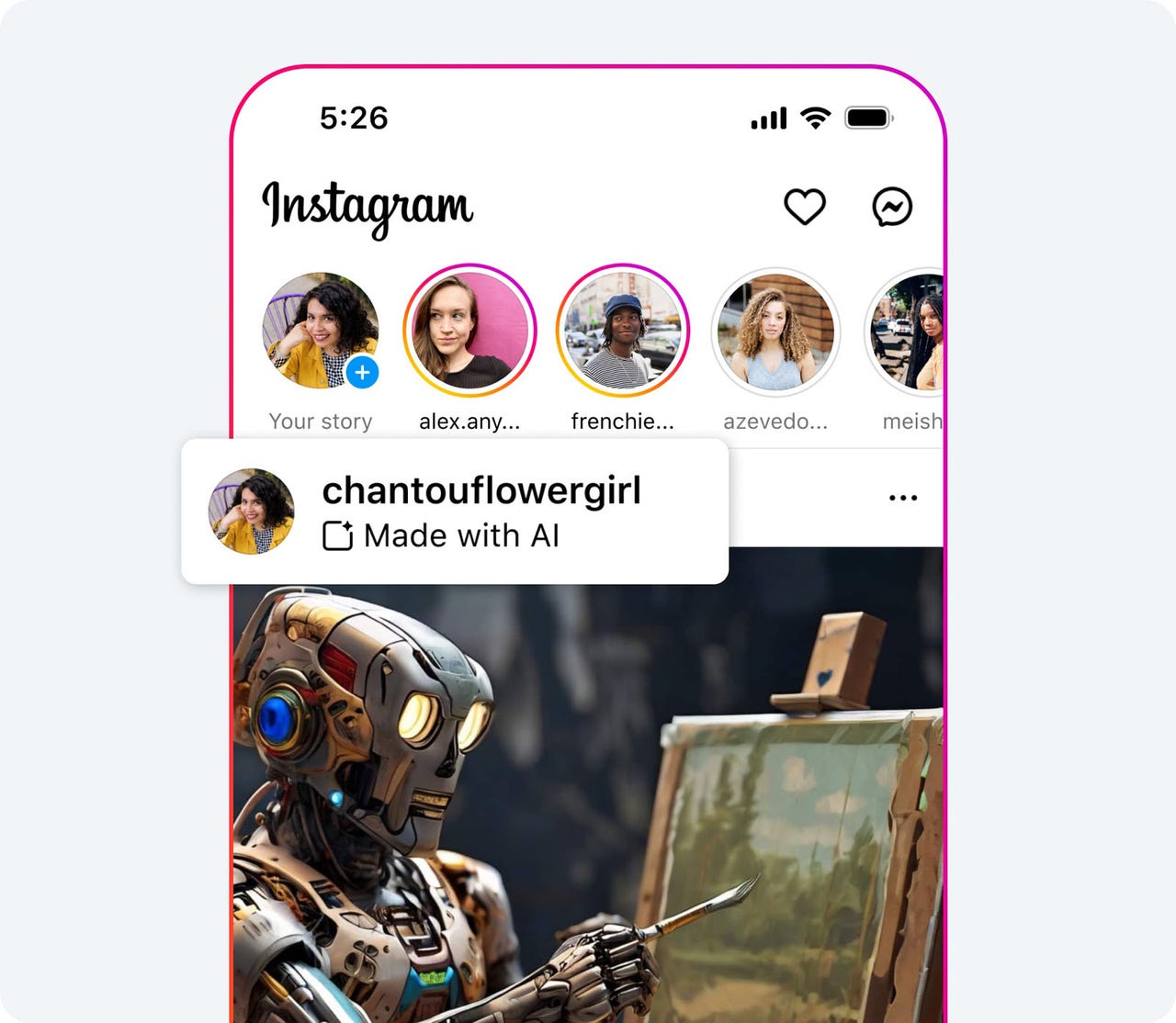

En febrero, Meta anunció planes para agregar nuevas etiquetas en Instagram, Facebook y Threads. para indicar cuándo una imagen fue generada por IA. Ahora, utilizando estándares técnicos creados por la empresa y los socios de la industria, Meta planea aplicar sus etiquetas «Hecho con IA» a videos, imágenes y clips de audio generados por IA, basándose en ciertas señales compartidas por la industria. (La compañía ya agrega una etiqueta «Imaginado con IA» a las imágenes fotorrealistas creadas con sus propias herramientas de IA).

en un entrada de blog publicada el viernesMeta anunció planes para comenzar a etiquetar contenido generado por IA en mayo de 2024 y dejar de eliminarlo automáticamente en julio de 2024. En el pasado, la compañía confiaba en su política de medios manipulados para determinar si las imágenes y videos creados por IA deben eliminarse o no. Meta explicó que el cambio surge de la retroalimentación de su Junta de Supervisión, así como de encuestas de opinión pública y consultas con académicos y otros expertos.

«Si determinamos que las imágenes, videos o audios creados o alterados digitalmente crean un riesgo particularmente alto de engañar materialmente al público en un asunto de importancia, podemos agregar una etiqueta más destacada para que las personas tengan más información y contexto», dijo Meta. en la publicación de su blog. «Este enfoque general brinda a las personas más información sobre el contenido para que puedan evaluarlo mejor y tener contexto si ven el mismo contenido en otro lugar».

También: Probé Code Llama de Meta con 3 desafíos de codificación de IA que ChatGPT superó, y no fue bueno

meta Junta de Supervisiónque era establecido en 2020 Al revisar las políticas de moderación de contenido de la empresa, descubrió que el enfoque de moderación de IA existente de Meta es demasiado limitado. Escrita en 2020, cuando el contenido generado por IA era relativamente raro, la política cubría solo videos creados o modificados por IA para que pareciera que una persona dijo algo que no dijo. Dados los recientes avances en la IA generativa, la junta dijo que la política ahora también debe cubrir cualquier tipo de manipulación que muestre a alguien haciendo algo que no hizo.

Además, la junta sostiene que eliminar medios manipulados por IA que de otro modo no violen los derechos de Meta Estándares comunitarios podría restringir la libertad de expresión. Como tal, la junta recomendó un enfoque menos restrictivo en el que Meta etiquetaría los medios como generados por IA pero aún permitiría a los usuarios verlos.

Meta y otras empresas se han enfrentado a quejas de que la industria no ha hecho lo suficiente para frenar la difusión de noticias falsas. El uso de medios manipulados es especialmente preocupante ahora que Estados Unidos y muchos otros países están celebrando elecciones en 2024 en las que los vídeos e imágenes de los candidatos pueden ser fácilmente falsificados.

«Queremos ayudar a la gente a saber cuándo se han creado o editado imágenes fotorrealistas utilizando IA, por lo que continuaremos colaborando con pares de la industria a través de foros como el Asociación sobre IA y permanecer en un diálogo con los gobiernos y la sociedad civil, y continuaremos revisando nuestro enfoque a medida que avance la tecnología», añadió Meta en su publicación.