Una patata caliente: A medida que la IA generativa se vuelve cada vez más avanzada y accesible, aparecen más imágenes falsas en las redes sociales junto con afirmaciones de que son auténticas. Meta dice que combatirá este problema detectando y etiquetando imágenes de IA publicadas en sus plataformas (Facebook, Instagram y Threads) incluso cuando sean creadas por servicios rivales.

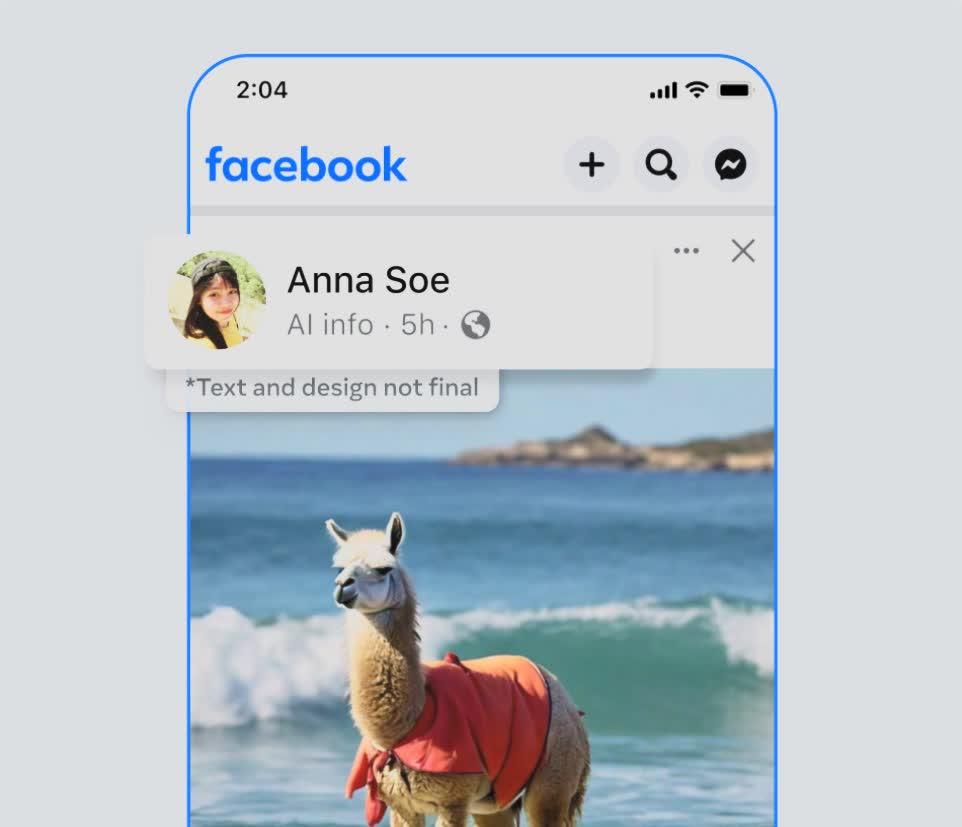

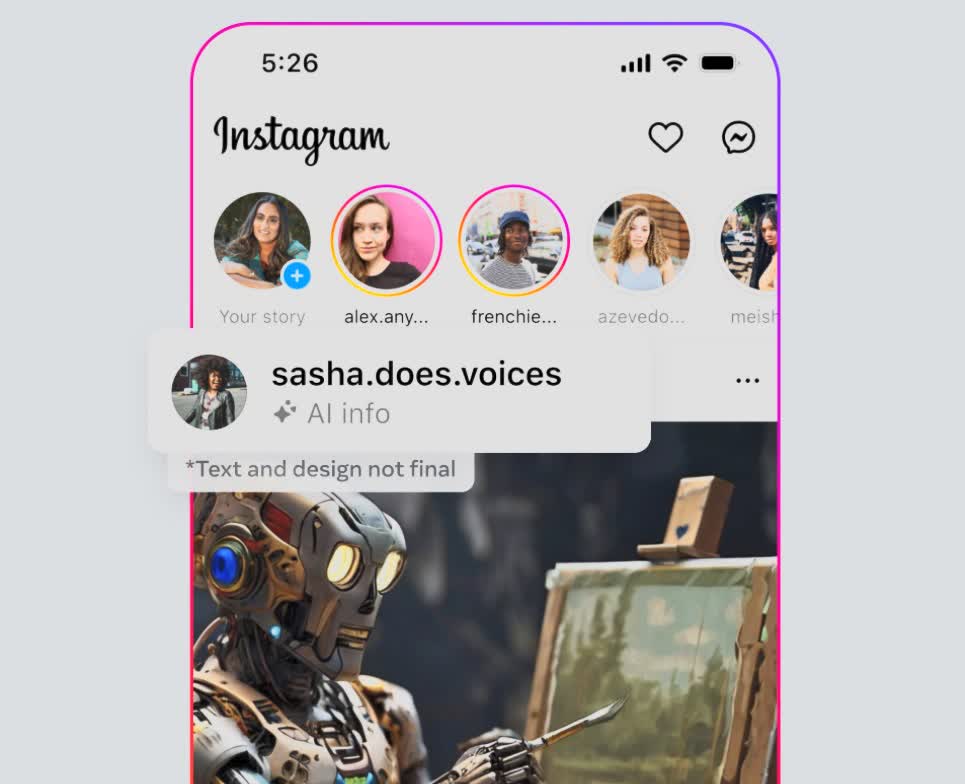

Meta ya etiqueta las imágenes fotorrealistas creadas por su herramienta de IA con etiquetas «Imaginadas con IA» y quiere hacer lo mismo con el contenido creado por otros servicios de IA generativa. escribe Nick Clegg, presidente de Asuntos Globales de Meta.

Las imágenes fotorrealistas creadas con la herramienta de IA de Meta incluyen marcadores visibles, marcas de agua invisibles y metadatos integrados en los archivos de imagen para ayudar a las plataformas a identificarlos como generados por IA.

Clegg escribe que Meta ha estado trabajando con otras empresas para desarrollar estándares comunes para identificar contenido generado por IA. El gigante de las redes sociales está creando herramientas que identifican marcadores invisibles a escala para que las imágenes de Google, OpenAI, Microsoft, Adobe, Midjourney y Shutterstock, que están trabajando para agregar sus propios metadatos a las imágenes, puedan identificarse y etiquetarse cuando se publiquen en un Meta. plataforma.

«Las personas a menudo se topan con contenido generado por IA por primera vez y nuestros usuarios nos han dicho que aprecian la transparencia en torno a esta nueva tecnología. Por eso es importante que ayudemos a las personas a saber cuándo el contenido fotorrealista que están viendo se ha creado utilizando IA». Clegg escribió.

Meta está desarrollando su capacidad para identificar imágenes generadas por IA ahora y comenzará a aplicar etiquetas en todos los idiomas en sus aplicaciones en los próximos meses.

Clegg dijo que identificar contenido de audio y video creado por IA está resultando más difícil ya que el proceso de agregar marcadores es complicado. Sin embargo, Meta está agregando una función que permitirá a los usuarios revelar cuándo comparten video o audio generado por IA para que la empresa pueda agregarle una etiqueta. Los usuarios también deben utilizar esta herramienta de divulgación cuando publican contenido orgánico con un video fotorrealista o audio con sonido realista que fue creado o alterado digitalmente. Meta «podrá aplicar sanciones si no lo hace».

Clegg dijo que cualquier imagen, video o audio creado o alterado digitalmente que «cree un riesgo particularmente alto de engañar materialmente al público en un asunto de importancia» recibirá una etiqueta más destacada.

Meta también está trabajando para desarrollar clasificadores que puedan ayudarlo a detectar automáticamente contenido generado por IA, incluso si dicho contenido carece de marcadores invisibles. También está buscando formas de hacer que sea más difícil alterar o eliminar marcas de agua invisibles.

Cada vez más empresas están presionando para encontrar formas de identificar contenido engañoso generado por IA a medida que se acercan las elecciones. En septiembre, Microsoft advirtió que se estaban utilizando imágenes de IA procedentes de China para influir en los votantes estadounidenses.

Más recientemente, se realizó una llamada automática a los residentes de New Hampshire que incluía una llamada automática de 39 segundos. mensaje pronunciado por lo que sonó como si el presidente Biden les dijera que no votaran. Probablemente se creó utilizando un motor de conversión de texto a voz creado por ElevenLabs, lo que llevó a la FCC a votar a favor. prohibir voces de IA en llamadas automáticas.