¡¿Qué carajo?! Si eres un jugador que presta la potencia de tu GPU a una empresa de computación en la nube llamada Salad, es muy probable que se utilice para crear contenido para adultos generado por IA a cambio de monedas y artículos de videojuegos. Sí, has leído bien.

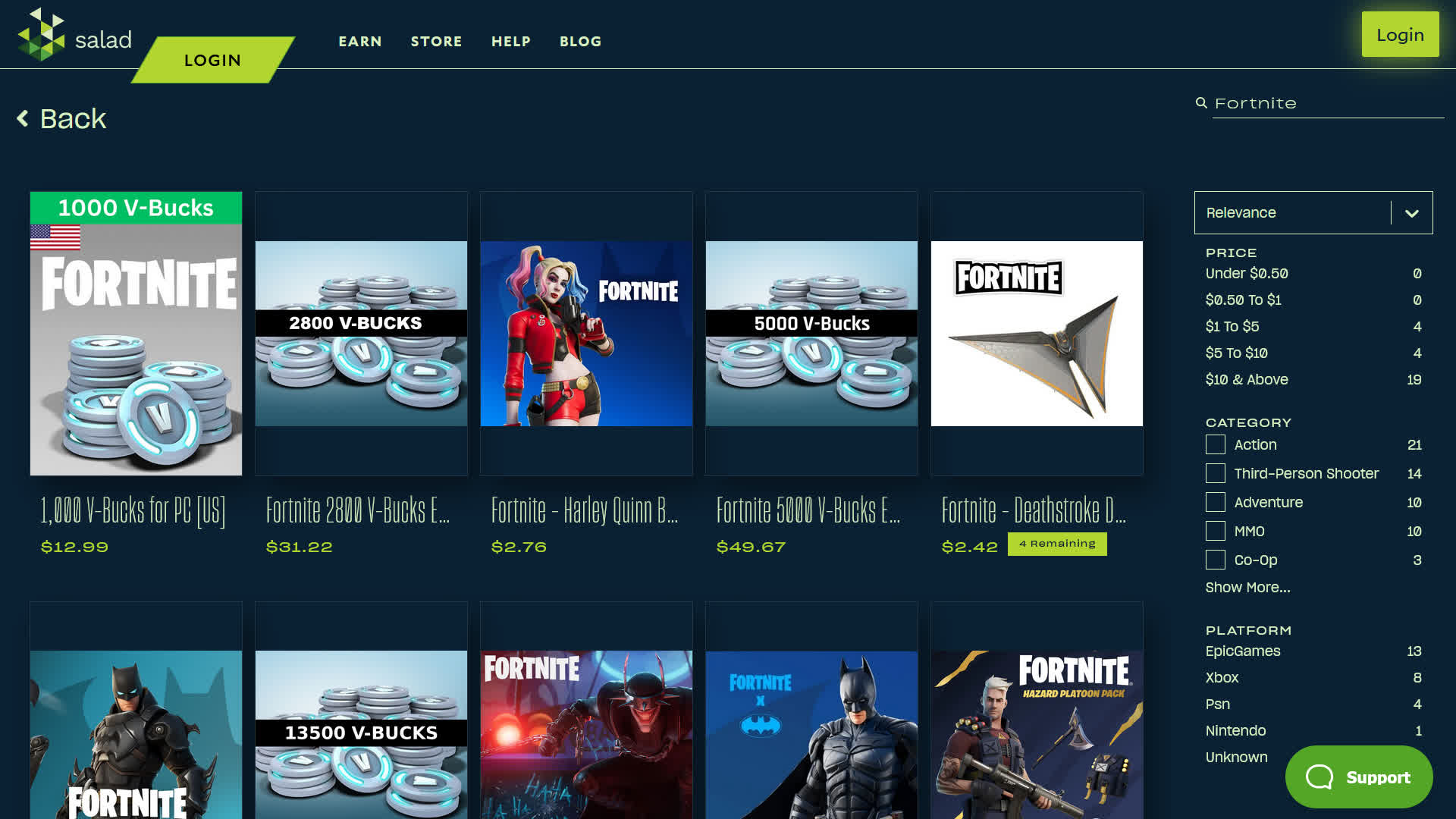

De acuerdo a un informe de 404 Media, Salad ha encontrado una manera inteligente de aumentar masivamente la generación de contenido de IA, incluidas imágenes, videos y texto, subcontratando el pesado trabajo computacional a las poderosas GPU que se encuentran en las plataformas de juegos. Los jugadores que se registran para «alquilar» sus GPU inactivas reciben pagos en productos digitales como cosméticos Fortnite, crédito Roblox, máscaras de Minecraft y otras recompensas relacionadas con los juegos a través de la tienda Salad.

Es dinero fácil: las tarjetas gráficas potentes son muy adecuado para la potencia de procesamiento necesaria para ejecutar modelos de IA como Difusión Estable para generar medios. Pero aquí está el truco: parte del contenido de inteligencia artificial que Salad genera utilizando la potencia de la GPU alquilada es contenido para adultos.

Al registrarse, Salad ofrece a los usuarios la opción de optar por no participar en la generación de contenido explícito para adultos. Sin embargo, según se informa, los mods de Discord de la compañía han afirmado que, de forma predeterminada, todos pueden optar por no participar, y algunos países no permiten la participación debido a las leyes locales. El sitio web de Salad también sugiere que los usuarios que no generan contenido para adultos podrían ganar menos dinero.

«Puede haber ocasiones en las que ganes un poco menos si tenemos una gran demanda de ciertas cargas de trabajo de contenido para adultos, pero no planeamos hacer de esas empresas el núcleo de nuestro modelo de negocio», se lee en un extracto de sus preguntas frecuentes.

La verdadera oscuridad surge con la participación de Salad en Civitai, una plataforma donde se comparten modelos de IA y se generan imágenes. 404 Media señala que Civitai ha permitido anteriormente la generación de pornografía no consensuada, incluido un incidente particularmente inquietante en el que imágenes generadas por IA «podrían clasificarse como pornografía infantil» se filtraron desde otra empresa que trabaja con Civitai.

Ni Salad ni Civitai han sido transparentes sobre cuán prevalente es la generación de contenido ilegal y no consensuado entre las resmas de pornografía con IA que se están produciendo. Pero dado el historial de Civitai y la gran escala de poder de procesamiento opaco que Salad está aprovechando, es muy posible que se estén creando algunas cosas desordenadas, sin que los jugadores cuyas GPU se alquilen lo sepan.

Es una situación sombría, emblemática de los mayores obstáculos éticos que surgen en el desarrollo comercial de la IA: empresas que se apresuran a reclamar y escalar sin que existan salvaguardias, transparencia o medidas de rendición de cuentas adecuadas.

404 Media especuló que Salad marca todos los trabajos de imágenes de Stable Diffusion como «contenido para adultos» de forma predeterminada porque en realidad no puede verificar lo que los usuarios individuales están generando.

Entonces, si bien es posible que solo espere obtener algunos obsequios gratuitos de Fortnite prestando su GPU a la red en la nube de Salad, existe la posibilidad de que su hardware esté produciendo depravación digital detrás de escena.

Esperemos que surja una regulación más reflexiva antes de que la metástasis del porno no consensuado con IA convierta a todo el sector en un basurero.