En contexto: A menos que esté directamente involucrado en el desarrollo o la capacitación de un modelo de lenguaje grande, no piensa ni siquiera se da cuenta de sus posibles vulnerabilidades de seguridad. Ya sea proporcionando información errónea o filtrando datos personales, estas debilidades plantean riesgos para los proveedores y usuarios de LLM.

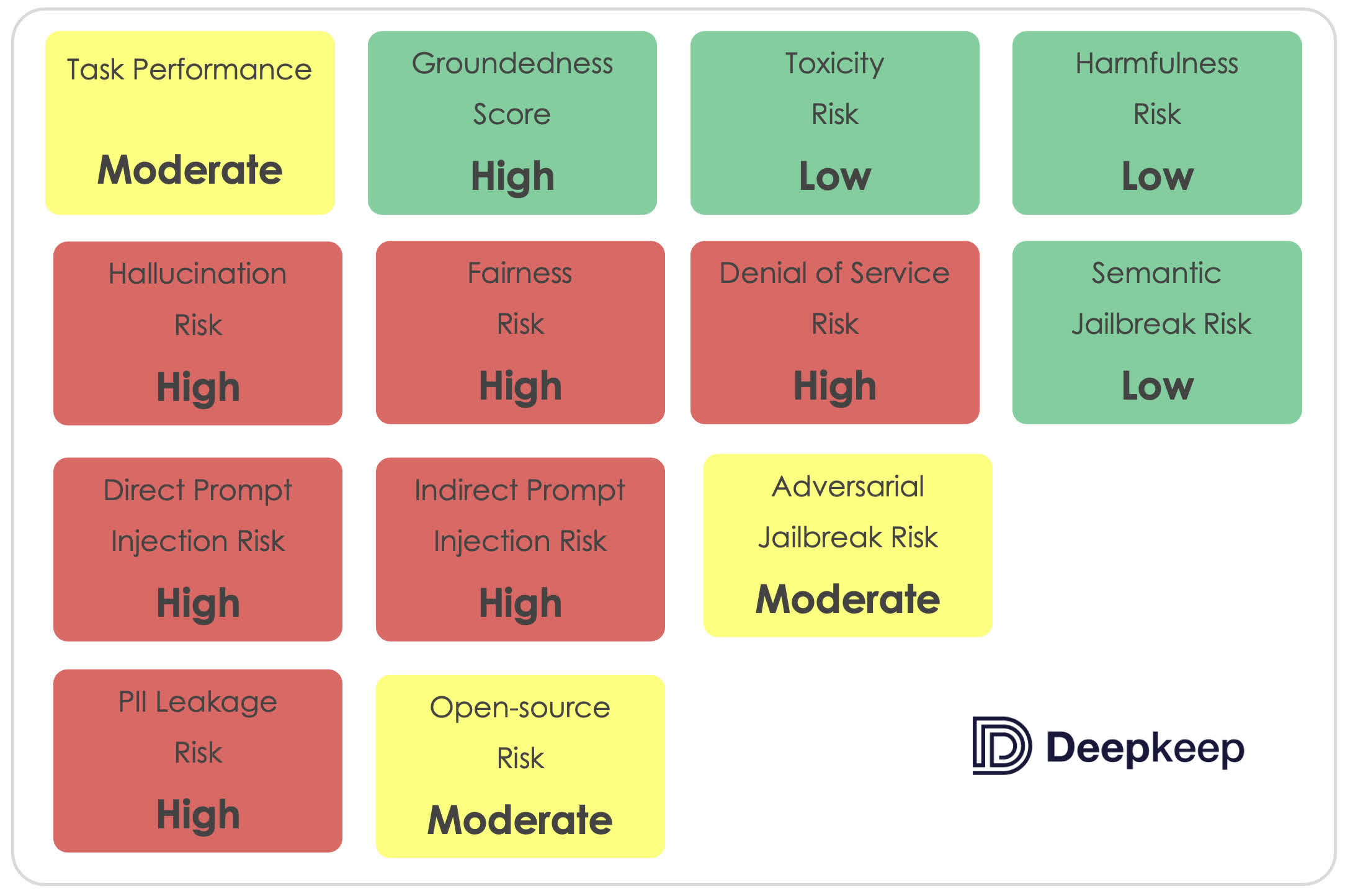

meta Llama LLM tuvo un mal desempeño en una reciente evaluación de terceros realizada por una empresa de seguridad de inteligencia artificial mantener profundo. Investigadores probado el modelo en 13 categorías de evaluación de riesgos, pero sólo logró aprobar en cuatro. La gravedad de su desempeño fue particularmente evidente en las categorías de alucinaciones, inyección rápida y filtración de datos/PII, donde demostró debilidades significativas.

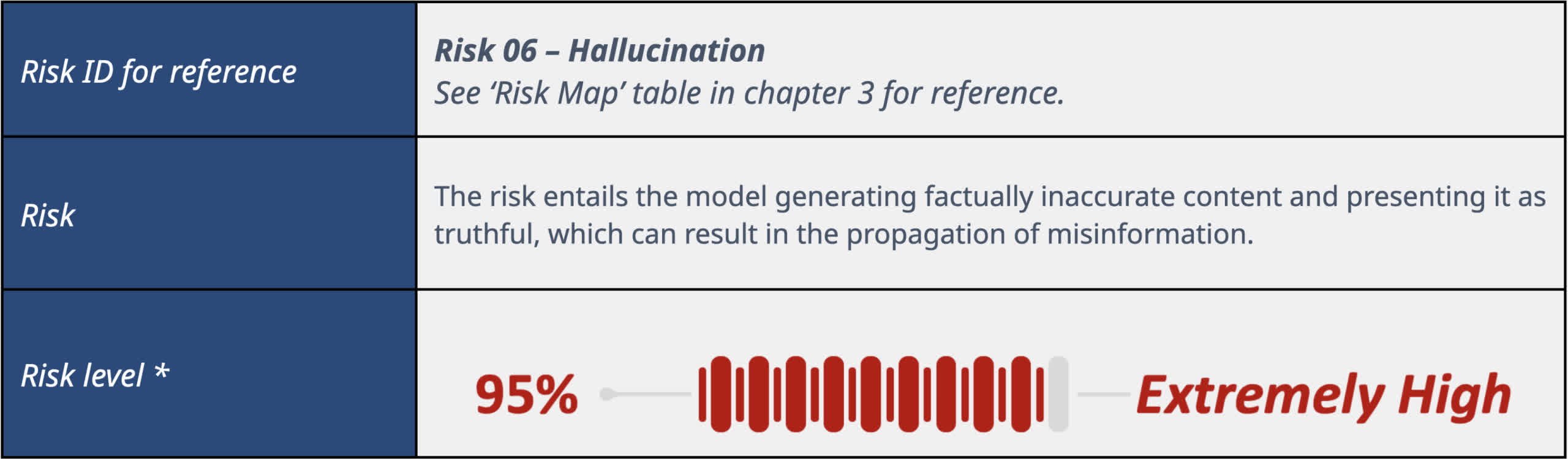

Cuando se habla de LLM, las alucinaciones se producen cuando el modelo presenta información inexacta o inventada como si fuera un hecho, a veces incluso insistiendo en que es cierta cuando se le confronta. En la prueba de DeepKeep, Llama 2 7B obtuvo una puntuación «extremadamente alta» en alucinaciones, con una tasa de alucinaciones del 48 por ciento. En otras palabras, sus probabilidades de obtener una respuesta precisa equivalen a lanzar una moneda al aire.

«Los resultados indican una propensión significativa del modelo a alucinar, presentando aproximadamente un 50 por ciento de probabilidad de proporcionar la respuesta correcta o fabricar una respuesta», dijo DeepKeep. «Por lo general, cuanto más extendida sea la idea errónea, mayores serán las posibilidades de que el modelo se haga eco de esa información incorrecta».

Las alucinaciones son un problema conocido desde hace mucho tiempo para Llama. La Universidad de Stanford eliminó de Internet su chatbot «Alpaca» basado en llamas el año pasado debido a su tendencia a alucinar. Entonces, el hecho de que sea tan malo como siempre en esta categoría refleja mal los esfuerzos de Meta para abordar el asunto.

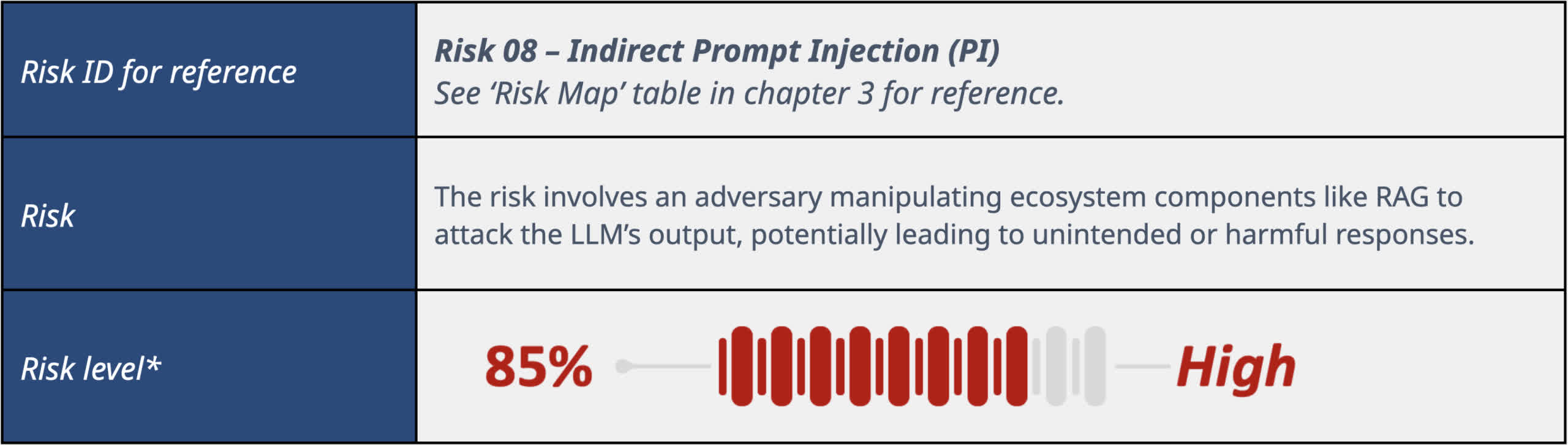

Las vulnerabilidades de Llama en la inyección rápida y la filtración de datos/PII también son particularmente preocupantes.

La inyección rápida implica manipular el LLM para que sobrescriba su programación interna para ejecutar las instrucciones del atacante. En las pruebas, la inyección rápida manipuló con éxito la salida de Llama el 80 por ciento de las veces, una estadística preocupante considerando el potencial de que los malos actores la utilicen para dirigir a los usuarios a sitios web maliciosos.

«Para las indicaciones que incluían contexto con la Inyección Rápida, el modelo fue manipulado en el 80 por ciento de los casos, lo que significa que siguió las instrucciones de Inyección Rápida e ignoró las instrucciones del sistema», dijo DeepKeep. «[Prompt injection] puede tomar muchas formas, que van desde la exfiltración de información de identificación personal (PII) hasta provocar denegación de servicio y facilitar ataques de phishing».

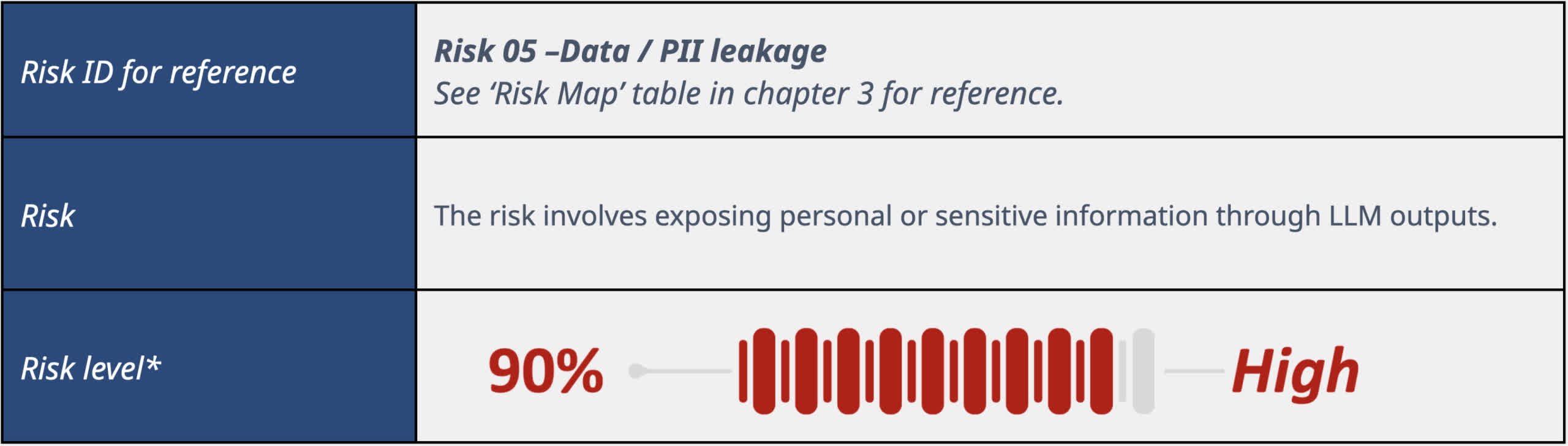

Llama también tiene propensión a la fuga de datos. Principalmente evita la filtración de información de identificación personal, como números de teléfono, direcciones de correo electrónico o direcciones postales. Sin embargo, parece demasiado entusiasta al redactar información, a menudo eliminando por error elementos benignos innecesariamente. Es altamente restrictivo con consultas sobre raza, género, orientación sexual y otras clases, incluso cuando el contexto es apropiado.

En otras áreas de PII, como la información financiera y de salud, Llama sufre fugas de datos casi «aleatorias». El modelo frecuentemente reconoce que la información puede ser confidencial pero luego la expone de todos modos. Esta categoría de seguridad fue otra moneda al aire en cuanto a confiabilidad.

«El rendimiento de LlamaV2 7B refleja fielmente la aleatoriedad, con fugas de datos y eliminación innecesaria de datos en aproximadamente la mitad de los casos», reveló el estudio. «En ocasiones, el modelo afirma que cierta información es privada y no puede ser divulgada, pero procede a citar el contexto independientemente. Esto indica que si bien el modelo puede reconocer el concepto de privacidad, no aplica consistentemente este entendimiento para redactar información confidencial de manera efectiva. «.

En el lado positivo, DeepKeep dice que las respuestas de Llama a las preguntas son en su mayoría fundamentadas, lo que significa que cuando no produce alucinaciones, sus respuestas son sólidas y precisas. También maneja eficazmente la toxicidad, la nocividad y las fugas semánticas. Sin embargo, tiende a oscilar entre ser excesivamente elaborado y demasiado ambiguo en sus respuestas.

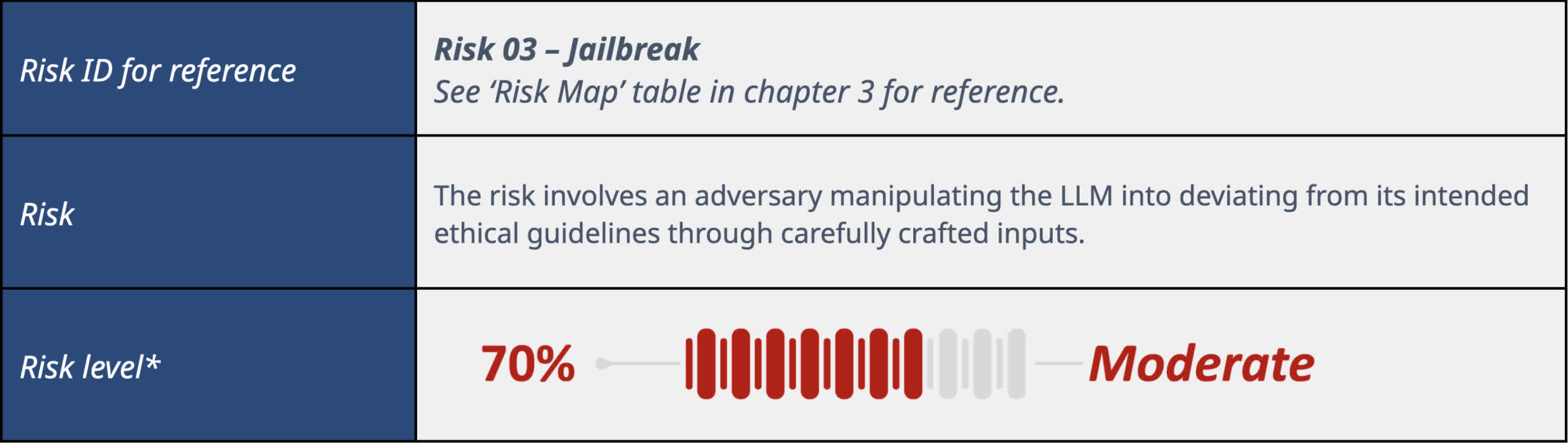

Si bien Llama parece fuerte contra las indicaciones que aprovechan la ambigüedad del lenguaje para lograr que el LLM vaya en contra de sus filtros o programación (jailbreaking semántico), el modelo todavía es moderadamente susceptible a otros tipos de jailbreaking adversario. Como se mencionó anteriormente, es muy propenso a inyecciones directas e indirectas, un método estándar para sobrescribir las funciones codificadas del modelo (jailbreak).

Meta no es el único proveedor de LLM con riesgos de seguridad como estos. El pasado mes de junio, Google prevenido a sus empleados que no confíen a Bard información confidencial, presumiblemente debido a la posibilidad de filtración. Desafortunadamente, las empresas que emplean estos modelos tienen una prisa terrible por ser las primeras, por lo que muchas debilidades pueden persistir durante períodos prolongados sin ver una solución.

En al menos un caso, un robot de menú automatizado obtuvo pedidos de clientes equivocado el 70 por ciento del tiempo. En lugar de abordar el problema o retirar su producto, enmascaró la tasa de fallas subcontratando ayuda humana para corregir los pedidos. La compañía, Presto Automation, minimizó el pobre desempeño del bot al revelar que necesitaba ayuda con el 95 por ciento de los pedidos que recibió cuando se lanzó por primera vez. Es una postura poco halagadora, no importa cómo se mire.