En contexto: Ahora que el auge de la criptominería ha terminado, Nvidia aún tiene que volver a su anterior enfoque centrado en los juegos. En cambio, se lanzó al auge de la IA y proporcionó GPU para impulsar chatbots y servicios de IA. Actualmente tiene un lugar en el mercado, pero un consorcio de empresas busca cambiar eso diseñando un estándar de comunicación abierto para procesadores de IA.

Algunas de las empresas de tecnología más grandes en los sectores de hardware e inteligencia artificial han formado un consorcio para crear un nuevo estándar industrial para la conectividad de GPU. El grupo Ultra Accelerator Link (ULink) tiene como objetivo desarrollar soluciones de tecnología abierta para beneficiar a todo el ecosistema de IA en lugar de depender de una sola empresa como Nvidia y su tecnología patentada NVLink.

El grupo UALink incluye AMD, Broadcom, Cisco, Google, Hewlett Packard Enterprise (HPE), Intel, Meta y Microsoft. Según su comunicado de prensa, el estándar abierto de la industria desarrollado by UALink permitirá un mejor rendimiento y eficiencia para los servidores de IA, haciendo que las GPU y los aceleradores de IA especializados se comuniquen «de manera más efectiva».

Empresas como HPE, Intel y Cisco aportarán al grupo su «amplia» experiencia en la creación de soluciones de inteligencia artificial a gran escala y sistemas informáticos de alto rendimiento. A medida que la demanda de informática de IA continúa creciendo rápidamente, una red robusta, escalable y de baja latencia que pueda compartir eficientemente recursos informáticos es crucial para la futura infraestructura de IA.

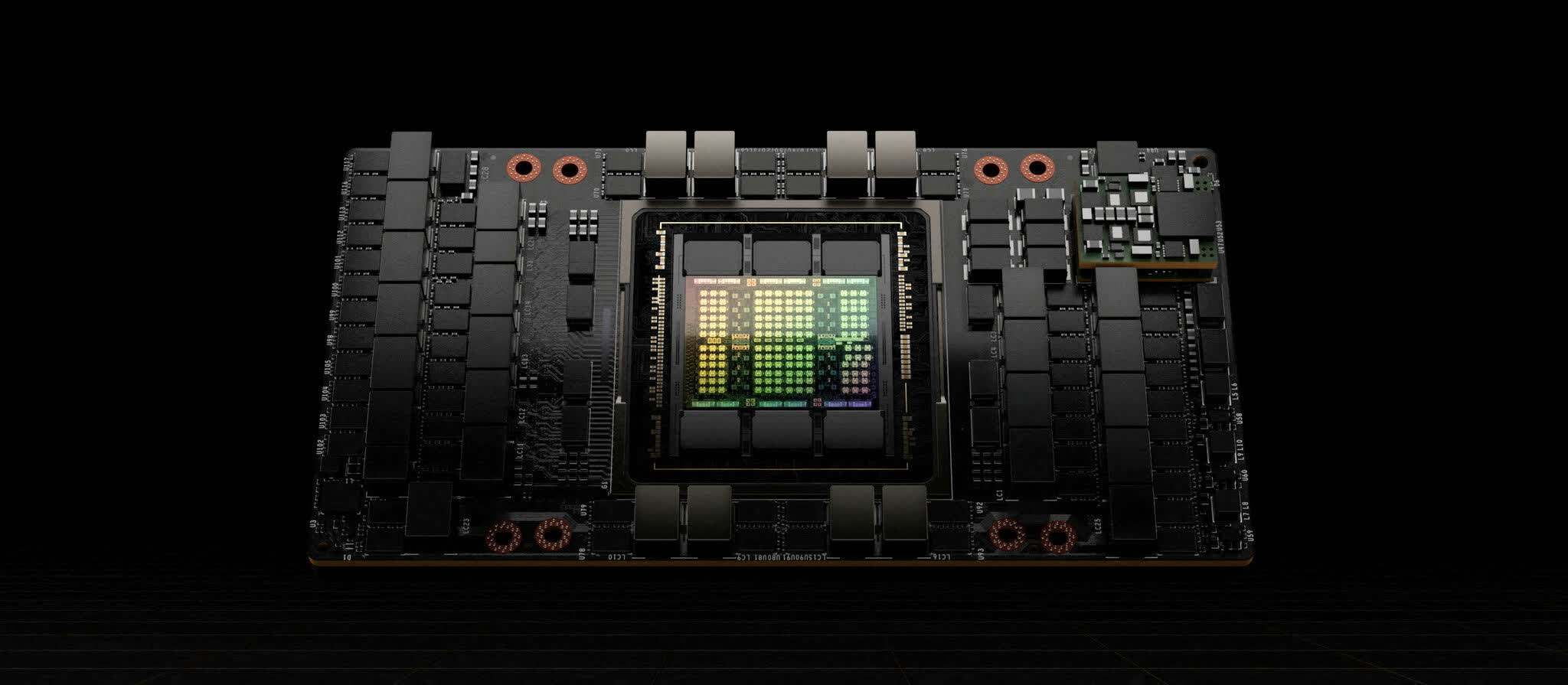

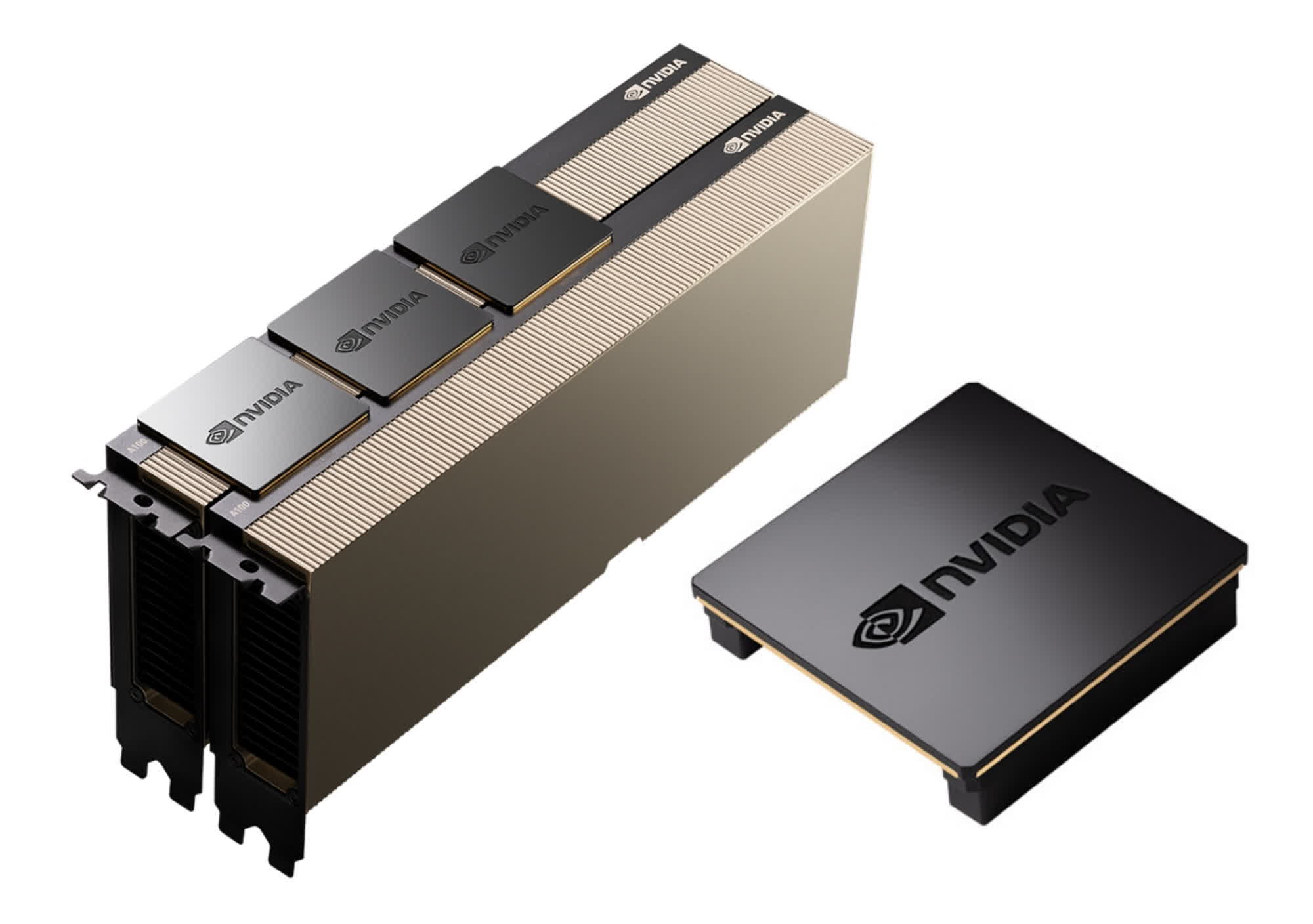

Actualmente, Nvidia vende los aceleradores más potentes del mundo para algunos de los modelos de IA más grandes disponibles. Es NVEnlace La tecnología ayuda a facilitar el rápido intercambio de datos entre cientos de GPU instaladas en estos clústeres de servidores de IA. UALink espera definir una interfaz estándar para IA y aprendizaje automático, HPC y computación en la nube, con comunicaciones de alta velocidad y baja latencia para todas las marcas de aceleradores de IA, no solo Nvidia.

El grupo espera que su especificación 1.0 inicial llegue durante el tercer trimestre de 2024. El estándar permitirá comunicaciones para 1.024 aceleradores dentro de una «cápsula informática de IA», lo que permitirá a las GPU acceder directamente a cargas y almacenes entre sus elementos de memoria conectados.

El vicepresidente de AMD, Forrest Norrod, señaló que el trabajo que está realizando el grupo UALink es esencial para el futuro de las aplicaciones de IA. Asimismo, Broadcom dijo que estaba «orgulloso» de ser miembro fundador del consorcio UALink para apoyar un ecosistema abierto para la conectividad de IA.