DeepMind, el laboratorio de investigación y desarrollo de IA de Google, cree que la clave para lograr sistemas de IA más capaces podría estar en descubrir nuevas formas de resolver problemas geométricos desafiantes.

Con ese fin, DeepMind presentó hoy AlphaGeometry, un sistema que, según el laboratorio, puede resolver tantos problemas de geometría como el medallista de oro promedio de la Olimpiada Internacional de Matemáticas. AlphaGeometry, cuyo código fue de código abierto esta mañana, resuelve 25 problemas de geometría de la Olimpiada dentro del límite de tiempo estándar, superando los 10 del sistema de última generación anterior.

«Resolver problemas de geometría a nivel de Olimpiada es un hito importante en el desarrollo de un razonamiento matemático profundo en el camino hacia sistemas de IA más avanzados y generales», escriben Trieu Trinh y Thang Luong, científicos investigadores de IA de Google, en una entrada de blog publicada esta mañana. “[We] Espero que… AlphaGeometry ayude a abrir nuevas posibilidades en matemáticas, ciencia e inteligencia artificial”.

¿Por qué centrarse en la geometría? DeepMind afirma que demostrar teoremas matemáticos, o explicar lógicamente por qué un teorema (por ejemplo, el teorema de Pitágoras) es verdadero, requiere tanto razonamiento como la capacidad de elegir entre una variedad de pasos posibles hacia una solución. Este enfoque de resolución de problemas podría, si DeepMind tiene razón, resultar útil algún día en los sistemas de inteligencia artificial de uso general.

«Demostrar que una conjetura particular es verdadera o falsa amplía las capacidades incluso de los sistemas de inteligencia artificial más avanzados de la actualidad», se lee en los materiales de prensa de DeepMind compartidos con TechCrunch. «Hacia ese objetivo, ser capaz de demostrar teoremas matemáticos… es un hito importante ya que muestra el dominio del razonamiento lógico y la capacidad de descubrir nuevos conocimientos».

Pero entrenar un sistema de IA para resolver problemas geométricos plantea desafíos únicos.

Debido a las complejidades de traducir pruebas a un formato que las máquinas puedan entender, hay escasez de datos de entrenamiento de geometría utilizables. Y muchos de los modelos de IA generativa de vanguardia actuales, si bien son excepcionales a la hora de identificar patrones y relaciones en los datos, carecen de la capacidad de razonar lógicamente mediante teoremas.

La solución de DeepMind fue doble.

Créditos de imagen: Mente profunda

Al diseñar AlphaGeometry, el laboratorio combinó un modelo de “lenguaje neuronal” (un modelo arquitectónicamente similar a ChatGPT) con un “motor de deducción simbólica”, un motor que aprovecha reglas (por ejemplo, reglas matemáticas) para inferir soluciones a problemas. Los motores simbólicos pueden ser inflexibles y lentos, especialmente cuando se trata de conjuntos de datos grandes o complicados. Pero DeepMind mitigó estos problemas haciendo que el modelo neuronal «guiara» el motor de deducción a través de posibles respuestas a problemas de geometría determinados.

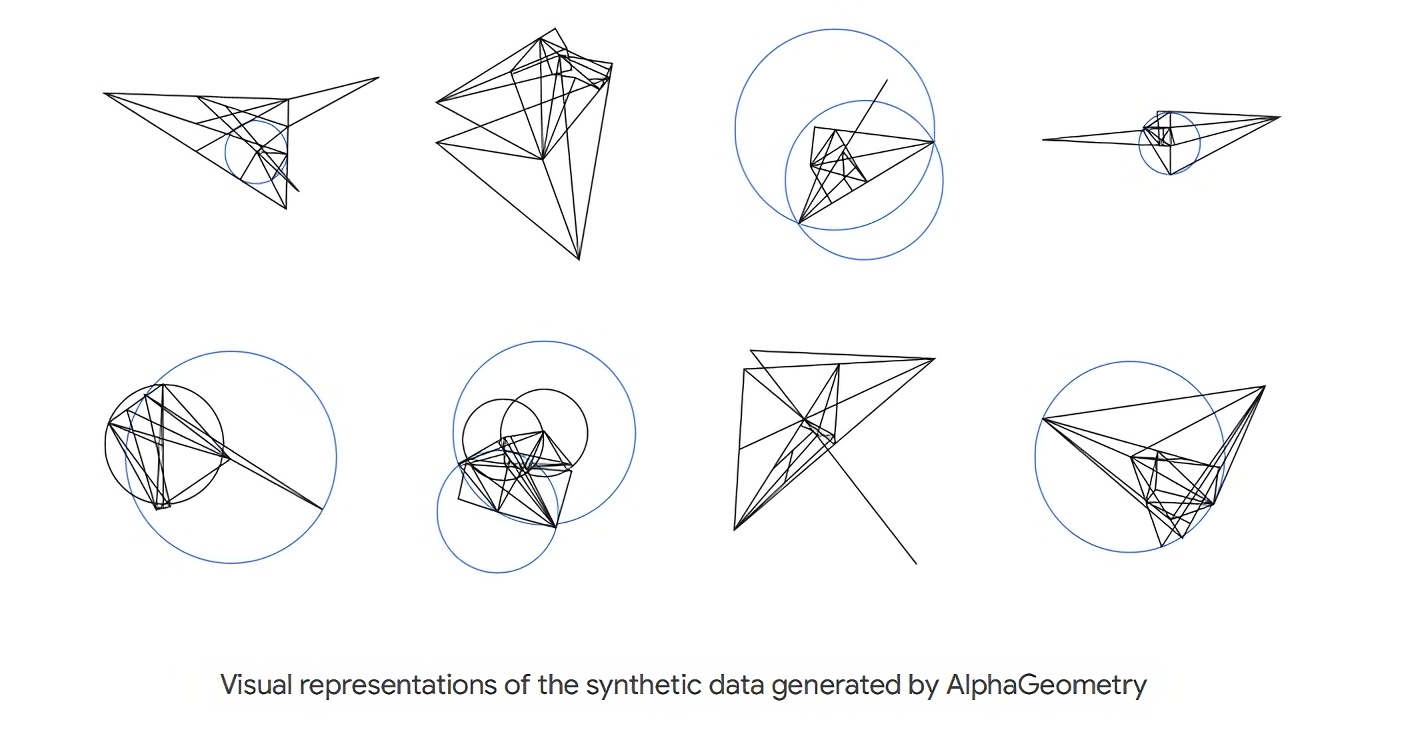

En lugar de datos de entrenamiento, DeepMind creó los suyos propios sintético datos, generando 100 millones de “teoremas sintéticos” y demostraciones de diversa complejidad. Luego, el laboratorio entrenó a AlphaGeometry desde cero con los datos sintéticos y los evaluó en problemas de geometría de la Olimpiada.

Los problemas de geometría de las Olimpíadas se basan en diagramas a los que es necesario agregar «constructos» antes de poder resolverlos, como puntos, líneas o círculos. Aplicado a estos problemas, el modelo neuronal de AlphaGeometry predice qué construcciones podrían ser útiles para agregar: predicciones que el motor simbólico de AlphaGeometry utiliza para hacer deducciones sobre los diagramas para identificar soluciones similares.

«Con tantos ejemplos de cómo estas construcciones llevaron a pruebas, el modelo de lenguaje de AlphaGeometry es capaz de hacer buenas sugerencias para nuevas construcciones cuando se les presentan problemas de geometría de Olimpiada», escriben Trinh y Luong. «Un sistema proporciona ideas rápidas e ‘intuitivas’ y el otro una toma de decisiones más deliberada y racional».

Los resultados de la resolución de problemas de AlphaGeometry, publicados en un estudio en la revista Naturaleza Esta semana, es probable que alimenten el debate de larga data sobre si los sistemas de inteligencia artificial deberían basarse en la manipulación de símbolos (es decir, manipular símbolos que representan conocimiento usando reglas) o en redes neuronales aparentemente más parecidas al cerebro.

Los defensores del enfoque de las redes neuronales sostienen que el comportamiento inteligente (desde el reconocimiento de voz hasta la generación de imágenes) puede surgir de nada más que cantidades masivas de datos y computación. Opuesto a Los sistemas simbólicos, que resuelven tareas definiendo conjuntos de reglas de manipulación de símbolos dedicadas a trabajos particulares (como editar una línea en un software de procesador de textos), las redes neuronales intentan resolver tareas mediante aproximaciones estadísticas y aprendiendo de ejemplos.

Las redes neuronales son la piedra angular de potentes sistemas de inteligencia artificial como DALL-E 3 y GPT-4 de OpenAI. Pero, afirman los partidarios de la IA simbólica, no son el fin de todo; La IA simbólica podría estar mejor posicionada para codificar eficientemente el conocimiento del mundo, razonar a través de escenarios complejos y “explicar” cómo llegaron a una respuesta, argumentan estos partidarios.

Como sistema híbrido de red simbólica-neural similar a AlphaFold 2 y AlphaGo de DeepMind, AlphaGeometry quizás demuestra que los dos enfoques (manipulación de símbolos y redes neuronales) conjunto es el mejor camino a seguir en la búsqueda de una IA generalizable. Tal vez.

“Nuestro objetivo a largo plazo sigue siendo construir sistemas de IA que puedan generalizarse en campos matemáticos, desarrollando la solución sofisticada de problemas y el razonamiento de los que dependerán los sistemas generales de IA, y al mismo tiempo ampliando las fronteras del conocimiento humano”, escriben Trinh y Luong. «Este enfoque podría moldear la forma en que los sistemas de inteligencia artificial del futuro descubrirán nuevos conocimientos, en matemáticas y más allá».