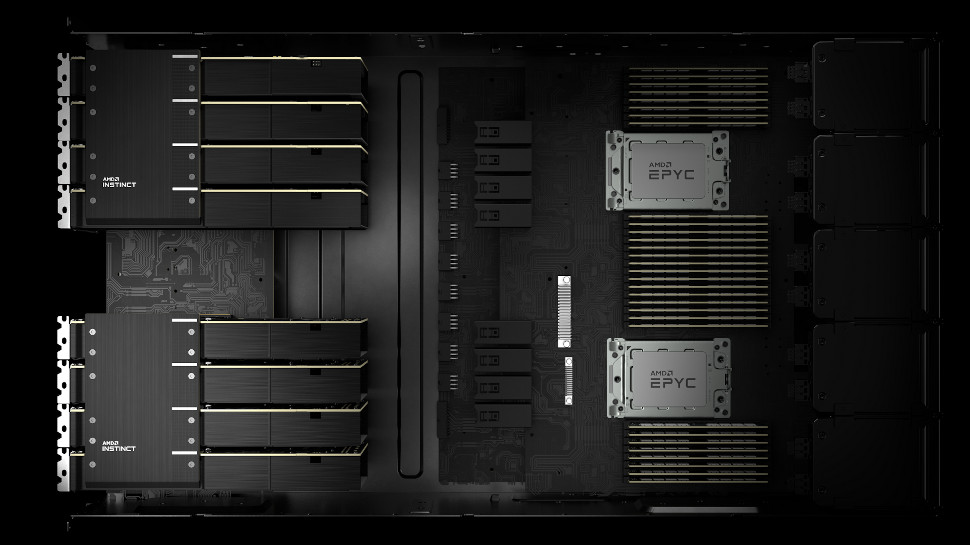

La supercomputadora más poderosa del mundo ha utilizado poco más del 8% de las GPU que lleva equipadas para entrenar un modelo de lenguaje grande (LLM) que contiene un billón de parámetros, comparable a AbiertoAIEs GPT-4.

Frontier, con sede en el Laboratorio Nacional Oak Ridge, utilizó 3.072 de sus AMD GPU Radeon Instinct para entrenar un sistema de inteligencia artificial a una escala de billones de parámetros, y utilizó 1.024 de estas GPU (aproximadamente el 2,5%) para entrenar un modelo de 175 mil millones de parámetros, esencialmente del mismo tamaño que ChatGPT.

Los investigadores necesitaron un mínimo de 14 TB de RAM para lograr estos resultados, según su papel, pero cada GPU MI250X solo tenía 64 GB de VRAM, lo que significa que los investigadores tuvieron que agrupar varias GPU. Sin embargo, esto introdujo otro desafío en forma de paralelismo, lo que significa que los componentes tenían que comunicarse mucho mejor y de manera más efectiva a medida que aumentaba el tamaño total de los recursos utilizados para capacitar al LLM.

Poniendo a trabajar la supercomputadora más poderosa del mundo

Los LLM no suelen estar capacitados en supercomputadoras, sino en servidores especializados y requieren muchas más GPU. ChatGPT, por ejemplo, fue entrenado en más de 20.000 GPU, según fuerza de tendencia. Pero los investigadores querían demostrar si podían entrenar una supercomputadora de manera mucho más rápida y efectiva aprovechando varias técnicas posibles gracias a la arquitectura de la supercomputadora.

Los científicos utilizaron una combinación de paralelismo tensorial (grupos de GPU que comparten partes del mismo tensor) y paralelismo de canalización (grupos de GPU que albergan componentes vecinos). También emplearon el paralelismo de datos para consumir una gran cantidad de tokens simultáneamente y una mayor cantidad de recursos informáticos. El efecto general fue lograr un tiempo mucho más rápido.

Para el modelo de 22 mil millones de parámetros, lograron un rendimiento máximo del 38,38 % (73,5 TFLOPS), 36,14 % (69,2 TFLOPS) para el modelo de 175 mil millones de parámetros y 31,96 % de rendimiento máximo (61,2 TFLOPS) para el modelo de 1 billón de parámetros. .

También lograron un 100 % de eficiencia de escalamiento débil, así como un rendimiento de escala fuerte del 89,93 % para el modelo de 175 mil millones y un rendimiento de escala fuerte del 87,05 % para el modelo de parámetros de 1 billón.

Aunque los investigadores fueron abiertos sobre los recursos informáticos utilizados y las técnicas involucradas, olvidaron mencionar los plazos involucrados en la capacitación de un LLM de esta manera.

TechRadar Pro solicitó a los investigadores los horarios, pero no respondieron al momento de escribir este artículo.