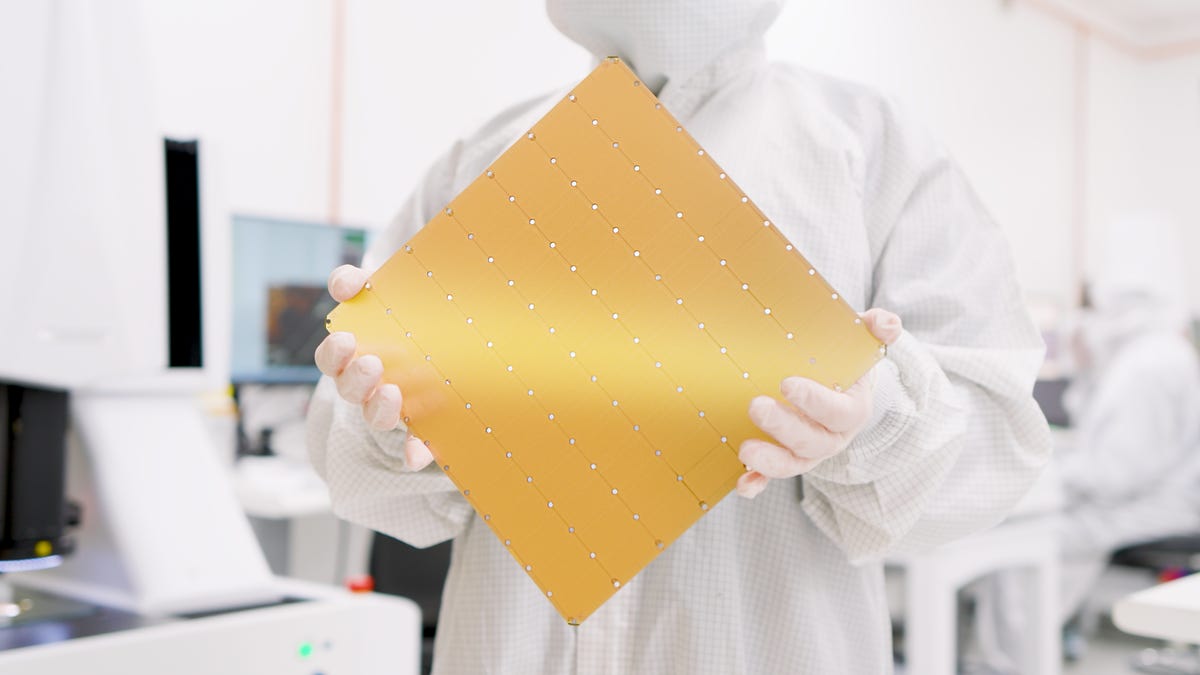

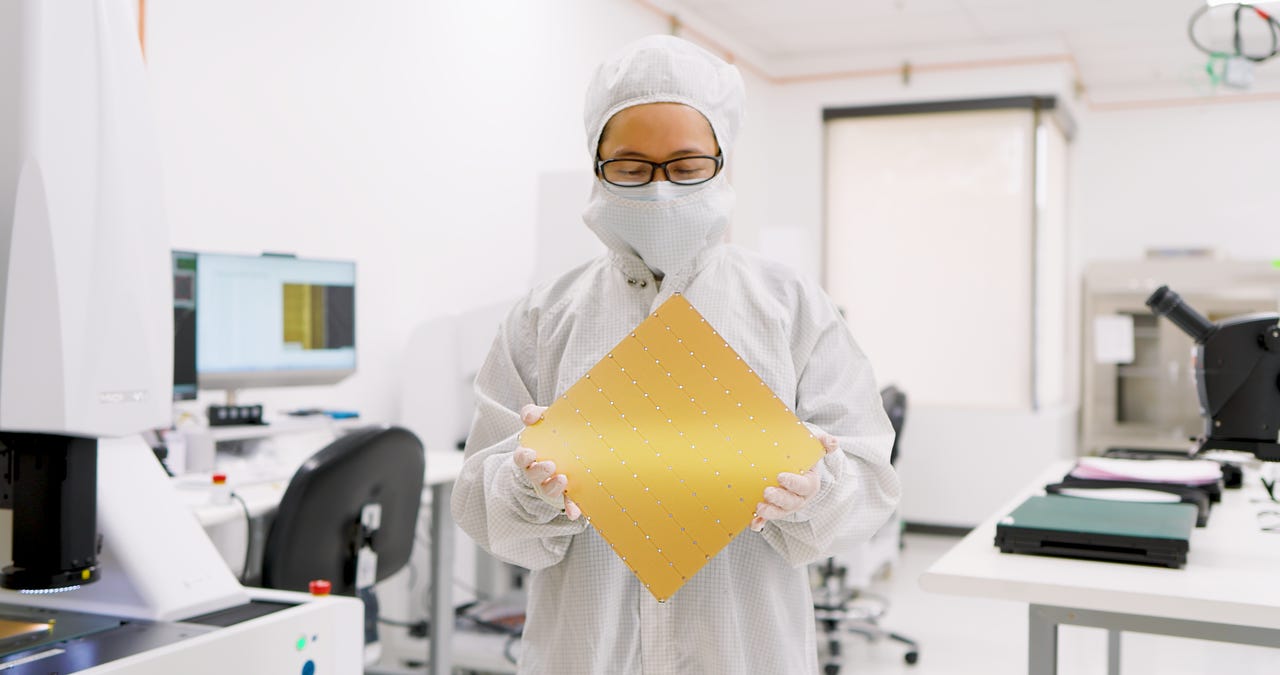

El chip WSE-3 de Cerebras, del tamaño de casi una oblea semiconductora completa de 12 pulgadas, es el chip más grande del mundo, eclipsando a la GPU H100 de Nvidia. La startup de IA señala que una sola de sus computadoras CS-3 que ejecutan el chip puede procesar una red neuronal como GPT-4 con un recuento de parámetros hipotético de 24 billones. Sistemas cerebrales

La carrera por modelos de inteligencia artificial generativa cada vez más grandes continúa impulsando la industria de los chips. El miércoles, Cerebras Systems, uno de los competidores más destacados de Nvidia, presentó el «Wafer Scale Engine 3», la tercera generación de su chip de inteligencia artificial y el semiconductor más grande del mundo.

Cerebras lanzó el WSE-2 en abril de 2021. Su sucesor, el WSE-3, está diseñado para entrenar modelos de IA, lo que significa refinar sus pesos o parámetros neuronales para optimizar su funcionalidad antes de ponerlos en producción.

«Es el doble de rendimiento, el mismo consumo de energía, el mismo precio, por lo que esto sería un verdadero paso de la Ley de Moore, y no hemos visto eso en mucho tiempo en nuestra industria», dijo el cofundador y director ejecutivo de Cerebras, Andrew Feldman, en un rueda de prensa sobre el chip, en referencia a la regla de décadas de que los circuitos del chip se duplican aproximadamente cada 18 meses.

El WSE-3 duplica la tasa de instrucciones realizadas, de 62,5 petaFLOP a 125 petaFLOPS. Un petaFLOP se refiere a 1.000.000.000.000.000 (1 cuatrillón) de operaciones de punto flotante por segundo.

El WSE-3, del tamaño de casi una oblea entera de 12 pulgadas, al igual que su predecesor, ha reducido sus transistores de 7 nanómetros (siete milmillonésimas de metro) a 5 nanómetros, aumentando el número de transistores de 2,6 billones de transistores en el WSE-2 a 4 billones. TSMC, el mayor fabricante de chips por contrato del mundo, está fabricando el WSE-3.

Cerebras ha mantenido la misma proporción de transistores lógicos y circuitos de memoria aumentando sólo ligeramente el contenido de memoria de la SRAM en el chip, de 40 GB a 44 GB, y aumentando ligeramente el número de núcleos de cómputo de 850.000 a 900.000.

«Creemos que ahora tenemos el equilibrio adecuado entre computación y memoria», dijo Feldman en la sesión informativa, que tuvo lugar en la sede de Colovore, el socio de alojamiento en la nube de la startup, en Santa Clara, California.

Al igual que con las dos generaciones de chips anteriores, Feldman comparó el enorme tamaño del WSE-3 con el estándar actual de Nvidia, en este caso, la GPU H100, a la que llamó «esta pobre y triste parte aquí» en una imagen de diapositivas.

«Es 57 veces más grande», dijo Feldman, comparando la WSE-3 con la H100 de Nvidia. «Tiene 52 veces más núcleos. Tiene 800 veces más memoria en el chip. Tiene 7.000 veces más ancho de banda de memoria y más de 3.700 veces más ancho de banda de estructura. Estos son los pilares del rendimiento».

«Esto sería un verdadero paso de la Ley de Moore», dijo Feldman sobre la duplicación de operaciones por segundo del nuevo chip, «y no hemos visto eso en mucho tiempo en nuestra industria». Tiernan Ray para ZDNET

Cerebras utilizó transistores adicionales para agrandar cada núcleo de cómputo, mejorando ciertas características, como duplicar la capacidad «SIMD», la característica de multiprocesamiento que afecta la cantidad de puntos de datos que se pueden procesar en paralelo para cada ciclo de reloj.

El chip viene empaquetado en una nueva versión del chasis y la fuente de alimentación, el CS-3, que ahora puede agruparse en 2.048 máquinas, 10 veces más que antes. Esas máquinas combinadas pueden realizar 256 exaFLOPS, mil petaFLOPS o un cuarto de zetaFLOP.

También: Cerebras, pionero de la IA, está teniendo un ‘año monstruoso’ en la informática híbrida de IA

Feldman dijo que su computadora CS-3 con WSE-3 puede manejar un modelo teórico de lenguaje grande de 24 billones de parámetros, lo que sería un orden de magnitud más que las herramientas de inteligencia artificial generativa de primera línea, como GPT-4 de OpenAI, que Se rumorea que tiene 1 billón de parámetros. «Los 24 billones de parámetros completos se pueden ejecutar en una sola máquina», afirmó Feldman.

Para ser claros, Cerebras está haciendo esta comparación utilizando un modelo sintético de lenguaje grande que en realidad no está entrenado. Es simplemente una demostración de la capacidad informática de WSE-3.

La máquina Cerebras es más fácil de programar que una GPU, argumentó Feldman. Para entrenar el GPT-3 de 175 mil millones de parámetros, una GPU requeriría 20,507 líneas de código combinado Python, C/C++, CUDA y otros, frente a solo 565 líneas de código para el WSE-3.

También: Cerebras y M42 de Abu Dhabi realizaron un LLM dedicado a responder preguntas médicas

Para el rendimiento bruto, Feldman comparó los tiempos de entrenamiento por tamaño de grupo. Feldman dijo que un grupo de 2.048 CS-3 podría entrenar el modelo de lenguaje grande Llama 2 de 70 mil millones de parámetros de Meta 30 veces más rápido que el grupo de entrenamiento de IA de Meta: un día versus 30 días.

«Cuando se trabaja con clústeres de este tamaño, se puede llevar a cada empresa la misma computación que los hiperescaladores usan para sí mismos», dijo Feldman, «y no sólo se puede traer lo que ellos hacen, sino que se puede traer radicalmente más rápido».

Feldman destacó a los clientes de las máquinas, incluido G42, una firma de inversión fundada hace cinco años con sede en Abu Dhabi, Emiratos Árabes Unidos.

Cerebras está trabajando en un grupo de 64 máquinas CS-3 para G42 en una instalación en Dallas, Texas, llamado «Condor Galaxy 3», la siguiente parte de un proyecto de nueve partes que se espera que alcance decenas de exaFLOPS para finales de 2024.

Al igual que Nvidia, Cerebras tiene más demanda de la que puede satisfacer en este momento, afirmó Feldman. La startup tiene una «considerable acumulación de pedidos de CS-3 en nubes empresariales, gubernamentales e internacionales».

También: Hacer que GenAI sea más eficiente con un nuevo tipo de chip

Feldman también anunció una asociación con el gigante de los chips Qualcomm para utilizar el procesador AI 100 de este último para la segunda parte de la IA generativa, el proceso de inferencia que consiste en hacer predicciones sobre el tráfico en vivo. Feldman señaló que el costo de ejecutar modelos de IA generativa en producción aumenta con el recuento de parámetros y señaló que ejecutar ChatGPT podría costar $1 billón de dólares anualmente si cada persona en el planeta le enviara solicitudes.

La asociación aplica cuatro técnicas para reducir el costo de la inferencia. Usando lo que se llama escasez, que ignora la entrada de valor cero, el software de Cerebras elimina hasta el 80% de los cálculos innecesarios, dijo Feldman. Una segunda técnica, la decodificación especulativa, hace predicciones utilizando una versión más pequeña de un modelo de lenguaje grande y luego hace que una versión más grande verifique las respuestas. Feldman explicó que esto se debe a que cuesta menos energía verificar el resultado de un modelo que producirlo en primer lugar.

Una tercera técnica convierte la salida del modelo en MX6, una versión compilada que necesita sólo la mitad de la memoria que normalmente necesitaría el acelerador Qualcomm AI 100. Por último, el software del WSE-3 utiliza la búsqueda de arquitectura de red para seleccionar un subconjunto de parámetros que se compilarán y ejecutarán en el AI 100, lo que, nuevamente, puede reducir el uso de computación y memoria.

Los cuatro enfoques aumentan en un orden de magnitud el número de «tokens» procesados en el chip de Qualcomm por dólar gastado, dijo Feldman, donde un token puede ser parte de una palabra en una frase o un fragmento de código de computadora para un desarrollador. copiloto.» En inferencia, «el rendimiento es igual al costo», señaló Feldman.

«Reducimos radicalmente la cantidad de tiempo que hay que dedicar a pensar en cómo pasar de los parámetros de entrenamiento a la inferencia de producción al colaborar con Qualcomm y garantizar un flujo de trabajo fluido», afirmó Feldman.

Se espera que el mercado de la inferencia se convierta en un foco mayor de la carrera armamentista en IA a medida que la inferencia pasa de los centros de datos a dispositivos más «periféricos», incluidos servidores empresariales e incluso dispositivos con limitaciones de energía, como los dispositivos móviles.

«Creo que cada vez más, la inferencia fácil llegará al límite y Qualcomm tiene una ventaja real allí», dijo Feldman.