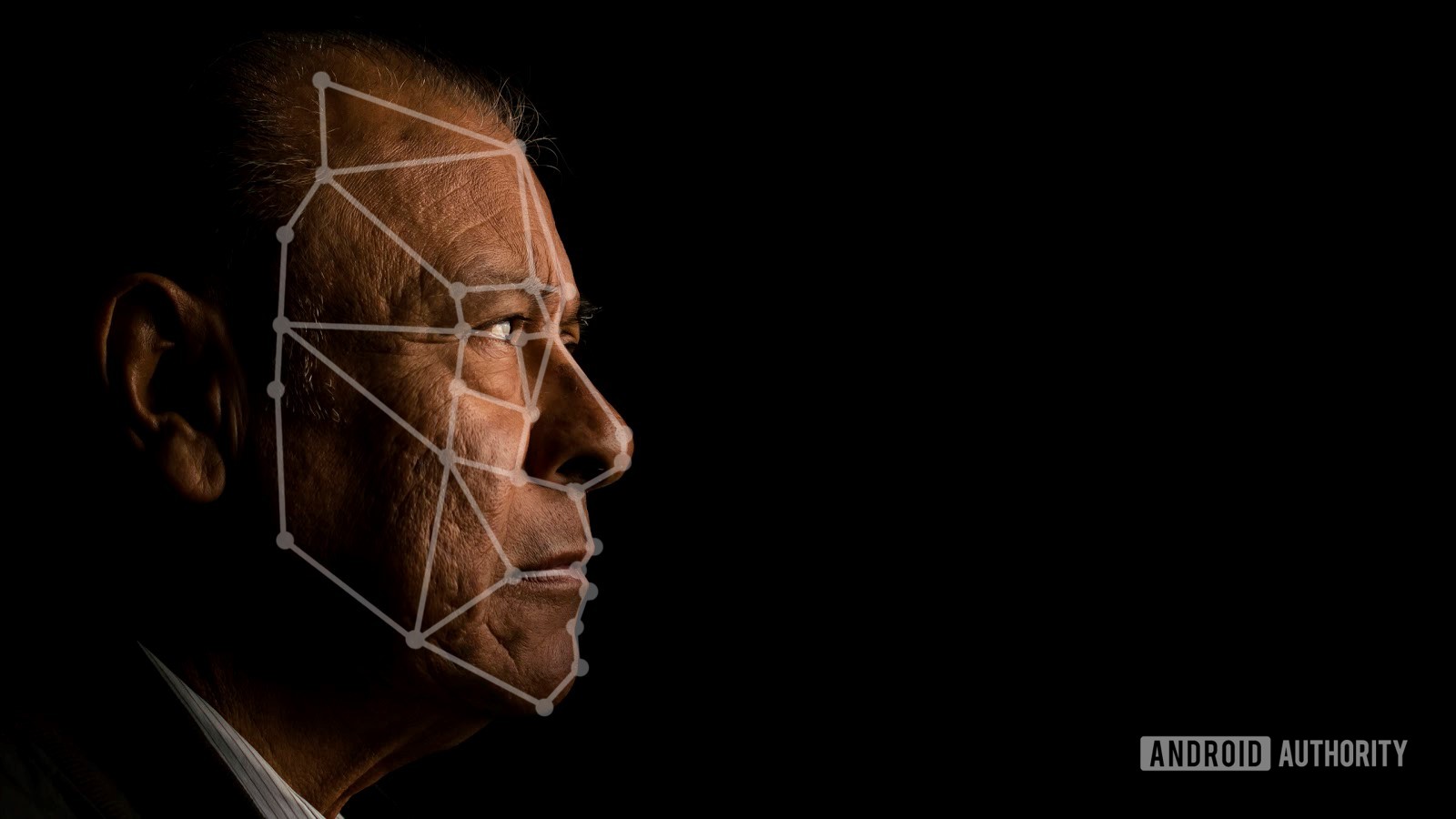

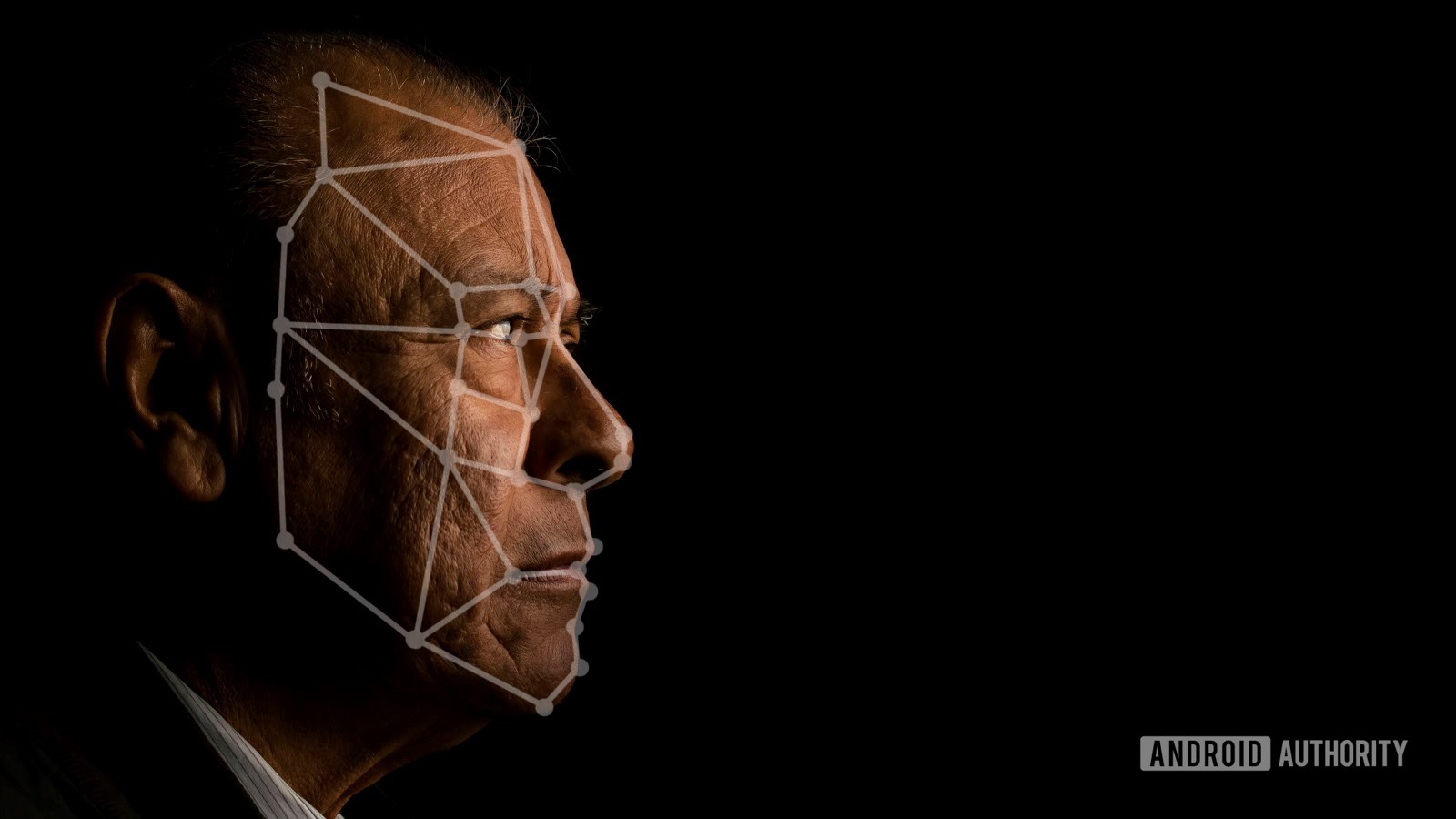

Edgar Cervantes / Autoridad Android

TL;DR

- Microsoft ha desarrollado una nueva herramienta de inteligencia artificial llamada VASA-1 que puede generar videos a partir de una sola imagen y un clip de audio.

- Esta tecnología tiene un potencial increíble para usos positivos, pero también conlleva el riesgo de manipulación dañina.

- Microsoft insiste en que están abordando VASA-1 con precaución, enfatizando la necesidad de regulaciones adecuadas antes de su lanzamiento al público.

IA generativa continúa remodelando nuestro panorama digital con avances aparentemente enormes de vez en cuando, y la última innovación de Microsoft es posiblemente la más innovadora (y desconcertante) hasta ahora.

VASA-1, un modelo de imagen a vídeo, desdibuja la línea entre vídeo real y fabricado. A partir de una sola imagen y un clip de audio, puede generar imágenes sorprendentemente realistas, con movimientos y expresiones de labios realistas.

Microsoft es muy consciente del poder de la tecnología y señala que VASA-1 es «capaz no sólo de producir una preciosa sincronización de audio entre labios sino también de capturar un amplio espectro de emociones y matices faciales expresivos y movimientos naturales de la cabeza que contribuyen a la percepción de realismo y vivacidad.»

El sistema genera vídeo de alta resolución (512×512) a unos impresionantes 45 FPS. Aún más notable es que puede generar videos de caras parlantes realistas a 40 FPS en tiempo real.

Las posibles aplicaciones son tentadoras. Imagine herramientas educativas con figuras históricas realistas que cobran vida o compañeros virtuales que ofrecen apoyo y beneficios terapéuticos. Sin embargo, el potencial de uso indebido es igualmente inmenso, lo que inmediatamente genera preocupaciones sobre la existencia de información altamente convincente. deepfakes capaz de difundir información errónea y socavar la confianza.

Microsoft lo sabe muy bien e insiste en que se trata principalmente de una tarea de investigación, al menos por ahora. La empresa reconoció los riesgos inherentes y afirmó: “… al igual que otras técnicas de generación de contenido relacionadas, aún podría utilizarse indebidamente para hacerse pasar por humanos. Nos oponemos a cualquier comportamiento destinado a crear contenidos engañosos o dañinos de personas reales…”

Afortunadamente, Microsoft sostiene que no lanzará esta potente tecnología prematuramente. Su plan de esperar regulaciones sólidas es tranquilizador y debe convertirse en una norma para el resto de la industria tecnológica.

El ritmo vertiginoso de la innovación hace que predecir el futuro (y las consecuencias de sistemas como VASA-1) sea una tarea desalentadora. Si tal herramienta se hiciera pública, ¿generaría una nueva ola de creatividad y accesibilidad, o alimentaría una creciente marea de desconfianza y manipulación? Háganos saber su opinión en los comentarios a continuación.