Opinión del editor: Como casi todos los profesionales de la tecnología hoy en día, pasamos el año pasado tratando de entender la «IA». Qué es, cómo funciona y qué significa para la industria. No estamos seguros de tener buenas respuestas, pero algunas cosas han quedado claras. Tal vez surja la AGI (inteligencia general artificial), o veamos algún otro avance importante en la IA, pero centrarse demasiado en esos riesgos podría ser pasar por alto las mejoras muy reales, pero también muy mundanas, que las redes de transformadores ya están brindando.

Parte de la dificultad de escribir este artículo es que estamos atrapados en una especie de dilema. Por un lado, no queremos desestimar los avances de la IA. Estos nuevos sistemas son logros técnicos importantes, no son juguetes sólo aptos para generar imágenes de lindos gatitos vestidos al estilo de los maestros holandeses contemplando un plato de fruta como en la imagen que se muestra a continuación (generado por Microsoft Copilot). No deberían descartarse fácilmente.

Nota del editor:

Autor invitado Jonathan Goldberg es el fundador de D2D Advisory, una firma de consultoría multifuncional. Jonathan ha desarrollado estrategias de crecimiento y alianzas para empresas de las industrias de telefonía móvil, redes, juegos y software.

Por otro lado, la abrumadora mayoría de los comentarios públicos sobre la IA son tonterías. Ninguna de las personas con las que hemos hablado que trabaja hoy en este campo piensa que estamos en la cúspide de la Inteligencia General Artificial (AGI). Quizás estemos a sólo un paso de distancia, pero no podemos encontrar a nadie que realmente crea que eso es probable. A pesar de esto, los medios de comunicación en general están llenos de todo tipo de historias que combinan la IA generativa y la AGI, con todo tipo de opiniones descabelladas y sin fundamento sobre lo que esto significa.

Dejando a un lado todo el ruido, y hay mucho ruido, lo que hemos visto durante el año pasado ha sido el aumento de las redes neuronales basadas en Transformer. Hemos estado utilizando sistemas probabilísticos en computación durante años y los transformadores son un método mejor o más económico para realizar esa computación.

Esto es importante porque abre el espacio de problemas que podemos abordar con nuestras computadoras. Hasta ahora, esto ha recaído en gran medida en el ámbito del procesamiento del lenguaje natural y la manipulación de imágenes. Estos son importantes, a veces incluso útiles, pero se aplican a lo que todavía es una parte bastante pequeña de la experiencia del usuario y las aplicaciones. Las computadoras que puedan procesar eficientemente el lenguaje humano serán muy útiles, pero no equivalen a algún tipo de avance informático universal.

Esto no significa que la «IA» sólo proporcione una pequeña cantidad de valor, pero sí significa que gran parte de ese valor se obtendrá de formas bastante mundanas. Creemos que este valor debería dividirse en dos categorías: experiencias de IA generativa y mejoras de bajo nivel en el software.

Tomemos como ejemplo lo último: mejoras en el software. Esto suena aburrido (lo es), pero eso no significa que carezca de importancia. Todas las principales empresas de software e Internet de la actualidad están incorporando transformadores a sus pilas. En su mayor parte, esto pasará totalmente desapercibido para los usuarios.

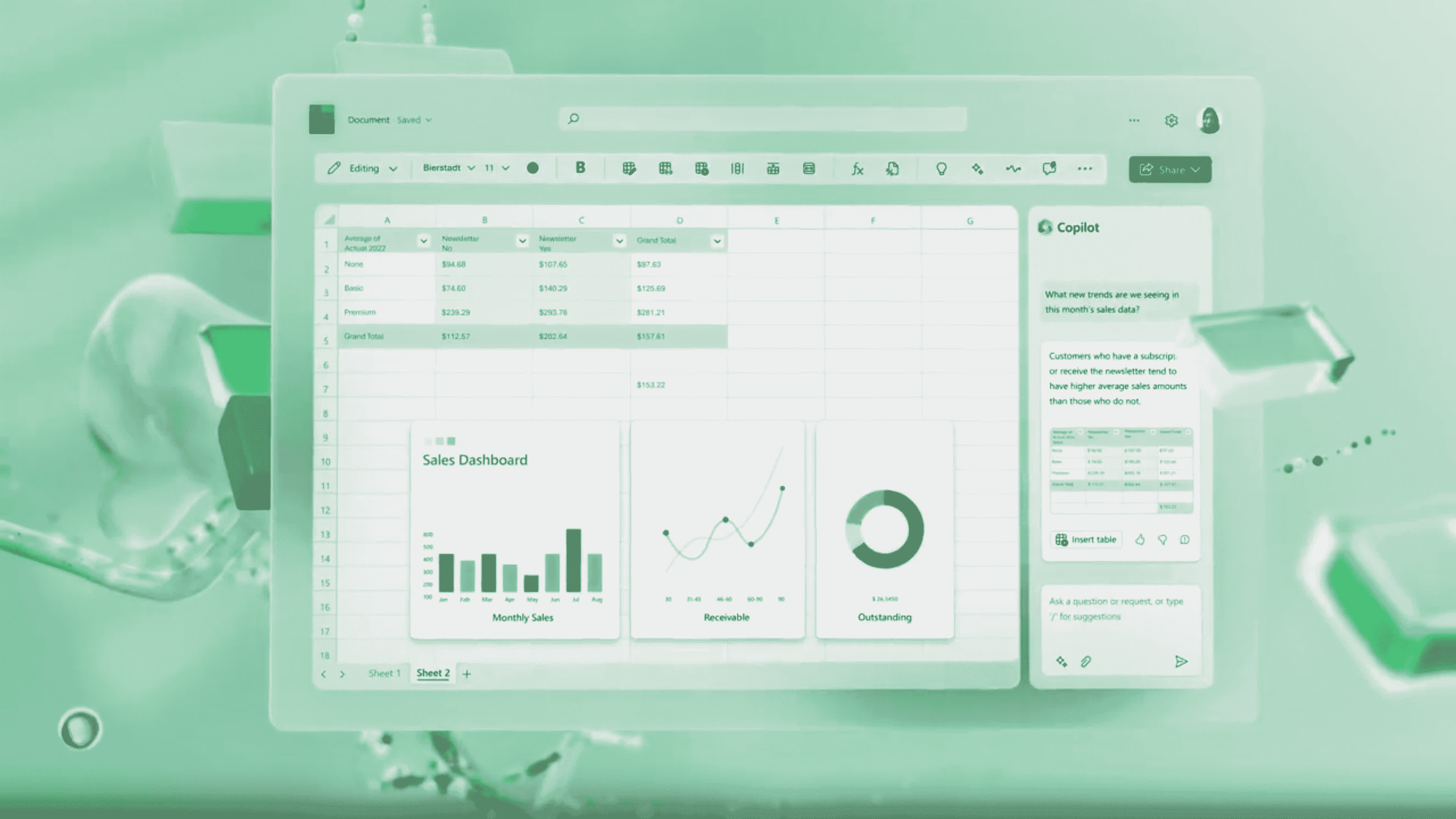

Imaginamos que Microsoft puede tener algunas funciones realmente interesantes para agregar a MS Word, PowerPoint y Visual Basic. Claro, adelante e impresionarnos con AI Excel. Pero eso es una gran esperanza para una empresa que no es muy conocida por ofrecer excelentes interfaces de usuario.

Las empresas de seguridad pueden mejorar un poco sus productos a la hora de detectar amenazas. Los sistemas CRM pueden mejorar un poco a la hora de hacer coincidir las solicitudes de los usuarios con resultados útiles. Empresas de chips mejorará la predicción de la rama del procesador en cierta medida. Todas estas son pequeñas ganancias, aumentos del 10% o 20% en el rendimiento o reducciones en los costos. Y eso está bien, sigue siendo un valor tremendo cuando se combina con todo el software que existe. Por el momento, creemos que la gran mayoría de los avances de la «IA» se producirán en estas formas sencillas pero útiles.

La IA generativa puede resultar más importante. Tal vez. Parte del problema que tenemos hoy en este campo es que gran parte de la industria tecnológica está esperando a ver qué harán los demás en este frente.

En todos sus comentarios públicos recientes, todas las principales empresas de procesadores han señalado la próxima actualización de IA de Microsoft como un importante catalizador para la adopción de semis de IA. Imaginamos que Microsoft puede tener algunas funciones realmente interesantes para agregar a MS Word, PowerPoint y Visual Basic. Claro, adelante e impresionarnos con AI Excel. Pero eso es mucha esperanza para aferrarse a una sola empresa, especialmente una empresa como Microsoft que no es muy conocida por ofrecer excelentes interfaces de usuario.

Por su parte, Google parece ser un ciervo en el foco cuando se trata de transformadores, algo irónico dado que ellos los inventaron. A fin de cuentas, todo el mundo está realmente esperando que Apple nos muestre cómo hacerlo bien. Hasta ahora, se han mantenido notablemente silenciosos respecto de la IA generativa. Tal vez estén tan confundidos como todos los demás, o tal vez simplemente no vean la utilidad todavía.

Apple lleva años teniendo procesadores neuronales en sus teléfonos. Fueron muy rápidos en agregar soporte para transformadores a las CPU de la serie M. No parece correcto decir que se están quedando atrás en IA, cuando tal vez simplemente estén al acecho.

Volviendo a los semiconductores, puede resultar tentador generar grandes expectativas y elaborar escenarios sobre todas las formas en que la IA impulsará nuevos negocios. De ahí la creciente cantidad de comentarios sobre las PC con IA y el mercado de semiconductores de inferencia. No estamos convencidos no está claro que ninguna de esas empresas realmente podremos construir mercados masivos en estas áreas.

En cambio, tendemos a ver la llegada de los sistemas de IA basados en transformadores en términos mucho más simples. El auge de los transformadores parece significar en gran medida una transferencia de influencia y captura de valor a Nvidia a expensas de Intel en el centro de datos. AMD puede hacerse con su parte de esta transferencia, y tal vez Intel pueda organizar el regreso de todos los regresos, pero en el futuro previsible no hay necesidad de complicar las cosas.

Dicho esto, tal vez estemos entendiendo todo mal. Tal vez haya grandes ganancias flotando por ahí, algún avance importante de un laboratorio de investigación o de la puesta en marcha de un preproducto deca-unicornio. No eliminaremos esa posibilidad. Nuestro punto aquí es simplemente que ya estamos viendo ganancias significativas de los transformadores y otros sistemas de inteligencia artificial. Todas esas mejoras «ocultas» en el software ya son significativas, y no deberíamos angustiarnos esperando que surja algo aún mayor.

Algunos dirían que la IA es una moda pasajera, la próxima burbuja a punto de estallar. Somos más optimistas que eso, pero vale la pena pensar en cuál podría ser el caso negativo para las semifinales de IA…

Somos bastante optimistas sobre las perspectivas de la IA, aunque en algunos lugares decididamente mundanos. Pero todavía estamos en los primeros días de esta transición, con muchas incógnitas. Somos conscientes de que entre algunos inversores existe una tendencia a pensar que estamos en una «burbuja de IA», y la versión dura de esa tesis sostiene que la IA es sólo una moda pasajera, y una vez que la burbuja se desinfle, el mercado de semifinales volverá a ser el status quo de hace dos años.

En algún punto entre los extremos de la IA es tan poderosa que acabará con la raza humana y la IA es un juguete inútil, se encuentra un inconveniente mucho más leve para los semiconductores.

Hasta donde podemos evaluar en este momento, el consenso parece sostener que el mercado de semis con IA se sumará modestamente a la demanda general. Las empresas seguirán necesitando gastar miles de millones en CPU y computación tradicional, pero ahora necesitarán capacidades de IA que requerirán la compra de GPU y aceleradores.

En el centro de este caso está el mercado de semis de inferencia. A medida que los modelos de IA se generalicen, la mayor parte de la demanda de IA caerá en esta área, lo que de hecho hará que la IA sea útil para los usuarios. Hay algunas variaciones dentro de este caso. Parte de la demanda de CPU desaparecerá con la transición a la IA, pero no mucho en juego. Y los inversores pueden debatir cuánta inferencia se realizará en la nube versus en el borde, y quién pagará ese gasto de capital. Pero éste es esencialmente el caso base. Bien por Nvidia, ya que queda mucho mercado de inferencia para todos los demás en un mercado en crecimiento.

El caso negativo realmente se presenta de dos formas. El primero se centra en el tamaño de ese mercado de inferencia. Como hemos mencionado varias veces, no está claro cuánta demanda habrá de semifinales de inferencia. El problema más evidente está en el borde. Por mucho que los usuarios de hoy parezcan cautivados por la IA generativa, dispuestos a pagar más de $20 al mes para acceder a lo último de OpenAI, los argumentos a favor de realizar esa IA generativa en el dispositivo no están claros.

La gente pagará por OpenAI, pero ¿realmente pagarán otro dólar más para ejecutarlo en su dispositivo en lugar de en la nube? ¿Cómo podrán siquiera notar la diferencia? Es cierto que existen razones legítimas por las que las empresas no querrían compartir sus datos y modelos con terceros, lo que requeriría inferencia en el dispositivo. Por otro lado, esto parece un problema resuelto por un grupo de abogados y un acuerdo de licencia redactado de forma estricta, que seguramente es mucho más asequible que construir un montón de bastidores de servidores GPU (si es que es posible encontrar alguno para comprar).

Todo lo cual significa que empresas como AMD, Intel y Qualcomm, que generan grandes expectativas para la IA en los dispositivos, tendrán dificultades para cobrar una prima por sus procesadores preparados para IA. En su última llamada de resultados, el CEO de Qualcomm planteó el caso de Snapdragon listo para IA como un impulso positivo para el cambio de combinación, que es una forma educada de decir aumentos de precios limitados para un pequeño subconjunto de productos.

El mercado de la inferencia en la nube debería ser mucho mejor, pero incluso en este caso existen dudas sobre el tamaño del mercado. ¿Qué pasa si los modelos se reducen lo suficiente como para poder ejecutarse bastante bien en CPU? Esto es técnicamente posible, la preferencia por GPU y aceleradores es en esencia un caso económico, pero cambie algunas variables y, para muchos casos de uso, la inferencia de CPU probablemente sea lo suficientemente buena para muchas cargas de trabajo. Esto sería catastrófico, o al menos muy malo, para las expectativas de todos los fabricantes de procesadores.

Probablemente el escenario más aterrador es aquel en el que la IA generativa se desvanece como producto de consumo. Útil para programar y crear correos electrónicos no deseados atractivos, pero poco más. Este es el verdadero argumento bajista para Nvidia, no algunas ganancias nominales de participación por parte de AMD, sino la falta de casos de uso convincentes. Es por eso que nos pone nerviosos el grado en que todos los fabricantes de procesadores parecen tan dependientes de la próxima actualización de Windows de Microsoft para despertar el interés de los consumidores en la categoría.

En última instancia, creemos que el mercado de semis con IA seguirá creciendo, impulsando una demanda saludable en toda la industria. Probablemente no tanto como algunas esperanzas, pero lejos de ser el peor de los casos, el bando de que «la IA es una moda pasajera».

Se necesitarán algunos ciclos más para encontrar casos de uso interesantes para la IA, y no hay razón para pensar que Microsoft sea la única empresa que puede innovar en este sentido. Todo lo cual nos coloca firmemente en medio de las expectativas: la demanda estructural a largo plazo crecerá, pero habrá altibajos antes de llegar allí, y probablemente no haya zombis post-apocalípticos de los que preocuparnos.