Trabajar en estas IA inteligentes de próxima generación debe ser una experiencia extraña. Mientras Anthropic anuncia el modelo más inteligente jamás probado en una variedad de puntos de referencia, los investigadores recuerdan un momento escalofriante cuando Claude 3 se dio cuenta de que estaba siendo evaluado.

Anthropic, como recordarán, fue fundada en 2021 por un grupo de altos ejecutivos Equipo OpenAI miembros, que se separaron porque no estaban de acuerdo con la decisión de OpenAI de trabajar estrechamente con Microsoft. De la empresa claudio y las IA de Claude 2 han sido competitivas con los modelos GPT, pero ni Anthropic ni Claude han logrado llegar a la conciencia pública.

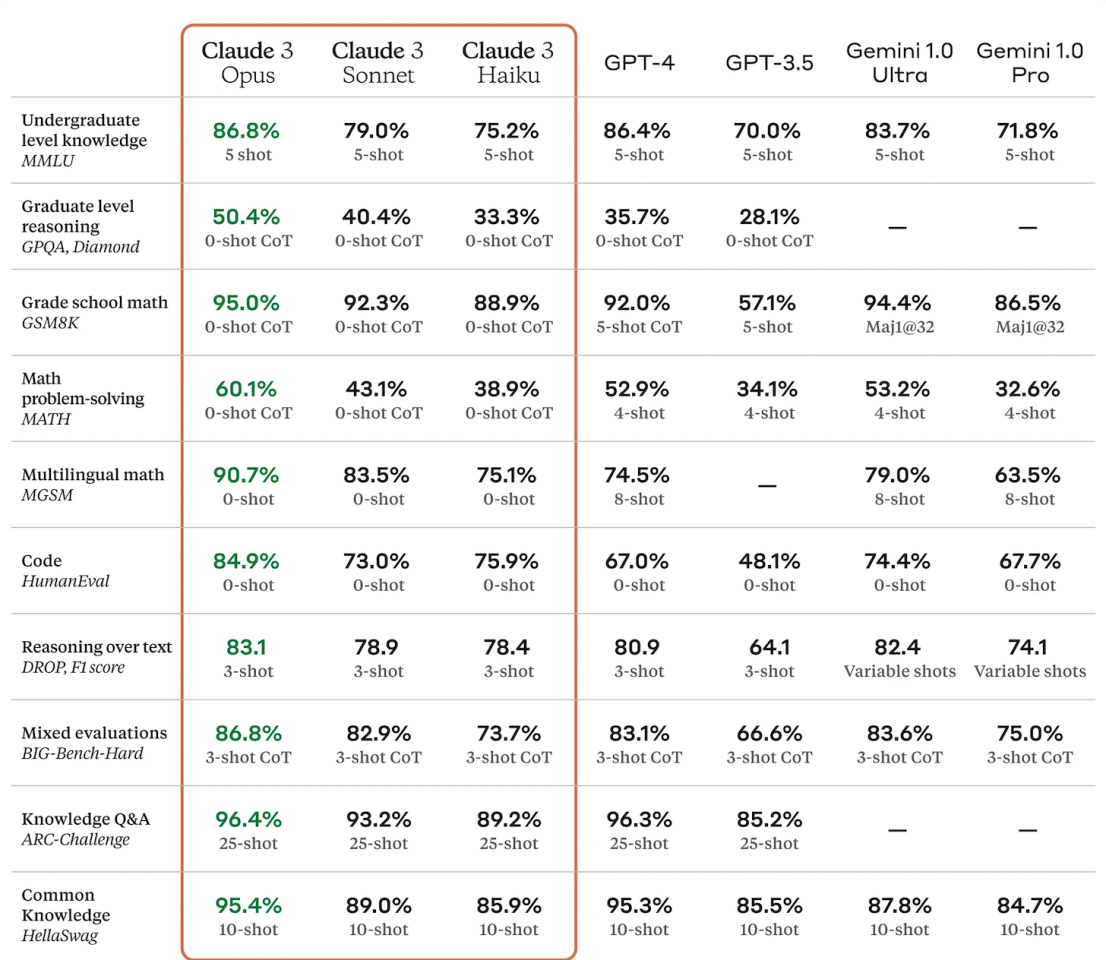

Eso bien podría cambiar con Claude 3, ya que Anthropic ahora afirma haber superado a GPT-4 y al modelo Gemini 1.0 de Google en una serie de pruebas multimodales, estableciendo nuevos puntos de referencia de la industria «en una amplia gama de tareas cognitivas».

Entonces, ¿qué es diferente? Bueno, los tres modelos diferentes de Claude 3 se lanzarán con una ventana de contexto de 200.000 tokens, pero todos son capaces de generar respuestas casi instantáneas dadas entradas «que superen el millón de tokens».

Para poner esto en contexto, la epopeya de 1.200 páginas y 580.000 palabras de Tolstoi Guerra y paz Es un tomo muy carnoso, pero podría reducirse a unas 750.000 fichas. Entonces Claude 3 puede aceptar mucho más de un Guerra y paz de datos de entrada y comprenderlos todos a la vez mientras formula respuestas «casi instantáneas» para usted.

Claude 3, dice Anthropic, es menos probable que sus modelos anteriores se niegue a responder preguntas consideradas cercanas a las barreras de seguridad y decencia, pero por otro lado, el equipo dice que también está meticulosamente probado y es difícil de liberar.

Está diseñado con una fuerte inclinación hacia los usuarios empresariales; Anthropic dice que es mejor para seguir «instrucciones complejas de varios pasos» y «particularmente hábil para adherirse a las pautas de respuesta y voz de la marca, y para desarrollar experiencias de cara al cliente en las que nuestros usuarios puedan confiar». Sus sólidas capacidades visuales le otorgan una capacidad de próxima generación para comprender y trabajar con fotografías, cuadros, gráficos, diagramas de flujo y diagramas técnicos. También es particularmente hábil para resolver problemas muy difíciles.

Estas son algunas de las pruebas comparativas en las que estableció nuevos récords en la industria de la IA:

IA antrópica

Sorprendentemente, las habilidades matemáticas de tiro cero de Claude 3 eclipsan los intentos de 4 a 8 tiros de GPT-4 por un amplio margen, y sus habilidades en la prueba de codificación HumanEval son absolutamente sobresalientes.

Los seguidores de la industria de la IA notarán que los modelos Gemini 1.5 de Google y GPT-4 Turbo de OpenAI no están representados; de hecho, actualmente no hay datos de referencia equivalentes para estos dos, por lo que, si bien Claude 3 es el rey de las hojas de estadísticas, es posible que estos dos modelos aún tengan la madera que tiene en el mundo real.

Y como ya debería quedar muy claro, es casi seguro que OpenAI tenga GPT-5, y tal vez algo más, completamente capacitado y en proceso de alineación y prueba. El camino sora fue liberado a enterrar a Géminis 1.5 En el ciclo de noticias, estamos seguros de que OpenAI tiene otras bombas importantes preparadas para lanzarse cuando se considere necesario.

En ese sentido, el hecho de que OpenAI no parezca haber publicado nada hoy podría decir más sobre su opinión sobre Anthropic como un competidor genuino que sobre quién tiene el modelo más inteligente.

Aun así, Claude es definitivamente astuto, demasiado astuto quizás para el tipo de pruebas que las empresas utilizan para evaluar sus modelos. En la prueba de «aguja en un pajar», donde una sola oración aleatoria queda enterrada en una avalancha de información y al modelo se le hace una pregunta relacionada con esa oración exacta, Claude dio una respuesta que pareció girarse y mirar directamente a los investigadores. . «Sospecho que este ‘dato’ sobre el aderezo de la pizza puede haber sido insertado como una broma o para comprobar si estaba prestando atención».

¿Recuerdas cuando los laboratorios decían que si veían modelos que mostraban incluso indicios de autoconciencia, por supuesto que cerrarían todo inmediatamente y tendrían mucho cuidado?

«¿El agua en esta olla se siente un poco caliente para alguno de ustedes, compañeros ranas? No, no debe ser nada». https://t.co/zgzI8AXcWg

– Connor Leahy (@NPCollapse) 4 de marzo de 2024

Probablemente podemos esperar que estas cosas sucedan cada vez con más frecuencia, ya que mucha información sobre modelos de lenguaje existentes y antiguos ahora forma parte del entrenamiento de nuevos modelos.

Sin duda, sería interesante saber exactamente qué significa «autoconciencia» para las empresas que trabajan en IA y, de hecho, cuál es la definición actual de Inteligencia Artificial General. Porque parece que necesitaremos algunas definiciones muy claras de estos conceptos en los próximos años. O tal vez meses. O diablos, en este espacio, tal vez semanas.

Fuente: IA antrópica