Increíblemente rápido: Los servicios de IA generativa pueden producir un mosaico visual de alta calidad, pero suelen ser bastante lentos. Investigadores del MIT y Adobe han desarrollado una posible solución a este problema que requiere mucho tiempo, con un nuevo método de generación de imágenes súper rápido con un impacto mínimo en la calidad. La técnica genera unas 20 imágenes por segundo.

La IA de generación de imágenes normalmente emplea un proceso conocido como difusión, que refina la salida visual a través de varios pasos de muestreo para alcanzar el resultado final, con suerte «realista». Los investigadores dicen que los modelos de difusión pueden generar imágenes de alta calidad, pero requieren docenas de pases hacia adelante.

Los expertos de Adobe Research y el MIT están introduciendo una técnica llamada «destilación coincidente de distribución» (DMD). Este procedimiento reduce un modelo de difusión de varios pasos a una solución de generación de imágenes de un solo paso. El modelo resultante puede generar imágenes comparables a los modelos de difusión «tradicionales» como Stable Diffusion 1.5, pero en órdenes de magnitud más rápido.

«Nuestra idea central es entrenar dos modelos de difusión para estimar no sólo la función de puntuación de la distribución real objetivo, sino también la de la distribución falsa», se lee en el estudio del equipo.

Los investigadores afirman que su modelo puede generar 20 imágenes por segundo en hardware GPU moderno.

El breve vídeo de arriba destaca la generación de imágenes de DMD en comparación con Stable Diffusion 1.5. Mientras que SD necesita 1,4 segundos por imagen, DMD puede generar una imagen similar en una fracción de segundo. Existe un equilibrio entre calidad y rendimiento, pero los resultados finales están dentro de límites aceptables para el usuario medio.

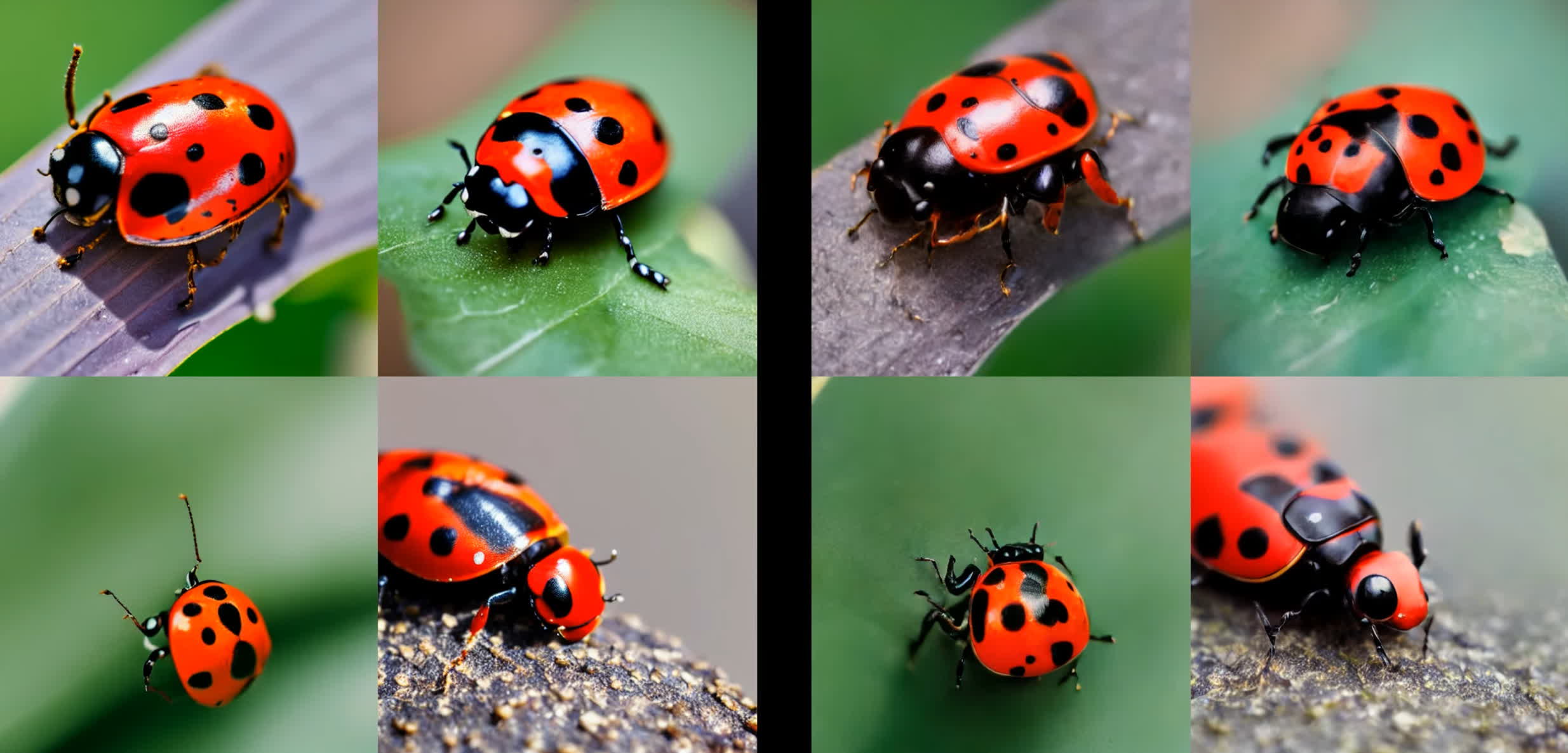

Los equipos publicación del nuevo método de renderizado muestra ejemplos adicionales de resultados de imágenes producidos con DMD. Compara Stable Diffusion y DMD al mismo tiempo que proporciona el mensaje textual más importante que generó las imágenes. Los temas incluyen un perro enmarcado a través de lentes DSLR virtuales, la cordillera de los Dolomitas, un ciervo mágico en un bosque, una representación 3D de un loro bebé, unicornios, barbas, automóviles, gatos e incluso más perros.

La destilación por coincidencia de distribución no es el primer método de un solo paso jamás propuesto para la generación de imágenes asombrosas de IA. Estabilidad IA desarrollado una técnica conocida como Destilación por Difusión Adversaria (ADD) para generar imágenes de 1 megapíxel en tiempo real. La compañía entrenó su modelo SDXL Turbo a través de ADD, logrando velocidades de generación de imágenes de solo 207 ms en un único acelerador GPU Nvidia A100 AI. ADD de Stability emplea un enfoque similar al DMD del MIT.