¿Lo que acaba de suceder? En su conferencia Vision 2024 en Phoenix, Arizona, Intel presentó el acelerador de IA Gaudi 3 que, según la compañía, ofrecerá un rendimiento un 50 por ciento mejor en tareas de inferencia que el H100 de Nvidia. El Gaudi 3 fue objeto de burlas en el evento AI Everywhere de Intel en diciembre de 2023, donde el director ejecutivo de la compañía, Pat Gelsinger, dijo que pronto estaría disponible para competir con la Nvidia H100 y AMD MI300.

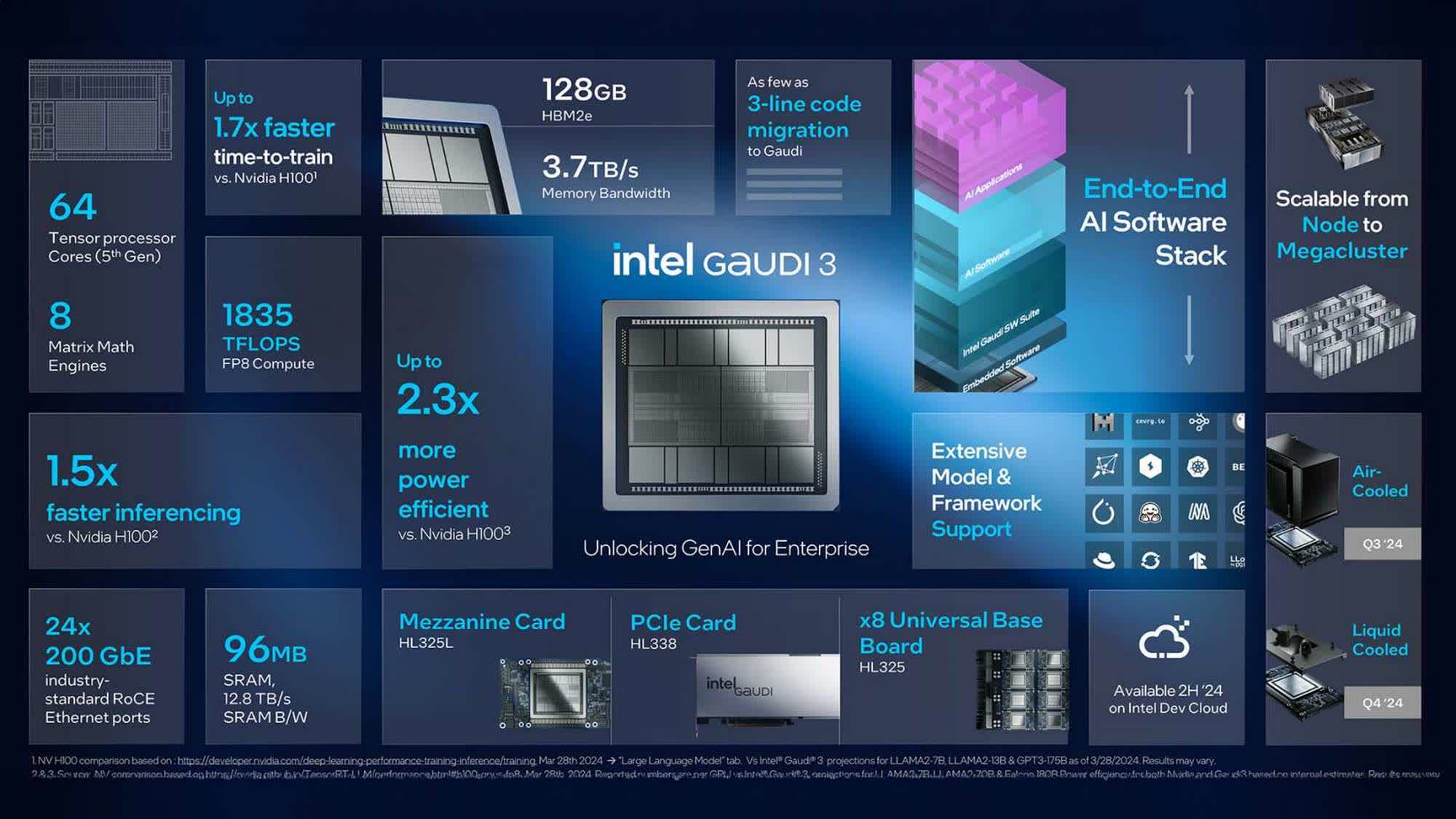

El nuevo chip, que sucede al Gaudi 2, combina dos matrices TSMC de 5 nm y cuenta con 64 núcleos Tensor de quinta generación, 128 GB de memoria HBM2e a 3,7 Gbps y un ancho de banda de 3,7 TB por segundo. Los números sugieren mejoras sustanciales con respecto al Gaudi 2, que venía con 24 núcleos Tensor, 96 GB de memoria HBM2e a 3,27 Gbps y 2,45 TB/s de ancho de banda. El Gaudi 3 también incluye 96 MB de SRAM con un ancho de banda de 12,8 TB/s.

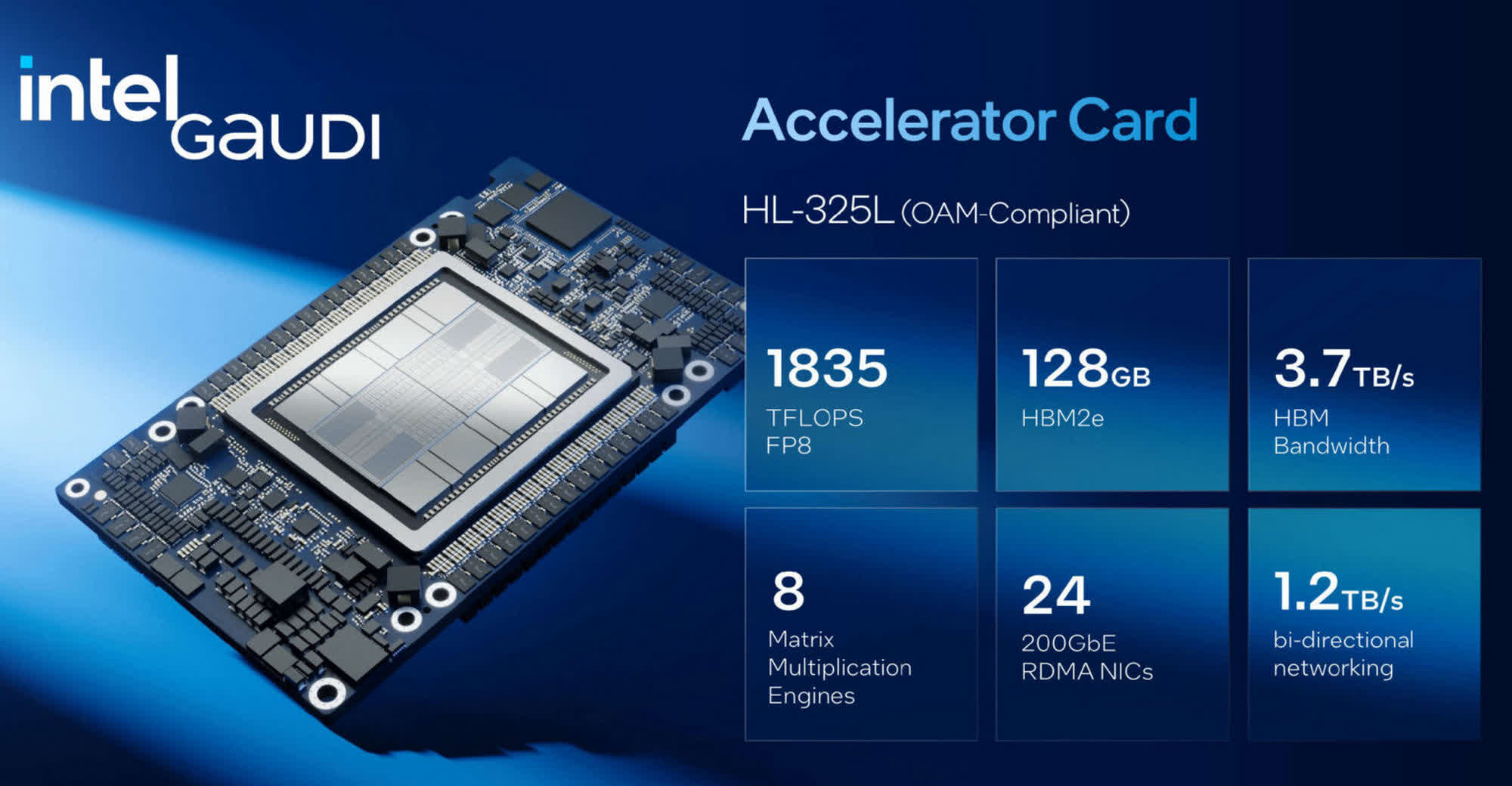

Otras especificaciones críticas incluyen 128 GB de VRAM, 1835 TFLOPS de rendimiento en matriz FP8 y BF16 y 900 vatios de consumo de energía en el aire. En comparación, Gaudi 2 tiene 96 GB de VRAM, ofrece 835 TFLOPS en FP8 Matrix, 432 TFLOPS en BF16 Matrix y consume 600 W de potencia.

Además, cada acelerador Gaudi 3 incluye veinticuatro puertos Ethernet de 200 Gb para proporcionar una red estándar abierta y flexible. También viene con una tarjeta complementaria PCIe que, según la compañía, ayudará en cargas de trabajo como el ajuste fino, la inferencia y la generación aumentada de recuperación (RAG).

De acuerdo a Intelel chip Gaudi de tercera generación ofrecerá 4x computación de IA para BF16, un aumento de 1,5x en el ancho de banda de memoria y 2x de ancho de banda de red en comparación con su predecesor, ofreciendo así «mejoras significativas de rendimiento» para tareas de entrenamiento e inferencia en los principales modelos GenAI.

Al comparar el Gaudi 3 con el Nvidia H100, Intel afirmó que su último acelerador de IA es un 50 por ciento más rápido en los parámetros Llama2 7B y 13B, y en los modelos de parámetros GPT-3 175B. También se dice que ofrece una inferencia un 50 por ciento más rápida y una eficiencia energética de inferencia un 40 por ciento mayor en los parámetros Llama 7B y 70B, y en los modelos de parámetros Falcon 180B.

Intel agrega que Gaudi 3 ofrecerá una inferencia un 30 por ciento más rápida en los parámetros Llama 7B y 70B, y en los modelos de parámetros Falcon 180B en comparación con la Nvidia H200. Los puntos de referencia proporcionados por Team Blue también sugieren que Gaudi 3 será entre un 40 y un 70 por ciento más rápido para el entrenamiento de IA que el H100, dependiendo del LLM, pero aún está por verse cómo se desempeña en la vida real.

Las primeras muestras del Gaudi 3 ya se están proporcionando a los socios de Intel, y la disponibilidad de la producción en volumen está prevista para el segundo semestre de este año. Según la hoja de ruta de Intel, las variantes refrigeradas por aire del Gaudi 3 comenzarán a enviarse en el tercer trimestre de 2024, mientras que los modelos refrigerados por líquido solo comenzarán a salir en el cuarto trimestre.