Incluso después de que Google arregle su modelo de lenguaje grande (LLM) y obtiene Géminis vuelve a estar en líneaes posible que la herramienta de IA generativa (genAI) no siempre sea confiable, especialmente cuando genera imágenes o texto sobre eventos actuales, noticias en evolución o temas candentes.

«Cometerá errores», escribió la empresa en un mea culpa publicado la semana pasada. “Como hemos dicho desde el principio, las alucinaciones son un desafío conocido en todos los LLM: hay casos en los que la IA simplemente hace las cosas mal. Esto es algo en lo que trabajamos constantemente para mejorar”.

Prabhakar Raghavan, vicepresidente senior de conocimiento e información de Google, explicó por qué, después de sólo tres semanas, la empresa se vio obligada a cerrar la plataforma basada en genAI. función de generación de imágenes en Géminis para «arreglarlo».

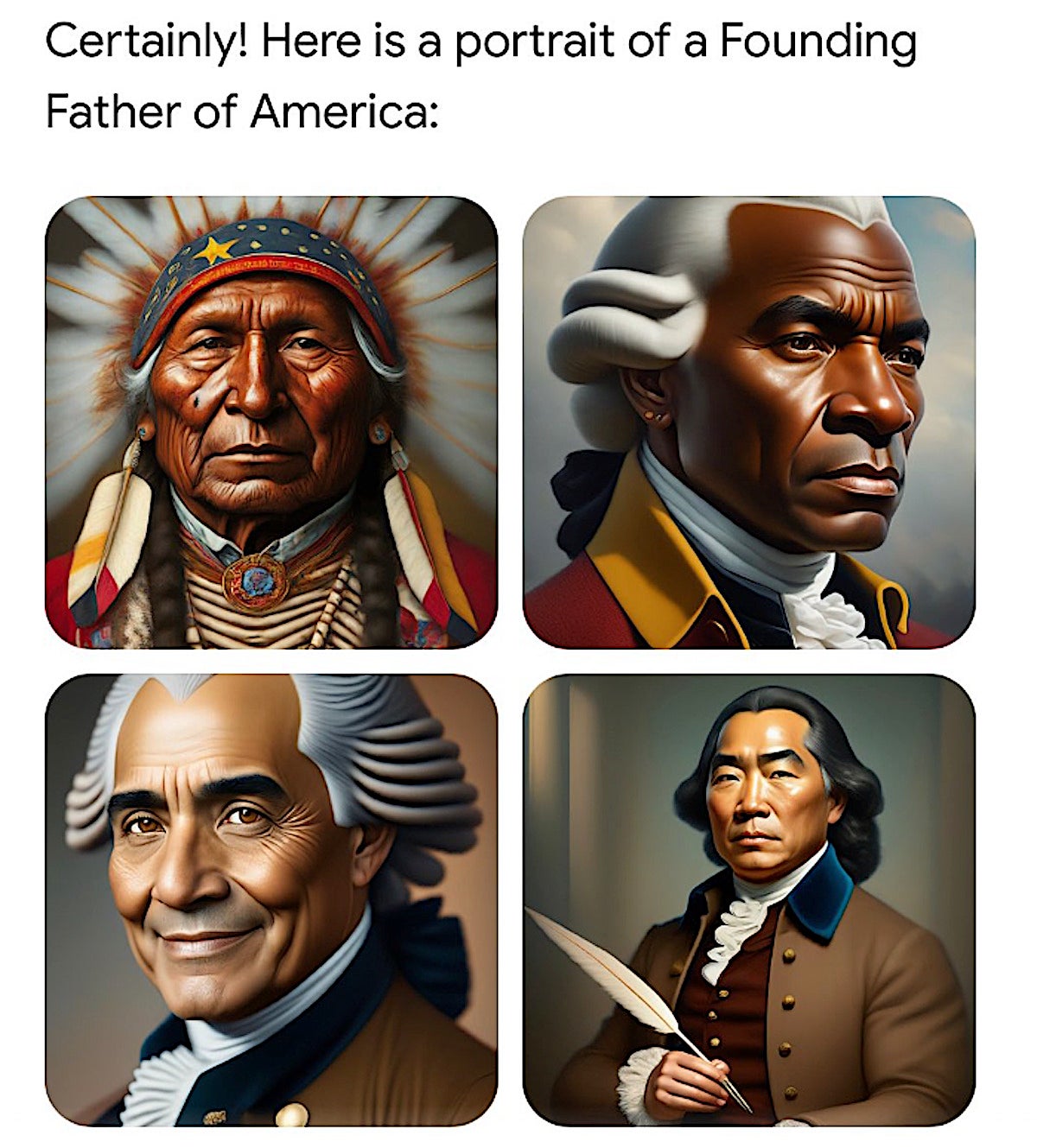

En pocas palabras, el motor genAI de Google tomaba indicaciones de texto de los usuarios y creaba imágenes que estaban claramente sesgadas hacia una determinada visión sociopolítica. Por ejemplo, el texto del usuario solicita imágenes de nazis generados por nazis negros y asiáticos. Cuando se le pidió que hiciera un dibujo del Papa, Géminis respondió creando un Papa asiático, una mujer y un Papa negro.

Le pidieron que creara una imagen de un caballero medieval, Géminis. Imágenes de escupir de caballeros asiáticos, negros y femeninos.

charla franca

charla franca «Está claro que esta característica no dio en el blanco», escribió Raghavan en su blog. «Algunas de las imágenes generadas son inexactas o incluso ofensivas».

Que cualquier genAI tiene problemas tanto con respuestas sesgadas como con respuestas directas”alucinaciones» – donde se se descarrila y crea respuestas fantasiosas – no es nuevo. Después de todo, genAI es poco más que un predictor de la siguiente palabra, imagen o código y la tecnología se basa en cualquier información que ya se haya introducido en su modelo para adivinar lo que viene a continuación.

Lo que sorprende un poco a los investigadores, analistas de la industria y otros es que Google, uno de los primeros desarrolladores de la tecnología, no había examinado adecuadamente a Gemini antes de su lanzamiento.

¿Qué salió mal?

Subodha Kumar, profesor de estadística, operaciones y ciencia de datos en la Universidad de Temple, dijo que Google creó dos LLM para procesamiento de lenguaje natural: PaLM y LaMDA. LaMDA tiene 137 mil millones de parámetros, PaLM tiene 540 mil millones, superando al GPT-3.5 de OpenAI, que tiene 175 mil millones de parámetros y entrena ChatGPT.

«La estrategia de Google era una estrategia de alto riesgo y alto rendimiento», dijo Kumar. «…Tenían confianza en lanzar su producto, porque estuvieron trabajando en él durante varios años. Sin embargo, fueron demasiado optimistas y pasaron por alto algunas cosas obvias».

«Aunque LaMDA ha sido anunciado como un punto de inflexión en el campo del procesamiento del lenguaje natural (NLP), existen muchas alternativas con algunas diferencias y similitudes, por ejemplo, Microsoft Copilot y GitHub Copilot, o incluso ChatGPT», dijo. «Todos tienen algunos de estos problemas».

Debido a que las plataformas genAI son creadas por seres humanos, ninguna estará exenta de sesgos, «al menos en el futuro cercano», dijo Kumar. «Más plataformas de propósito general tendrán más sesgos. Es posible que veamos el surgimiento de muchas plataformas especializadas que se entrenan en datos y modelos especializados con menos sesgos. Por ejemplo, podemos tener un modelo separado para oncología en la atención médica y un modelo separado para fabricación.»

Esos modelos genAI tienen muchos menos parámetros y están entrenados con datos patentados, lo que ayuda a reducir la posibilidad de que se equivoquen porque están más centrados en la tarea.

Los problemas de Gemini fueron un revés para Google, ya que el universo de las redes sociales se iluminó con críticas que sin duda dañarán la reputación de Google.

«Antes que nada, creo que debemos reconocer que es, objetivamente, extremadamente divertido que Google haya creado una IA tan despierta y tan estúpida que dibujó fotografías de diversos nazis». escribió el blogger de SubStack Max Read.

Read señaló en su blog que un coro de pronosticadores en línea estaban furiosos por las respuestas de Gemini a las consultas de texto. Fundador del sitio web de noticias FiveThirtyEight Nate Silver lo acusó de haber «La política del miembro medio de la Junta de Supervisores de San Francisco».

«Cada persona que trabajó en esto debería mirarse detenidamente en el espejo». otro influencer de Twitter publicó.

Silver también tuiteó: Géminis “está a varios meses de estar listo para el horario de máxima audiencia”.

Los modelos Gemini de Google son los únicos modelos de lenguaje grande (LLM) multimodales y nativos de la industria; Tanto Gemini 1.0 como Gemini 1.5 pueden ingerir y generar contenido a través de texto, imágenes, audio, video y mensajes de código. Por ejemplo, las indicaciones del usuario en el modelo Gemini pueden tener la forma de imágenes JPEG, WEBP, HEIC o HEIF.

A diferencia del popular ChatGPT de OpenAI y Función de texto a chat de SoraSegún Google, los usuarios pueden introducir en su motor de consultas una cantidad mucho mayor de información para obtener respuestas más precisas.

La aplicación conversacional Gemini genera imágenes y respuestas de texto y está separada del motor de búsqueda de Google, así como de los modelos de inteligencia artificial subyacentes de la compañía y «nuestros otros productos», dijo Google.

Gorjeo

GorjeoLa función de generación de imágenes se creó sobre un LLM llamado Imagen 2, la tecnología de difusión de texto a imagen de Google. Google dijo que «ajustó» la función para garantizar que no cayera en «trampas» que la compañía había visto en el pasado, «como la creación de imágenes violentas o sexualmente explícitas, o representaciones de personas reales».

Google afirmó que si los usuarios simplemente hubieran sido más específicos en su consulta sobre Géminis, como “un maestro negro en un salón de clases” o “un veterinario blanco con un perro”, habrían obtenido respuestas precisas.

La “sintonización” (es decir, pronta ingeniería), utilizado para enseñar a Géminis, mostró que «una variedad de personas no tuvieron en cuenta casos que claramente no deberían mostrar un rango». Con el tiempo, dijo Google, el modelo se volvió mucho más cauteloso de lo que se pretendía y se negó a responder ciertas indicaciones por completo, interpretando erróneamente algunas indicaciones muy anodinas como sensibles.

“Estas dos cosas llevaron al modelo a compensar excesivamente en algunos casos y a ser demasiado conservador en otros, lo que generó imágenes embarazosas y erróneas”, escribió Raghavan.

Antes de que Google vuelva a activar el generador de imágenes, planea realizar pruebas exhaustivas.

Los problemas de Géminis, sin embargo, no comienzan ni terminan con la generación de imágenes. Por ejemplo, la herramienta se negó a escribir un anuncio de trabajo para la industria del petróleo y el gas debido a preocupaciones ambientales, según el distinguido vicepresidente y analista de Gartner, Avivah Litan.

Litan también señaló El análisis de Géminis. que la Constitución de Estados Unidos prohíbe cerrar el El Correo de Washington o el New York Times pero no Fox News o el Correo de Nueva York.

“La afirmación de Géminis de que comparar a Hitler y Obama es inapropiado pero Comparando a Hitler con Elon Musk Es complejo y requiere una ‘consideración cuidadosa’”, escribió Litan.

«Gemini ha recibido una merecida presión desde su reciente lanzamiento, y por una buena razón», continuó Litan. “Expone el peligro claro y presente cuando las IA bajo el control de unos pocos gigantes técnicos poderosos parecen arrojar información sesgada que a veces incluso reescribe la historia. Manipular mentes utilizando una única fuente de verdad controlada por personas autorizadas es, en mi opinión, tan peligroso como los sistemas de armas físicas.

«Lamentablemente», continuó, «no tenemos las herramientas como consumidores o como empresas para eliminar fácilmente los sesgos inherentes a los diferentes resultados de los modelos de IA».

LItan dijo que los SNAFU altamente públicos de Gemini «destacan la necesidad urgente de un enfoque regulatorio en la genAI y el sesgo».

Ritu Jyoti, analista de IDC, bromeó diciendo que “estos son tiempos interesantes y desafiantes para Google Gemini.

«De hecho, Google está a la vanguardia de las innovaciones en inteligencia artificial», dijo Jyoti, «pero parece que este escenario es un ejemplo de una consecuencia no deseada causada por cómo se ajustó el algoritmo».

Si bien el mercado aún es joven y está evolucionando rápidamente, y si bien algunos problemas de genAI son complejos, se necesita más diligencia debida en la capacitación/ajuste y en cómo estas herramientas se llevan al mercado, dijo Jyoti.

«Hay mucho en juego», dijo. “En el mercado empresarial, hay más humanos involucrados antes de que algo salga. Por lo tanto, la capacidad de contener las consecuencias negativas no deseadas es ligeramente mejor. En el mercado de consumo, la situación es mucho más complicada”.

Junto con Gemini, otros creadores de genAI han luchado por crear herramientas que no muestren prejuicios, no creen alucinaciones ni cometan infracciones de redacción al robar trabajos publicados de otros.

Por ejemplo, ChatGPT de OpenAI Tengo un abogado en problemas después de utilizar el motor para crear informes legales, una tarea típicamente tediosa que parecía perfecta para la tecnología de automatización. Desafortunadamente, la herramienta creó varias citaciones de demandas falsas para los escritos. Incluso después de disculparse ante un juez, el abogado fue despedido de su bufete.

Chon Tang, socio fundador Fondo Berkeley SkyDeckun acelerador académico de la Universidad de California-Berkeley, dijo simplemente: “La IA generativa sigue siendo inestable…, a diferencia de otras piezas de tecnología que se comportan más como ‘herramientas’ con un comportamiento muy bien definido.

«Por ejemplo, no querríamos usar un lavavajillas que no lavara nuestros platos el 5% del tiempo», dijo Tang.

Tang advirtió a las empresas que si confían en genAI para completar tareas automáticamente sin supervisión humana, se llevarán un duro despertar.

“La IA generativa se parece más a un ser humano, en el sentido de que debe gestionarse”, dijo, “las indicaciones deben examinarse minuciosamente, verificarse el flujo de trabajo y comprobarse dos veces el resultado final. Por lo tanto, no espere un sistema que complete tareas automáticamente. En cambio, la IA generativa en general, y los LLM en particular, deben verse como miembros de su equipo de muy bajo costo».

Kumar de la Universidad de Temple estuvo de acuerdo: nadie debería confiar plenamente en estas plataformas genAI «todavía».

De hecho, para muchos casos de uso empresarial, las respuestas de genAI siempre deben ser verificadas y utilizadas únicamente por expertos.

«Por ejemplo, estas son excelentes herramientas para redactar contratos o resumir informes, pero los resultados aún deben ser verificados por un experto», dijo Kumar. «A pesar de estas deficiencias, si tenemos cuidado al utilizar estos resultados, podemos ahorrar mucho tiempo. Por ejemplo, los médicos pueden utilizar los resultados de genAI para la detección inicial para ahorrar tiempo y descubrir patrones ocultos, pero genAI puede «No reemplazará a los médicos (al menos en el futuro cercano o en nuestra vida). De manera similar, GenAI puede ayudar a contratar personas, pero no deberían contratarlas todavía».

Copyright © 2024 IDG Communications, Inc.