Ferret LLM de Apple podría ayudar a permitir siri comprender el diseño de las aplicaciones en la pantalla de un iPhone, aumentando potencialmente las capacidades del asistente digital de Apple.

Apple ha estado trabajando en numerosos aprendizaje automático y Proyectos de IA eso podría provocar en WWDC 2024. En un artículo recién publicado, ahora parece que parte de ese trabajo tiene el potencial de que Siri comprenda cómo son las aplicaciones y el propio iOS.

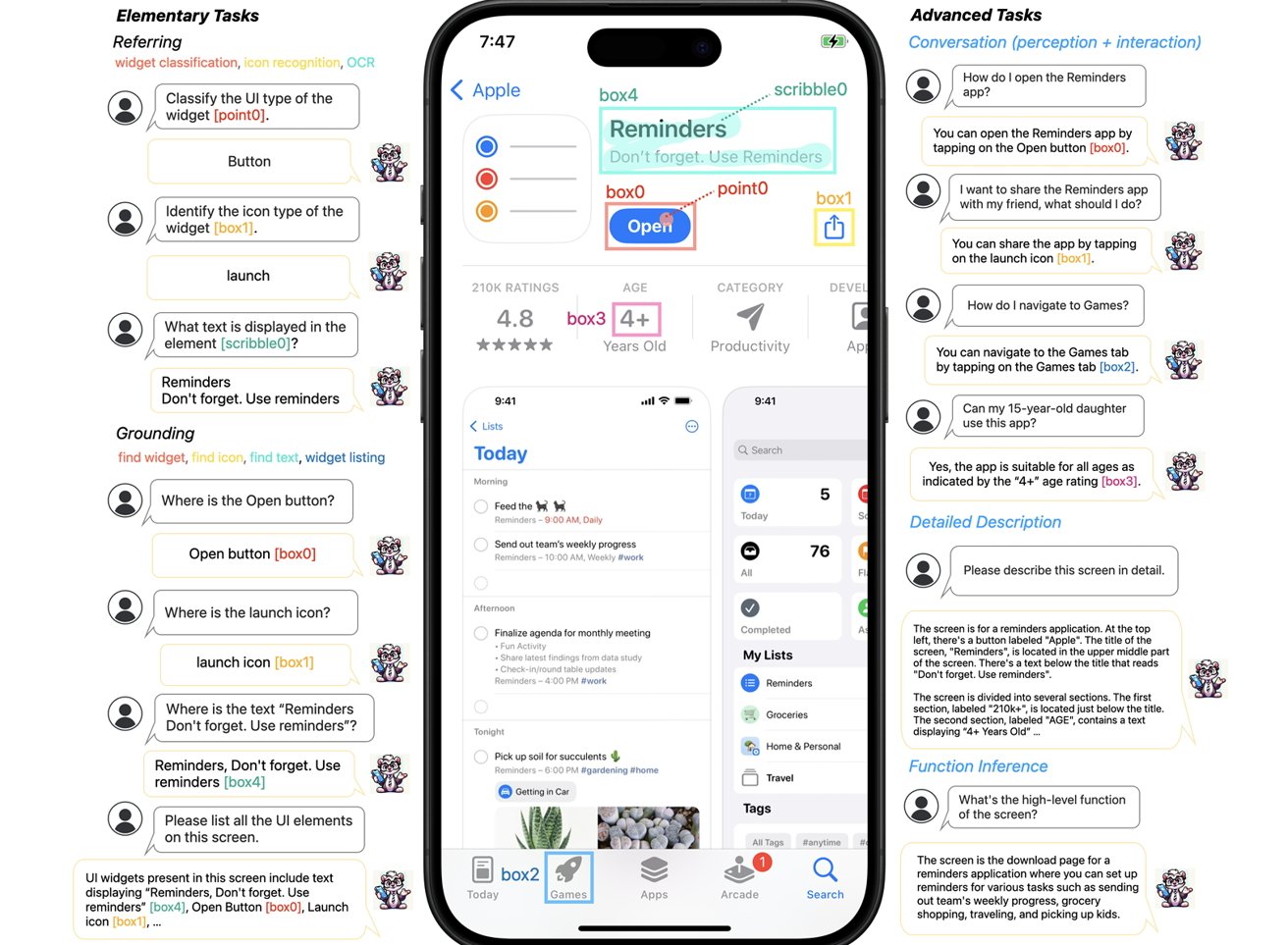

El documento, publicado por la Universidad de Cornell los lunes, se titula «Ferret-UI: comprensión de la interfaz de usuario móvil basada en LLM multimodales». Básicamente, explica un nuevo modelo de lenguaje grande multimodal (MLLM) que tiene el potencial de comprender las interfaces de usuario de las pantallas móviles.

El nombre Ferret surgió originalmente de un LLM multimodal de código abierto.lanzado en octubre, por investigadores de la Universidad de Cornell que trabajan con homólogos de Apple. En ese momento, Ferret pudo detectar y comprender diferentes regiones de una imagen para consultas complejas, como identificar una especie de animal en una parte seleccionada de una fotografía.

Un avance de LLM

El nuevo artículo de Ferret-UI explica que, si bien ha habido avances notables en el uso de MLLM, todavía «no alcanzan su capacidad para comprender e interactuar de manera efectiva con las pantallas de la interfaz de usuario (UI)». Ferret-UI se describe como un nuevo MLLM diseñado para comprender las pantallas de UI móviles, completo con «capacidades de referencia, conexión a tierra y razonamiento».

Parte del problema que tienen los LLM para comprender la interfaz de una pantalla móvil es, en primer lugar, cómo se utiliza. A menudo, en orientación vertical, esto significa que los iconos y otros detalles pueden ocupar una parte muy compacta de la pantalla, lo que dificulta la comprensión de las máquinas.

Para ayudar con esto, Ferret tiene un sistema de ampliación para mejorar las imágenes a «cualquier resolución» para hacer que los íconos y el texto sean más legibles.

Para el procesamiento y la capacitación, Ferret también divide la pantalla en dos secciones más pequeñas, cortándola por la mitad. El documento afirma que otros LLM tienden a escanear una imagen global de menor resolución, lo que reduce la capacidad de determinar adecuadamente cómo se ven los iconos.

Al agregar una importante selección de datos para la capacitación, se obtuvo un modelo que puede comprender suficientemente las consultas de los usuarios, comprender la naturaleza de varios elementos en pantalla y ofrecer respuestas contextuales.

Por ejemplo, un usuario podría preguntar cómo abrir la aplicación Recordatorios y se le pedirá que toque el botón Abrir en pantalla. Una consulta adicional sobre si un joven de 15 años podría usar una aplicación podría consultar las pautas de edad, si están visibles en la pantalla.

Un asistente de asistencia

Aunque no sabemos si se incorporará a sistemas como Siri, Ferret-UI ofrece la posibilidad de control avanzado sobre un dispositivo como un iPhone. Al comprender los elementos de la interfaz de usuario, ofrece la posibilidad de que Siri realice acciones para los usuarios en las aplicaciones, seleccionando elementos gráficos dentro de la aplicación por sí solo.

También existen aplicaciones útiles para personas con discapacidad visual. Un LLM de este tipo podría ser más capaz de explicar en detalle lo que aparece en la pantalla y, potencialmente, llevar a cabo acciones para el usuario sin que tenga que hacer nada más que pedir que esto suceda.