Por qué es importante: Las capacidades avanzadas de IA generalmente requieren modelos masivos alojados en la nube con miles de millones o incluso billones de parámetros. Pero Microsoft está desafiando eso con el Phi-3 Mini, una potencia de IA del tamaño de una pinta que puede ejecutarse en su teléfono o computadora portátil mientras ofrece un rendimiento que rivaliza con algunos de los modelos de lenguaje más importantes que existen.

Con un peso de sólo 3.800 millones de parámetros, Phi-3 Mini es el primero de tres nuevos modelos compactos de IA que Microsoft tiene en proceso. Puede que sea pequeño, pero Microsoft afirma que este pequeño superpoderoso puede superar su categoría de peso, produciendo respuestas cercanas a las que obtendría de un modelo 10 veces su tamaño.

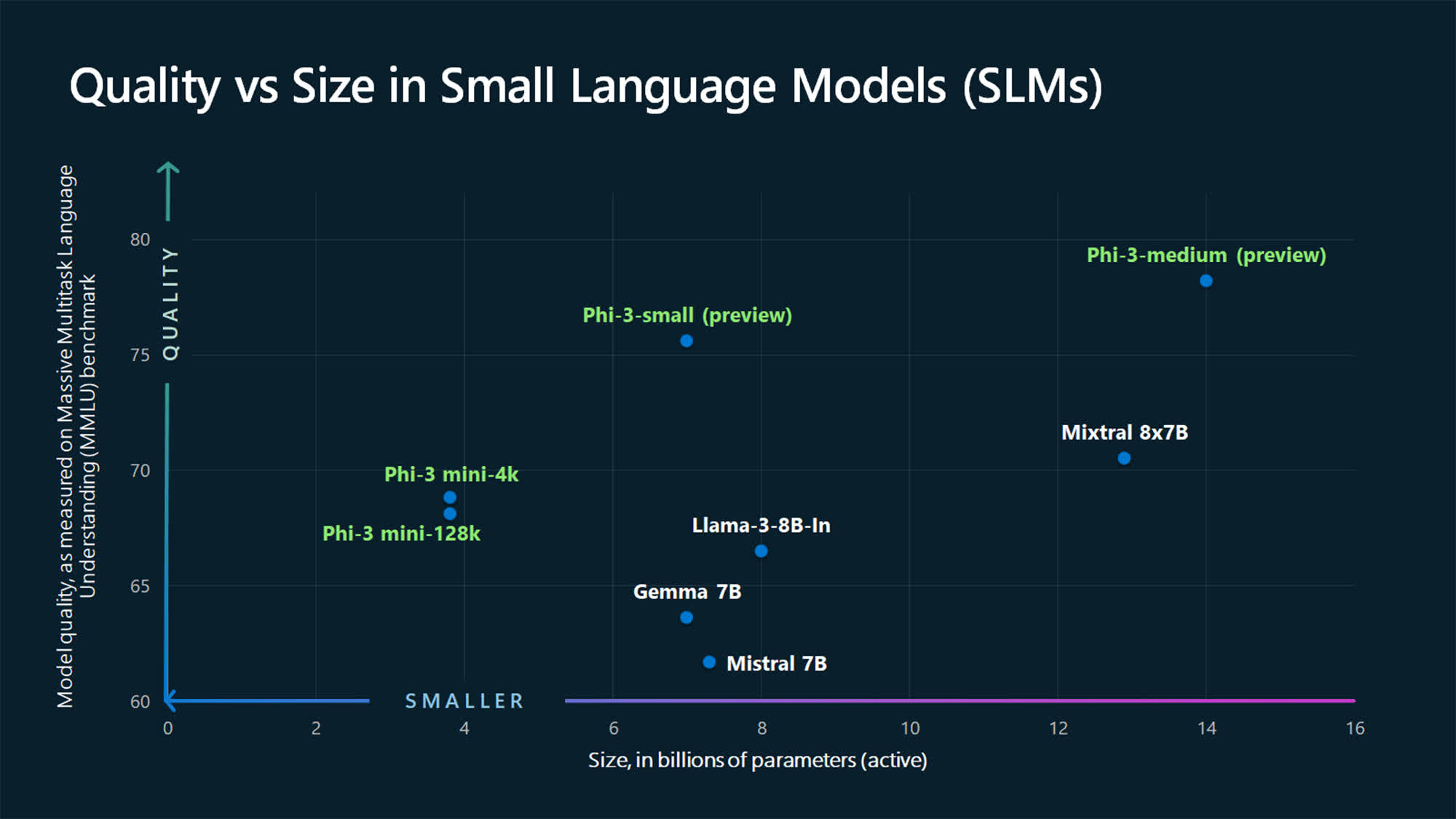

El gigante tecnológico planea seguir al Mini con Phi-3 Small (7 mil millones de parámetros) y Phi-3 Medium (14 mil millones) más adelante. Pero incluso el Mini, de 3.800 millones de parámetros, se perfila como un jugador importante, según las cifras de Microsoft.

Esos números muestran que Phi-3 Mini se mantiene firme frente a pesos pesados como el GPT-3.5 de más de 175 mil millones de parámetros que impulsa el ChatGPT gratuito, así como el modelo Mixtral 8x7B de la empresa francesa de inteligencia artificial Mistral. No está nada mal para un modelo lo suficientemente compacto como para ejecutarse localmente sin necesidad de conexión a la nube.

Entonces, ¿cómo se mide exactamente el tamaño cuando se trata de modelos de lenguaje de IA? Todo se reduce a parámetros: los valores numéricos de una red neuronal que determinan cómo procesa y genera texto. Más parámetros generalmente significan una comprensión más inteligente de sus consultas, pero también mayores demandas computacionales. Sin embargo, este no es siempre el caso, como afirma el CEO de OpenAI. Sam Altman.

Mientras que a los modelos gigantes les gusta GPT-4 de OpenAI y Claude 3 Opus de Anthropic Se rumorea que incluye varios cientos de miles de millones de parámetros, Phi-3 Mini alcanza un máximo de sólo 3.800 millones. Sin embargo, los investigadores de Microsoft lograron obtener resultados sorprendentes mediante un enfoque innovador para refinar los propios datos de entrenamiento.

Al centrar el modelo relativamente pequeño de 3.800 millones de parámetros en un conjunto de datos extremadamente seleccionado de contenido web de alta calidad y material generado sintéticamente evolucionado a partir de modelos Phi anteriores, le dieron al Phi-3 Mini habilidades descomunales para su estatura delgada. Puede manejar hasta 4000 tokens de contexto a la vez, y también está disponible una versión especial de 128k token.

«Debido a que se lee material similar a un libro de texto, documentos de calidad que explican las cosas muy, muy bien, la tarea del modelo de lenguaje para leer y comprender este material es mucho más fácil», explica Microsoft.

Las implicaciones podrían ser enormes. Si los pequeños modelos de IA como Phi-3 Mini realmente pueden ofrecer un rendimiento competitivo con los gigantes de más de mil millones de parámetros actuales, es posible que podamos dejar atrás las granjas de IA en la nube que consumen mucha energía para las tareas cotidianas.

Microsoft ya ha puesto a disposición el modelo para ponerlo a prueba en la nube de Azure, así como a través de los hosts de modelos de IA de código abierto Hugging Face y Ollama.